花200美元测了GPT-5.5 Pro的数学能力,结果和宣传的不太一样

维度GPT-5.5 Pro 的表现推理质量和 GPT-5.4 几乎一样,没有质变推理速度快了约4倍(60min → 16min)Token效率用更少token给出相似答案Agent任务比 GPT-4 快15%,质量几乎一样基准测试Frontier Math Tier 1-3 提升2%,Tier 4 提升4%API价格更贵了消费者体验快了一些,但答案没有更好一句话:GPT-5.5 Pro 是一个有价

标签:#GPT5.5Pro #AI评测 #数学推理 #OpenAI #大模型

一句话结论

GPT-5.5 Pro 相比前代,主要提升在效率(用更少token、更短时间给出相似质量的答案),而非智能水平的显著飞跃。对于花200美元订阅的用户来说,这更像是一个优化补丁,而不是新一代产品。

1. GPT-5.5 Pro 宣称了什么?

OpenAI 官方的说法:

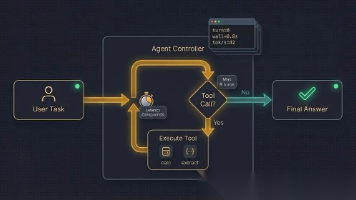

- 更擅长端到端解决方案

- 在编程代理任务上更强

- 更长的上下文,更可靠

- 效率更高——用更少的token提供同等质量的答案

- 在 agentic coding、computer use、知识工作、早期科研方面有显著进步

看起来很猛对吧?但实际测下来呢?

2. 测试一:研究级数学问题

测试者用的是一道随机矩阵理论领域的问题——一道目前还没有完整解决方案的研究级题目。这道题之前测过 Google DeepThink、Claude Extended Thinking、GPT-5.4 Pro 等模型。

基准测试数据

Copy

Frontier Math Benchmark 结果:

Tier 1-3 Tier 4

GPT-5.4 50.0% 35.4%

GPT-5.5 51.7% 39.6%

GPT-5.5 Pro 52.4% 39.6% ← 提升幅度:Tier 1-3 +2.4%, Tier 4 +4.2%

Claude Opus 4.7 43.8% 22.9%

Gemini 3.1 Pro 36.9% 16.7%

Tier 1-3 从50%提升到52%——只涨了2个百分点。Tier 4 提升了4个百分点。

进步是有的,但谈不上"飞跃"。

实际测试结果

| 模型 | 表现 |

|---|---|

| GPT-5.4 Pro | 思考超过1小时,给出了建议方向,但没有封闭形式解答 |

| Google DeepThink | 给出了较好的思路,但也没能解出 |

| Claude Extended Thinking | 类似水平 |

| GPT-5.5 Pro | 给出了目前最好的答案,但仍然没有解出 |

GPT-5.5 Pro 确实是表现最好的。但关键区别在于:

GPT-5.4 Pro 需要60分钟以上,GPT-5.5 Pro 只用了16分钟。

答案质量相似,时间缩短了约75%。

Copy

# 效率对比

efficiency = {

"GPT-5.4 Pro": {"thinking_time": "60min+", "answer_quality": "good"},

"GPT-5.5 Pro": {"thinking_time": "16min", "answer_quality": "similar"},

# 答案几乎一样,但快了将近4倍

}

测试者的原话:"建议内容几乎一模一样(pretty much exactly the same)。"

3. 测试二:Codex 编程代理任务

第二个测试更贴近实际开发者场景:用 Codex 接手一个复杂数学研究项目,整合多份文档生成新的预印本。

测试配置:

- 工具:VS Code + Codex

- 任务:读取旧草稿 + Codex 工作文件 + 相关数学内容,合并生成新文档

- 对比:GPT-4 vs GPT-5.5

结果

Copy

GPT-4 Codex: 工作 6分3秒,生成了一份预印本 PDF

GPT-5.5 Codex: 工作约5分10秒,生成了一份几乎一模一样的 PDF

效率提升:~15%(思考时间缩短约1分钟)

质量差异:几乎无法区分哪个是新版模型的输出

测试者直接说:"两个模型生成的PDF质量几乎一致,难以区分哪个是更新的模型。"

唯一的微弱优势:GPT-5.5 多引入了一个方程。但主草稿中的大量方程它也没有包含。

而且两个模型都只用了约6分钟的推理时间,输出都很仓促。

4. 那到底谁获益了?

这是测试者问得最尖锐的问题。

Copy

OpenAI 的收益:

✅ API效率更高 → 服务成本更低 → 利润率更高

✅ 可以用"新产品"的名义维持/提高订阅价格

✅ 有新的营销素材

消费者的收益:

✅ 回答速度快了一些(从60min → 16min)

❓ 答案质量没有明显提升

❌ API 价格更贵了

❌ 订阅费没有降

测试者的总结:"GPT-5.5 更多是 OpenAI 自身的改进,不是为付费用户带来显著提升。"

他甚至直接批评说:"看到 OpenAI 不断发布这些模型,版本号每次只涨0.1——5.2、5.3、5.4、现在5.5——感觉更像是为了吸引订阅的炒作。"

5. 我的看法

看完这个实测,我有几点感受:

5.1 效率提升本身也有价值

把推理时间从60分钟缩短到16分钟,这在实际开发中是有意义的。如果你在做科研辅助或者大规模推理任务,token消耗减半 = API费用减半。

但问题是:GPT-5.5 的 API 单价更贵了。 效率提升带来的成本节省,可能被单价上涨抵消一部分。

5.2 "更聪明"和"更快"是两码事

OpenAI 在营销中暗示 GPT-5.5 "更聪明"了,但实测结果表明它主要是**"更快"**。

对于愿意等一个小时但要更好答案的用户来说,这个升级意义不大。

对于时间敏感的场景(比如实时对话、快速迭代),这个升级是有用的。

5.3 大模型的能力提升正在放缓?

从 GPT-4 到 GPT-5,有一个明显的智能跃升。但从 GPT-5 到 GPT-5.5,提升幅度明显变小了。

这可能意味着:大模型的"暴力scaling"路线正在碰到天花板。 后续的提升更多来自工程优化(效率、工具使用、agent能力),而不是基础智能的飞跃。

Copy

# 大模型智能提升曲线(个人推测)

智能

↑

│ ╭──── 未来的提升?

│ ╭───╯

│ ╭───╯ ← GPT-5 → 5.5(边际递减)

│ ╭───╯

│ ╭───╯ ← GPT-3.5 → 4(大跃升)

│ ╭───╯

│ ╭───╯

│──╯

└──────────────────────────────→ 时间

5.4 对开发者的建议

Copy

# 实际建议

# 1. 如果你主要用 GPT 做简单任务(代码补全、翻译、格式化)

# → 升级到 5.5 体验会好一些(更快),但差别不大

# 2. 如果你在做复杂数学推理或科研

# → 5.5 Pro 有点用(速度快4倍),但答案质量没变

# → 复杂问题还是解不了

# 3. 如果你在用 API 做大规模推理

# → 仔细算一笔账:效率提升 vs 单价上涨,哪个更大?

# 4. 如果你在做 agent/coding 任务

# → 5.5 和 4 的差距很小(15%),不必急着迁移

6. 总结

| 维度 | GPT-5.5 Pro 的表现 |

|---|---|

| 推理质量 | 和 GPT-5.4 几乎一样,没有质变 |

| 推理速度 | 快了约4倍(60min → 16min) |

| Token效率 | 用更少token给出相似答案 |

| Agent任务 | 比 GPT-4 快15%,质量几乎一样 |

| 基准测试 | Frontier Math Tier 1-3 提升2%,Tier 4 提升4% |

| API价格 | 更贵了 |

| 消费者体验 | 快了一些,但答案没有更好 |

一句话:GPT-5.5 Pro 是一个有价值的效率优化,但不是一次智能革命。

不要被"博士级数学题1小时内解决"这样的标题骗了。测试者的实际结论是——它确实更快了,但并没有变得更聪明。

以上分析基于 YouTube 频道 GoldenSpiderAI 的实测视频内容。如果你也在用 GPT-5.5 Pro,欢迎在评论区分享你的体验。

#GPT5.5Pro #OpenAI #AI评测 #大模型推理 #数学AI #Python

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)