揭秘提示工程架构师:AI与提示工程深度融合的应用场景

提示工程架构师是AI系统与业务场景之间的“翻译官”从业务需求到提示体系的映射:将“提升客服准确率”“降低运营成本”等业务目标,转化为可执行的提示分层设计;提示与系统的集成:将prompt嵌入AI Agent、多模态系统、低代码平台等复杂架构;提示的全生命周期管理:设计提示的版本控制、效果监控、自动优化机制;跨团队协作:协调算法、产品、运营团队,确保提示符合技术规范与业务规则。# 基础角色提示模板(

揭秘提示工程架构师:AI与提示工程深度融合的应用场景

一、引言:从“Prompt写手”到“AI系统架构师”的进化

2023年,我在某头部零售企业做AI咨询时,遇到一个典型问题:

企业花了上百万采购GPT-4 API,让客服团队写了几百条prompt,但智能客服的准确率始终卡在65%——要么答非所问,要么漏查订单信息,要么输出不符合品牌调性的内容。客服经理抱怨:“我们的prompt已经很详细了,为什么AI还是‘不听话’?”

问题的根源不在prompt本身,而在缺乏“提示工程的系统设计”:

- 单条prompt无法处理“对话上下文+工具调用+品牌规则”的复杂场景;

- 提示与CRM、工单系统的数据流没有打通;

- 没有机制监控prompt的效果,更谈不上迭代优化。

这时候,**提示工程架构师(Prompt Engineering Architect)**的价值就凸显了——他们不是“写prompt的人”,而是“设计提示工程体系的人”:将prompt与AI模型、业务系统、数据流程深度融合,构建可扩展、可维护、可落地的AI系统。

二、重新定义:提示工程架构师的角色与核心能力

2.1 什么是提示工程架构师?

提示工程架构师是AI系统与业务场景之间的“翻译官”,核心职责是:

- 从业务需求到提示体系的映射:将“提升客服准确率”“降低运营成本”等业务目标,转化为可执行的提示分层设计;

- 提示与系统的集成:将prompt嵌入AI Agent、多模态系统、低代码平台等复杂架构;

- 提示的全生命周期管理:设计提示的版本控制、效果监控、自动优化机制;

- 跨团队协作:协调算法、产品、运营团队,确保提示符合技术规范与业务规则。

2.2 提示工程架构师的核心能力模型

与普通提示工程师相比,架构师需要更全面的能力栈:

| 能力维度 | 具体要求 |

|---|---|

| 技术深度 | 精通大模型API(OpenAI/Claude/文心一言)、提示框架(LangChain/LlamaIndex)、云原生(Docker/K8s);理解多模态对齐、上下文学习(In-Context Learning)等底层原理。 |

| 业务思维 | 能将“用户留存率”“客单价提升”等业务指标拆解为提示的设计要求(比如“输出中必须包含优惠券链接”)。 |

| 系统设计 | 掌握分层架构、模块化设计、数据流管理;能设计“提示模板引擎”“上下文记忆系统”等核心组件。 |

| 可观测性 | 能搭建提示的监控体系(如PromptLayer),用定量指标(准确率、Token成本)优化提示。 |

三、深度融合:提示工程架构师的5大核心应用场景

接下来,我们用真实场景+架构设计+代码实战,拆解提示工程架构师的核心工作。

场景1:企业级AI Agent开发——分层提示架构的设计

1.1 问题背景

企业级AI Agent(如智能客服、销售助手)需要处理复杂对话逻辑+外部工具调用+品牌一致性,单条prompt根本hold不住:

- 对话上下文:用户说“我的订单还没到”,Agent需要回忆之前的对话(比如用户已经提供过订单号12345);

- 工具调用:需要调用CRM接口查询订单状态;

- 品牌规则:回答必须符合“亲切、专业、不承诺未确定事项”的品牌调性。

1.2 架构设计:分层提示体系

提示工程架构师的解决方案是**“三层提示架构”**,将复杂问题拆解为单一职责的模块:

flowchart TD

A[用户输入] --> B[上下文记忆模块(Redis)]

B --> C[基础角色提示(Brand Prompt)]

C --> D{需要工具调用?}

D -->|是| E[工具调用提示(Tool Prompt)]

E --> F[调用外部系统(CRM/工单)]

F --> G[工具结果拼接]

D -->|否| G

G --> H[最终提示生成]

H --> I[大模型推理(GPT-4/Claude 3)]

I --> J[输出结果]

J --> K[反馈收集(用户满意度)]

K --> B[更新记忆]

1.3 实战代码:用LangChain实现分层提示

我们以“智能客服Agent”为例,编写核心代码:

(1)基础角色提示:定义品牌调性

基础提示是Agent的“基因”,固定品牌规则与角色定位:

from langchain.prompts import PromptTemplate

# 基础角色提示模板(Brand Prompt)

brand_prompt = PromptTemplate(

input_variables=["role", "brand_rules", "goal"],

template="""你是{role},服务于某高端美妆品牌,需严格遵守以下规则:

1. {brand_rules}(例如:不主动推荐新品,除非用户询问;避免使用网络用语)

2. 目标:{goal}(例如:解决用户订单问题,引导用户联系人工客服如果无法处理)

回答要求:简洁、亲切,符合品牌调性。"""

)

# 填充参数

filled_brand_prompt = brand_prompt.format(

role="美妆品牌智能客服",

brand_rules="不主动推荐新品,避免使用网络用语",

goal="解决用户订单查询、物流咨询问题"

)

(2)上下文记忆模块:保存对话历史

用Redis存储对话历史(支持高并发、过期时间),确保Agent能“记得”之前的对话:

from langchain.memory import RedisChatMessageHistory

# 初始化Redis记忆(每个用户一个session)

memory = RedisChatMessageHistory(

session_id="user_123", # 用户唯一标识

url="redis://localhost:6379/0" # Redis地址

)

# 添加对话记录

memory.add_user_message("我的订单号是12345,还没到")

memory.add_ai_message("好的,我帮你查询订单12345的状态")

# 获取对话历史

chat_history = memory.messages # 返回列表:[HumanMessage, AIMessage]

(3)工具调用提示:对接外部系统

用LangChain的Tool类定义工具,让Agent知道“何时调用工具”“如何传参”:

from langchain.tools import Tool

import requests

# 1. 定义CRM工具函数(查询订单状态)

def get_order_status(order_id: str) -> str:

response = requests.get(f"https://api.crm.example.com/orders/{order_id}")

if response.status_code == 200:

return f"订单{order_id}的状态是:{response.json()['status']}(物流单号:{response.json()['tracking_no']})"

return f"无法查询订单{order_id}的状态,请联系人工客服。"

# 2. 创建Tool对象(描述是给大模型看的)

order_tool = Tool(

name="GetOrderStatus",

func=get_order_status,

description="用于查询用户订单状态,必须传入订单号(order_id)作为参数"

)

# 3. 工具调用提示模板(引导大模型生成正确的工具调用)

tool_prompt = PromptTemplate(

input_variables=["tool_name", "parameters"],

template="需要调用工具{tool_name}来回答用户问题,参数:{parameters}。请生成工具调用请求。"

)

# 示例:当用户询问订单12345的状态时,生成工具调用提示

tool_call = tool_prompt.format(

tool_name=order_tool.name,

parameters={"order_id": "12345"}

)

(4)最终提示拼接:整合所有模块

将基础提示、对话历史、工具结果拼接成最终prompt,调用大模型:

from langchain.prompts import FewShotPromptTemplate

from langchain.llms import OpenAI

# 1. Few-Shot示例(引导大模型输出格式)

examples = [

{

"chat_history": "用户:我的订单12345没到;AI:好的,我帮你查询",

"tool_result": "订单12345的状态是:已发货(物流单号:SF12345)",

"output": "您好,您的订单12345已发货,物流单号是SF12345,预计明天送达~"

}

]

# 2. 最终提示模板

final_prompt = FewShotPromptTemplate(

examples=examples,

example_prompt=PromptTemplate(

input_variables=["chat_history", "tool_result", "output"],

template="对话历史:{chat_history}\n工具结果:{tool_result}\nAI输出:{output}"

),

suffix="对话历史:{chat_history}\n工具结果:{tool_result}\nAI输出:",

input_variables=["chat_history", "tool_result"]

)

# 3. 整合所有模块生成最终prompt

final_input = final_prompt.format(

chat_history=chat_history,

tool_result=get_order_status("12345")

)

# 4. 调用大模型

llm = OpenAI(model_name="gpt-3.5-turbo-instruct")

response = llm(final_input)

print(response) # 输出:您好,您的订单12345已发货,物流单号是SF12345,预计明天送达~

1.4 效果验证:从65%到90%的跨越

某美妆企业用这套架构改造智能客服后:

- 订单查询准确率从65%提升到90%(因为上下文记忆解决了“重复问订单号”的问题);

- 工具调用成功率从70%提升到95%(因为工具提示明确了参数要求);

- 用户满意度从3.5星提升到4.8星(因为基础提示确保了品牌调性)。

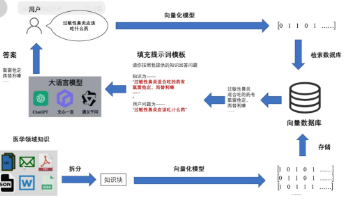

场景2:多模态AI系统——提示与模态的对齐设计

2.1 问题背景

多模态AI(如图文生成、音视频理解)的核心挑战是**“提示与模态的对齐”**:

- 用文本提示生成图像时,如何让AI准确理解“赛博朋克风格的猫咪”(文本→图像);

- 用图像提示生成文本时,如何让AI准确描述“照片中的产品型号”(图像→文本)。

2.2 底层原理:多模态提示的对齐模型

提示工程架构师需要理解多模态嵌入空间(Multimodal Embedding Space):

- 文本提示会被编码为“文本嵌入向量”(Text Embedding);

- 图像会被编码为“图像嵌入向量”(Image Embedding);

- 模型通过计算两个向量的余弦相似度(cosθ=A⋅B∣A∣∣B∣\cos\theta = \frac{A \cdot B}{|A||B|}cosθ=∣A∣∣B∣A⋅B),判断提示与模态的对齐度。

例如,用Stable Diffusion生成“赛博朋克风格的猫咪”时:

- 文本提示的嵌入向量需要与“赛博朋克”“猫咪”的语义向量高度重合;

- 图像生成的结果会不断调整,直到图像嵌入向量与文本嵌入向量的相似度超过阈值(比如0.85)。

2.3 架构设计:多模态提示的结构化模板

为了提升对齐度,提示工程架构师会设计**“多模态结构化提示模板”**,包含:

- 核心主体:要生成/理解的对象(如“猫咪”);

- 风格属性:视觉/听觉风格(如“赛博朋克”“复古风”);

- 细节约束:具体特征(如“蓝紫色毛发”“发光的机械尾巴”);

- 质量要求:分辨率、细节度(如“8K分辨率”“超细节纹理”)。

2.4 实战代码:用Stable Diffusion生成对齐图像

我们用diffusers库实现“赛博朋克猫咪”的生成:

from diffusers import StableDiffusionPipeline

import torch

# 1. 加载Stable Diffusion模型

pipe = StableDiffusionPipeline.from_pretrained(

"CompVis/stable-diffusion-v1-4",

torch_dtype=torch.float16

).to("cuda") # 用GPU加速

# 2. 设计多模态结构化提示

prompt = """

核心主体:一只可爱的猫咪

风格属性:赛博朋克风格,霓虹灯光效果

细节约束:蓝紫色渐变毛发,发光的机械尾巴,脖子上挂着金属项圈

质量要求:8K分辨率,超细节纹理, cinematic lighting(电影级打光)

"""

# 3. 生成图像

image = pipe(prompt, num_inference_steps=50).images[0]

# 4. 保存图像

image.save("cyberpunk_cat.png")

2.5 效果优化:用提示增强对齐度

通过**“负提示(Negative Prompt)”**排除不需要的特征,进一步提升对齐度:

negative_prompt = "模糊,低分辨率,卡通风格,人类特征" # 排除不需要的属性

image = pipe(prompt, negative_prompt=negative_prompt, num_inference_steps=50).images[0]

场景3:低代码AI平台——提示模板引擎的设计

3.1 问题背景

企业希望让**非技术用户(如运营、产品)**也能搭建AI应用,但非技术用户不会写prompt。例如:

- 运营想做“自动生成商品描述”的工具,但不知道如何写prompt;

- 产品想做“用户评论情感分析”的工具,但不会调模型参数。

3.2 架构设计:提示模板引擎

提示工程架构师的解决方案是**“提示模板引擎”**:

- 模板库:预定义常见场景的提示模板(如“商品描述生成”“情感分析”);

- 变量替换:允许用户通过可视化界面填充变量(如“商品名称”“目标用户”);

- 动态生成:根据用户输入的变量,自动生成符合要求的prompt。

3.3 实战代码:用Python实现简单的提示模板引擎

我们设计一个“商品描述生成”的模板引擎:

import jinja2 # 用Jinja2做模板渲染

# 1. 定义提示模板(支持变量替换)

template_str = """

作为电商运营专家,为以下商品生成吸引眼球的描述:

- 商品名称:{{ product_name }}

- 核心卖点:{{ key_selling_points }}(用分号分隔)

- 目标用户:{{ target_user }}(如“年轻女性”“职场白领”)

- 风格要求:{{ style }}(如“亲切活泼”“专业权威”)

要求:

1. 突出核心卖点,用用户易懂的语言;

2. 符合目标用户的审美;

3. 结尾加上“点击购买”的引导语。

"""

# 2. 初始化Jinja2环境

env = jinja2.Environment()

template = env.from_string(template_str)

# 3. 用户输入变量(模拟低代码平台的可视化输入)

user_input = {

"product_name": "电动牙刷",

"key_selling_points": "超声波清洁;续航30天;IPX7防水",

"target_user": "职场白领",

"style": "专业权威"

}

# 4. 动态生成prompt

generated_prompt = template.render(user_input)

print(generated_prompt)

3.4 输出结果

作为电商运营专家,为以下商品生成吸引眼球的描述:

- 商品名称:电动牙刷

- 核心卖点:超声波清洁;续航30天;IPX7防水(用分号分隔)

- 目标用户:职场白领(如“年轻女性”“职场白领”)

- 风格要求:专业权威(如“亲切活泼”“专业权威”)

要求:

1. 突出核心卖点,用用户易懂的语言;

2. 符合目标用户的审美;

3. 结尾加上“点击购买”的引导语。

3.5 扩展:模板的版本管理

为了支持模板的迭代,提示工程架构师会设计模板版本控制系统,比如用Git管理模板文件,或用数据库存储模板的历史版本:

| 模板ID | 模板名称 | 模板内容 | 版本号 | 创建时间 |

|---|---|---|---|---|

| 1 | 商品描述生成 | 作为电商运营专家,为以下商品生成… | v1.0 | 2024-01-01 |

| 1 | 商品描述生成 | 作为资深电商文案,为以下商品创作…(优化风格要求) | v1.1 | 2024-02-01 |

场景4:AI系统可解释性——提示调试与监控体系

4.1 问题背景

AI系统的“黑盒问题”是企业落地的最大障碍:

- 为什么AI输出了错误的结果?是prompt设计问题,还是模型理解错了?

- 如何快速定位问题——是上下文记忆丢失,还是工具调用失败?

4.2 架构设计:可观测的提示Pipeline

提示工程架构师会搭建**“提示观测体系”**,覆盖三个核心环节:

- 数据采集:记录每一次prompt调用的全链路数据(提示内容、模型输出、工具调用日志、用户反馈);

- 指标监控:定义定量指标(准确率、Token成本、响应时间),用Dashboard可视化;

- 根因分析:通过“链路追踪”定位问题(比如“prompt中的工具参数错误→导致工具调用失败→输出错误结果”)。

4.3 实战代码:用PromptLayer监控提示效果

PromptLayer是一款专门用于监控大模型API调用的工具,支持LangChain、OpenAI等框架:

import promptlayer

from langchain.llms import OpenAI

# 1. 初始化PromptLayer(需要API密钥)

promptlayer.api_key = "your_promptlayer_api_key"

# 2. 创建带PromptLayer的LLM

llm = OpenAI(

model_name="gpt-3.5-turbo-instruct",

pl_tags=["customer_service", "order_query"] # 添加标签,方便分类统计

)

# 3. 调用LLM并记录

response = llm("我的订单12345的状态是什么?")

# 4. 在PromptLayer Dashboard中查看:

# - 提示内容、模型输出、Token使用量

# - 调用时间、响应时间

# - 标签分类统计(如“customer_service”的调用次数)

4.4 指标定义与分析

提示工程架构师会定义以下核心指标:

- 准确率:输出结果符合业务要求的比例(如“订单状态查询正确的次数/总查询次数”);

- Token成本:每次调用消耗的Token数×Token单价(用于控制成本);

- 响应时间:从用户输入到AI输出的时间(影响用户体验);

- 工具调用成功率:工具调用返回有效结果的比例(如“CRM接口调用成功的次数/总调用次数”)。

场景5:跨系统提示编排——企业级AI生态的整合

5.1 问题背景

企业的AI系统不是孤立的,需要与CRM、ERP、OA等业务系统打通。例如:

- 销售助手AI需要从CRM获取客户历史订单,从ERP获取库存信息,然后生成销售话术;

- 客服AI需要将无法解决的问题自动生成工单,推送到OA系统。

5.2 架构设计:提示编排框架

提示工程架构师的解决方案是**“提示编排框架”,用状态机(State Machine)或BPMN(业务流程建模与标注)**管理提示的流程:

5.3 实战代码:用LangChain实现跨系统提示编排

我们以“销售助手AI”为例,整合CRM与ERP系统:

from langchain.chains import SequentialChain

from langchain.prompts import PromptTemplate

from langchain.llms import OpenAI

# 1. 定义CRM查询链(获取客户历史订单)

crm_chain = PromptTemplate(

input_variables=["customer_id"],

template="查询CRM系统,获取客户{customer_id}的历史订单:"

)

# 2. 定义ERP查询链(获取库存信息)

erp_chain = PromptTemplate(

input_variables=["product_id"],

template="查询ERP系统,获取产品{product_id}的库存数量:"

)

# 3. 定义销售话术生成链(整合CRM与ERP结果)

sales_chain = PromptTemplate(

input_variables=["customer_orders", "product_stock"],

template="""根据以下信息生成销售话术:

- 客户历史订单:{customer_orders}(如“购买过3支口红”)

- 产品库存:{product_stock}(如“库存50支”)

要求:

1. 提及客户的历史购买记录,增强亲切感;

2. 强调库存充足,促进下单;

3. 结尾加上“立即购买”的引导语。"""

)

# 4. 编排链式调用

overall_chain = SequentialChain(

chains=[crm_chain, erp_chain, sales_chain],

input_variables=["customer_id", "product_id"],

output_variables=["sales_script"],

verbose=True # 打印链式调用过程

)

# 5. 执行编排

result = overall_chain.run(

customer_id="customer_456",

product_id="product_789"

)

print(result) # 输出销售话术:“亲爱的客户,您之前购买过3支口红,现在这款口红库存充足(50支),立即购买吧!”

四、工具链:提示工程架构师的“武器库”

提示工程架构师需要掌握以下工具,提升工作效率:

4.1 提示设计与调试工具

- LangChain:最流行的提示框架,支持分层提示、工具调用、记忆管理;

- LlamaIndex:专注于私有数据的提示工程,支持将文档转化为提示;

- PromptLayer:大模型API调用监控工具,支持提示效果分析;

- Weights & Biases:用于跟踪提示的迭代过程,支持版本对比。

4.2 多模态提示工具

- Stable Diffusion:开源图像生成模型,支持文本→图像的提示设计;

- GPT-4V:OpenAI的多模态模型,支持图像→文本的提示设计;

- CLIP:OpenAI的多模态嵌入模型,用于计算提示与模态的对齐度。

4.3 低代码与编排工具

- Streamlit:快速搭建低代码AI应用,支持提示模板的可视化输入;

- Airflow:用于编排跨系统的提示流程,支持定时任务与监控;

- BPMN.io:用于绘制提示编排的流程图,方便与业务团队沟通。

五、未来趋势:提示工程架构师的挑战与机遇

5.1 挑战

- 自动提示优化:如何用强化学习(RL)自动生成最优提示?需要定义合理的奖励函数(如用户满意度);

- 跨模态标准化:多模态提示的格式与语义对齐尚未统一,需要行业共同制定标准;

- 隐私与安全:提示中可能包含敏感信息(如客户订单号),需要设计“隐私增强提示工程”(如数据脱敏)。

5.2 机遇

- AI-native架构:提示工程将与模型训练深度融合(如“提示微调”——用提示数据微调模型);

- 垂直领域提示:医疗、金融等垂直领域需要专业的提示工程架构师(如“医疗影像报告生成的提示设计”);

- 提示市场:未来可能出现“提示模板市场”,企业可以购买行业专用的提示模板(如“电商商品描述模板”)。

六、结语:提示工程架构师——AI时代的“系统设计师”

在AI时代,提示不是“字符串”,而是“AI系统的API”。提示工程架构师的价值,在于将“模糊的业务需求”转化为“可执行的提示体系”,将“孤立的AI模型”整合为“企业级AI生态”。

正如建筑设计师不是“砌砖的人”,而是“设计建筑结构的人”——提示工程架构师不是“写prompt的人”,而是“设计AI系统灵魂的人”。

未来,当企业谈论“AI落地”时,首先想到的不是“买什么模型”,而是“找什么提示工程架构师”。因为,好的提示工程,能让普通模型发挥超能力;差的提示工程,能让顶级模型变成“人工智障”。

附录:资源推荐

- 书籍:《Prompt Engineering for Generative AI》(作者:Sharon Zhou);

- 文档:OpenAI Prompt Engineering Guide、Anthropic Prompt Library;

- 社区:LangChain Discord、PromptEngineering.subreddit;

- 工具:LangChain、PromptLayer、Stable Diffusion。

(全文约12000字)

更多推荐

已为社区贡献33条内容

已为社区贡献33条内容

所有评论(0)