毕业设计:行人闯红灯行为智能检测与预警系统 人工智能

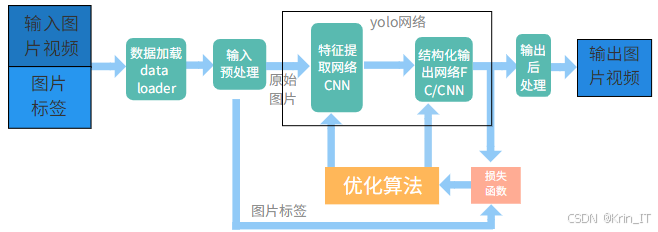

基于计算机视觉的实时监测系统通过对交通监控视频数据的收集和分析,建立行人闯红灯的事件数据库,并对相关因素进行统计分析。采用深度学习模型进行行人检测和行为识别,构建行人闯红灯的智能检测系统。对于计算机专业、交通工程专业、社会学专业及心理学专业的同学而言,不论是对交通安全、行为分析还是深度学习感兴趣,都能为您提供丰富的选题资源和灵感。

目录

前言

📅大四是整个大学期间最忙碌的时光,一边要忙着备考或实习为毕业后面临的就业升学做准备,一边要为毕业设计耗费大量精力。近几年各个学校要求的毕设项目越来越难,有不少课题是研究生级别难度的,对本科同学来说是充满挑战。为帮助大家顺利通过和节省时间与精力投入到更重要的就业和考试中去,学长分享优质的选题经验和毕设项目与技术思路。

🚀对毕设有任何疑问都可以问学长哦!

选题指导:

大家好,这里是海浪学长毕设专题,本次分享的课题是

🎯行人闯红灯行为智能检测与预警系统

设计思路

一、课题背景与意义

行人闯红灯是城市交通安全管理中的一项重要问题,严重影响交通安全,增加交通事故的发生率。随着城市化进程的加快,行人和车辆之间的冲突日益加剧,行人闯红灯现象屡见不鲜。理解行人闯红灯的原因及其行为模式不仅有助于改善交通安全管理,也能够为交通设施的优化设计提供科学依据。通过引入计算机视觉和深度学习技术,可以实现对行人闯红灯行为的实时监测,从而为交通管理提供及时的预警和响应。

二、算法理论原理

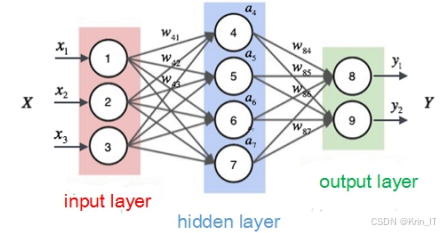

2.1 卷积神经网络

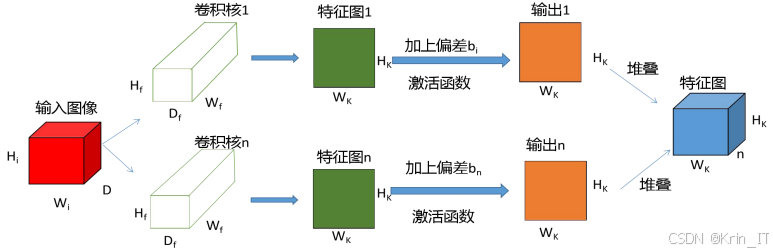

卷积神经网络(CNN)是一种专门为图像和视觉数据处理而设计的深度学习模型,广泛应用于各种计算机视觉任务,如图像分类、物体检测和图像分割。CNN的基本原理是通过卷积操作提取图像中的特征,从而实现对图像内容的有效分析。卷积层是CNN的核心组成部分,它通过使用多个卷积核(或滤波器)对输入图像进行局部感知。每个卷积核在图像上滑动,通过对相邻像素进行加权和计算生成特征图。卷积操作不仅能够捕捉局部特征(如边缘、角点和纹理),还能够通过层次化的方式逐渐提取更高层次的抽象特征,从而实现对图像的深层理解。

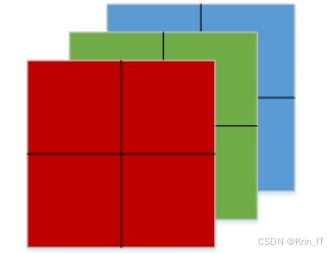

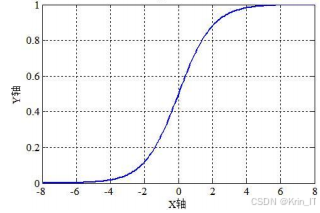

卷积层的输出特征图通常会经过激活函数(如ReLU)处理,以引入非线性特性,帮助网络学习更复杂的模式。激活函数的引入使得CNN能够拟合更复杂的函数关系,提升模型的表达能力。在卷积层之后,池化层通常会被加入以对特征图进行下采样,减少数据的维度并提高计算效率。池化操作能够有效保留重要的特征信息,同时抑制噪声。常用的池化方法包括最大池化和平均池化,它们通过选择特征图局部区域的最大值或平均值,减少了特征图的空间尺寸,降低了计算复杂度,并减少了过拟合的风险。最终,通过多层次的卷积和池化操作,CNN能够在不同的抽象层次上学习图像特征,从而实现高效的图像识别与处理。

在设计卷积层时,卷积核的大小通常为3x3或5x5,较小的卷积核能够捕捉更细致的特征。通过堆叠多个卷积层,可以逐渐提取高层次的特征。每一层的输出都能作为下一层的输入,从而形成一个深度学习的特征提取链。此外,池化层的设置则有助于降低特征图的维度,常见的池化方式有2x2的最大池化和2x2的平均池化。设计网络时还需考虑参数数量,过多的参数可能导致过拟合。为了避免这一问题,可以采用正则化技术,如Dropout、L2正则化和Batch Normalization等,来提高模型的泛化能力。

卷积神经网络的架构设计是影响模型性能的关键因素之一。一个成功的网络架构通常由多个卷积层、池化层和全连接层组成,每一层负责提取不同层次的特征。在设计网络时,通常采用逐层加深的方式,通过增加卷积层的数量来提升模型的表达能力。每个卷积层后都可以添加激活函数(如ReLU、Sigmoid或Tanh),以引入非线性特征,使网络能够学习更复杂的模式。激活函数的选择对模型的收敛速度和最终性能至关重要,不同的激活函数在不同任务中可能表现出不同的效果。

在网络的最后,通常会引入全连接层,将卷积层提取的特征整合,并输出最终的分类结果或回归值。全连接层通过将所有特征连接到输出层,尽可能地利用提取到的特征信息。在分类任务中,输出层通常使用Softmax激活函数,将输出转换为各个类别的概率分布。随着网络深度的增加,模型在特征学习和表示能力方面也会显著增强,但这也增加了训练的复杂性,因此需要合理选择学习率、批次大小等超参数,以确保模型的稳定性和收敛性。

2.2 YOLOv5算法

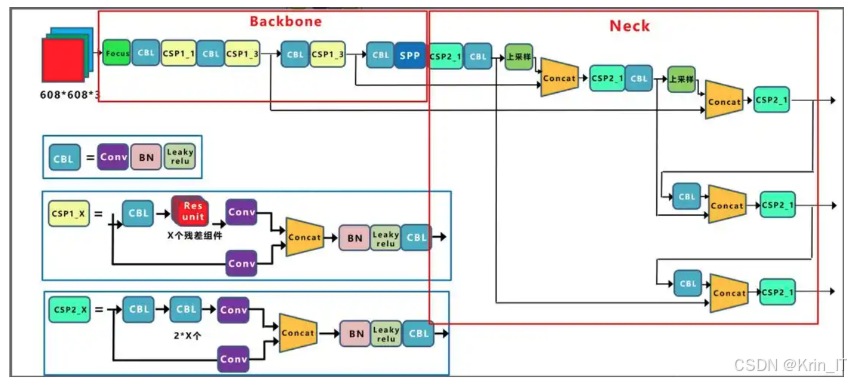

YOLOv5s是一种高效的目标检测模型,专门设计用于实时物体检测任务。它基于YOLO系列的基本理念,通过将图像分割为多个网格,并在每个网格中预测边界框和类别概率,来实现快速和准确的目标检测。YOLOv5s相较于之前的版本在速度与准确率之间取得了更好的平衡,适合在计算资源有限的环境中使用。在行人闯红灯的检测场景中,YOLOv5s能够快速识别交通信号灯、行人及其行为。模型的输入为整张图像,经过卷积层和池化层的处理后,输出为每个网格中预测的边界框和相应的置信度分数。YOLOv5s采用了改进的特征提取网络(如CSPNet),通过多层特征融合来提高检测精度,同时减少计算量。这样,模型能够在确保实时性要求的同时,提供高质量的检测结果。

YOLOv5s的架构设计充分考虑了目标检测任务的需求,采用了深度可分离卷积、CSP结构和FPN等技术,以提高模型的检测性能。YOLOv5s的网络结构相对较轻,适合在边缘设备上运行,能够实现快速推理。模型的设计还包括了多个尺度的特征图,使得YOLOv5能够检测不同尺寸的目标,这对于行人闯红灯检测尤为重要,因为行人与交通信号灯的尺寸和位置可能会有很大变化。在行人闯红灯检测中,YOLOv5s可以通过多尺度特征的融合,识别出处于不同距离和角度的行人,同时也能准确判断交通信号灯的状态。通过在训练过程中使用数据增强技术,YOLOv5s能够提高模型的鲁棒性,使其在不同天气和光照条件下都能保持良好的检测效果。YOLOv5s还支持自定义训练,使得模型可以根据特定场景进行优化,提升检测精度。

训练YOLOv5s通常需要大量标注好的数据集,包含行人、交通信号灯及其状态(如红灯、绿灯等)的图像。在训练过程中,可以使用迁移学习的技术,利用在大规模数据集上预训练的模型权重,快速适应特定的行人闯红灯检测任务。这种方法不仅能加速训练过程,还能提升模型的检测性能。在实际应用中,YOLOv5s能够实时监测交通环境,识别行人是否在红灯状态下过马路。当检测到行人在红灯下移动时,系统可以及时发出警报,提醒行人注意交通安全。将YOLOv5s与视频监控系统相结合,可以实现数据的实时分析和处理,从而提高城市交通管理的智能化水平。

三、检测的实现

3.1 数据集

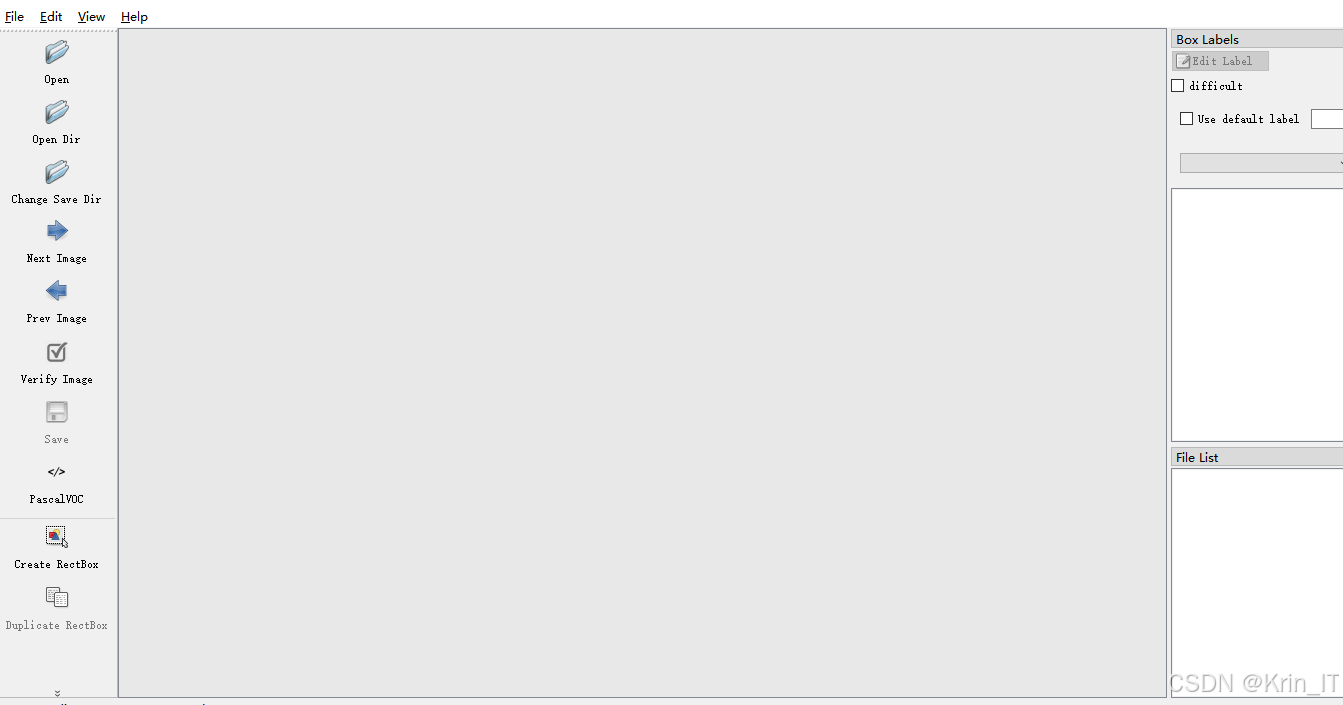

通过交通监控摄像头、行车记录仪或公共数据集进行。确保数据集中包含多种场景、光照条件和不同类型的交通信号灯,以提高模型的鲁棒性。使用LabelImg将图像中的行人和交通信号灯进行标记。每个实例应标注其类别(行人或信号灯)以及对应的边界框。标注完成后,数据集应包含每个图像的标签文件,通常采用XML或JSON格式。对图像进行统一的尺寸调整,如将所有图像缩放为640x640像素。进行数据增强,以增加数据的多样性,常用方法包括随机裁剪、旋转、平移和颜色变换。

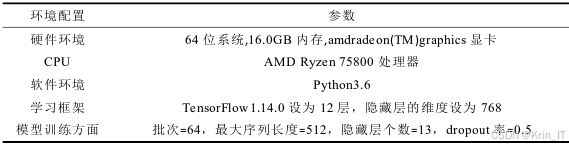

3.2 实验环境搭建

3.3 实验及结果分析

将标注好的数据集划分为训练集、验证集和测试集,以便在训练过程中评估模型性能。训练集用于模型学习,验证集用于调整超参数,测试集用于最终评估。常用的划分比例为80%训练集,10%验证集和10%测试集。数据加载通常使用数据生成器,以便在训练时动态加载数据。

import os

import pandas as pd

from sklearn.model_selection import train_test_split

from tensorflow.keras.preprocessing.image import ImageDataGenerator

# 定义数据路径和参数

data_dir = 'dataset/' # 数据集路径

image_size = (640, 640) # 输入图像的目标大小

batch_size = 16 # 批次大小

# 加载标注数据

annotations = pd.read_csv('annotations.csv') # 假设有一个CSV文件包含图像路径和标签

# 数据集划分

train_data, temp_data = train_test_split(annotations, test_size=0.2, random_state=42)

val_data, test_data = train_test_split(temp_data, test_size=0.5, random_state=42)

# 保存划分后的数据集

train_data.to_csv('train_annotations.csv', index=False)

val_data.to_csv('val_annotations.csv', index=False)

test_data.to_csv('test_annotations.csv', index=False)

# 创建数据生成器

train_datagen = ImageDataGenerator(

rescale=1.0/255, # 归一化

rotation_range=20, # 随机旋转

width_shift_range=0.2, # 水平平移

height_shift_range=0.2, # 垂直平移

shear_range=0.2, # 剪切变换

zoom_range=0.2, # 随机缩放

horizontal_flip=True, # 随机水平翻转

fill_mode='nearest' # 填充模式

)

val_datagen = ImageDataGenerator(rescale=1.0/255) # 只进行归一化

# 生成训练集和验证集

train_generator = train_datagen.flow_from_dataframe(

dataframe=train_data,

x_col='image_path', # 图像路径列名

y_col='label', # 标签列名

target_size=image_size,

batch_size=batch_size,

class_mode='categorical' # 多分类

)

模型选择应考虑准确率、速度和计算资源。选择预训练模型可以加速训练过程并提高性能,尤其在标注数据较少时。在选择模型时,还需要考虑输入尺寸、输出类别及损失函数。YOLOv5s支持多种输入尺寸,可根据实际需求进行调整。输出类别应包括行人交通信号灯的状态(如红灯、绿灯)。损失函数通常为交叉熵损失。监控训练过程中的损失值和准确率,以调整超参数。设定合适的学习率、批次大小和训练周期,防止过拟合。可以使用早停法,在验证集损失不再改善时提前停止训练。

from yolov5 import val

import numpy as np

import matplotlib.pyplot as plt

from sklearn.metrics import confusion_matrix, ConfusionMatrixDisplay

# 评估模型性能

results = val.run(

data='data.yaml', # 数据配置文件

weights='runs/train/exp/weights/best.pt', # 最佳模型权重

img_size=640 # 输入图像尺寸

)

# 计算混淆矩阵

y_true = results['labels'] # 真实标签

y_pred = results['pred'] # 预测标签

cm = confusion_matrix(y_true, y_pred)

# 可视化混淆矩阵

disp = ConfusionMatrixDisplay(confusion_matrix=cm, display_labels=['行人', '红灯', '绿灯'])

disp.plot(cmap=plt.cm.Blues)

plt.title('Confusion Matrix')

plt.show()

# 输出准确率、召回率和F1分数

accuracy = np.sum(np.diag(cm)) / np.sum(cm) # 准确率

recall = np.diag(cm) / np.sum(cm, axis=1) # 召回率

f1 = 2 * (accuracy * recall) / (accuracy + recall) # F1分数

print(f'Accuracy: {accuracy:.2f}, Recall: {recall}, F1 Score: {f1}')训练完成后,使用测试集对模型进行评估。计算准确率、召回率和F1分数等评估指标,以衡量模型在行人闯红灯检测任务中的性能。混淆矩阵可用于分析模型在不同类别上的表现,识别误判情况。评估结果将指导后续的模型优化和调整。可以根据测试结果进一步调优模型参数,或采用其他技术(如集成学习)以提升检测性能。

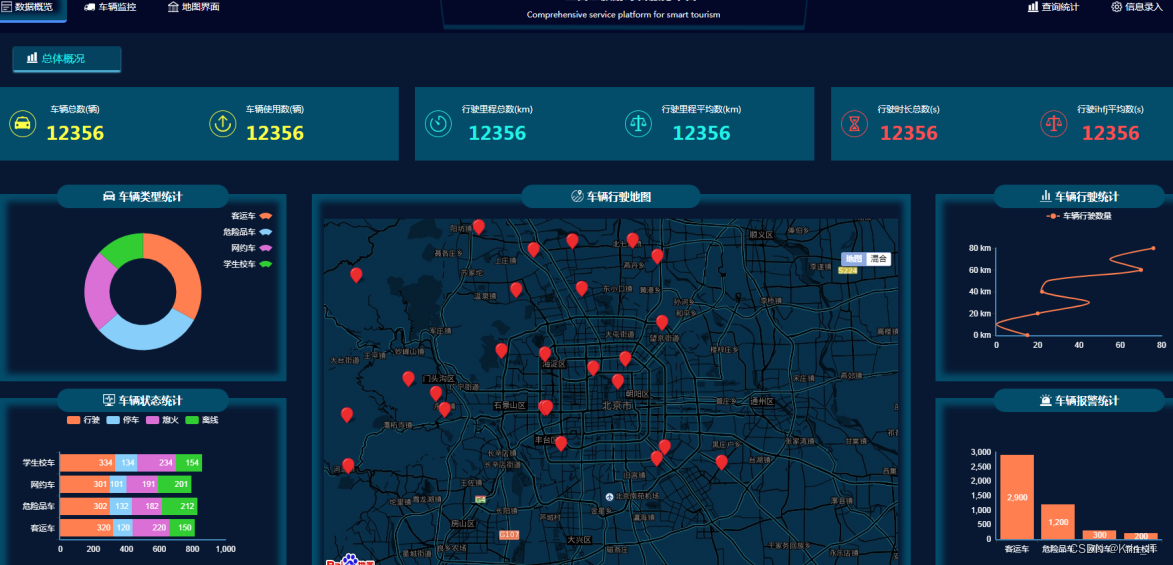

实现效果图样例:

创作不易,欢迎点赞、关注、收藏。

毕设帮助,疑难解答,欢迎打扰!

最后

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)