第12课:OpenClaw|浏览器自动化【让AI替你“上网冲浪”】

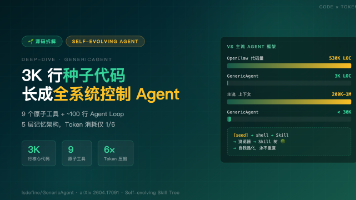

本案例将构建一套完整的新闻自动抓取流程——每天定时抓取Hacker News头条,将信息结构化整理后推送到指定渠道。步骤一:确保浏览器技能已安装并启用# 检查当前浏览器技能状态# 如playwright-scraper-skill未安装则安装步骤二:手动登录News网站(如果需要)如果新闻站点需要Cookie鉴权,先在OpenClaw浏览器中进行一次人工登录,让系统保存会话状态。步骤三:发送初始抓

文章目录

上一节课我们让OpenClaw拥有了操作本地文件系统的能力——它能整理下载文件夹、批量处理图片、生成报告。但现实世界的信息大多数并不存在本地硬盘上,而是藏在互联网的某个网页里。

如果你曾经盯着网页上的表格,一格一格地手工往Excel里粘贴数据;如果你曾经为了等一个商品降价,每天刷新页面十几次;如果你曾经在多个平台之间来回切换,只是为了对比价格——你一定会问一个问题:为什么不把这些事扔给AI去做?

这正是本节课要解决的问题。OpenClaw通过内置的浏览器自动化能力,让AI能够像真人一样打开网页、点击按钮、填写表单、提取数据,实现24小时不间断的网页自动化任务。它给OpenClaw装上了“上网的手和眼睛”,让AI从“聊天助手”变身“全能网页管家”。

本节课将从零开始讲解浏览器自动化技能的核心能力,涵盖安装配置、导航与交互操作、内容提取、登录与Cookie管理,最后通过两个贴近现实的完整项目(自动抓取新闻摘要、监控商品价格变动)串联所有知识点,并深入讲解Headless模式的部署与安全实践。读完这节课,你的OpenClaw将获得一双随时可以上网冲浪的“手”。

12.1 浏览器自动化技能安装与工作模式

一句话概括:Agent Browser是OpenClaw生态中最火热的浏览器自动化技能,基于Rust超快内核+Playwright引擎,让AI能像真人一样操控浏览器,核心价值是打破AI“只会说不会做”的浏览器操作壁垒。

Agent Browser是什么?

Agent Browser是OpenClaw生态中最受欢迎的浏览器自动化技能,下载量超过8万,星标400+。其核心价值是让AI能够像真人一样操控浏览器,无需人工干预完成网页相关任务。它不是简单的网页爬虫(只能提取静态数据),而是完整的“浏览器自动化引擎”——支持动态网页交互、登录状态保持、截图录屏等复杂操作,且可以在后台无界面运行,不干扰用户正常使用电脑。

对普通用户而言,你无需学习Selenium、Playwright等复杂工具,只需给OpenClaw发一句自然语言指令,就能实现“说句话,AI帮你搞定网页事”。

核心技术能力

根据2026年最新实测验证,Agent Browser的核心能力可归纳为六大场景,覆盖绝大多数网页自动化需求:

| 核心能力 | 具体功能 | 典型应用场景 |

|---|---|---|

| 网页导航与交互 | 打开URL、点击按钮、填写表单、下拉选择、悬停操作 | 自动登录网站、批量填写表单、提交申请 |

| 数据提取与整理 | 提取文字、价格、表格数据、链接,结构化输出 | 电商比价、股票数据抓取、竞品信息监控 |

| 截图与录屏 | 全屏截图、指定区域截图、操作过程录屏 | 工作汇报、问题复现、流程分享 |

| 登录状态保持 | 保存Cookie,下次直接登录 | 自动登录网盘、后台管理系统、社交媒体 |

| 条件控制与等待 | 等待页面加载、等待特定元素出现、超时重试 | 处理慢加载网页、避免操作失败 |

| 高级扩展功能 | 多标签页并行、网络请求拦截、模拟鼠标移动、运行JS代码 | 复杂流程自动化、网页功能测试 |

技能安装与配置

2026年最新版OpenClaw已默认集成浏览器操作插件agent-browser v0.2.0,同时支持从Clawhub技能库扩展更多实用功能。以下是完整的安装与配置流程:

第一步:确认浏览器模块可用

# 检查Chromium是否已安装(OpenClaw内置浏览器引擎)

openclaw browser check

# 如未安装,手动安装Chromium

openclaw browser install

# 确认版本

openclaw browser version

第二步:安装Agent Browser技能

# 通过openclaw命令安装

openclaw skills install agent-browser

# 或使用clawhub命令

clawhub install agent-browser

# 验证安装

openclaw skills list | grep agent-browser

如果你正在使用阿里云部署方案,轻量应用服务器的OpenClaw镜像已预置agent-browser技能,无需额外安装。

第三步:配置文件设置(可选手动调优)

在~/.openclaw/openclaw.json的"browser"区块内添加或修改以下配置:

{

"browser": {

"enabled": true,

"engine": "chromium",

"headless": true,

"launch_options": {

"args": [

"--no-sandbox",

"--disable-setuid-sandbox",

"--disable-dev-shm-usage",

"--disable-gpu"

],

"timeout": 30000

},

"default_viewport": {

"width": 1920,

"height": 1080

},

"max_concurrent_pages": 5,

"page_timeout_ms": 30000

}

}

⚠️ 【安全提醒】

--no-sandbox参数会禁用Chromium的沙箱保护。在生产环境强烈建议使用Podman容器进行外层隔离,而不是仅禁用沙箱。详见第27课“安全沙箱与权限深度管理”。

基础工作模式

OpenClaw的浏览器自动化底层采用了分层架构。它启动的是一个独立、隔离的Chromium实例,拥有自己的用户数据目录——可以理解为AI专用的浏览器,与你的日常浏览会话完全分离。各工作模式的对比如下:

| 模式 | 描述 | 适用场景 |

|---|---|---|

| Headless(标准) | 无GUI界面,后台运行 | 服务器环境、定时爬取、CI/CD |

| Headed(调试) | 显示浏览器窗口 | 开发调试、需要人工介入的流程 |

| Headless New | Chrome 113+新无头模式 | 需要更完整浏览器行为模拟的场景 |

在架构层面,Agent Browser调用Playwright库处理高级交互(点击、打字、表单填写),底层通过Chrome DevTools Protocol与浏览器通信。Agent不需要理解这些技术细节——你只需用自然语言下达指令,Agent会自动完成复杂的浏览器操作编排。

避坑指南:如果安装playwright-scraper-skill后抓网页始终失败,先确认浏览器依赖是否完整。执行

npx playwright install chromium安装完整内核。此外,OpenClaw刚装好时浏览器组件可能是关闭的,如果遇到AI只能“摸”网页无法真实交互的情况,检查openclaw.json中"browser":{"enabled":true}是否设置。

12.2 打开网页、点击元素、填写表单

一句话概括:Agent Browser将复杂的浏览器操作简化为自然语言指令——打开网页、定位元素、点击按钮、填写表单,全部用一句话完成,无需写一行CSS选择器代码。

页面导航与快照分析

Agent Browser不依赖“视觉”来理解页面,而是使用一个叫“快照”(Snapshot)的独特机制。Agent调用snapshot命令后,会生成页面的可访问性树,每个交互元素都会获得一个数字引用ID。这样AI看到的页面结构如下:

[12] button "Submit"

[13] input "Email address"

[14] link "Terms and Conditions"

有了这些引用ID,AI后续的指令就可以非常精确地定位元素——不需要担心页面样式变化导致选择器失效。

最基础的操作是打开网页。以下是几个可在WebUI或Telegram中直接使用的指令示例:

打开网页的基本指令

打开 https://news.ycombinator.com 并截图保存

打开GitHub首页,告诉我导航栏有哪些链接

点击与交互

Agent能够点击任何元素、输入文本、选择下拉菜单、悬停操作、拖拽等。

点击元素的指令

在https://example.com的页面上,点击“了解更多”按钮

填写表单

批量填写表单时,可以用JSON快速填充多个字段:

在登录页面填写用户名"testuser"和密码"mypassword",然后点击登录按钮

帮我批量填写这30份申请表单,数据在这个CSV文件里

等待策略与智能重试

网页加载速度不同,自动化操作需要智能的等待机制。Agent Browser内置了多种条件等待能力:等待页面加载完成、等待特定元素出现、超时重试等。

{

"browser": {

"page_timeout_ms": 30000,

"launch_options": {

"args": ["--disable-dev-shm-usage"],

"timeout": 30000

}

}

}

带等待条件的操作

打开https://example.com/slow-page,等待页面完全加载后再截图

等待“加载完成”文字出现后,点击下一步按钮

多标签页管理

Agent Browser支持多标签页并行操作,适合跨站点对比或从多个仪表板同时拉取数据。

新建标签页打开https://bing.com,然后在原标签页截取首页图

关闭所有空白标签页

在Headless模式中,可通过max_concurrent_pages配置控制最大并发页数(默认5),防止资源过度消耗。

文件上传与下载

自动化流程中经常需要上传文件或保存下载内容。Agent Browser支持完整的文件工作流——上传文件到输入框、等待下载完成等。

在文件上传界面,上传~/Documents/report.pdf这个文件

点击导出按钮,等待文件下载完成后将其移动到Reports目录

避坑指南:网页内容千变万化,“点击XX按钮”这种模糊指令可能在AI选错元素时触发误操作。首次建立爬虫类Skill时,建议先用指令方式让Agent描述找到的元素情况,人工评审后再允许生产运行。另外,OpenClaw默认使用独立Chromium实例,Cookies、扩展、密码均与你的个人浏览器相互隔离,请勿试图让它“共用”你的登录态。

12.3 网页内容抓取与结构化数据提取

一句话概括:OpenClaw的内容抓取策略分为三层——轻量HTTP请求处理静态页面、托管浏览器应对动态渲染、结构化提取器将HTML转为JSON,让AI能够从任何形态的网页中提取所需数据。

三种抓取模式

OpenClaw根据网页的复杂程度提供了三种渐进的抓取策略,这也是官方设计的核心原则之一——优先使用最轻量的方式完成任务,仅在必要时启用重级浏览器引擎:

| 模式 | 所用工具 | 适用场景 | 特点 |

|---|---|---|---|

| 轻量HTTP | web_fetch |

静态HTML、纯文本页面 | 速度快、消耗低、无JS渲染 |

| 动态渲染 | Playwright引擎 | JS密集页面、SPA应用 | 完全模拟浏览器行为 |

| 抗反爬 | Playwright隐身模式 | 电商/社交平台 | 绕过Cloudflare等防护 |

OpenClaw内置的web_fetch工具基于HTTP GET,同时带内容提取、缓存和重定向处理。在静态或半动态站点的大批量提取中,经常能跑赢BeautifulSoup、Selenium这类传统方案。

Playwright Scraper技能

对于需要JavaScript渲染的页面,OpenClaw生态中的Playwright Scraper Skill填补了传统爬虫的空白。它基于真实浏览器内核运行,支持简单模式与隐身反爬模式,可稳定抓取小红书、知乎、电商平台、招聘网站、新闻站点等各类网页内容。

开始前先安装:

# 安装Playwright Scraper技能

clawhub install playwright-scraper-skill

# 安装轻量HTTP抓取工具(可选)

clawhub install curl-http

双模式抓取功能各有侧重:

- 简单模式(playwright-simple) :适合常规动态页面,快速加载JS并提取文本、列表、链接

- 隐身模式(playwright-stealth) :绕过反爬系统、Cloudflare、机器人检测,模拟人类滑动、随机延迟、真实User-Agent,隐藏爬虫特征

自然语言提取:告别选择器

2026年OpenClaw的一大突破是“自然语言提取”——AI能理解你想要的字段,自动识别网页中的对应元素。这项功能极大地降低了网页抓取的技术门槛。

基础提取指令

从https://news.ycombinator.com抓取所有新闻的标题、链接和作者

提取该页面上所有文章名称和价格,输出为JSON格式

结构化输出

将提取的信息保存为Markdown表格,存入output/news.md

同时抓取京东、淘宝、拼多多的iPhone价格,生成对比表格

数据提取流程

APIFY的2026年分析指出,AI抓取会面临“Token税”问题:AI抓取器从HTML提取数据时支付一次Token成本,处理结果时再付一次。这凸显了结构化输出和缓存策略的重要性。以下示例配置展示了典型的抓取参数设置:

{

"url": "https://example.com/products",

"selector": ".product-item",

"fields": ["title", "price", "sales"],

"output": "excel"

}

OpenClaw的配置极度简化,只需告诉它三个核心信息:去哪里抓(url)、抓什么(selector和fields)、怎么输出(output)。

考虑到AI Agent场景下解析海量HTML并转换成结构化数据的成本,Bright Data等专业方案提供了预定义的结构化数据工具,可直接从Amazon、LinkedIn等平台返回干净的JSON数据。

避坑指南:对于抖音、小红书等JS繁重的大型应用,Playwright隐身模式可能仍需配合代理IP和合理的请求间隔,才能在高强度抓取中稳定存活。建议先从单页面小任务练手,扩展至完整爬虫前阅读页面robots.txt协议。

⚠️ 【合规提醒】 网页抓取需严格遵守各网站服务条款和robots.txt协议。OpenClaw不会绕过验证码或反机器人系统,商业化大规模抓取需确保符合相关法律法规。

12.4 模拟登录与Cookie管理

一句话概括:OpenClaw提供两层登录管理方案——对于交互式登录,支持扫码和验证码等人工介入;对于长期自动化,可将Cookies持久化存储至~/.openclaw/shared/auth/,实现跨会话免登录。

交互式登录:人工介入模式

当网站需要登录且无法绕过验证码时,OpenClaw支持从终端(或Docker)发起带交互的人工辅助登录流程。这并不是AI自动破解验证码,而是让用户亲自在代理浏览器中完成一次登录,浏览器将持久存储该登录态,供后续自动化使用。

典型的交互式登录流程是:

- Agent在独立Chromium实例中打开登录页面

- 用户扫码或输入验证码完成登录

- OpenClaw自动保存会话状态和Cookie信息

- 下次访问直接免登,全程无需重复输入密码

典型指令

打开https://example.com/login,等待扫描二维码登录

Cookie持久化:生产级账号态管理

对于企业级账号,可将所有已保存的Cookie文件统一存放至~/.openclaw/shared/auth/目录,并在openclaw.json中统一引用。

{

"auth": {

"profiles": {

"twitter": {

"cookieFile": "~/.openclaw/shared/auth/twitter.json"

},

"notion": {

"cookieFile": "~/.openclaw/shared/auth/notion.json"

}

}

}

}

有的用户反馈,第一次启动Bird Skill时,Agent要求提供auth_token和ct0——下次重启OpenClaw或换设备后可能又忘了。解决方法是:完成首次成功登录后,将浏览器Cookie持久化到磁盘,并在openclaw.json中为每个Cookie Profile配置独立文件路径,新会话启动时调度到该共享账号状态。

无需凭证交给AI

⚠️ 【安全红线】 官方文档强调:在涉及需要登录的网站时,请在主机浏览器配置文件(OpenClaw浏览器)中手动登录。不要将账号密码直接提供给模型。自动登录通常会触发反机器人防御并可能锁定账户。

此外,AdsPower等指纹浏览器可以为每个自动化任务提供独立的浏览器身份环境,防止Cookie冲突或跨账户干扰,在需要进行多个账号管理的场景中尤其实用。

12.5 实战案例1:自动抓取每日新闻摘要

本案例将构建一套完整的新闻自动抓取流程——每天定时抓取Hacker News头条,将信息结构化整理后推送到指定渠道。

步骤一:确保浏览器技能已安装并启用

# 检查当前浏览器技能状态

openclaw skills list | grep -E "agent-browser|playwright"

# 如playwright-scraper-skill未安装则安装

clawhub install playwright-scraper-skill

步骤二:手动登录News网站(如果需要)

如果新闻站点需要Cookie鉴权,先在OpenClaw浏览器中进行一次人工登录,让系统保存会话状态。

步骤三:发送初始抓取指令(验证是否能提取数据)

抓取https://news.ycombinator.com/news列表,提取前10条新闻的标题、URL和作者。

输出为Markdown表格。

Agent完成抓取后应该返回类似如下的结构化内容:

| 标题 | 作者 | 链接 |

|---|---|---|

| OpenClaw 1.0 Released | sarah_tech | https://… |

| … | … | … |

步骤四:结构化处理与格式化输出

在上一步骤基础上增加格式化和存储要求:

将抓取结果格式化为Markdown表格,包括序号、原标题、来源链接、摘要与发布小时。

保存名为daily_news.md文件到output目录。

步骤五:设置定时任务(第14课的Cron任务)

在HEARTBEAT.md中添加定时任务,实现每天早晨自动执行新闻抓取:

# HEARTBEAT.md - 每日新闻抓取任务

## 每天早晨7:00执行

- 抓取https://news.ycombinator.com/news

- 提取前15条新闻标题和链接

- 生成Markdown格式摘要

- 将摘要推送到配置的飞书或Telegram渠道

## 错误处理

- 抓取失败时重试最多3次

- 连续失败后发送告警消息

步骤六:结果验证与调试

检查output/daily_news.md文件是否正确生成。如果提取的字段不全,需要在自然语言指令中更精确地描述需要的元素。当抓取方向遇到页面反爬时,将模式切换为隐身模式。

以隐身模式运行playwright-scraper-skill抓取https://news.ycombinator.com/news

12.6 实战案例2:监控商品价格变动

一句话概括:OpenClaw可通过定时抓取商品页面实现价格监控,捕获“降价超过10%”等事件后自动通过飞书/微信告警,让AI成为你的24小时比价工具。

构建价格监控系统在OpenClaw社区中已有成熟实践。deal-hunter插件专门为此设计,通过条件GET(ETag/Last-Modified)减少无效请求,支持限流配置和结构化价格信号解析。

步骤一:安装deal-hunter插件(原生插件版本)

# 安装(通过npm包路径)

openclaw plugins install openclaw-deal-hunter

# 启用插件,在配置中添加

openclaw config set plugins.entries.openclaw-deal-hunter.enabled true

步骤二:在openclaw.json中配置监控目标与限流策略

{

"plugins": {

"entries": {

"openclaw-deal-hunter": {

"enabled": true,

"config": {

"maxConcurrent": 8,

"maxBytesPerResponse": 1048576,

"defaultMaxRpsPerHost": 1,

"allowedHosts": ["*.amazon.com", "*.jd.com", "*.taobao.com"],

"fetcher": "local"

}

}

}

},

"browser": {

"enabled": true,

"headless": true

}

}

安全提示:插件本身不会绕过验证码或反机器人检测,使用前只需遵守网站服务条款即可。

步骤三:从自然语言触发价格监控任务

监控https://www.amazon.com/dp/B09XYZ1234的价格,当降价超过10%时通知我

Agent完成监控配置后,会设置周期性抓取(默认每6小时一次),持续监测指定商品的价格变动。

步骤四:查看历史价格与趋势报告

查看这款商品近7天的价格变化记录和最低价

deal-hunter内置了deal_history命令,可展示每个商品的历史价格走势、最近价格差距和已见最低/最高价。

步骤五:多商品监控与批量配置

需要监控多个商品时,可以用JSON批量声明。也可设置企业级限流,通过defaultMaxRpsPerHost限制每秒对同一主机的请求数,避免被反爬误伤。

配置完成后,你可以在飞书、Slack或企业微信中接收降价告警。需要注意的是,开箱即用的价格监控依赖商品页面的HTML结构相对稳定;如果网站重构了前端布局,需重新校验提取规则是否匹配。

⚠️ 【合规红线】 对于电商自动化比价用途,OpenClaw不能绕过验证码或反机器人系统。大批量商业级监控应采取合法爬取策略(代理池、请求间隔、遵守robots.txt)。

12.7 Headless模式部署与实践

一句话概括:Headless模式的本质是让OpenClaw在没有图形界面的服务器上运行浏览器自动化——节点主机会自动声明浏览器代理,智能体无需额外配置即可在远程节点上使用浏览器能力。

之前讨论部署方案时已接触过Headless模式。回顾第4课,Headless模式是无图形界面后台运行的浏览器模式,特别适合云服务器上的自动化任务。其两大优势是资源占用低(无需渲染界面)和可持续运行(24小时无人值守)。

节点主机:浏览器代理的零配置

如果节点上未禁用browser.enabled,节点主机会自动声明一个浏览器代理,智能体无需额外配置即可在该节点上使用浏览器自动化。这一机制大幅降低了在云服务器上搭建浏览器自动化环境的复杂度。

浏览器代理检测与启用

# 检查节点是否支持浏览器代理

openclaw node status # 查看节点所声明的代理

# 在openclaw.json中启用浏览器模块

{

"browser": {

"enabled": true,

"headless": true

}

}

Chrome Relay扩展与中继连接

Chrome Relay是OpenClaw官方提供的浏览器控制扩展,通过CDP与中继服务实现AI对浏览器的底层操作调用,核心覆盖能力包括:自然语言打开网页、点击按钮、填写表单、自动登录;自动提取页面文本、链接、表格、图片信息;支持多标签页管理、页面截图、HTML源码获取。

云服务器部署时,必须为连接加密,否则浏览器指令可能暴露到公共互联网。Tailscale或类似VPN方案会在VPS和本地设备之间建立一个私有加密通道,是推荐的安全基线。

远程CDP配置(对接独立浏览器沙箱)

当需要将OpenClaw连接到已有的无头Chromium沙箱时,需在openclaw.json中配置CDP地址:

{

"browser": {

"enabled": true,

"attachOnly": true,

"defaultProfile": "remote",

"profiles": {

"remote": {

"cdpUrl": "http://localhost:9222",

"color": "#FF4500"

}

}

}

}

如果使用Zeabur等容器平台部署浏览器沙箱,还需通过curl命令验证连接:

curl http://openclaw-sandbox-browser:9222/json/version

零配置部署场景

官方节点主机支持–no-auto-browser配置在某些场景屏蔽自动代理,通过openclaw node相关的配置browser.enabled可实现。但对于大多数场景,保持默认值即可让OpenClaw自动完成浏览器代理搭建——这是其“零配置”哲学在浏览器自动化方面的体现。

12.8 本节小结

本节课我们完整走过了OpenClaw浏览器自动化的全链路:

-

安装与架构:Agent Browser技能基于Chromium+Playwright,启动独立、隔离的浏览器实例,通过无头模式在服务器上后台运行

-

交互操作:页面导航、点击、表单填写支持自然语言指令,利用原子数字映射元素,无需手写选择器;支持等待策略和多标签页

-

内容抓取:分层策略从轻量HTTP到动态渲染的Playwright隐身模式,可绕过反爬并提取结构化数据

-

登录与Cookie管理:人工介入登录和Cookie持久化存储,实现多站点跨会话免登录,凭证与AI指令隔离

-

实战项目:自动抓取新闻摘要(从单个网页批量提取数据并结构化输出)和商品价格监控(设置条件告警)

-

Headless部署:节点主机自动声明浏览器代理,支持Chrome Relay扩展,远程CDP可连接到独立浏览器沙箱

掌握了浏览器自动化,你的OpenClaw就真正拥有了“联网操作”的能力。这不仅意味着能自动查数据和填表单,更重要的是可以与文件管理、邮件技能、定时任务编排成连贯的自动化解决方案——让AI成为你工作中无处不在的“数字同事”。

12.9 课后习题

1. 探索浏览器快照机制

在你的OpenClaw环境中执行“打开https://example.org并截图”,再运行“打开https://example.org,获取快照后告诉我页面上有哪些按钮”。比较两个指令的执行差异——Agent是如何通过快照了解页面结构的?结合12.2节提到的方案,描述第2个指令的额外数据交互过程。

2. 新闻爬取对比实验

分别使用“简单网页抓取”和“playwright-stealth模式”抓取同一电商平台的商品价格页。记录两个任务的完成时间和提取数据的完整性差异。如果在隐身模式下仍被反爬,需要配合哪些措施。

3. Cookie持久化配置

为Twitter或知乎配置Cookie持久化存储。首次登录后检查~/.openclaw/shared/auth/目录中是否生成了新的Cookie文件。在多轮对话中轮流让Agent发文和停止后,再问它是否能通过免登继续执行操作。

4. 价格监控告警部署

部署deal-hunter插件,监控一个你关心的商品。配置降价告警阈值,并设定飞书或Telegram作为告警通道。提交你的配置代码片段,截取Agent“已添加监控任务”的反馈日志。当价格发生变化时,记录接收到的消息结构和延迟。

5. Headless模式沙盘实验

在一台云服务器或本地Docker上,搭建一个完整的Headless浏览器环境。分别测试通过节点声明代理和远程CDP两种方式让OpenClaw连接到无头Chrome。对比两种方式的部署难度和响应时间。如果采用的是云服务商的一键镜像方案,测试镜像是否已预配置浏览器中继连接。

🔗《30节课精通 OpenClaw》系列课程导航

第一部分(第1-5课):基础认知与入门部署——解决“这是什么、怎么搭建”的问题。

第二部分(第6-10课):核心原理深度剖析——解决“底层怎么工作”的问题。

第三部分(第11-15课) :应用场景与平台集成——解决“能用来做什么”的问题。

第四部分(第16-21课) :技能开发与定制扩展——解决“如何自己扩能力”的问题。

第五部分(第22-26课):高级特性与性能优化——解决“怎么用得更好”的问题。

第六部分(第27-30课) :安全、运维与生态进阶——解决“如何安全可靠地规模化”的问题。

🌟 感谢您耐心阅读到这里!

💡 如果本文对您有所启发欢迎:

👍 点赞📌 收藏 📤 分享给更多需要的伙伴。

🗣️ 期待在评论区看到您的想法, 共同进步。

🔔 关注我,持续获取更多干货内容~

🤗 我们下篇文章见~

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)