第6篇】memU:让记忆本身成为 24/7 后台 Agent,最激进的主动范式

在所有 Agent 记忆框架中,memU 的设计最为激进:它不再满足于让 Agent“被动存取记忆”,而是**让记忆本身变成一个 24/7 全天候运行的后台智能体**——持续观察、自动学习、主动预判。本文深度拆解 memU 的核心机制:三层分层存储架构(Resource → Item → Category)、双检索模式(RAG 向量检索 + LLM 语义检索)、多模态原生支持与自演化闭环。我们将结

在所有 Agent 记忆框架中,memU 的设计最为激进:它不再满足于让 Agent“被动存取记忆”,而是让记忆本身变成一个 24/7 全天候运行的后台智能体——持续观察、自动学习、主动预判。本文深度拆解 memU 的核心机制:三层分层存储架构(Resource → Item → Category)、双检索模式(RAG 向量检索 + LLM 语义检索)、多模态原生支持与自演化闭环。我们将结合 Locomo 基准 92.09% 准确率、上下文压缩 70%+ 的真实数据,分析其“记忆即文件系统”的设计哲学、与 OpenClaw 的深度集成案例,以及主动记忆范式带来的隐私与计算成本挑战。读完本文,你将理解 Agent 记忆从“被动存储”到“主动计算”的范式跃迁。

我们一直在问:Agent 的记忆系统该怎么设计?

Text2Mem 的答案是“先定义一套标准指令集”;Mem0 的答案是“双存储引擎 + 工厂模式”;Letta 的答案是“OS 虚拟内存 + Git 版本化”;ReMe 的答案是“文件即记忆,让用户可读可改”。

但有一个框架,给出了一个完全颠覆性的答案:为什么记忆一定是“被动存储”?如果记忆本身就是一个 24/7 全天候运行的后台 Agent 呢?

这就是 memU——由 NevaMind-AI 团队推出的开源记忆基础设施。截至 2026 年 4 月,memU 在 GitHub 上已获得 11.5k+ Star,并推出了 1.0.0 正式版。它将自己定位为“专为 24/7 主动智能体设计的记忆基础设施”,核心理念用一句话概括:

“Memory as File System, File System as Memory”——将记忆按语义分层分类,像文件夹一样可导航、可检索,同时叠加主动智能层,让 AI 不仅能“记住”,还能“主动运用”。

这一篇,作为模块一的压轴之作,我们将完整拆解 memU 的设计哲学、核心机制、性能数据与真实局限。

一、核心定位:记忆本身就是一个后台 Agent

memU 与前面五个框架最大的区别,不在于它的存储引擎,而在于它对“记忆角色”的根本性重新定义。

传统记忆框架将记忆视为一个“被动仓库”:Agent 需要时来查询,不需要时静静躺着。memU 则完全不同——它将记忆本身变成一个持续运行的智能体:

- 持续观察:24/7 在后台监控所有交互,自动记录和提取关键信息

- 主动学习:从对话、文档、图片等多模态内容中,自动提取用户偏好和知识,无需手动标注

- 预判行动:分析用户习惯和上下文,在用户开口之前就主动准备或建议下一步行动

memU 团队在 V2EX 上的公开发布中这样描述:“它会 24/7 运行,持续记录构建长期记忆,随着时间推移,它会逐渐理解你的习惯和上下文。不再只是等待 Prompt,而是尝试推断你的意图,在你开口之前就主动行动。”

二、三层分层存储架构:从原始数据到可用的“记忆文件”

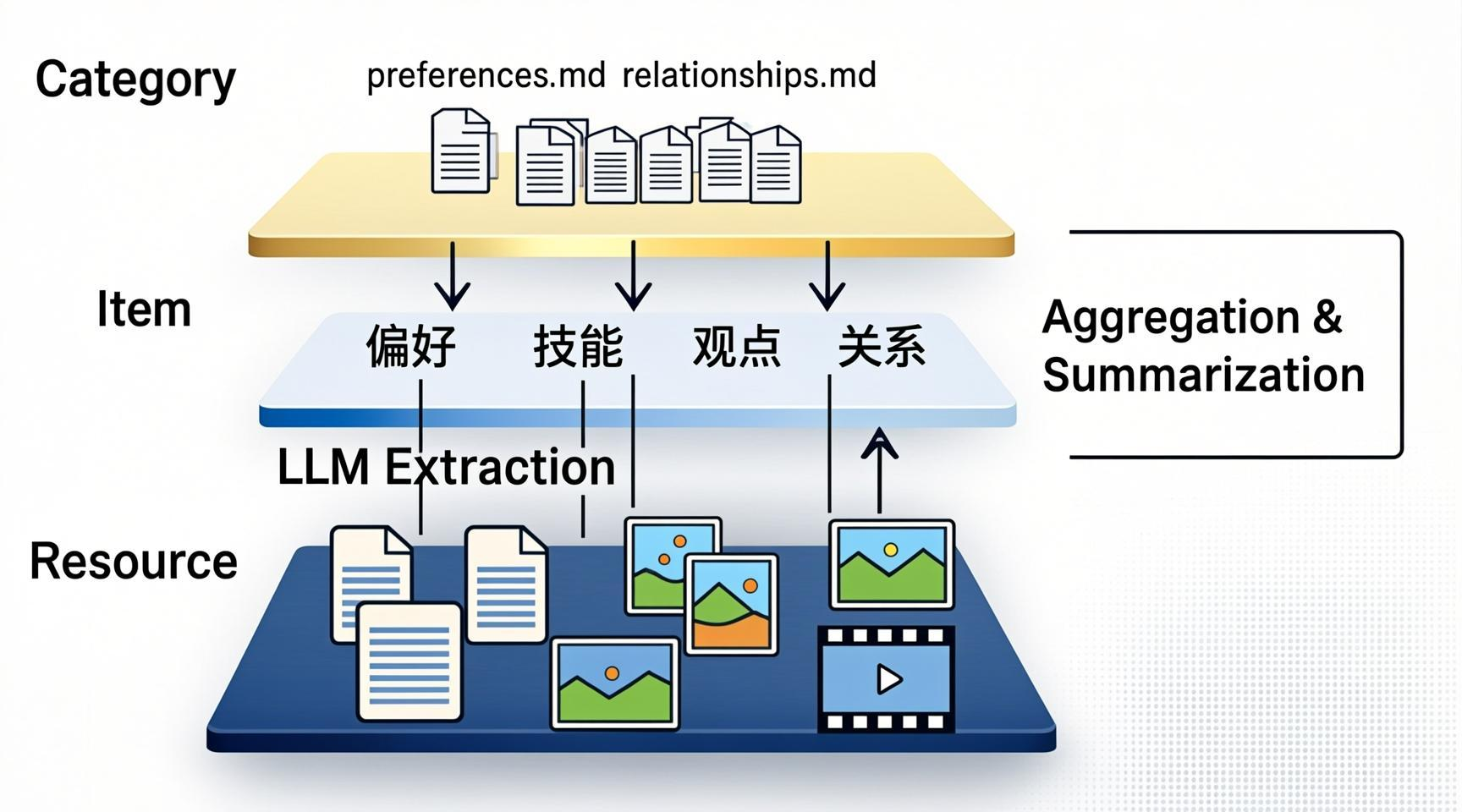

memU 最核心的技术创新是其三层分层存储架构。这一设计灵感来源于传统文件系统的层次化组织,但针对 AI 记忆特性进行了深度优化。

2.1 Resource 层:原始多模态数据仓库

Resource 层是架构的底层,负责存储未经处理的原始数据。这一层的关键设计决策是保持数据的原始性和完整性,为后续追溯和验证提供基础。支持的数据类型包括:

- JSON 格式的对话记录

- 文本文档(.txt, .md 等格式)

- 图像文件(PNG, JPG 等)

- 视频文件(支持帧提取)

- 音频文件(支持转录处理)

工程实现上,Resource 层采用轻量级元数据管理,每个资源都包含原始文件路径、创建时间、修改记录等基础信息。这种设计确保了即使在上层处理过程中出现错误,也能回溯到原始数据重新处理。

2.2 Item 层:离散记忆单元提取

Item 层是 memU 架构中的核心处理层,负责从原始资源中提取结构化的记忆单元。这一层的设计哲学是将连续数据离散化,将复杂的多模态信息分解为可独立管理和检索的单元。

典型的 Item 类型包括:

- 偏好:用户的个人喜好和习惯

- 技能:从执行日志中提取的能力和知识

- 观点:对话中表达的态度和立场

- 关系:实体之间的关联和互动模式

每个 Item 都包含置信度评分、提取方法、时间戳等元数据,为后续的检索和演化提供基础。

2.3 Category 层:聚合文本记忆与摘要

Category 层是架构的顶层,负责将离散的 Item 聚合为有组织的文本记忆文件。这一层的关键创新在于动态分类和渐进式摘要,能够根据内容模式自动调整分类结构。

在 memU 的默认配置中,记忆被组织为以下目录结构:

memory/

├── preferences/ # 用户偏好(如设计风格、工作习惯)

├── relationships/ # 人际关系(如联系人信息、协作模式)

├── knowledge/ # 领域知识(如专业术语、行业规则)

└── context/ # 当前上下文+待办任务(跨会话关联)

memU 1.0.0 的官方博客这样总结三层架构的意义:“通过逐步抽象,将杂乱多样的数据转化为 Agent 能够理解、检索和演化的记忆。这一流程是:Resource 层 → Memory Item 层 → Memory Category 层。”

三、双检索模式:RAG 向量检索 + LLM 语义检索

memU 最显著的技术特色是其双检索机制,这一设计解决了传统 RAG 系统在检索精度与效率之间的固有矛盾。

3.1 RAG 向量检索:毫秒级的速度优先

RAG 检索基于向量相似度计算,采用标准的余弦相似度算法。其核心参数包括:

- 向量化配置:默认使用

text-embedding-3-small,1536 维向量,支持归一化,批量处理大小 32 - 检索参数:top_k 默认值 10,相似度阈值默认 0.7,可选启用二次重排

RAG 检索的核心优势在于其毫秒级响应时间和线性扩展能力。在测试环境中,memU 的 RAG 检索能够在 5-10 毫秒内完成查询,即使面对百万级 Item 库也能保持稳定的性能。

3.2 LLM 语义检索:深度理解的推理优先

LLM 检索采用直接文件读取和语义理解的方式,其核心在于渐进式查询重写和充分性检查。检索流程包括:

- 查询理解:LLM 分析原始查询的深层意图

- 类别筛选:仅在相关类别中进行搜索

- Item 评估:对筛选出的 Item 进行深度语义匹配

- 结果整合:生成综合性的回答

LLM 检索虽然速度较慢(通常在秒级),但其深度语义理解能力和上下文感知能力使其在复杂推理任务中表现优异。memU 的测试数据显示,在需要深度理解的查询中,LLM 检索的准确率比 RAG 检索高出 15-20%。

3.3 智能切换:速度与深度的平衡

memU 提供了灵活的检索策略配置,支持基于查询类型和应用场景的智能切换:

retrieval_strategy = {

"default_method": "rag", # 默认使用 RAG 检索

"fallback_to_llm": True, # RAG 失败时回退到 LLM

"llm_triggers": [ # 触发 LLM 检索的条件

"complex_reasoning",

"multi_step_query",

"context_dependent"

],

"hybrid_scoring": { # 混合评分配置

"rag_weight": 0.6,

"llm_weight": 0.4,

"fusion_method": "weighted_sum"

}

}

这种双检索策略让 memU 在“日常快速响应”和“复杂深度推理”之间实现了优雅的平衡。

四、自演化闭环:从“存储”到“生长”

memU 最独特的地方在于,它将记忆的存储、组织、检索设计为一个完整的自演化闭环

memU 1.0.0 的官方博客这样描述这个闭环:“当新信息进入系统时,首先以原始形式存储在 Resource 层。从那里,系统逐步提取具有明确含义的 Memory Items,并根据现有记忆结构将它们放入合适的 Memory Category 文件中。随着记忆向上移动,含义变得更加清晰,结构变得更加稳定。”

更关键的是,memU 实现了类似人类记忆的“遗忘”机制:“当一条记忆长时间未被引用时,它可能不再出现在类别层,在该层级被有效‘遗忘’。此时系统会回退到更深层进行检索。如果记忆条目仍然找不到,原始资源始终是可检索的——因为资源永远不会被剪枝或丢弃。”

这种设计确保了记忆系统不会无限膨胀,而是持续优化:高频使用的记忆被提升到 Category 层快速访问,低频记忆自然下沉,但永远不会彻底丢失。

memU 官方对自己的定位是:“没有文档分块,没有 embedding 检索流水线,没有 RAG 复杂性——只有干净的、专注于记忆的存储、组织和检索。”

五、性能数据与成本分析

5.1 Locomo 基准:92.09% 准确率

在长对话记忆能力的 Locomo 基准测试中,memU 达到了 92.09% 的平均准确率。作为对比:

| 框架 | Locomo 准确率 |

|---|---|

| memU | 92.09% |

| Letta | ~74% |

| 传统 RAG 基线 | ~60-65% |

这近 18% 的绝对提升,主要归功于 memU 的三层分层架构 + 双检索模式的协同效应。

5.2 Token 成本:上下文压缩 70%+

memU 的核心成本优势来自其分层缓存机制。官方数据显示,通过将原始对话压缩为结构化的类别文件摘要,长对话的上下文 Token 消耗可降低 70% 以上。

memU Bot(基于 memU 框架构建的企业级助手)的文档甚至宣称:“通过记忆优化的上下文选择和洞察缓存,实现高达 10 倍的长期成本节省。”

5.3 检索延迟:毫秒级的 RAG,秒级的 LLM

- RAG 检索:5-10 毫秒,适合日常对话中的快速记忆召回

- LLM 检索:秒级,适合复杂推理和深度语义理解

智能切换机制确保了在绝大多数日常场景中都能保持毫秒级响应,只在必要时触发深度检索。

六、实战集成:memU + OpenClaw,让 Agent“永不失忆”

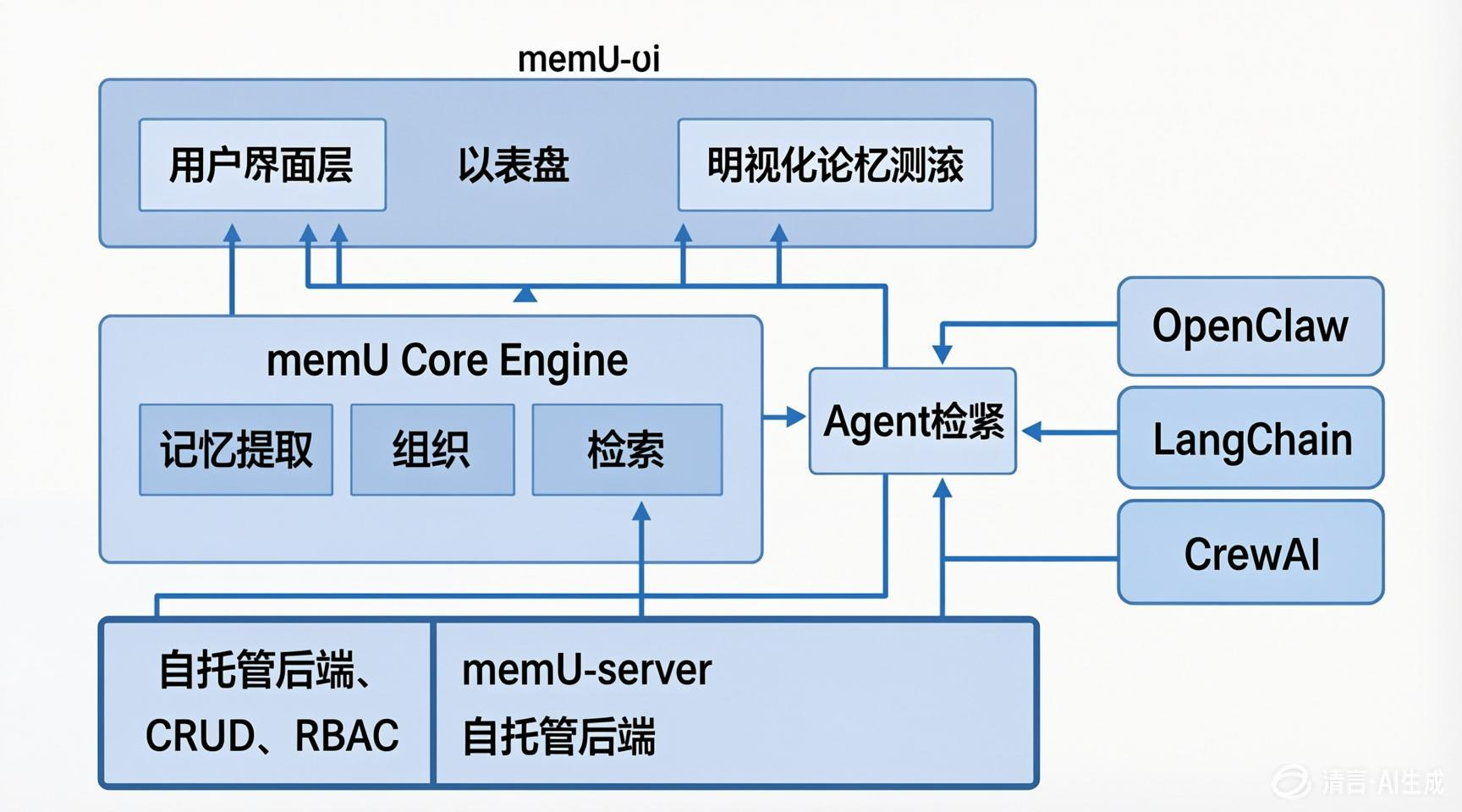

memU 的另一个核心优势是其与主流 Agent 框架的深度集成能力。其中最典型的案例是与 OpenClaw(原 Clawdbot、Moltbot)的集成。

6.1 问题:OpenClaw 的“记忆短板”

OpenClaw 是 GitHub 星标超 20 万的开源 AI Agent 框架,在执行自动化任务、多渠道交互等方面表现出色。但它的原生记忆层仅能简单存储对话记录,缺乏结构化分类与主动调用能力,导致三个核心痛点:

- 跨会话失忆:“今天不记得昨天事”,每次新对话从零开始

- Token 成本飙升:长对话将所有历史全量注入上下文,成本指数级增长

- 被动响应:只会等待指令,不会主动预判用户需求

6.2 方案:memU 作为“记忆外挂”

memU 恰好弥补了 OpenClaw 的这些短板。集成后:

- 跨会话永久记忆:memU 将 OpenClaw 的对话记录自动提取、分层存储,跨会话永久保存

- Token 成本降低 70%+:memU 的分层缓存 + 洞察预加载,只将真正相关的记忆注入上下文

- 从被动到主动:memU 后台持续监控,自动预判用户意图,在用户开口前主动行动

集成代码极为简洁。通过 memU 的 MemUService API,开发者可以在几分钟内将记忆能力接入 OpenClaw。memU 官方也提供了云平台版本,让开发者可以零配置快速接入,同时也支持完全自托管部署,满足隐私和合规需求。

6.3 效果:从“工具”到“伙伴”

集成 memU 后的 OpenClaw,从“一次性任务执行器”进化为“越用越懂你的终身 AI 伙伴”——它能记住你的偏好、理解你的工作习惯、在合适的时机主动提供帮助,而不再是一个每次都要重新认识的“陌生人”。

七、适用场景与局限

✅ 强烈推荐 memU 的场景

- 24/7 持续运行的主动智能体:这是 memU 的核心设计场景。如果你需要构建一个全天候运行、能主动学习和预判的 AI 助手,memU 是目前最匹配的选择。

- 需要多模态记忆的场景:memU 原生支持文本、图像、音频、视频的统一处理,适合处理复杂多模态交互的应用。

- 长对话 Token 成本敏感的场景:70%+ 的上下文压缩率能显著降低长期运行成本,特别适合高频交互的 SaaS 产品。

- 与 OpenClaw / LangChain 等框架集成:memU 提供简单 API 和丰富集成示例,可与主流框架无缝对接。

- 对记忆可解释性有要求:memU 的“文件即记忆”设计让记忆以 Markdown 文件形式存储,人类可读、可审计。

⚠️ 谨慎评估后使用的场景

- 短周期、低频交互的应用:如果 Agent 不需要跨会话记忆,memU 的 24/7 架构可能过于复杂。

- 实时性要求极高的场景:LLM 检索的秒级延迟在实时对话中可能影响体验,需要依赖 RAG 模式并接受其精度限制。

- 团队规模小、运维能力有限:memU 虽然提供云平台,但自托管部署需要管理 Postgres 数据库、memU-server、memU-ui 等多个组件,有一定运维门槛。

❌ 不太适合的场景

- 简单的单次问答场景:memU 的复杂度远超需求,直接使用 RAG 即可。

- 已有成熟记忆基础设施且不愿迁移:memU 需要替换或重构现有记忆层,迁移成本需要评估。

八、模块一总结:5 个框架,5 条完全不同的路线

memU 是模块一的第五个框架,也是五个框架中范式最为激进的一个。现在,让我们把这五个框架放到一起,做一次全景对比。

| 维度 | Text2Mem | Mem0 | Letta | ReMe | memU |

|---|---|---|---|---|---|

| 核心理念 | 标准化指令集 | 双存储中间件 | OS 虚拟内存 | 文件即记忆 | 记忆即 Agent |

| 记忆角色 | 被动存储 | 被动存储 | LLM 自主管理 | 透明存储 | 24/7 主动智能体 |

| 存储模型 | JSON 操作层 | 向量库 + 知识图谱 | Git 仓库 | Markdown 文件 | 三层分层文件系统 |

| 检索方式 | 结构化查询 | 语义 + 关系推理 | LLM 自主调度 | 向量 + BM25 | RAG + LLM 双模式 |

| 可审计性 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| 多模态支持 | 否 | 有限 | 否 | 否 | 原生支持 |

| GitHub Star | ~500 | 41k+ | 21k+ | 1.8k | 11.5k+ |

| 最佳场景 | 高精度操作审计 | 快速接入 | 研究/审计 | 个人知识管理 | 24/7 主动助手 |

五个框架代表了 Agent 记忆系统演进的不同方向,它们共同回答了一个核心问题:Agent 的记忆到底应该怎么设计?

九、小结:从“被动存储”到“主动计算”

memU 最令人兴奋的地方,在于它彻底颠覆了我们对“记忆系统”的认知。记忆不再是一个静态的档案柜,而是一个持续运行、主动学习的后台智能体——它观察、它思考、它预判、它行动。

这种范式跃迁,将 Agent 记忆从“被调用”推向了“主动推送”。在传统框架中,记忆是被动的——Agent 需要时才去查。在 memU 中,记忆是主动的——它持续分析用户行为,在合适的时机主动把相关的记忆和建议推送到 Agent 的上下文中。

但主动范式也带来了新的挑战:

- 计算成本:24/7 后台运行意味着持续的计算资源消耗,尽管 memU 宣称 10 倍长期成本节省,但这一数字的成立前提是高频交互场景——对于低频场景,持续运行的成本可能反而更高

- 隐私考量:持续监控所有交互并自动提取用户偏好,对数据隐私提出了更高要求。memU 的设计强调“本地优先”和“数据隔离”,但用户仍需谨慎评估主动记忆带来的隐私边界

- 主动行为的准确性:在用户开口前就主动行动,听起来很智能,但一旦预判错误,带来的用户体验可能比被动等待更差。如何在“主动”和“谨慎”之间找到平衡,是主动记忆面临的最大挑战。

memU 团队在 1.0.0 发布博客中这样总结他们的方向:“memU 1.0.0 是一个专门为智能体构建的记忆基础设施——可演化、可维护、为长期使用而设计。它不是关于更大的上下文窗口,也不是关于更复杂的 RAG 流水线。相反,memU 提供了一个长期记忆系统:人类可以管理,智能体可以理解,智能体的能力可以随时间演化。”

这正是 memU 对整个 Agent 记忆领域的终极贡献:记忆不是 Agent 的“外挂”,而是 Agent 的“内核”。当记忆本身成为一个 24/7 运行的智能体时,Agent 才真正从“一次性工具”进化为“持续成长的数字伙伴”。

模块一至此完结。 接下来我们将进入模块二,把目光从“开源框架”转向“前沿研究架构”,一口气拆解 5 条完全不同的记忆技术路线:MemOS v2.0.8(多态记忆)、OpenViking(字节火山上下文数据库)、Hindsight(仿生记忆)、Second Me(本地训练)、MetaMem(元记忆层)。这些架构代表了学术界和工业界对 Agent 记忆未来的最新探索。下一篇,我们将从模块二的开篇开始,敬请期待。

如果你觉得这篇文章有帮助,欢迎点赞、收藏。你对 memU 的“主动记忆”范式怎么看?是 Agent 记忆的终极方向,还是过度设计的空中楼阁?欢迎在评论区留下你的观点。

更多推荐

已为社区贡献25条内容

已为社区贡献25条内容

所有评论(0)