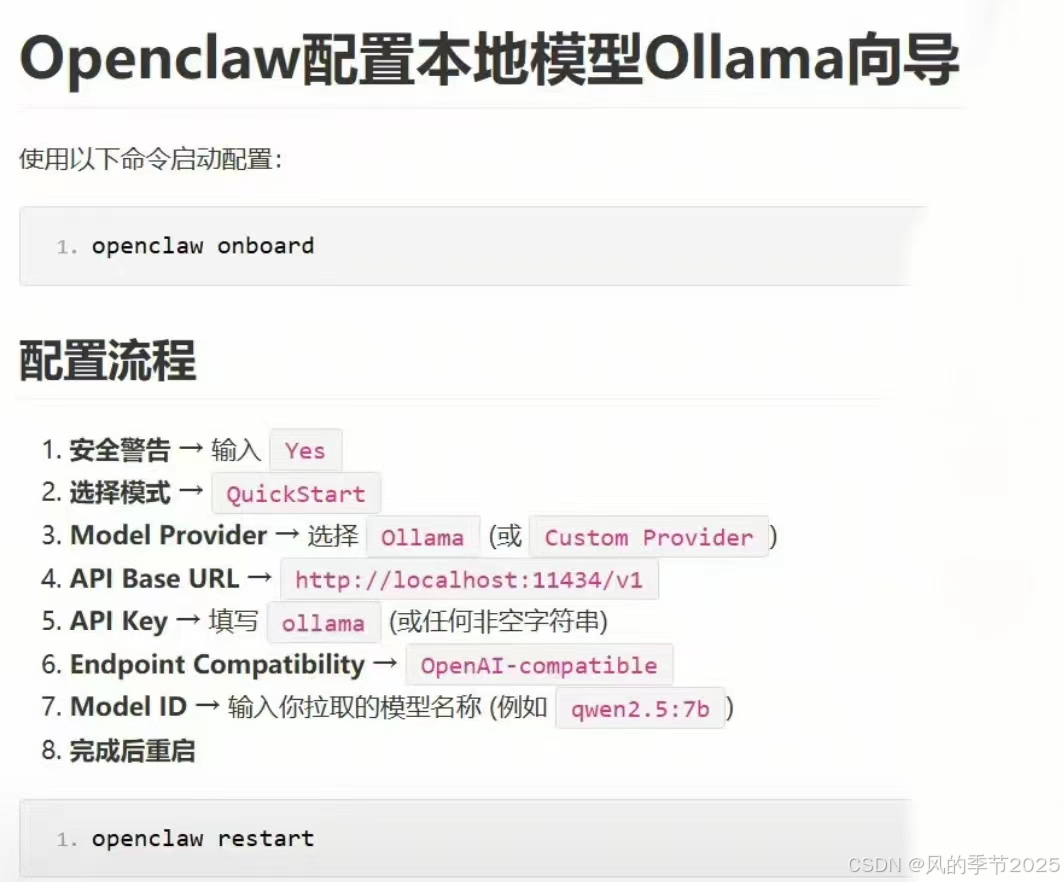

Openclaw标准安装方法 配置本地模型Ollama

Openclaw安装配置本地模型Ollama向导

一、完成前置软件nodejs安装

windwos安装包简单一直下一步安装即可

node-v24.14.0 https://nodejs.org/zh-cn/download

二、安装Openclaw

1.调整Windows PowerShell执行策略

Set-ExecutionPolicy -Scope CurrentUser -ExecutionPolicy RemoteSigned

2.在线安装Openclaw命令

iwr -useb https://openclaw.ai/install.ps1 | iex

3.使用以下命令启动Openclaw初始化配置:

openclaw onboard

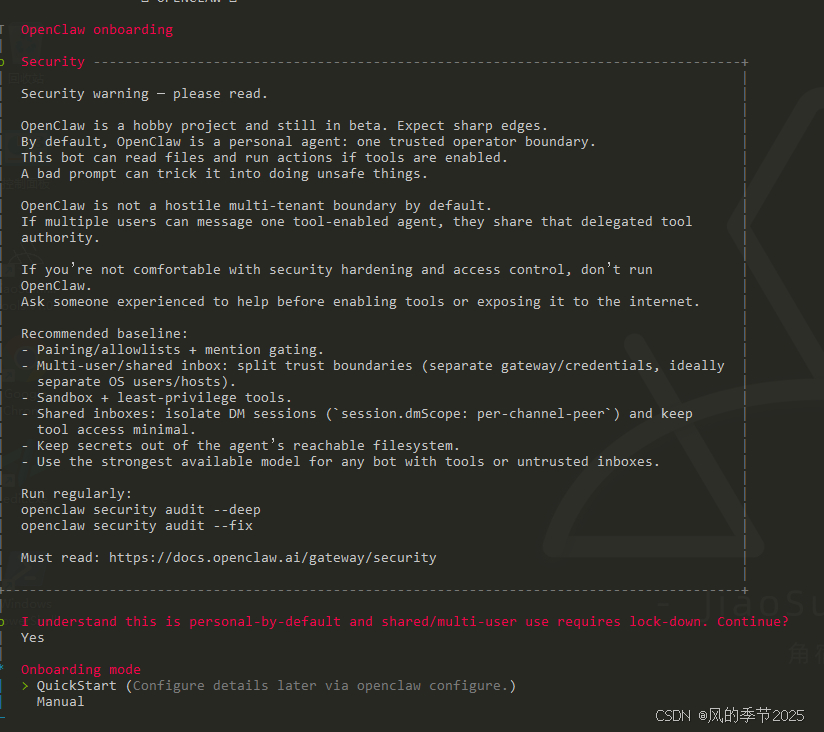

1。安全警告输入 Yes

2。选择模式 QuickStart

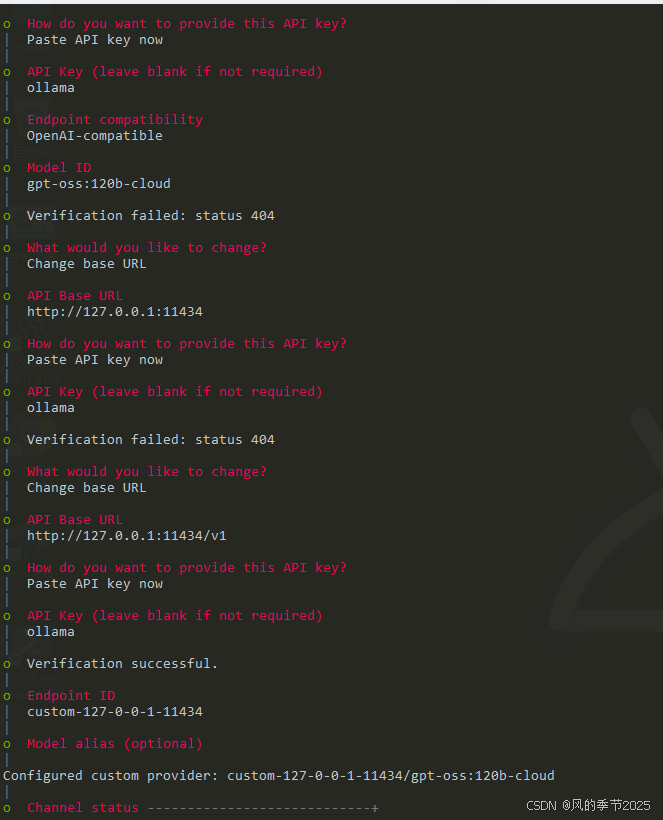

3.Model Provider选择 0llama (或 Custom Provider)

4.API Base URL http://localhost:11434/v1

5.API Key填写 ollama (或任何非空字符串)

6.Endpoint Compatibility OpenAI-compatible

7.Model ID输入你拉取的模型名称(例如 qwen2.5:7b )

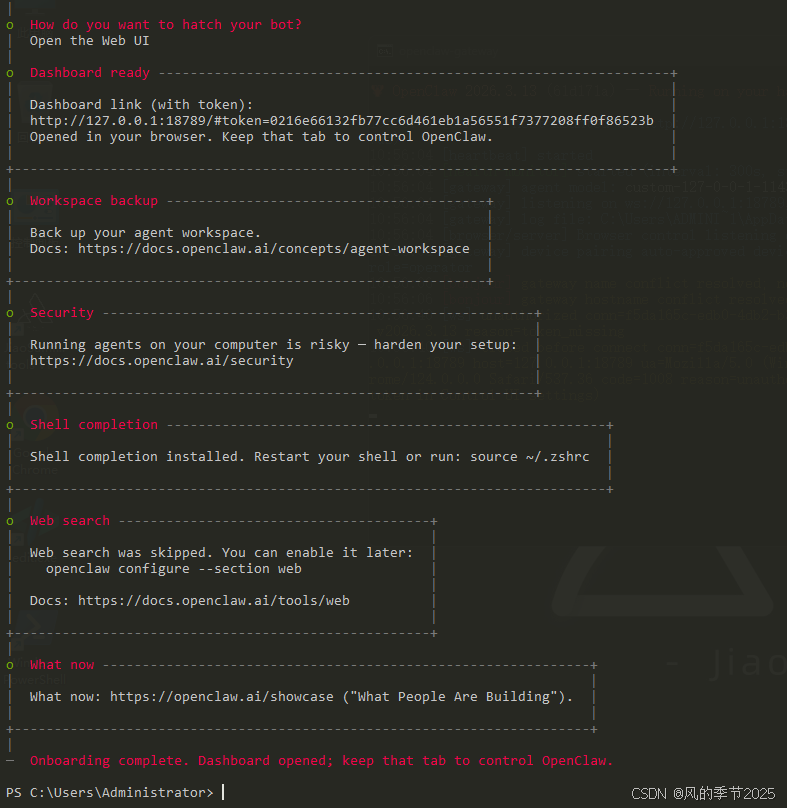

8.完成后重启 openclaw restart

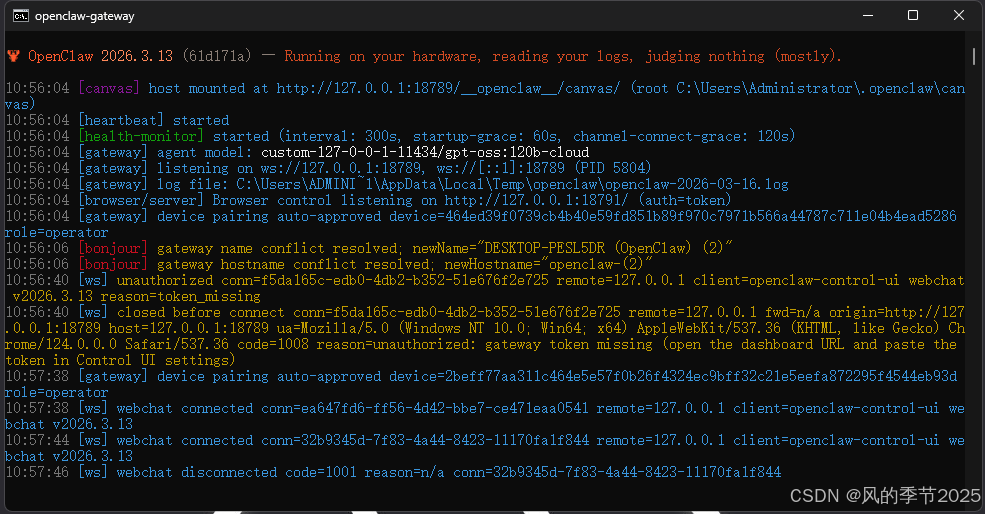

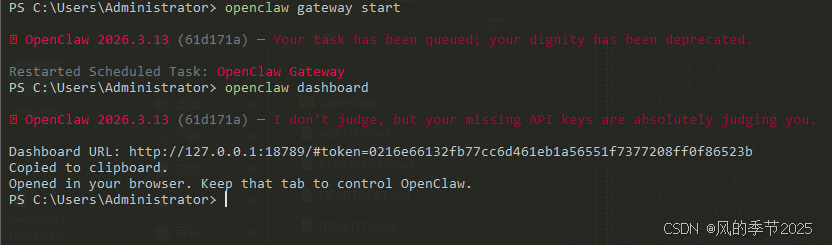

三、关机重启电脑后启动 OpenClaw

启动网关服务 openclaw gateway start

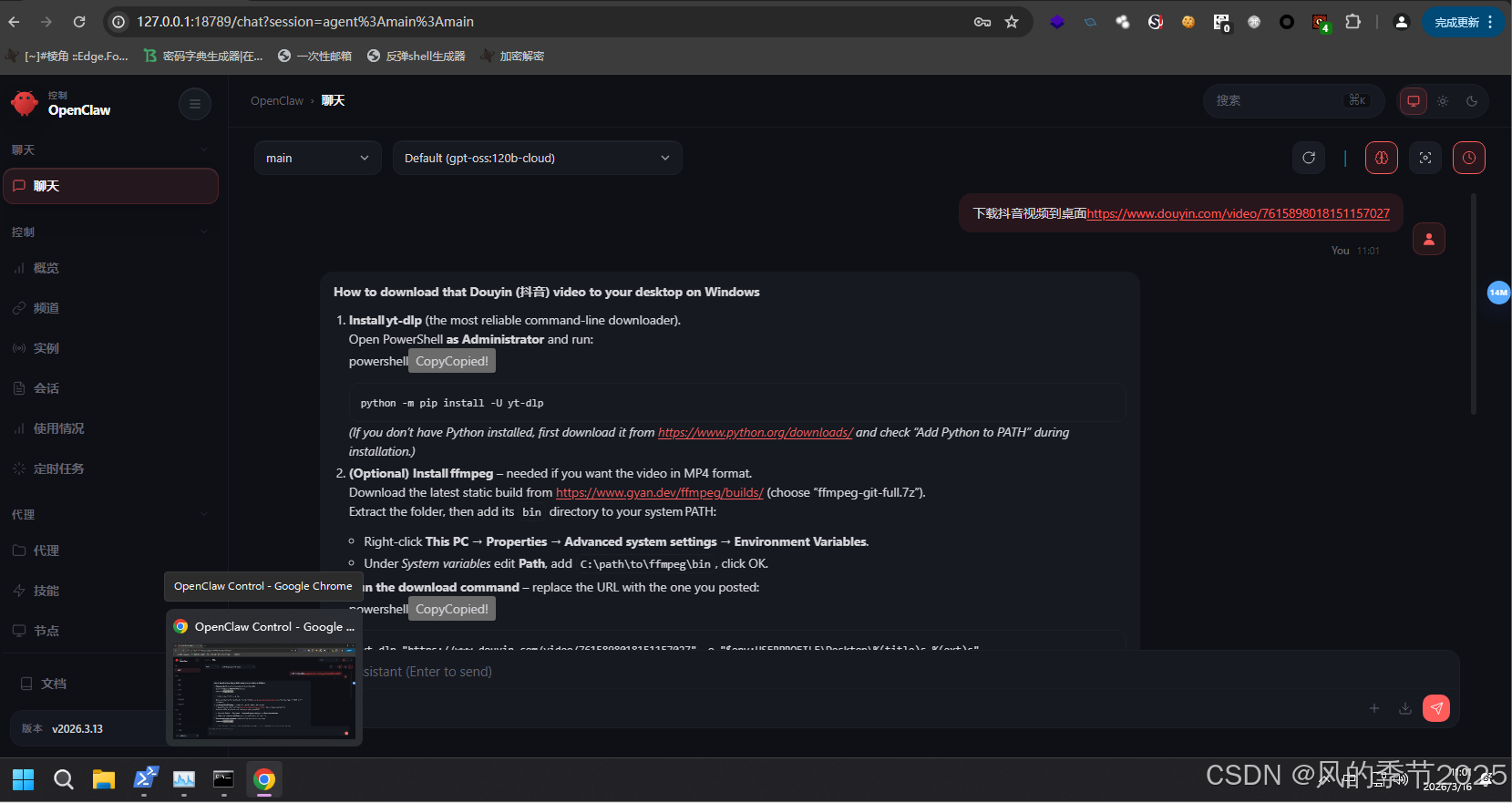

打开 Web 控制面板(自动弹出web对话、管理面板) openclaw dashboard

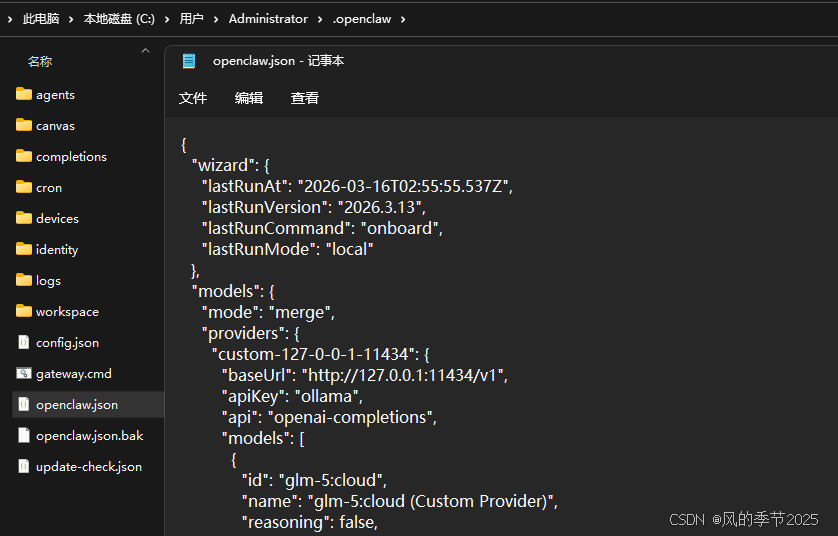

四、修改OpenClaw默认模型方法

1. 找到核心配置文件,用记事本打开 C:\Users\Administrator\.openclaw\openclaw.json

找到配置里的 Models 字段,改成你本地运行的模型名称

2. 重启网关使配置生效openclaw gateway restart

五、OpenClaw其他常用服务命令

- 查看状态

openclaw gateway status - 重启服务

openclaw gateway restart - 停止服务

openclaw gateway stop

设置开机自启动

openclaw gateway install更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)