Token 不再焦虑:用 GPUStack + OpenClaw 搭一个“无限用”的本地 AI 助手(下)

如果出现反复授权,并提示:duplicate plugin id detected。可尝试:rm -rf ~/.openclaw/extensions/feishu。当推理能力、上下文和工具调用都变成基础设施的一部分,不妨亲手试一次,把 AI 真正接进你的日常工作流里。当模型运行在云端、能力掌握在别人手里时,而当模型真正跑在自己的 GPU 上,它不再是一次次付费调用的 API,当你不再关心 Tok

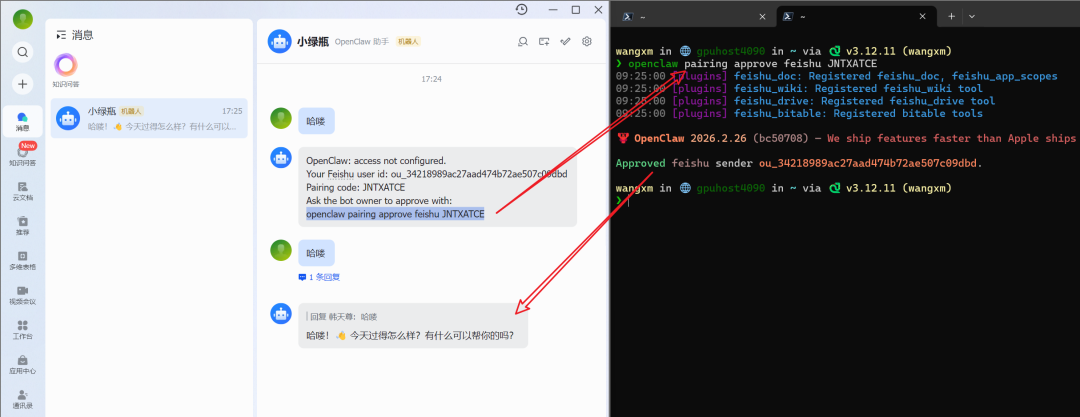

四、首次授权与测试

1. 在飞书中向机器人发送消息

2. 首次会提示 Pairing 授权

3. 在服务器执行:

openclaw pairing approve feishu <Pairing-Code>

如果出现反复授权,并提示:duplicate plugin id detected

可尝试:rm -rf ~/.openclaw/extensions/feishu

openclaw gateway restart

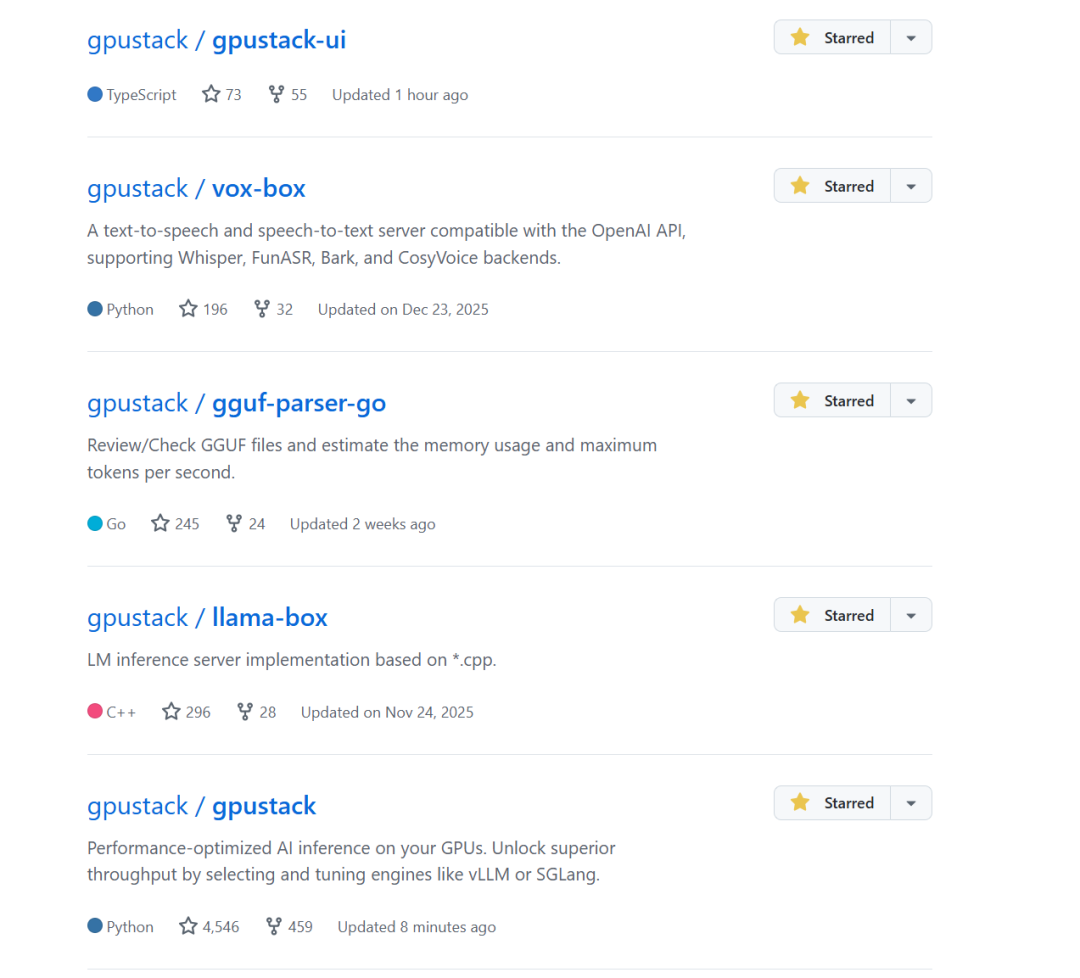

五、实战示例:让机器人给 GPUStack 项目标星

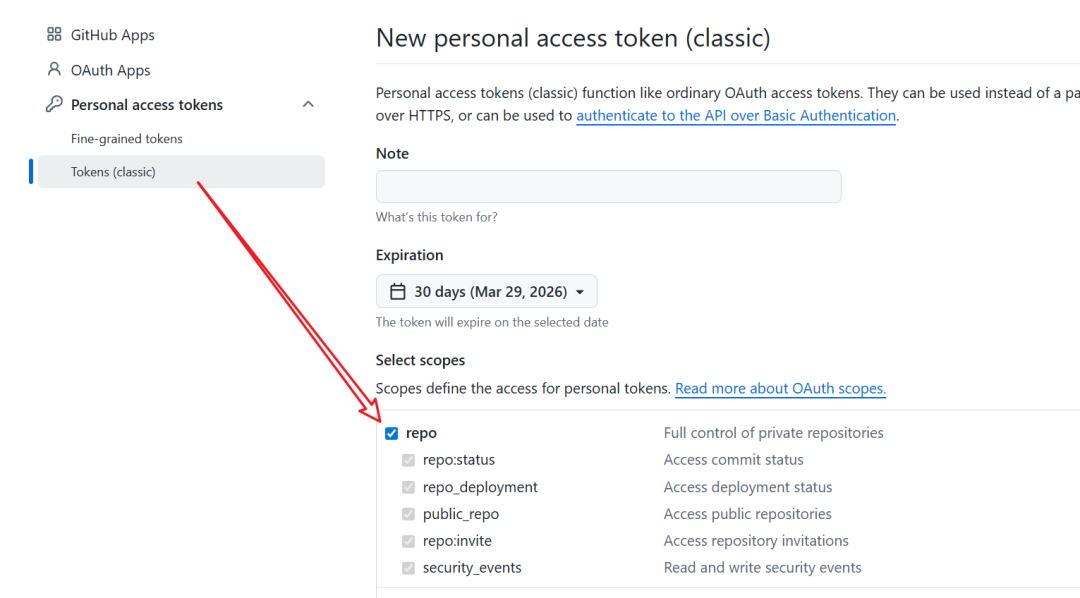

1. 准备 GitHub PAT

使用 Tokens (classic)

勾选 repo 权限

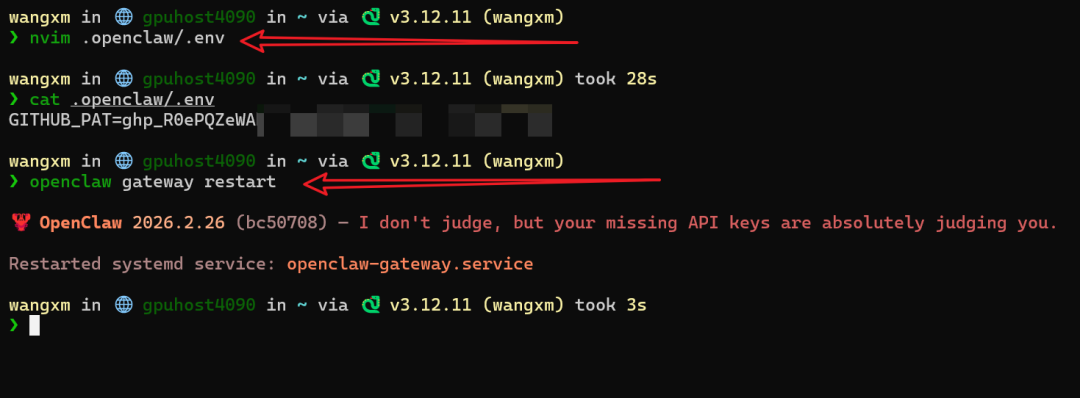

2. 写入环境变量

vim ~/.openclaw/.env

重启:openclaw gateway restart

3. 飞书中发送指令

六、常用指令说明

/new:开启新会话

/status:查看 Bot 状态

/reset:重置上下文

/model:查看 / 切换模型

七、OpenClaw 实用命令与资源入口

常用 CLI 命令

openclaw logs --follow

openclaw doctor

openclaw gateway --help

openclaw dashboard

openclaw tui

文档与生态

📘 https://docs.openclaw.ai

🌐 https://clawhub.ai

结语:当 AI 成为基础设施,而不是消耗品

回过头看,Token 焦虑的本质,并不是模型贵,而是 AI 被当成了一种“外部消耗资源”。

当模型运行在云端、能力掌握在别人手里时,

我们习惯于精打细算、限制使用、控制调用频率。

而当模型真正跑在自己的 GPU 上,

当推理能力、上下文和工具调用都变成基础设施的一部分,

AI 的角色也随之发生了变化——

它不再是一次次付费调用的 API,

而是一个随时可用、长期在线、持续演进的工作助手。

这正是 GPUStack 与 OpenClaw 组合所带来的意义:

让 AI 从“成本项”,回归为“生产力”。

如果你已经拥有 GPU 资源,

不妨亲手试一次,把 AI 真正接进你的日常工作流里。

当你不再关心 Token 的时候,

你才会真正开始用好 AI。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)