扔掉提示词,开始养“龙虾”:2026 AI自动化执行新逻辑

2026年,我们终于不再对着AI喊“OMG”,而是冷静地思考如何让它搬砖。OpenClaw的爆火,本质上是行业对“代理式AI(Agentic AI)”渴望的一次集中爆发。从单一模型到多Agent协同,从概率生成到确定性执行,从提示词工程到流程工程。我们正在见证AI从“玩具”变成“工具”,再变成“同事”的演进过程。别再试图训练一个无所不能的“神”,试着组建一支各司其职、高效协同的“数字团队”。或许,

01. 2026的十字路口:为什么单模型走不下去了?

如果你还在纠结于提示词怎么写才能让GPT-4o一次性生成完美代码,你可能已经落后于这个时代了。

2026年被行业普遍视为“AI元年”,但这个元年并非因为某个模型突破了万亿参数,而是因为行业终于完成了对AI的“祛魅” 。企业不再关心模型知道多少,只关心它能稳定把事情做对多少次。传统的单模型架构在真实生产环境中面临三大死穴:

-

上下文失忆:长流程任务中,模型越到后面越“糊涂”;

-

工具调用混乱:让一个负责信息搜集的Agent去执行系统脚本,风险极高;

-

成本失控:所有任务都调用千亿参数大模型,推理成本直线飙升。

正如CACM最新评论指出:“Exceptions have become the new norm.”(异常已成为新常态)。当业务流程充满不确定性,传统的硬编码Pipeline已经无法支撑 。

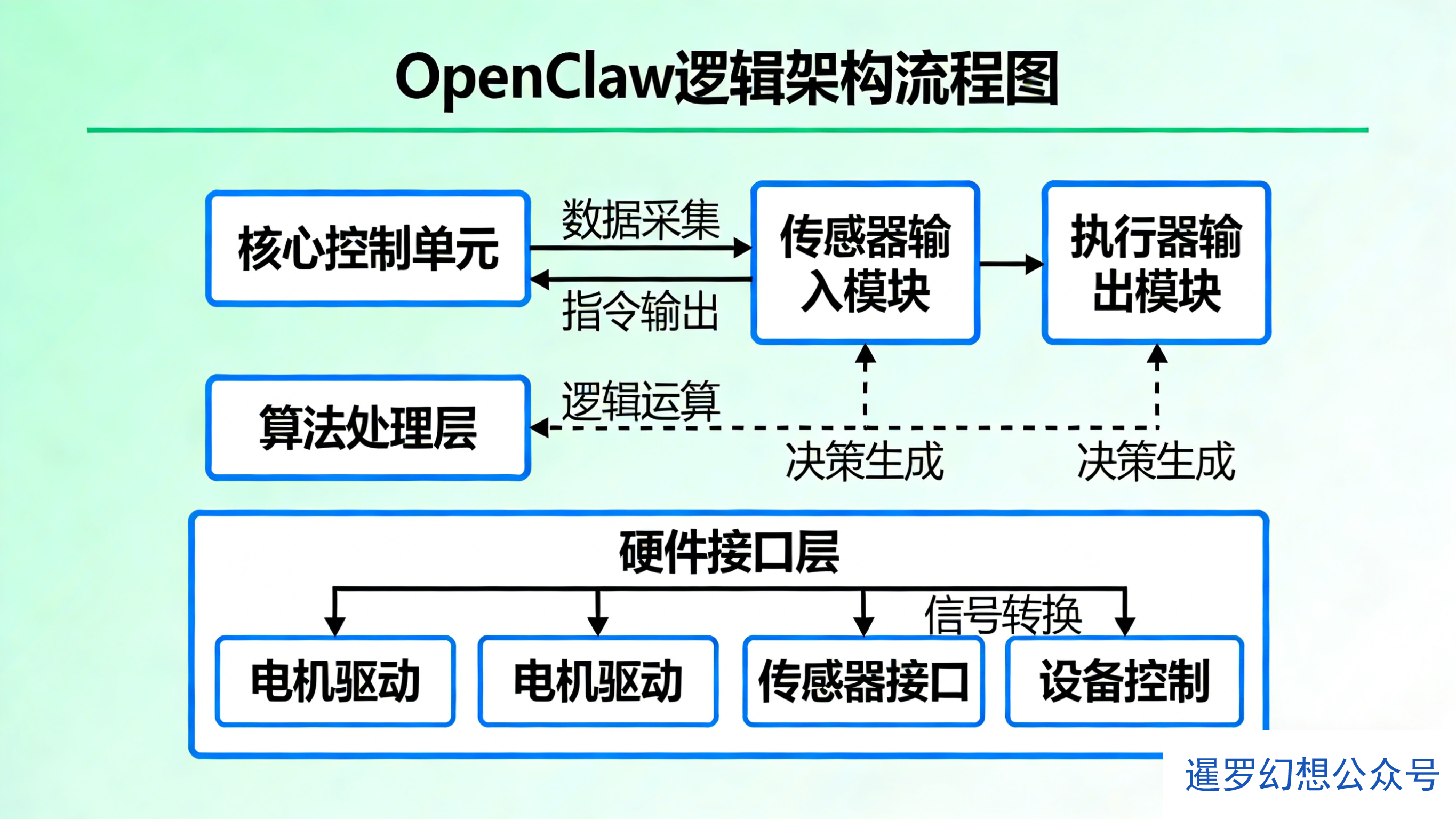

02. 解构“龙虾”内脏:OpenClaw的三大核心设计

OpenClaw之所以能成为2026年的技术爆点,在于它并非一个简单的脚本集合,而是一套设计精密的轻量级AI Agent协同框架 。它通过三大核心设计,将大模型从“会思考”推向了“会执行”。

(一)身脑分离:躯壳与灵魂的彻底解耦

在OpenClaw的哲学里,每个Agent都由“躯壳(agentDir)”和“灵魂(Workspace)”两部分构成 。

-

agentDir(躯壳):负责基础工程接入与鉴权,存放API Key、数据库密码等敏感凭证。你可以在这里为主节点配置复杂推理模型(如Claude-3.7),为子节点配置低延迟快模型(如Gemini Flash),实现动态模型路由 。

-

Workspace(大脑):这是一组纯文本的.md文件!

SOUL.md定义人格,MEMORY.md存储长期记忆,AGENTS.md规范协作职责 。

这种解耦意味着什么?意味着你可以随时更换Agent的“大脑”而无需重启整个服务,意味着多Agent的动态扩展变得像插拔U盘一样轻量。

(二)精准通讯:拒绝“偷听”的会话隔离

多Agent协作最大的噩梦是什么?信息串扰。负责财务的Agent不小心“偷听”到了研发的机密对话。

OpenClaw通过点对点的通讯白名单机制彻底解决了这个问题 。每个Agent拥有唯一的小写agentId,默认状态下,每个Agent处于绝对的上下文隔离中。只有当主Agent通过sessions_send工具显式唤起专业Agent时,指令才会在独立的“沙箱”中流转。这种 “Deny优先” 的权限控制,从底层杜绝了越权操作 。

(三)技能即代码:让Agent自己写工具

这是OpenClaw最激进也最性感的特性。它的技能系统允许用户通过自然语言指令,让智能体自行编写代码来创建新技能 。

这意味着什么?意味着系统具备了元能力——不仅是调用工具,更是创造工具。当你告诉它“我需要一个监控竞品官网变动并发送摘要到Slack的技能”,OpenClaw会自己写代码、调试、部署。这种“生成工具—调用工具—再生成工具”的正向循环,正是通往通用人工智能(AGI)的必经之路 。

03. 硬核拆解:OpenClaw任务调度系统解析

如果说上述架构是骨架,那么任务调度系统就是OpenClaw的心脏。2026年的AI自动化执行,核心在于如何将一个大目标拆解为可执行、可观测、可追溯的小步骤。

OpenClaw的调度逻辑摒弃了简单的链式调用,采用了一套更接近工业级工作流引擎的三级调度模型 :

第一级:渠道级调度

网关(Gateway)作为统一的流量入口,负责接收来自WhatsApp、Telegram、Slack、企业微信甚至自定义Webhook的消息 。网关仅做路由和标准化,不参与推理,这种解耦确保了即使某个聊天应用宕机,用户仍可通过其他渠道控保持对智能体的控制 。

第二级:任务级调度(DAG图驱动)

当接收到复杂任务(如“调研2026年新能源汽车市场趋势,生成报告并发送邮件”),系统会启动任务规划模块。

OpenClaw采用基于有向无环图(DAG)的任务分解策略 :

-

任务解析:将大任务分解为“搜索数据”→“分析数据”→“生成图表”→“撰写报告”→“发送邮件”等子任务。

-

依赖分析:识别任务间的依赖关系(“发送邮件”必须等待“生成报告”完成)。

-

并行加速:对于无依赖的任务(如从多个信源同时搜索),调度器会并行执行,大幅压缩总耗时。

第三级:资源级调度

这里体现了OpenClaw的精打细算。调度器会根据子任务的复杂性,动态分配最适合的模型资源 :

-

简单摘要 → 路由到低成本的轻量模型(如Gemini Flash)。

-

代码生成/深度推理 → 调用高性能模型(如Claude-3.7 Sonnet或GPT-4o)。

-

本地隐私数据 → 调度至本地运行的端侧模型(如通过Ollama加载的Qwen2.5-7B),确保数据不出内网 。

心跳机制:从“被动响应”到“主动值守”

OpenClaw区别于传统AI助手的另一大利器是Cron子系统和心跳循环 。通过配置定时任务(Cron表达式),智能体可以在没有用户输入的情况下主动“苏醒”。

比如,你可以设定:

-

“每天早上7点,汇总团队Jira进度发到钉钉群。”

-

“每15分钟扫描一次服务器日志,检测到ERROR关键字立即告警。”

这种从“被动响应”到“主动协作”的转变,让AI Agent真正从一个对话工具,变成了嵌入业务流程的值守系统 。

| 核心维度 | 传统Pipeline/单模型 | OpenClaw 多Agent协同 | 2026年市场价值 |

|---|---|---|---|

| 架构逻辑 | 硬编码流程,按部就班 | 目标驱动,动态规划 | 应对业务不确定性,降低重设计成本 |

| 记忆管理 | 单次会话,上下文有限 | 三级存储(短/长/结构化) | 实现类人长期记忆与知识沉淀 |

| 权限控制 | 粗放或硬编码 | “Deny优先” + 通讯白名单 | 杜绝越权,满足企业级审计合规 |

| 资源调度 | 固定模型,成本高企 | 动态路由:按任务配模型 | 平衡性能与成本,提升边际效益 |

| 运行模式 | 触发-响应 | 心跳值守 + 计划任务 | 从工具升级为7x24小时数字员工 |

04. 商汤们入局:生态爆发与冷思考

OpenClaw的火爆绝不仅仅是开发者的自嗨。就在上个月(2026年3月),商汤科技在AWE展会上正式推出了基于OpenClaw生态的智能体一体化交付方案 。

在这个方案中,商汤的“办公小浣熊”负责解决“能做什么”(数据分析、文档处理能力封装为Raccoon Skills),OpenClaw解决“如何执行”(任务规划与调度),再结合趋境科技的本地AI Box解决“如何落地”。这标志着中国AI厂商开始正视“模型能力”与“执行能力”之间的鸿沟,并试图通过OpenClaw这样的开源框架来填平它 。

但冷静来看,风险与机遇并存。

艾媒咨询分析师指出,OpenClaw仍处于从“个人尝鲜”向“规模化落地”的过渡期 。安全问题尤为突出:

-

供应链投毒:2026年初,安全人员在ClawHub技能市场发现了上千个恶意技能,它们会窃取SSH密钥或开启反向Shell 。

-

“影子AI”泛滥:员工私自部署高权限Agent,绕过IT部门管控,成为企业内网的新跳板 。

05. 结语:系统级智能的黎明

2026年,我们终于不再对着AI喊“OMG”,而是冷静地思考如何让它搬砖。OpenClaw的爆火,本质上是行业对 “代理式AI(Agentic AI)” 渴望的一次集中爆发 。

从单一模型到多Agent协同,从概率生成到确定性执行,从提示词工程到流程工程 。我们正在见证AI从“玩具”变成“工具”,再变成“同事”的演进过程。

回到我们文章的开头,如果你还在困惑为什么自家的AI落地总是不顺,不妨换个思路:别再试图训练一个无所不能的“神”,试着组建一支各司其职、高效协同的“数字团队”。

或许,这才是2026年AI带给我们的最大启示。

关键词: OpenClaw任务调度系统解析:AI自动化执行框架的核心逻辑

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)