使用Ollama本地模型养龙虾

首先下载Ollama配置路径,网络,上下文长度:然后打开,选择模型,发送你好,进行下载。Ollama本地部署模型完毕,下一步我们来对接OpenClaw小龙虾。

·

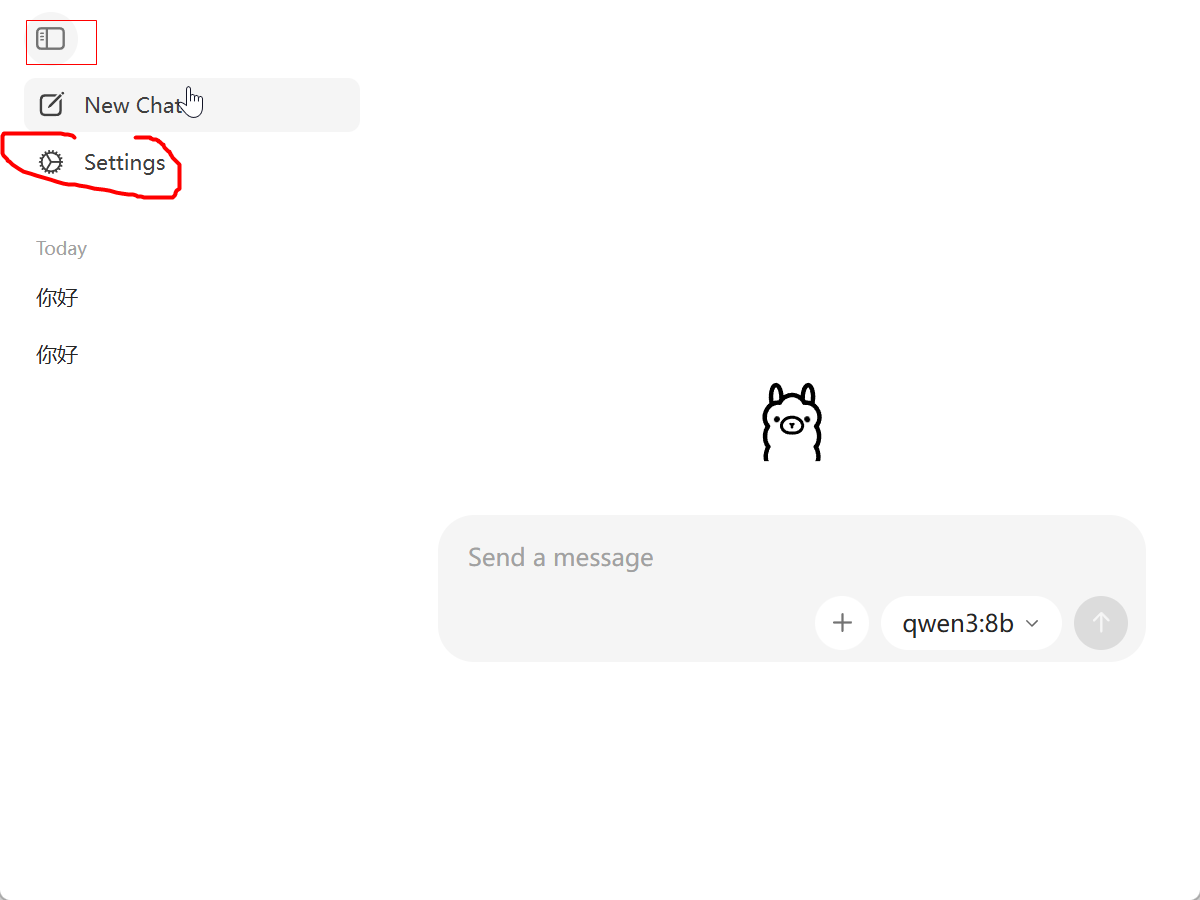

首先下载Ollama

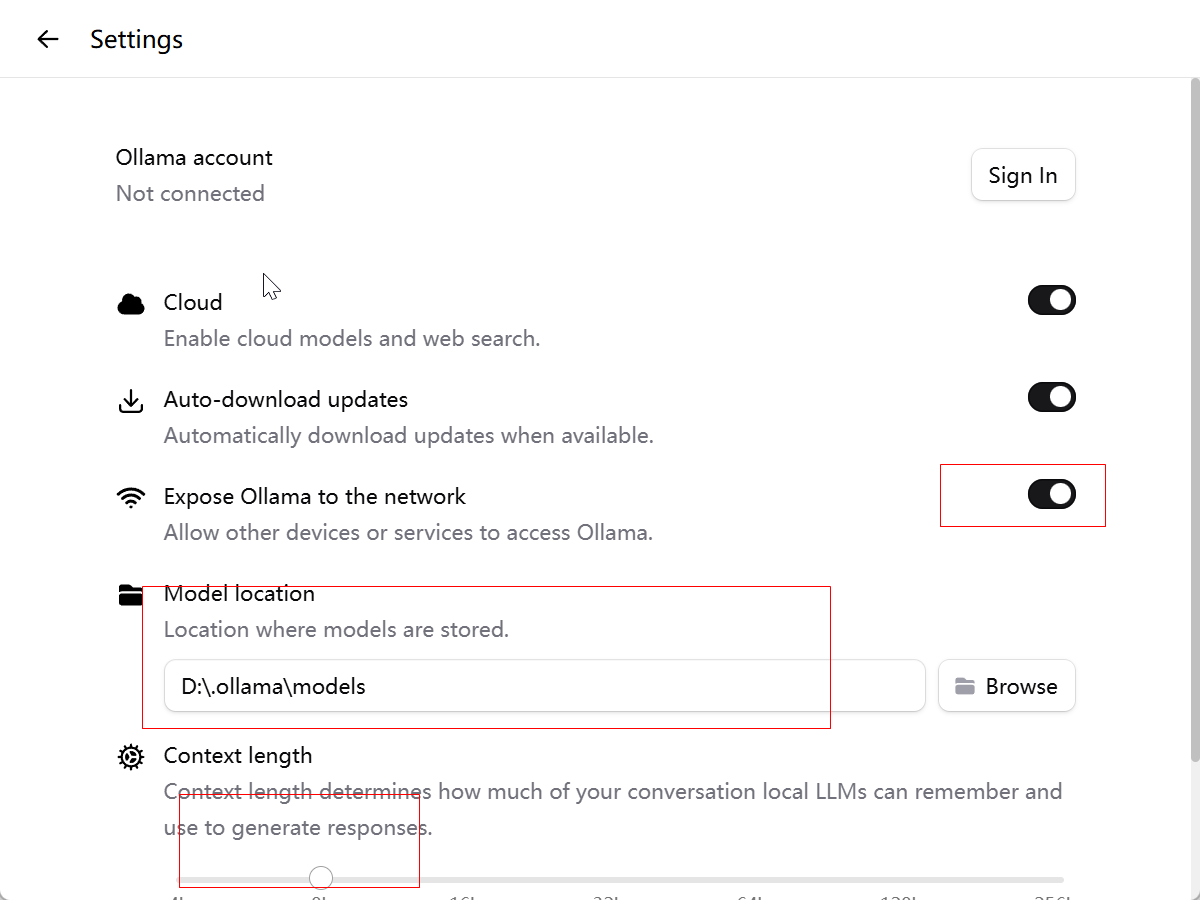

配置路径,网络,上下文长度:

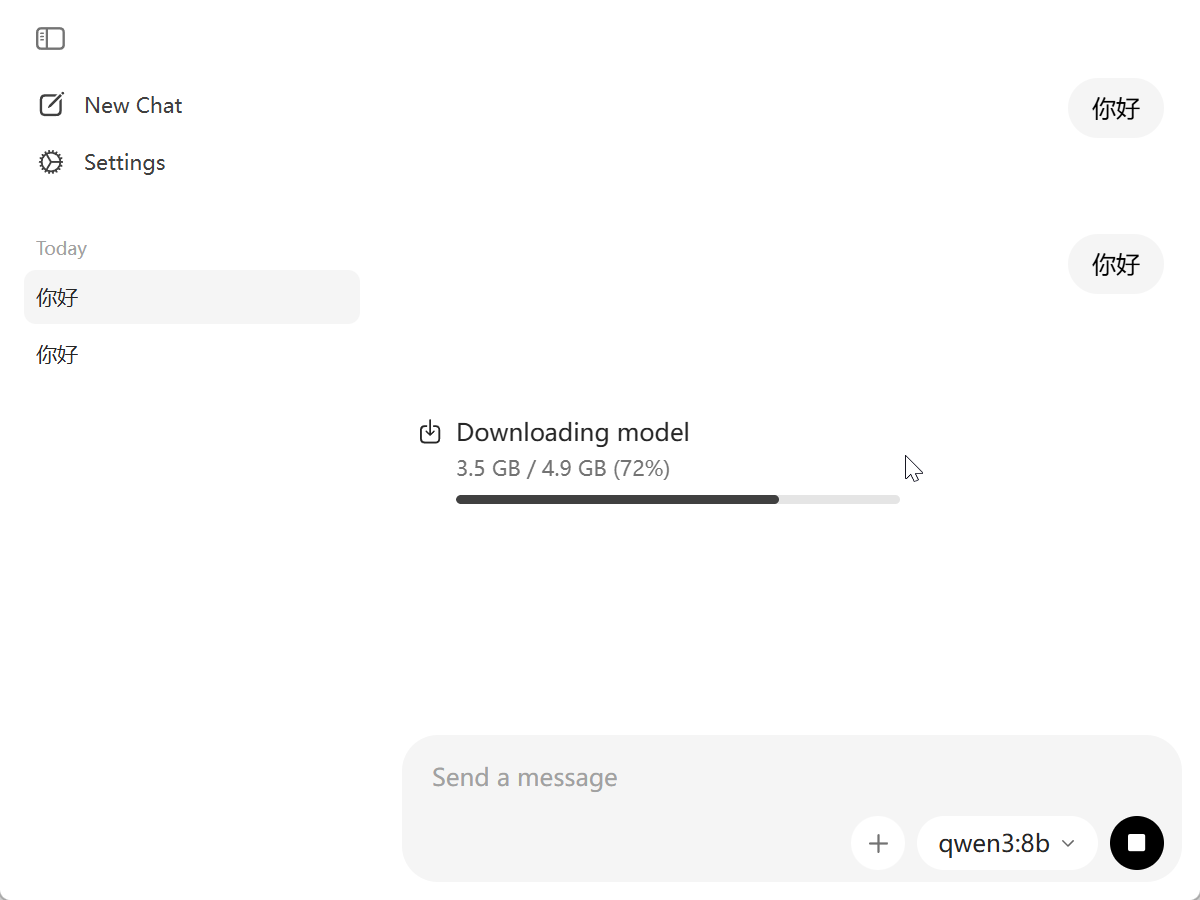

然后打开,选择模型,发送你好,进行下载。

Ollama本地部署模型完毕,下一步我们来对接OpenClaw小龙虾。

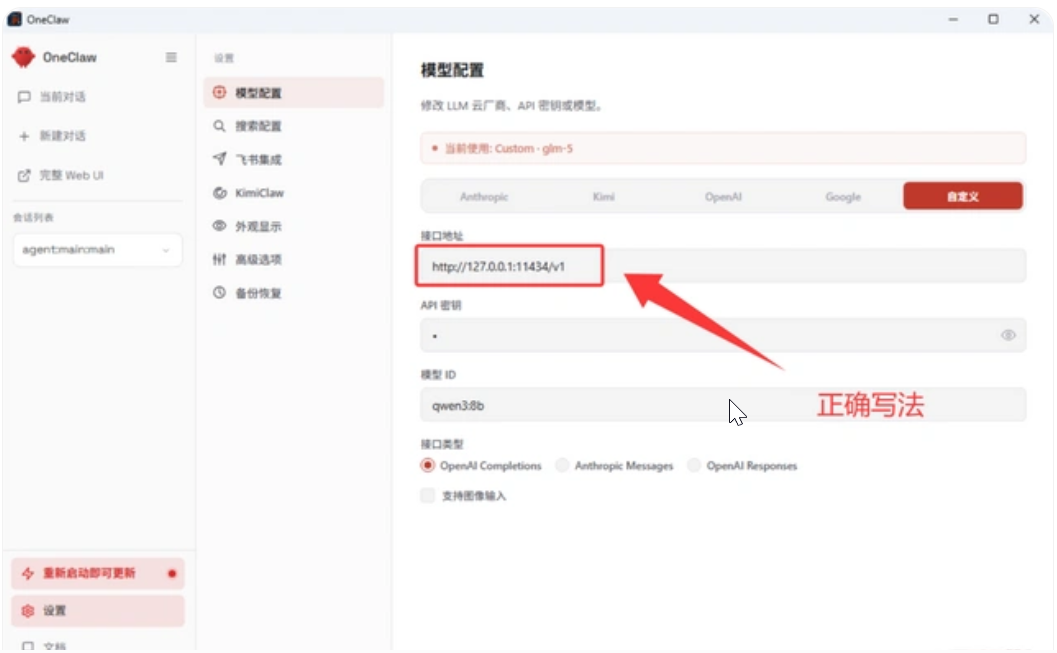

使用 Ollama 运行本地大模型时,其默认的 API 地址和密钥配置如下:

API 地址(URL)

- 基础地址:

http://localhost:11434 - 常用接口路径:

- 聊天接口(推荐用于对话):

http://localhost:11434/api/chat - 生成接口(用于补全/单轮生成):

http://localhost:11434/api/generate - OpenAI 兼容接口(用于对接如 OpenAI 客户端):

http://localhost:11434/v1

- 聊天接口(推荐用于对话):

例如,在使用 curl 或 Python 请求时,若调用聊天功能,应使用:

curl http://localhost:11434/api/chat -X POST -H "Content-Type: application/json" -d '{"model":"llama3","messages":[{"role":"user","content":"你好"}]}'

API 密钥(Key)

- Ollama 本身不要求真实密钥,但部分客户端(如 OpenAI 兼容工具)强制要求填写密钥字段。

- 此时可任意填写一个非空字符串,例如:

ollamalocal-keyanything(只要不为空即可)

例如,在使用 OpenAI Python 客户端时需设置:

pythonCopy Code

client = OpenAI( base_url='http://localhost:11434/v1', api_key='ollama' # 必填,但实际不验证 )

验证服务是否运行

- 确保 Ollama 已启动(安装后通常自动运行)。

- 在终端执行:

bashCopy Code

若返回curl http://localhost:11434Ollama is running或类似内容,说明服务正常。

替换龙虾模型为本地模型,操作如下:

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)