【AI智能体】——OpenClaw(龙虾)深度研究分享(三)OpenClaw+Ollama本地模型定制

OpenClaw与Ollama本地AI代理系统部署指南 摘要:本文详细介绍如何部署OpenClaw与Ollama结合的本地AI代理系统。OpenClaw作为系统级操作工具,配合Ollama本地大模型推理,实现自然语言指令到实际操作的转换。重点包括:1)Ollama的轻量级部署方法;2)Qwen系列大模型的拉取与自定义配置(需扩展至32K上下文窗口);3)OpenClaw对接本地模型的完整配置流程;

一、使用背景

OpenClaw是一款具备系统级操作权限的AI代理工具,能将自然语言指令转化为实际的文件操作、程序控制、网络请求等行为;Ollama则是一款轻量级的本地大模型运行工具,支持一键部署Qwen、Llama、Phi等主流大模型,二者结合能实现本地推理+本地执行的全闭环。

二、Ollama简介

Ollama 是一个开源框架,专为在本地机器上便捷部署和运行大型语言模型(LLM)而设计。

Ollama是OpenClaw的“智能大脑”,负责自然语言指令的解析与推理,需先完成Ollama安装,再拉取并定制大模型,核心要求是模型上下文窗口≥16000 tokens(OpenClaw官方硬性要求,否则无法正常运行)。

三、Ollama特点和功能概述

1、简化部署:

Ollama 目标在于简化在 Docker 容器中部署大型语言模型的过程,使得非专业用户也能方便地管理和运行这些复杂的模型。

2. 轻量级与可扩展:

作为轻量级框架,Ollama 保持了较小的资源占用,同时具备良好的可扩展性,允许用户根据需要调整配置以适应不同规模的项目和硬件条件。

3. API支持:

提供了一个简洁的 API,使得开发者能够轻松创建、运行和管理大型语言模型实例,降低了与模型交互的技术门槛。

4. 预构建模型库:

包含一系列预先训练好的大型语言模型,用户可以直接选用这些模型应用于自己的应用程序,无需从头训练或自行寻找模型源。

5. 模型导入与定制:

从 GGUF 导入:支持从特定平台(如GGUF,假设这是一个模型托管平台)导入已有的大型语言模型。

从 PyTorch 或 Safetensors 导入:兼容这两种深度学习框架,允许用户将基于这些框架训练的模型集成到 Ollama 中。

自定义提示:允许用户为模型添加或修改提示(prompt engineering),以引导模型生成特定类型或风格的文本输出。

6. 跨平台支持:

提供针对 macOS、Windows(预览版)、Linux 以及 Docker 的安装指南,确保用户能在多种操作系统环境下顺利部署和使用 Ollama。

7. 命令行工具与环境变量:

命令行启动:通过命令 ollamaserve 或其别名 serve、start 可以启动 Ollama 服务。

环境变量配置:如 OLLAMA_HOST,用于指定服务绑定的主机地址和端口,默认值为 127.0.0.1:11434。

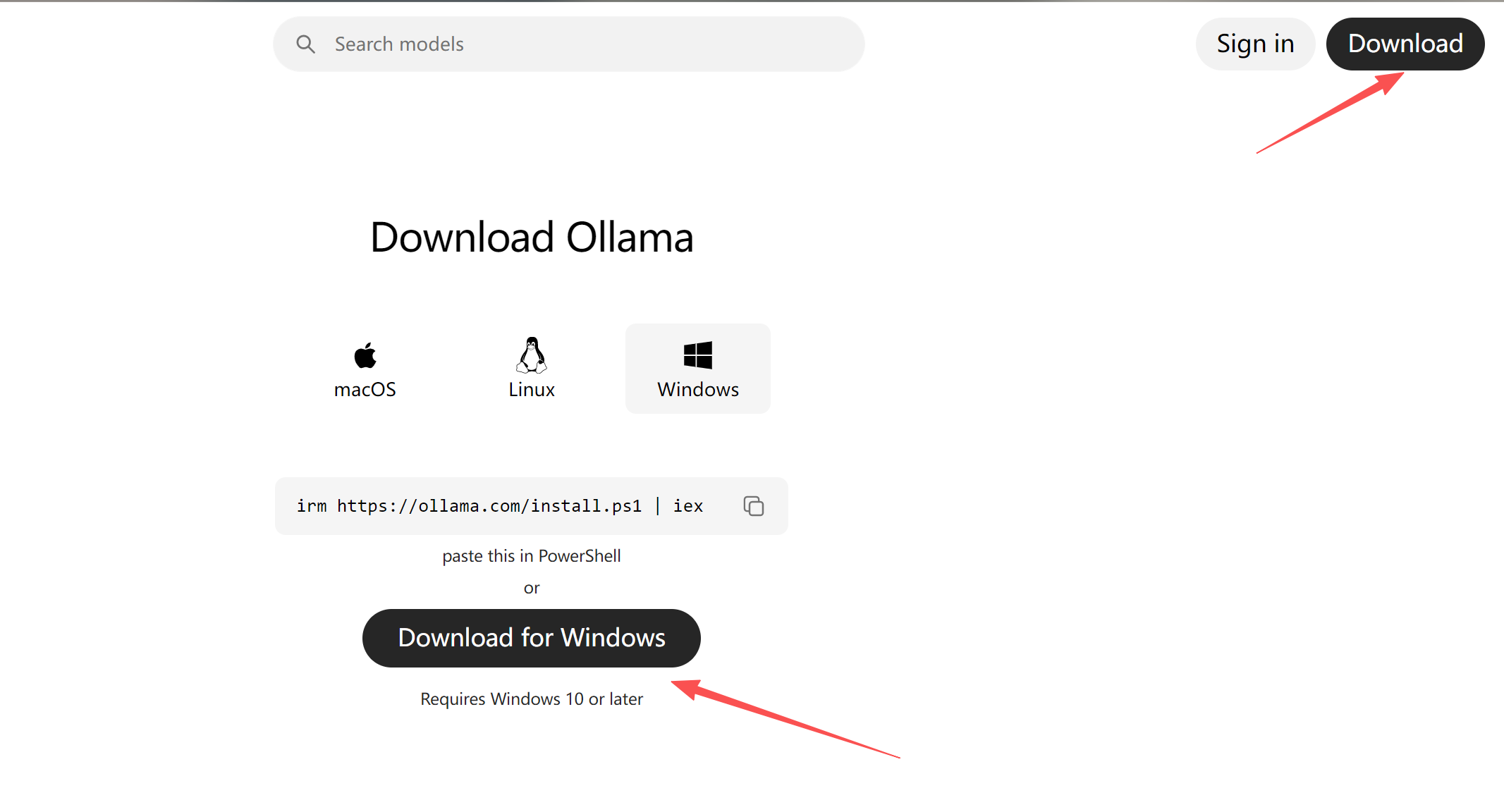

四、Ollama如何安装

1、访问Ollama官网,以window下载安装为例

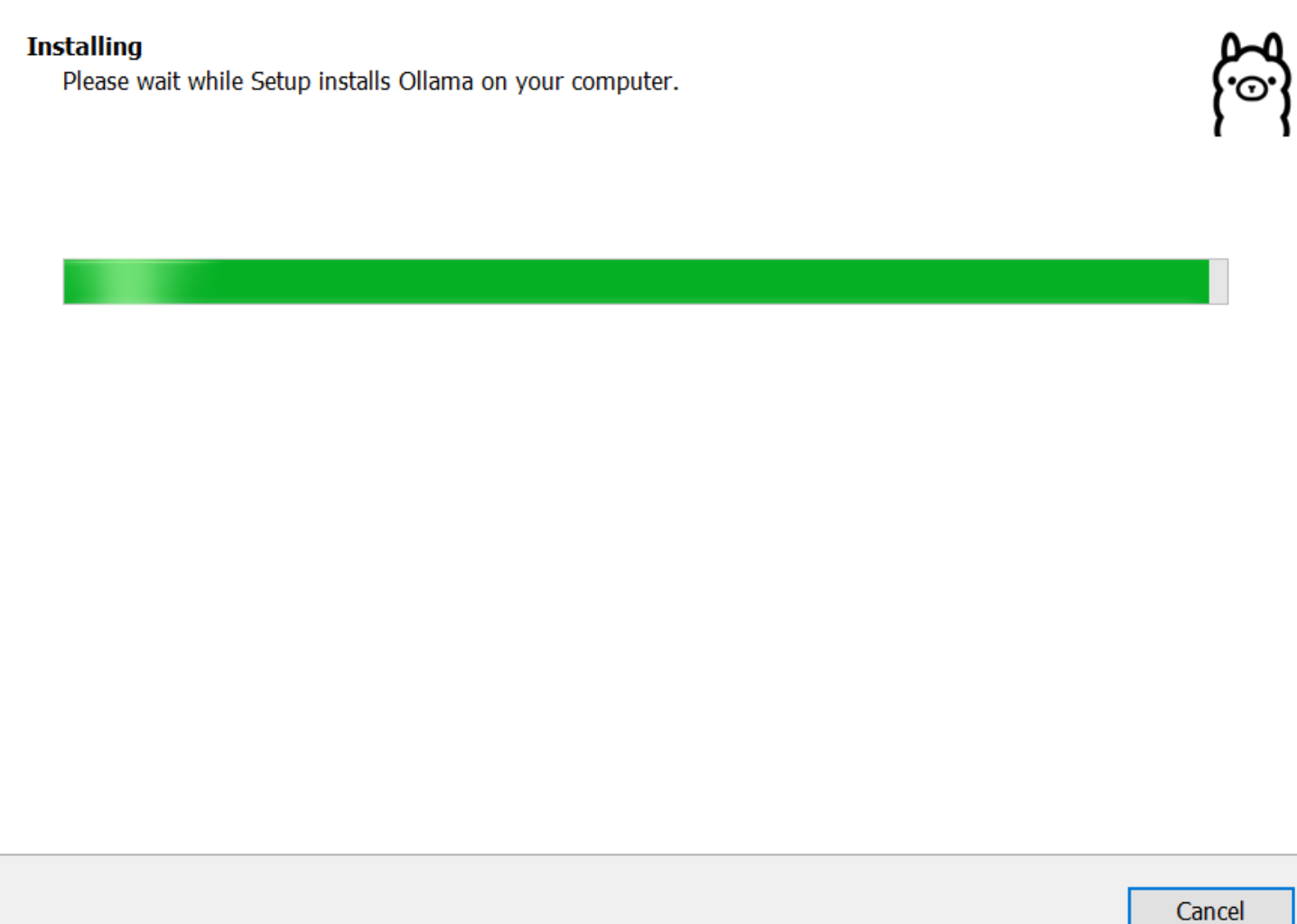

下载Windows版本安装包,双击运行,全程默认下一步即可完成安装;

2、 安装完成后,Ollama会自动注册为系统服务,实现开机自启,无需手动启动;

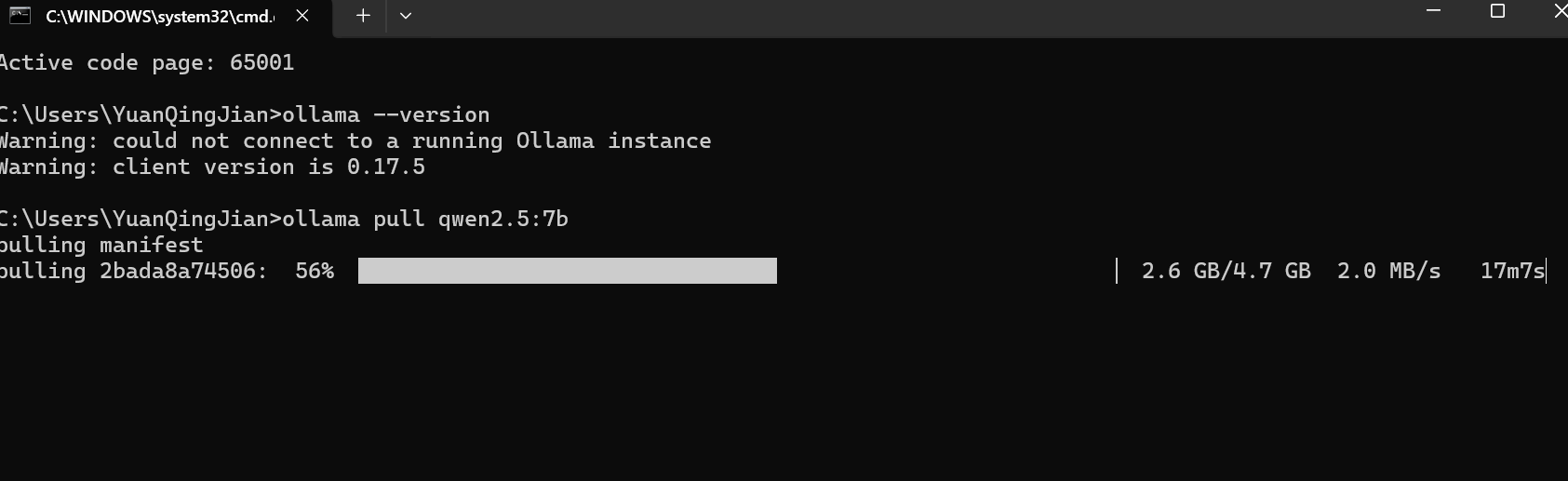

3、验证Ollama安装是否成功,在PowerShell中执行以下命令,显示版本号即表示成功

拉取基础大模型(推荐Qwen2.5/ Qwen3)

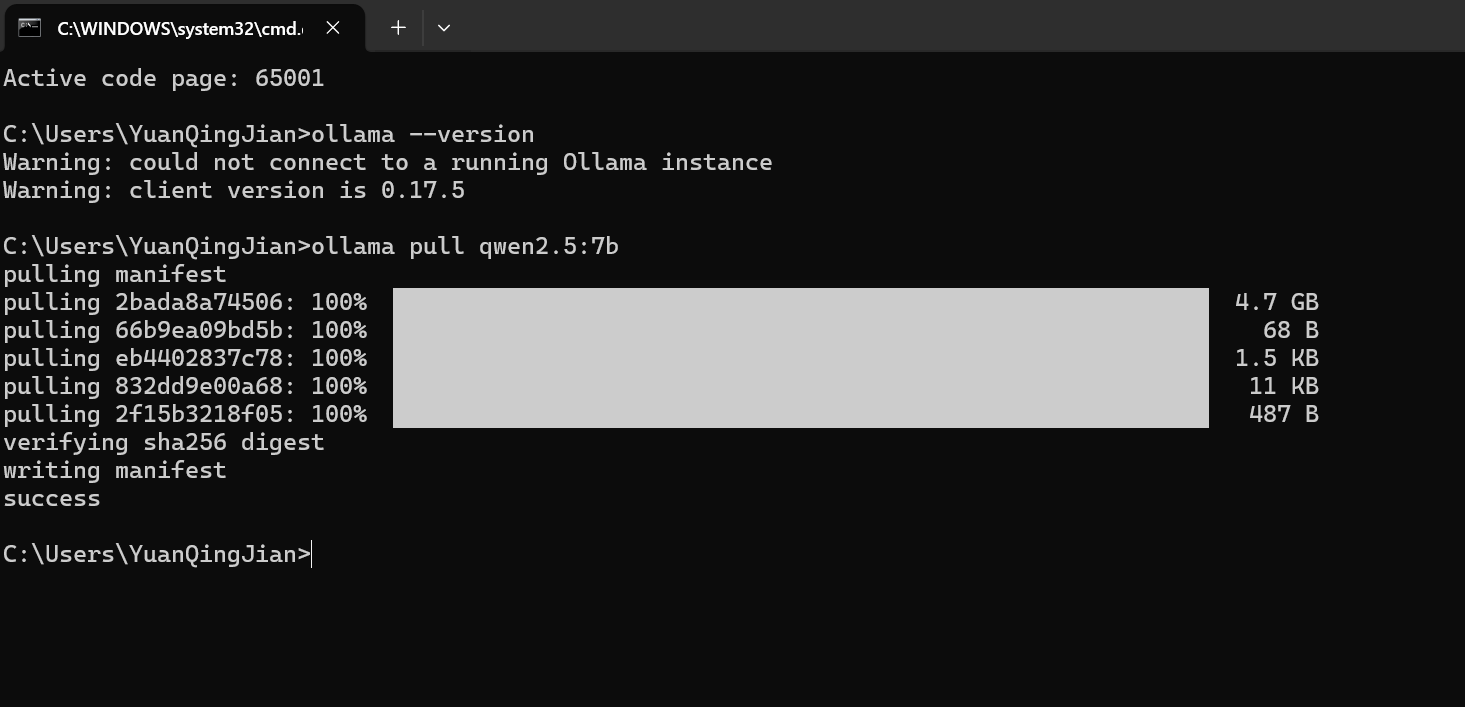

Ollama支持一键拉取主流大模型,推荐通义千问系列(Qwen2.5/Qwen3),中文推理能力强、适配性好,基础模型选择7B量化版,兼顾性能与硬件要求,命令如下:

# 拉取Qwen2.5 7B基础模型(约4.7GB,推荐)

ollama pull qwen2.5:7b

# 若需更强的推理能力,可拉取Qwen3 8B模型(约5GB,要求显存≥10GB)

ollama pull qwen3:8b

# 轻量版,显存4GB可运行:Qwen2.5 4B

ollama pull qwen2.5:4b

拉取过程中保持网络通畅,根据网络速度,耗时约5~20分钟,拉取完成后,模型会自动存储在本地Ollama目录中。

创建支持更大上下文窗口的模型(OpenClaw 要求 ≥16K)

OpenClaw 默认要求模型上下文窗口至少 16000 tokens,而基础模型可能只有 4096,因此需要创建自定义模型。

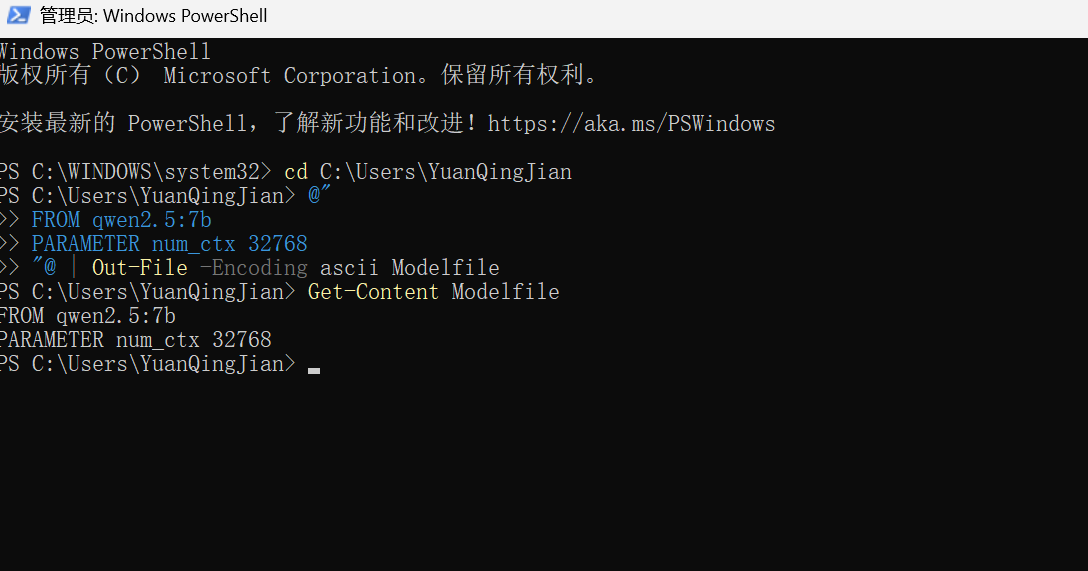

1、切换到用户根目录

cd C:\Users<你的用户名>

2、创建Modelfile模型配置文件,定义基础模型与上下文窗口参数,执行以下命令(一键创建,无需手动编辑)

#创建Modelfile,基于Qwen2.5:7b,设置上下文窗口32768 tokens

@"FROM qwen2.5:7b

PARAMETER num_ctx 32768"@ | Out-File -Encoding ascii Modelfile

正确输出应包含:FROM qwen2.5:7b和PARAMETER num_ctx 32768

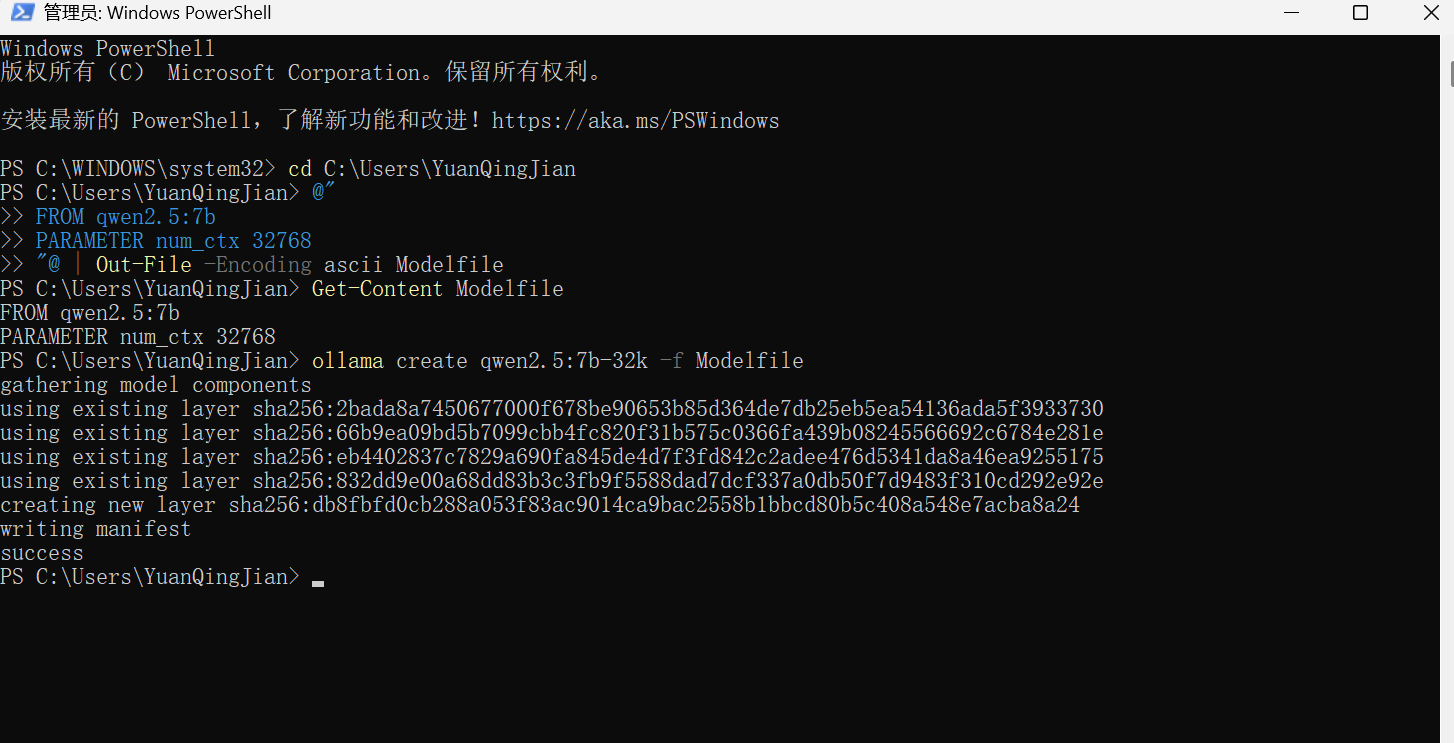

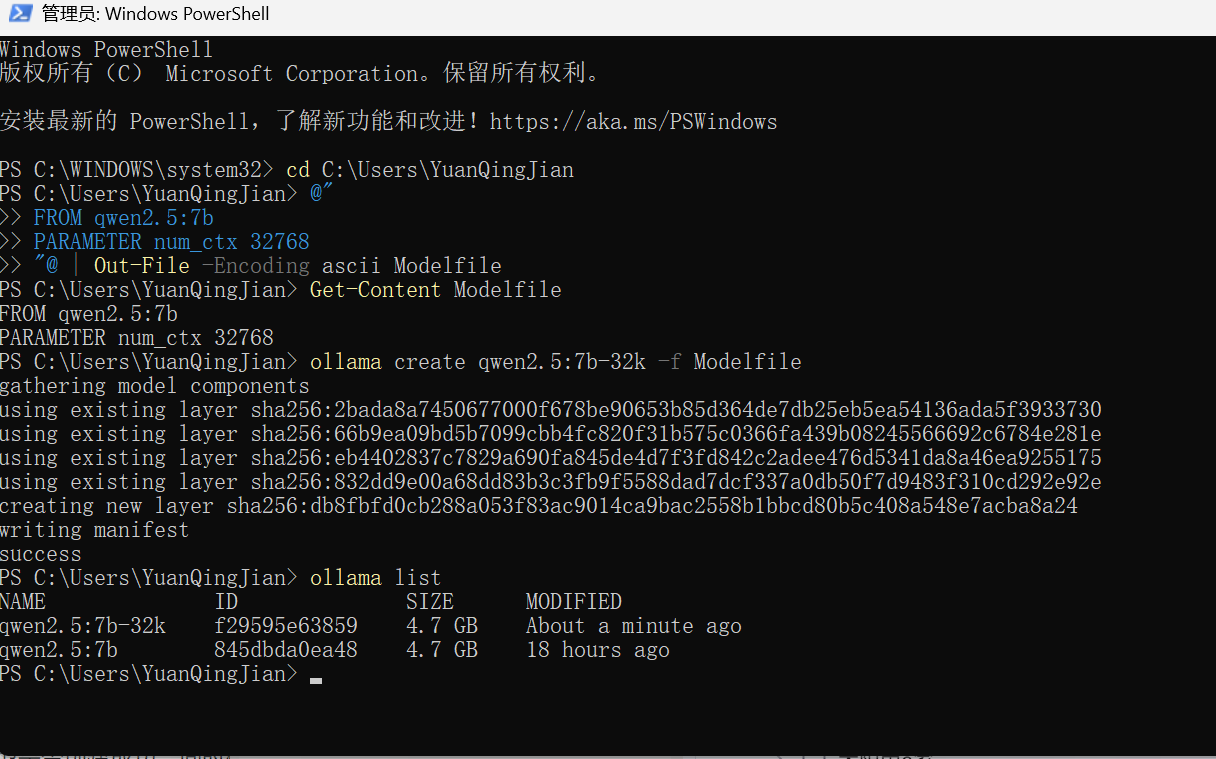

4、基于Modelfile创建自定义模型(命名为qwen2.5:7b-32k,便于识别):

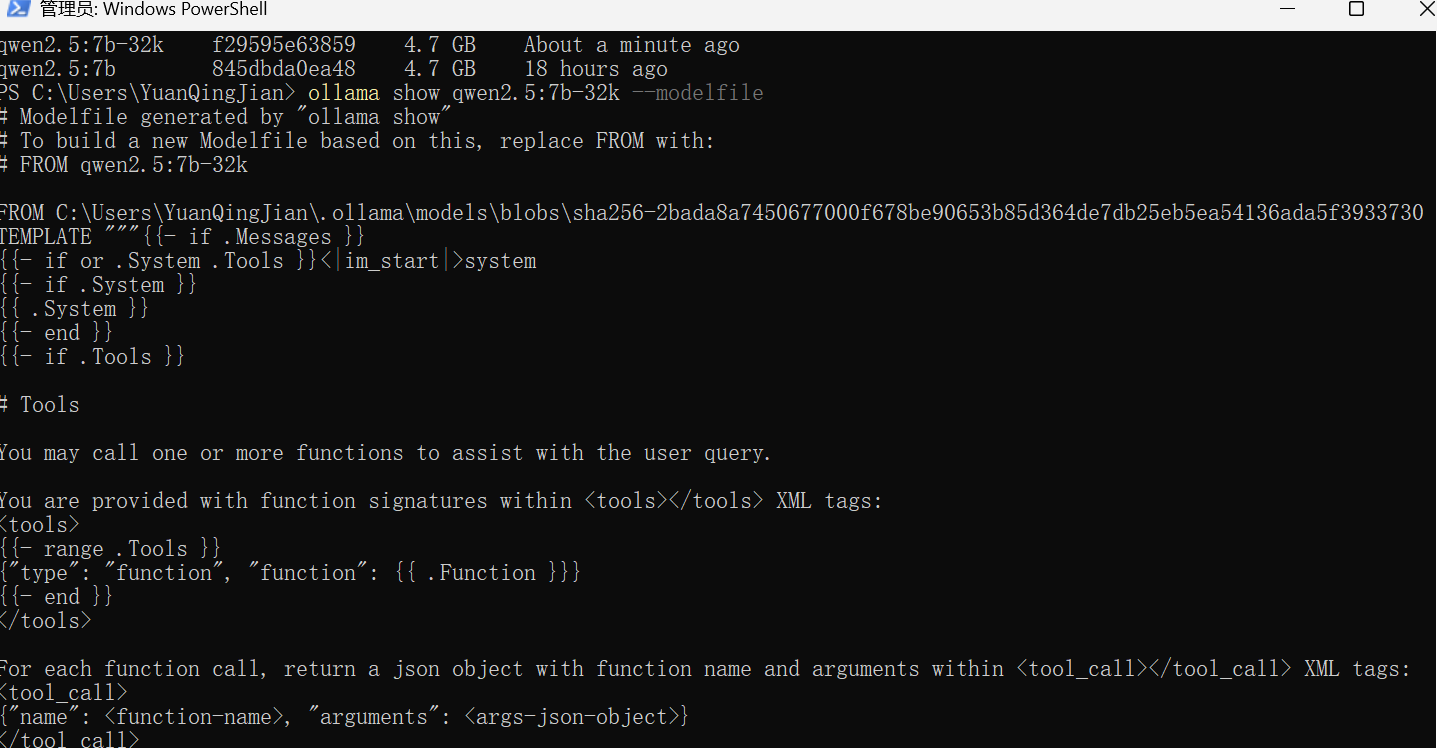

5、验证自定义模型是否创建成功,同时检查上下文窗口参数:

查看本地所有模型,应显示qwen2.5:7b-32k

ollama list

查看自定义模型的配置,确认包含num_ctx 32768

ollama show qwen2.5:7b-32k --modelfile

注:若创建时出现unknown type错误,原因是Modelfile包含不可见字符,重新执行步骤2的创建命令即可(已指定-Encoding ascii,避免字符问题)。

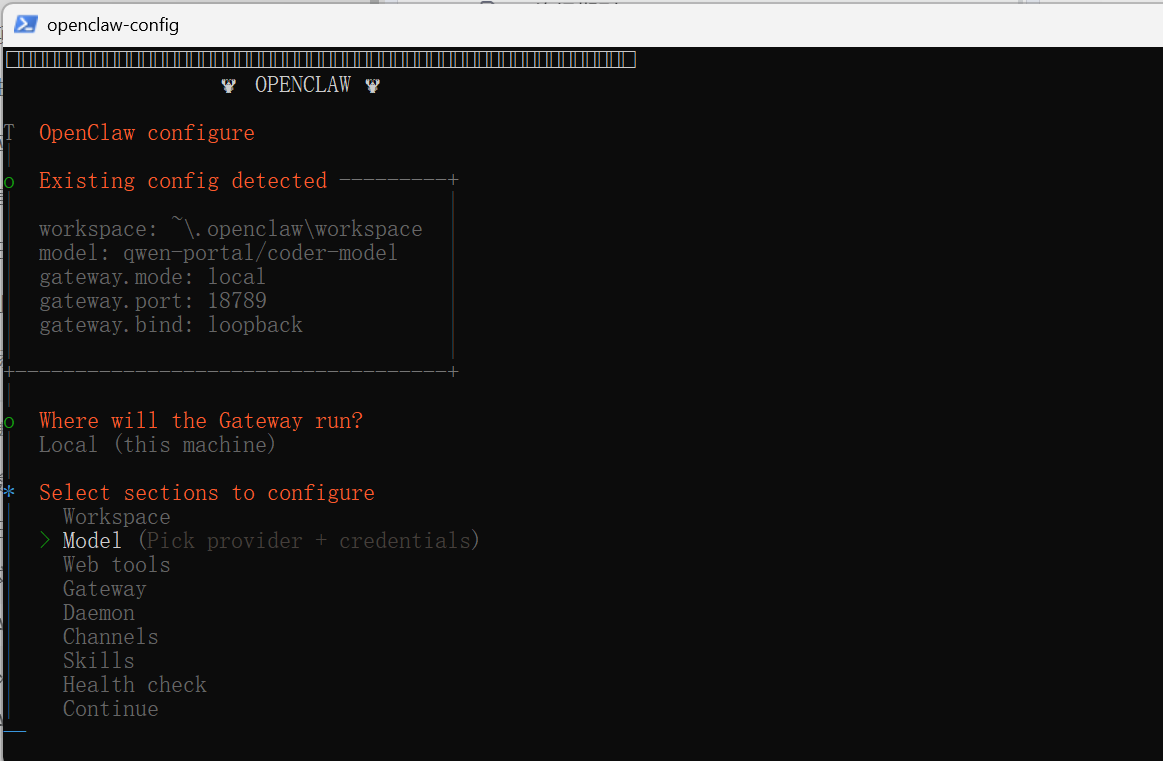

OpenClaw对接本地Ollama模型

核心是将模型提供商指向本地Ollama

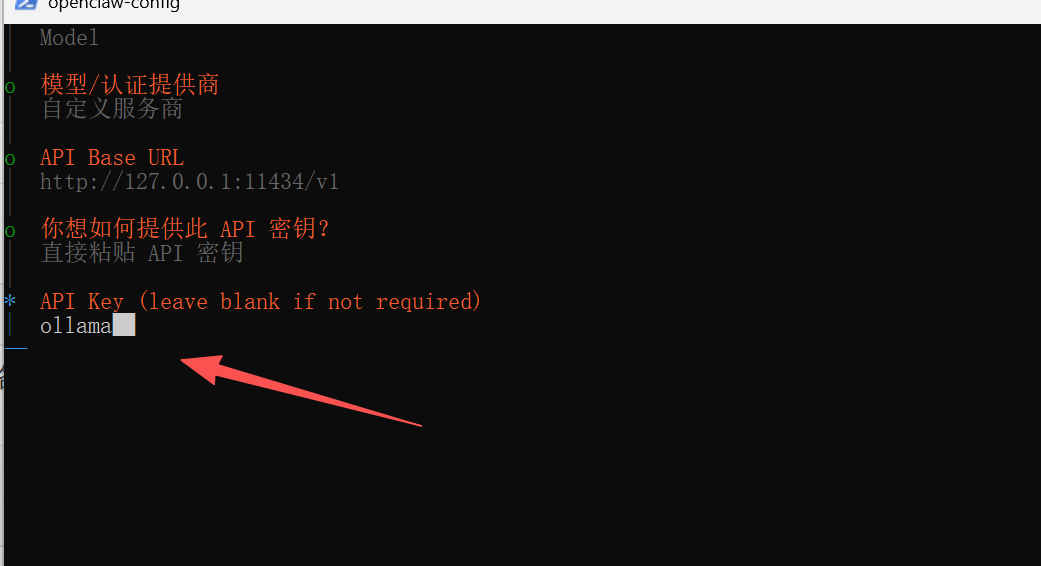

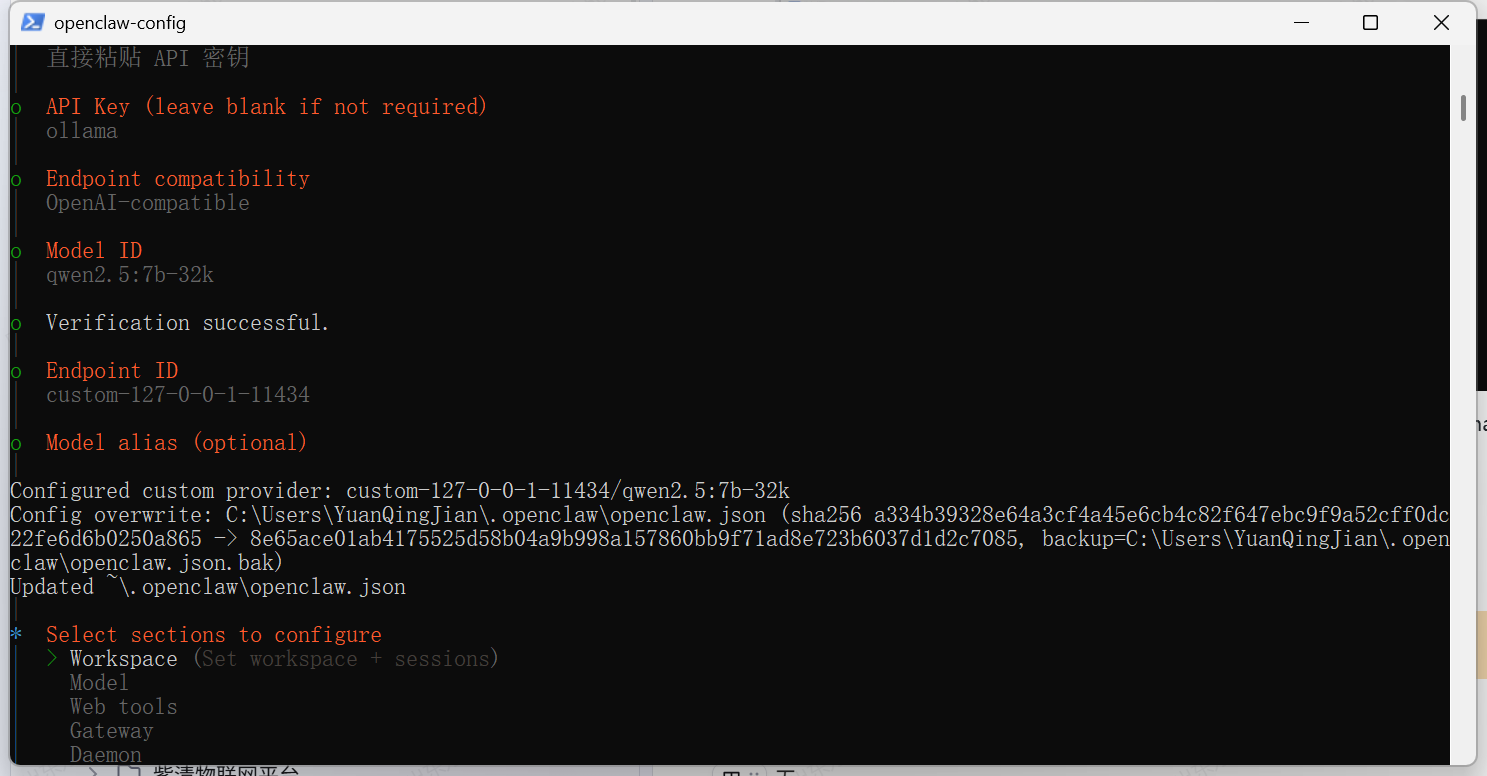

输入openclaw config 配置model模型

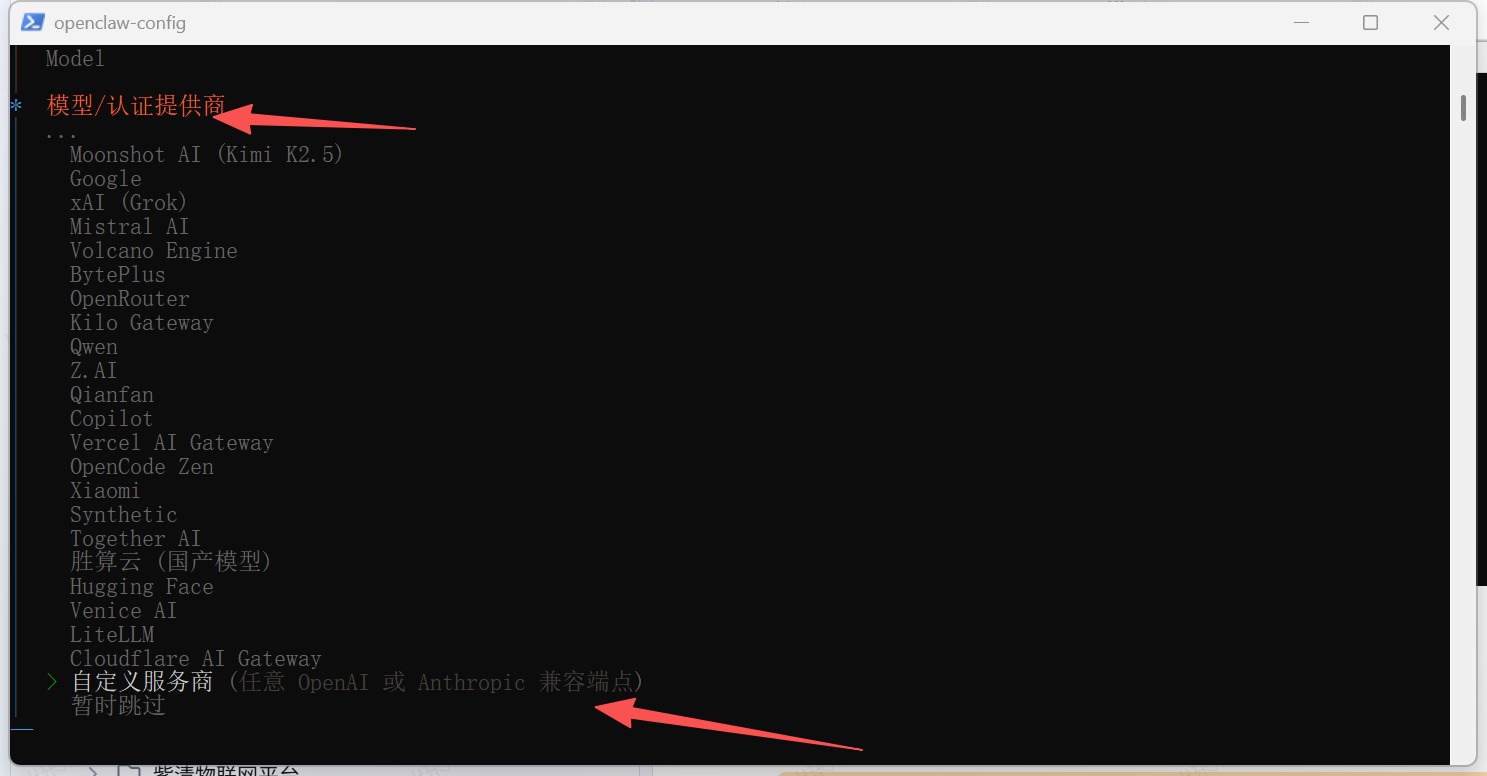

模型下拉选择自定义服务商

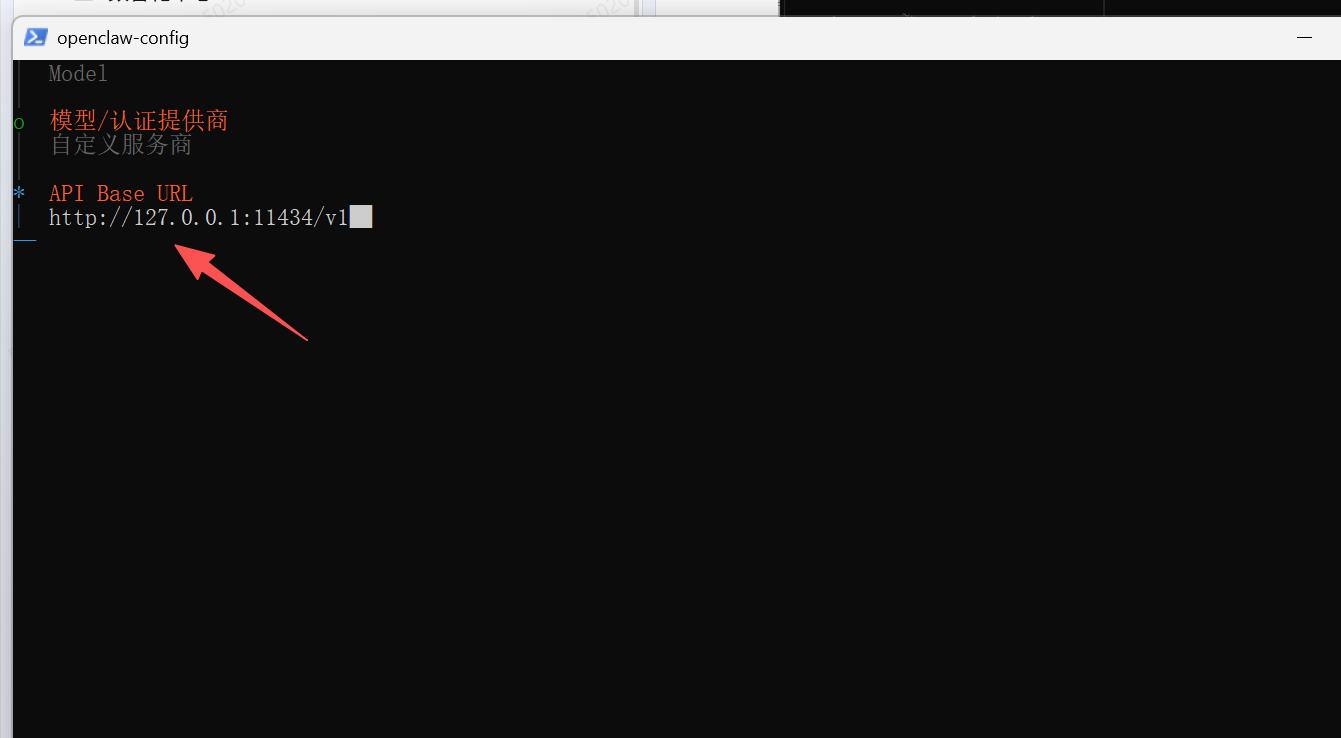

API地址:http://127.0.0.1:11434/v1

配置API Key

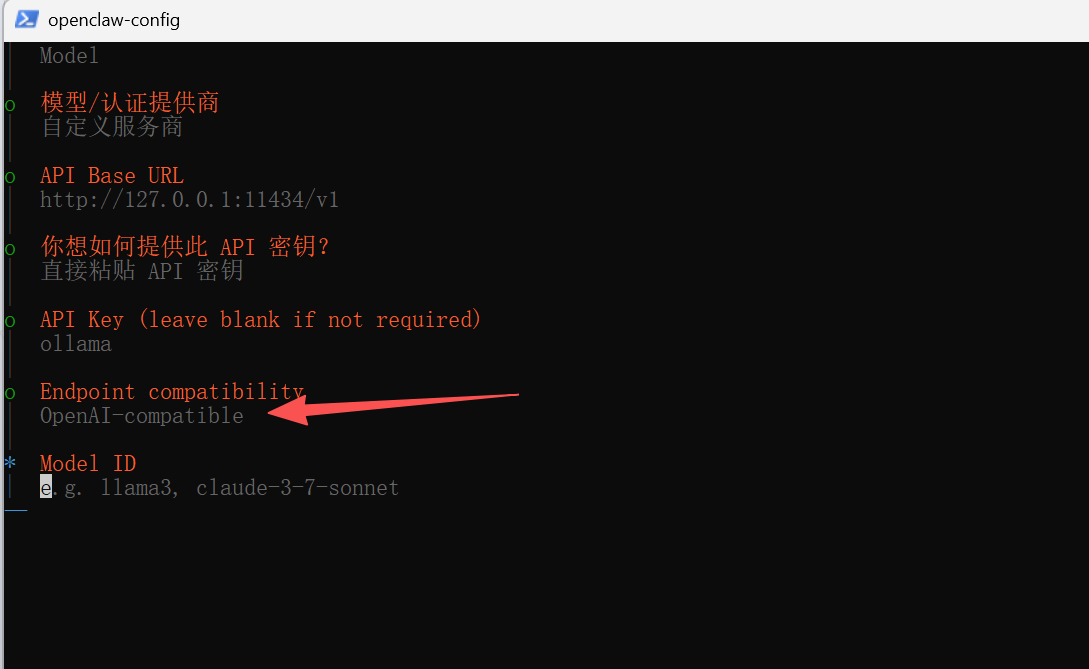

接口兼容模式,选择OpenAI兼容

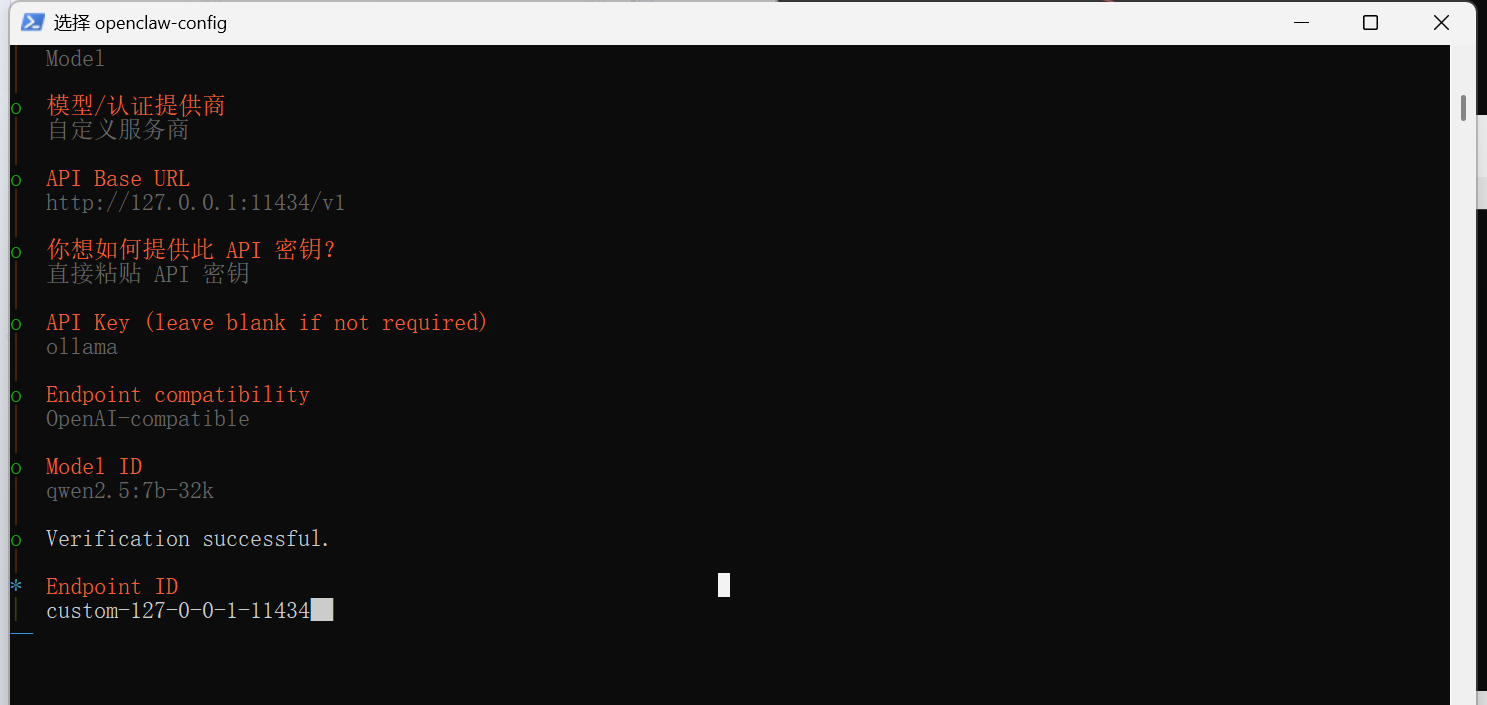

本地自定义的模型名,qwen2.5:7b-32k

配置Model ID

配置完成后,若显示Verification successful,表示OpenClaw与本地Ollama模型连接成功

OpenClaw验证指令(推荐测试,覆盖基础能力)

推荐测试以下指令,验证OpenClaw+Ollama的核心能力:

1、 自然语言对话:介绍一下苹果官网最新产品

2、代码生成:帮我写一段Python代码,实现批量重命名文件夹下的所有txt文件

3、本地文件操作:在桌面创建一个名为AI_Test的文件夹,里面新建一个README.md文件,写入内容“OpenClaw+Ollama本地智能体”

4、系统信息查询:查看当前电脑的健康状况,输出详细报告

所有指令执行完成后,可手动检查本地文件、系统信息,确认AI执行结果准确。

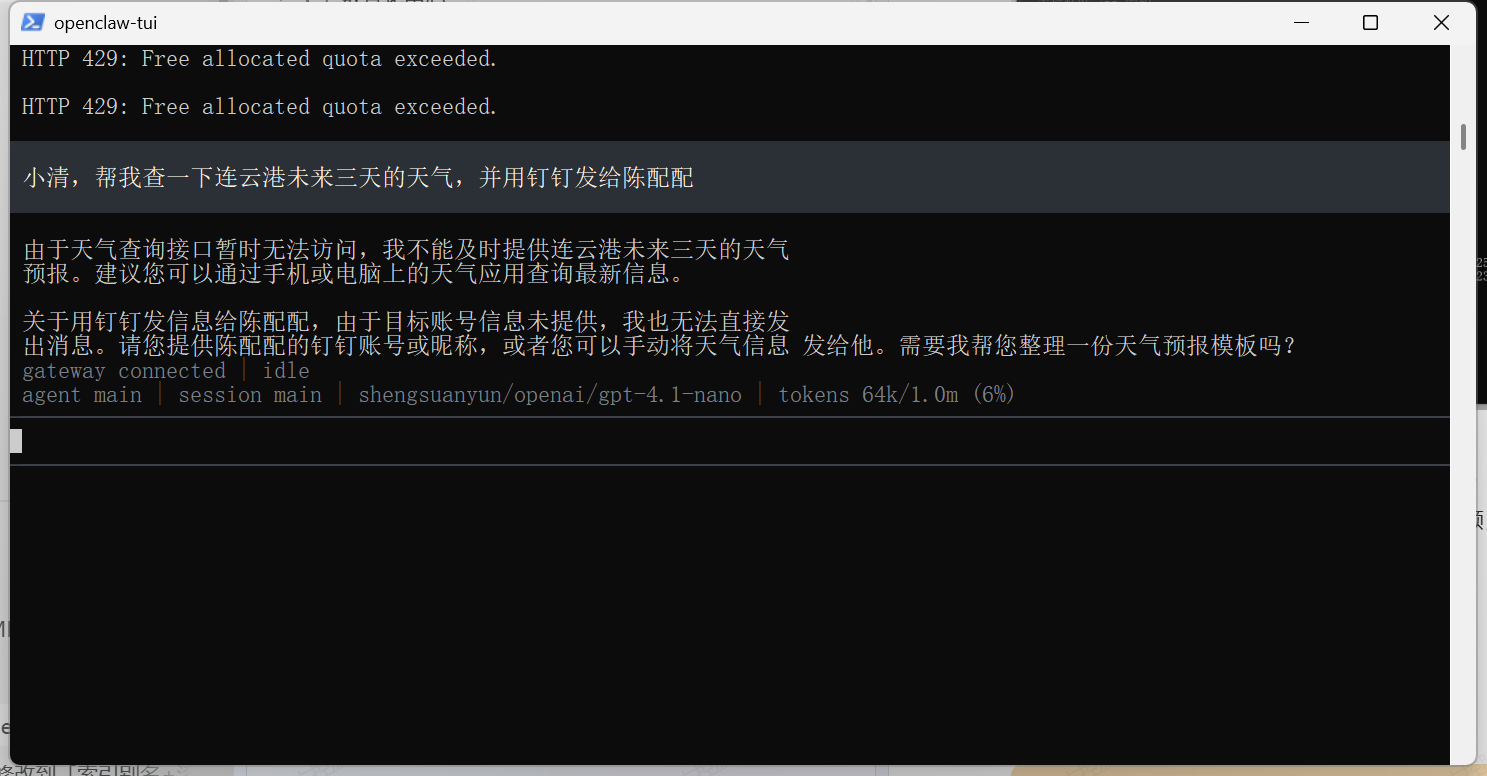

启动TUI终端交互界面(推荐,轻量、流畅)

TUI是OpenClaw的核心交互方式,轻量无界面卡顿,适合日常使用,启动命令如下:

openclaw tui

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)