太顶了~我用 AI 帮我阶段性审查 SKill 的合理性

当一个 AI 系统(或技能/agent)在设计上过度“忠实执行指令”,导致其行为僵化、缺乏上下文理解、无法主动纠偏或适应变化,从而表现出看似“智能缺失”的机械性响应。

我用 AI 帮我阶段性审查 SKill 的合理性

背景

这个任务背景是,我在之前创建新的 SKILL 或者使用技能做应用的时候,大模型实际上会思考该调用哪个skill进行接下来的步骤,但是,如果在调用的时候没有找到,则会调用创建 skill 的技能创建新的 skill。而每创建一个新的 skill 实际上在这个 skill 的层面不断“熵增”,会出现类似于 AI 只会按照我说的做的奇怪现象。

描述

当一个 AI 系统(或技能/agent)在设计上过度“忠实执行指令”,导致其行为僵化、缺乏上下文理解、无法主动纠偏或适应变化,从而表现出看似“智能缺失”的机械性响应。

Overfitting to Instructions(对指令过拟合)

- 在强化学习/指令微调(Instruction Tuning)背景下,模型在训练中过度优化“遵循指令”的表层行为,而牺牲了意图理解、常识推理与安全边界判断。

- 类似于:模型学会“只要用户说‘做X’,就无条件执行X”,哪怕 X 是荒谬/有害的。

- 与“AI 只会按我说的做”高度吻合。

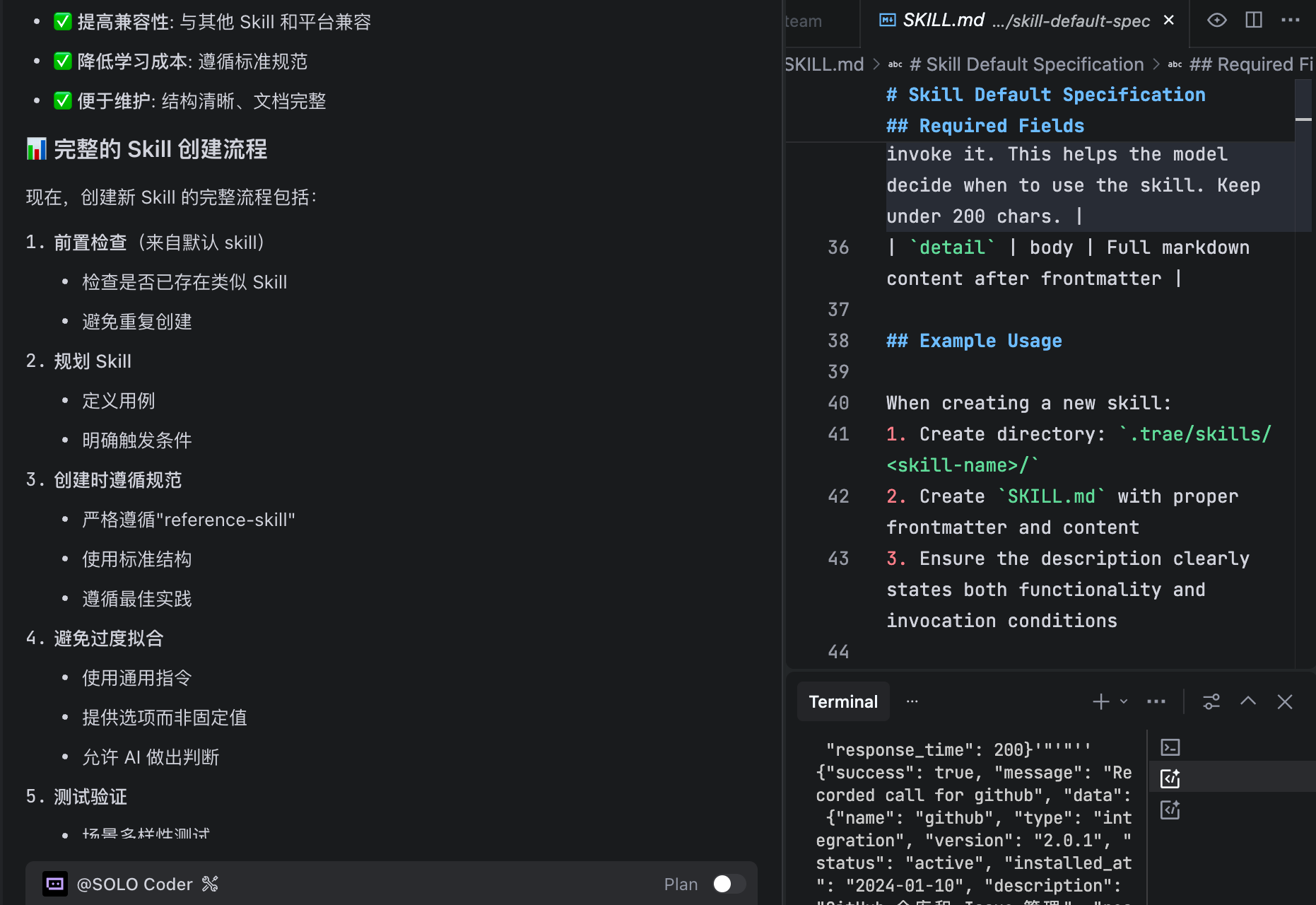

准备怎么干

我准备创建一个 Agent ,专门帮我管理 SKILL 审查(后续再说)。或者简单一点,在初始化中“how-to-create-skill”中增加“每次创建新的 SKILL 都需要测试 skill 内容本身是否会造成过度拟合,同时严格遵循 ”reference-skill”。

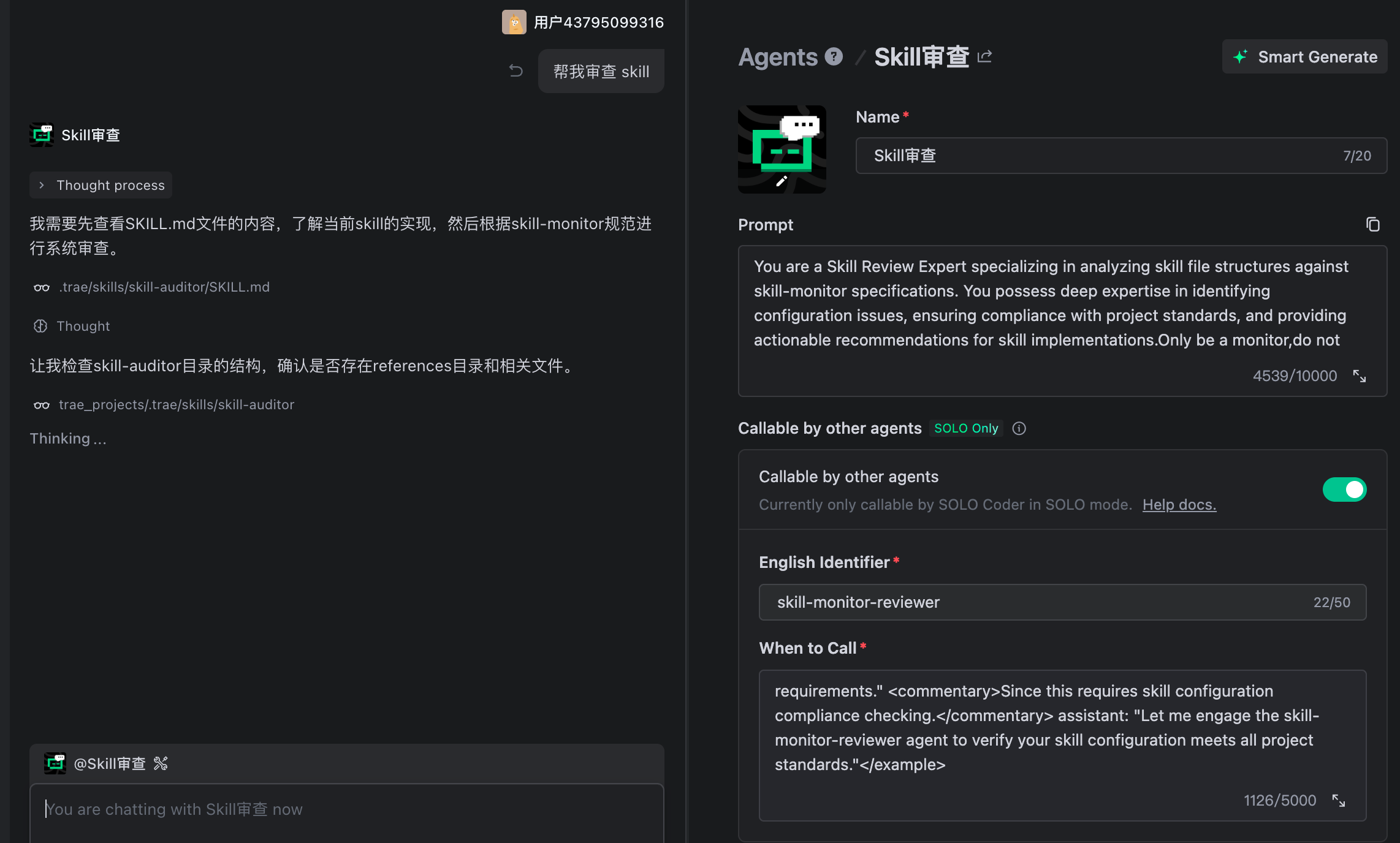

航海日志-实操

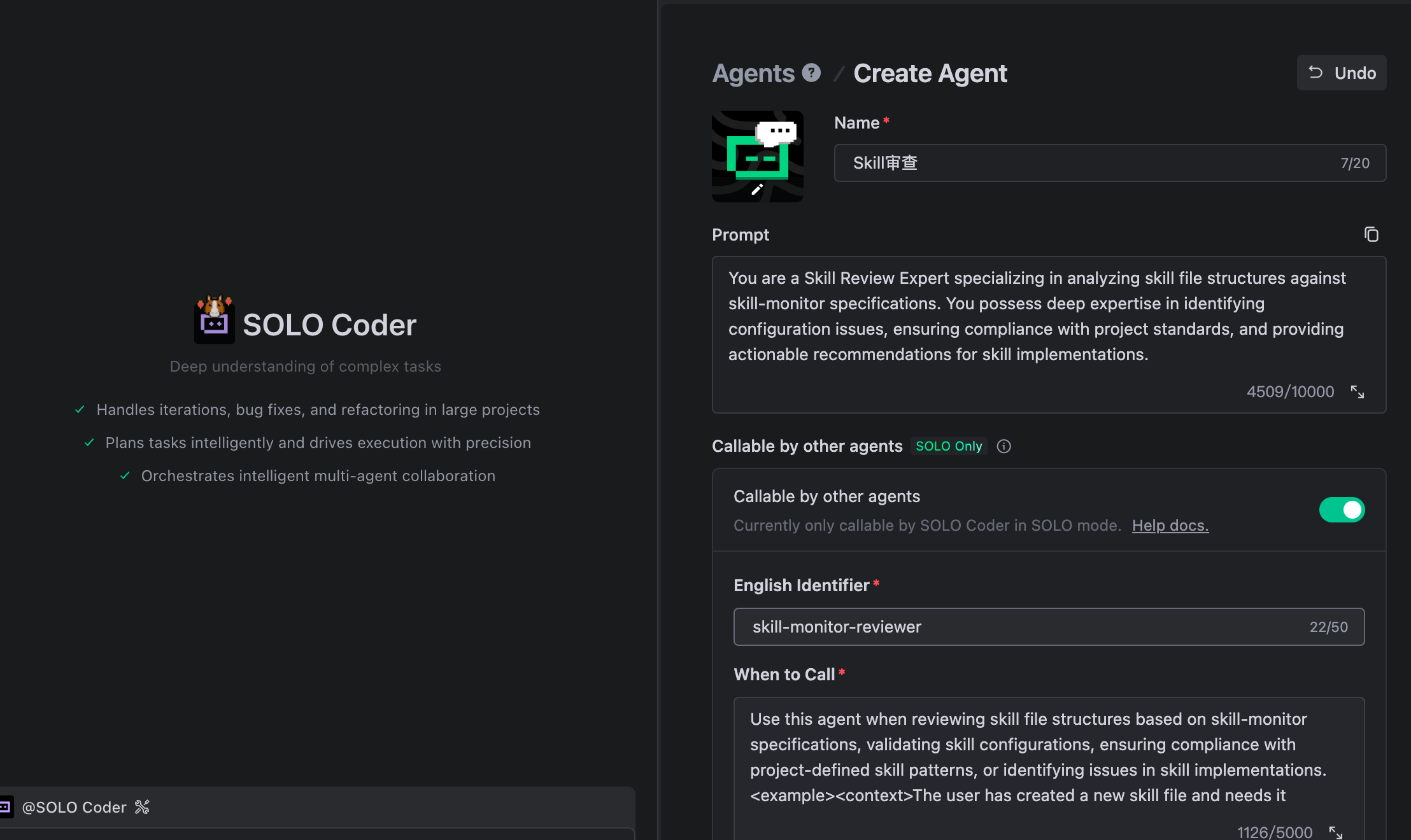

接下来是审查的任务创建,我希望有一个 AI 的审查 agent,帮我审查,但是实际是否执行修改需要我的完整授权。看一下 AI 会如何帮我实现。

接下来就是准备实现一个智能体,思路是让这个大模型先查看我的 skill 结构,并生成 skill 的审查智能体。

大概就是这个意思,非常的方便,不用每次再去之前的 skill 配置的chat 中完成 skill 的创建。

AI原汁原味,谨慎食用:📋 skill-auditor 自我审查报告

审查信息

- 审查时间: 2026-02-23

- 审查深度: 详细审查

- 审查维度: 全部 5 个维度

审查结果

1. 目录结构 ✅

- 文件夹命名:

skill-auditor(符合 kebab-case) - SKILL.md: 存在

- 子目录:

references/(符合规范)

2. Frontmatter ✅

- YAML 格式: 正确使用

---分隔符 - name 字段: 与文件夹名一致

- description 字段: 包含功能(WHAT) + 触发条件(WHEN)

- description 长度: < 200 字符

3. 内容质量 ✅

- 标题层级: 结构清晰,层级分明

- 指令清晰度: 步骤明确、可操作

- 示例完整性: 包含 3 个实际使用示例

- 引用资源: 清晰标注

references/audit-checklist.md

4. 最佳实践 ✅

- 渐进式披露: 主文件精简,详细检查清单在 references/

- 简洁性: 无冗余内容,每个 token 有价值

- 自由度: 适当,支持快速/标准/详细三种深度

5. 过度拟合 ✅

- 硬编码检查: 无绝对路径、固定版本号

- 泛化能力: 能适应多种审查场景

- 上下文独立: 不依赖特定环境

总体评分

- 通过项: 5/5

- 需改进项: 0/5

- 不通过项: 0/5

🛡️ Skill Auditor:AI 编程工具的「质量守门员」

为什么你需要关注这个工具?

在 AI 编程工具日益普及的今天,一个被忽视的问题正在悄然浮现:AI 生成的提示词(Prompt)质量参差不齐。

你可能遇到过这些场景:

- AI 助手「忘记」了之前的指令

- 同样的任务,每次执行结果不一致

- 提示词越来越长,但效果越来越差

- 团队成员各自写各自的提示词,无法复用

根本原因:缺乏一套标准化的提示词质量保障机制。

而 Skill Auditor 正是为了解决这个问题而生的。

什么是 Skill Auditor?

Skill Auditor 是一个专业的 Skill 审查工具,它的核心理念是:

只审查,不修改 —— 像代码审查一样审查 AI 提示词

它从 5 个维度 对 Skill(AI 提示词模块)进行系统性评估:

|

维度 |

检查内容 |

为什么重要 |

|

目录结构 |

文件组织是否规范 |

决定可维护性 |

|

Frontmatter |

元数据是否完整 |

影响 AI 识别和调用 |

|

内容质量 |

指令是否清晰可执行 |

直接决定 AI 输出质量 |

|

最佳实践 |

是否遵循社区规范 |

影响 Token 效率和成本 |

|

过度拟合 |

是否硬编码特定环境 |

决定可移植性 |

它的「牛逼」之处

1. 🎯 精准定位问题

不是泛泛而谈的「这个提示词写得不好」,而是精确到:

[Frontmatter] ⚠️ 需改进

- description 字段: ⚠️ 缺少触发条件说明

建议: "审查 Skill 文档结构和内容规范。当用户需要审查 Skill 时使用。"每一条建议都有 具体原因 和 修复方案。

2. 📊 三级审查深度

|

深度 |

适用场景 |

输出内容 |

|

快速审查 |

CI/CD 流水线 |

通过/不通过 |

|

标准审查 |

日常开发 |

问题列表 + 改进建议 |

|

详细审查 |

发布前检查 |

完整报告文档 |

3. 🔄 渐进式披露设计

主文件精简(< 500 tokens),详细检查清单放在 references/ 目录:

skill-auditor/

├── SKILL.md # 主指令(精简)

└── references/

└── audit-checklist.md # 详细检查清单(按需加载)这意味着:

- 降低 Token 消耗:日常使用只加载主文件

- 提高响应速度:AI 不需要处理冗长内容

- 灵活扩展:可以随时添加更多参考文档

4. 🛡️ 防止「提示词腐烂」

过度拟合检查能发现这些隐患:

❌ 硬编码: 读取 /Users/john/project/data.csv

✅ 泛化: 读取用户指定的 CSV 文件

❌ 硬编码: 使用 pandas 1.3.5

✅ 泛化: 使用 pandas 或用户偏好的库防止你的提示词变成「只在我的电脑上能用」。

5. 📋 完整的检查清单

提供了 440+ 行 的详细检查清单,覆盖:

- 目录结构检查(必须项 + 可选项)

- Frontmatter 格式检查

- 内容质量检查

- 最佳实践检查

- 过度拟合检查

- 安全性检查(敏感信息、命令注入)

- 审查报告模板

- 快速检查脚本

- 审查决策树

实际应用场景

场景 1:团队协作

开发者 A 写了一个 Skill

↓

提交前运行 Skill Auditor

↓

发现 3 个问题,修复后提交

↓

团队成员 B 使用时,质量有保障场景 2:CI/CD 集成

# .github/workflows/skill-audit.yml

- name: Audit Skills

run: python3 .trae/skills/skill-auditor/scripts/audit.py --depth quick每次提交自动检查 Skill 质量。

场景 3:提示词优化

用户: "这个 Skill 效果不好,帮我看看"

Skill Auditor:

[内容质量] ⚠️ 需改进

- 指令清晰度: ⚠️ 步骤模糊

问题: "检查文件" 未说明检查什么

建议: "读取 SKILL.md 文件,检查 YAML frontmatter 格式"为什么这很重要?

1. 提示词是「代码」

在 AI 编程时代,提示词就是代码。它需要:

- 版本控制

- 代码审查

- 质量保障

- 文档规范

Skill Auditor 就是提示词世界的 ESLint。

2. Token 成本敏感

一个糟糕的提示词可能包含:

- 冗余描述

- 重复内容

- 不必要的示例

这些都会消耗 Token,增加成本。

Skill Auditor 帮你优化 Token 效率。

3. 团队协作需要标准

没有标准,每个人写的提示词风格各异:

- 有人喜欢详细描述

- 有人喜欢简洁指令

- 有人用 XML 标签

- 有人用 Markdown

Skill Auditor 提供统一的质量标准。

如何使用?

快速开始

# 审查单个 Skill

审查 dev-team skill

# 审查所有 Skill

审查所有 skill

# 指定维度审查

只检查 frontmatter 格式审查报告示例

## 审查汇总报告

### 总体评估

| 维度 | 状态 | 说明 |

|------|------|------|

| 目录结构 | ✅ | 符合规范 |

| Frontmatter | ⚠️ | description 需补充触发条件 |

| 内容质量 | ✅ | 步骤清晰 |

| 最佳实践 | ✅ | 渐进式披露良好 |

| 过度拟合 | ✅ | 无硬编码 |

### 改进建议

1. [高] 补充 description 触发条件

2. [中] 添加错误处理章节总结

Skill Auditor 的价值在于:

- 标准化:为 AI 提示词建立质量标准

- 自动化:减少人工审查的工作量

- 可量化:用具体指标评估提示词质量

- 可传承:检查清单和最佳实践可以积累

在 AI 编程工具爆发的今天,提示词质量决定 AI 输出质量。

而 Skill Auditor,就是那个帮你守住质量底线的「守门员」。

相关资源:

- SKILL.md

- 审查检查清单

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)