OpemClaw本地部署

windows(wsl2)下的OpenClaw安装配置+飞书应用

OpenClaw + 飞书安装配置全过程记录 (windows+wsl2)

基于 Windows 10/11 + WSL2 (Ubuntu) 环境,详细记录从 WSL 安装到 OpenClaw 部署及飞书机器人集成的全过程。

第一阶段:WSL2 环境搭建 (Windows 端)

1. 启用 WSL 功能

以管理员身份打开 PowerShell 或 CMD,执行以下命令:

# 启用 WSL 功能

dism.exe /online /enable-feature /featurename:Microsoft-Windows-Subsystem-Linux /all /norestart

# 启用虚拟机平台功能 (WSL2 必需)

dism.exe /online /enable-feature /featurename:VirtualMachinePlatform /all /norestart

执行完成后,重启电脑后生效。

2. 设置 WSL 默认版本为 2

重启后,再次以管理员身份打开 PowerShell:

wsl --set-default-version 2

3. 安装 Linux 发行版

推荐安装 Ubuntu 22.04 LTS 或 Ubuntu 24.04 LTS:

# 查看可用发行版

wsl --list --online

# 安装 Ubuntu 22.04 (根据列表中的 NAME 列调整)

wsl --install -d Ubuntu-22.04

安装完成后会自动启动,需设置 Linux 用户名和密码。接下来的命令无另外说明,都将在 wsl 终端下进行。

4. 安装 curl 工具

sudo apt-get update && sudo apt-get install -y curl

5. 安装 NodeJs

首先需要输入fs命令升级软件源列表:

curl -fsSL https://deb.nodesource.com/setup_22.x | sudo -E bash -

然后使用apt-get install命令进行安装:

sudo apt-get install -y nodejs

等待安装完成后即可输入node -v 查看安装版本,显示大于22.0 版本即说明安装成功:

node -v

第二阶段:OpenClaw 安装及配置

1. 运行官方安装脚本

curl -fsSL https://molt.bot/install.sh | bash

如果长时间卡在 Installing OpenClaw... 这里,考虑 npm 切换国内镜像源后重试。

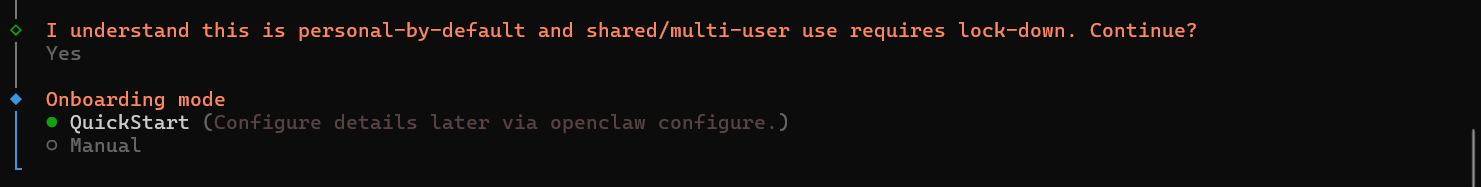

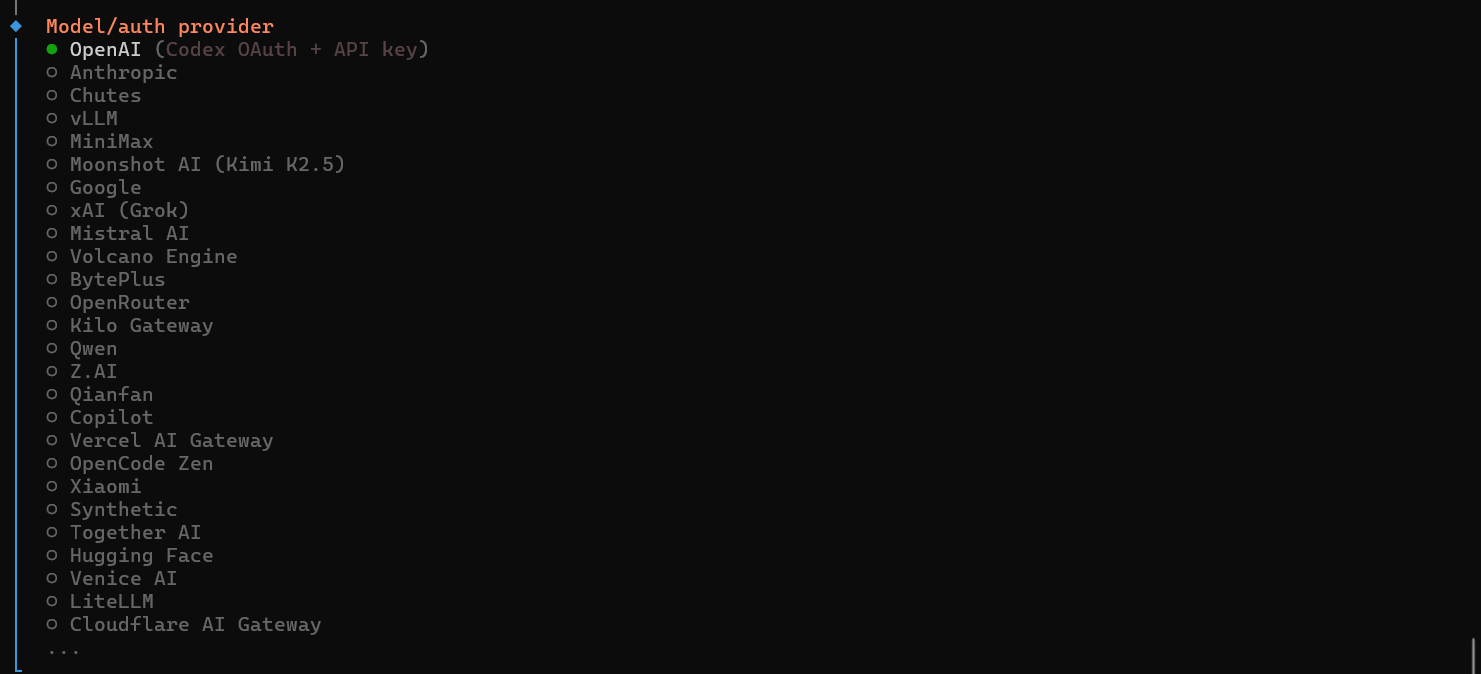

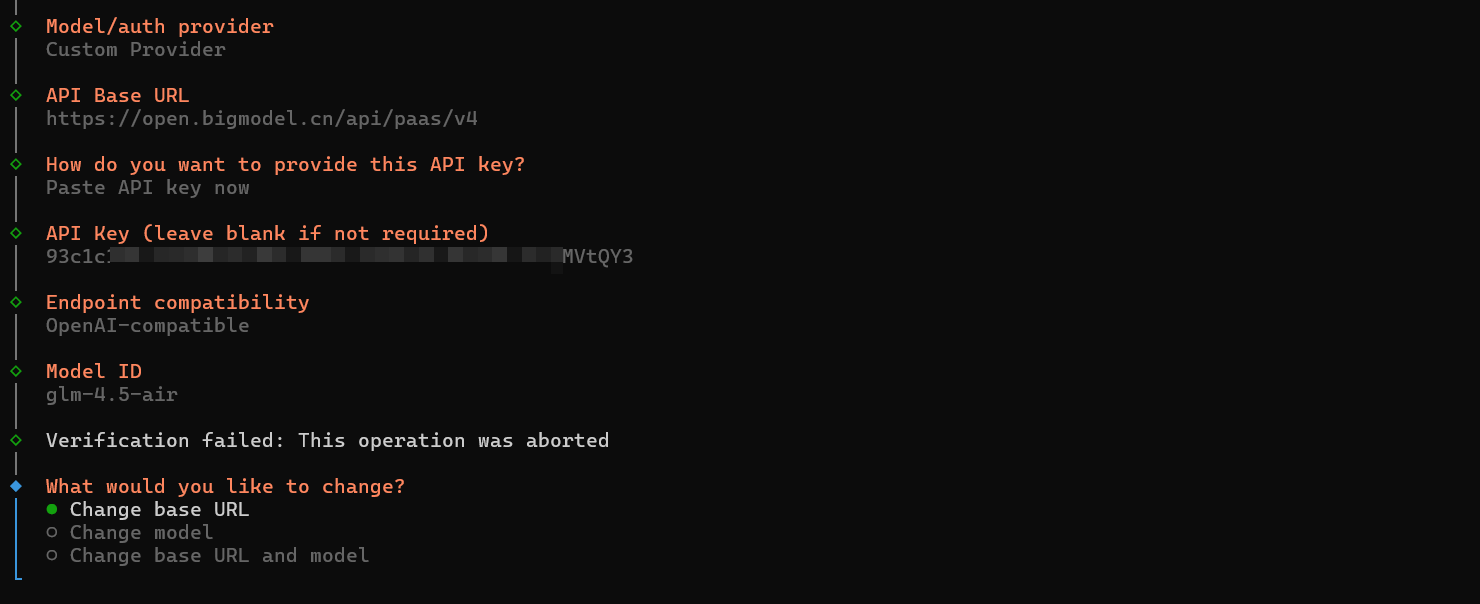

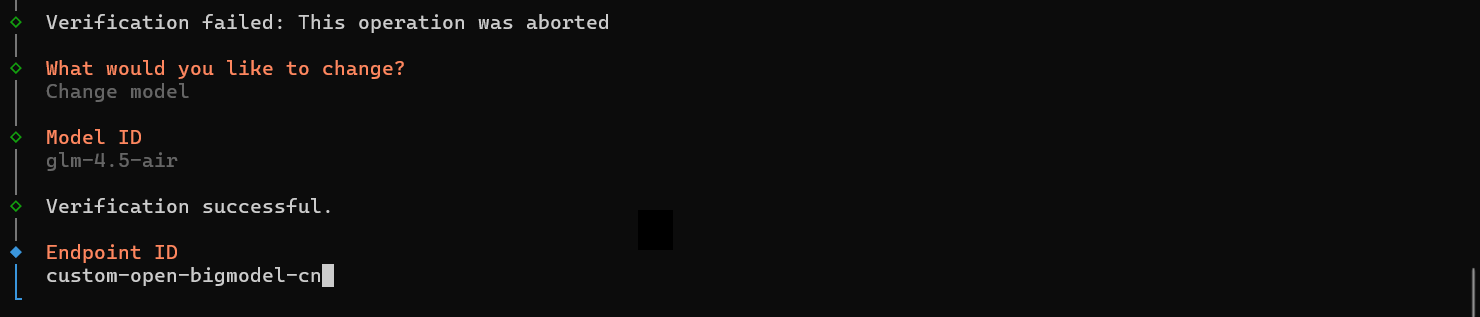

2. 跟据官方引导配置

大模型验证失败则需要检查想要调用的大模型的 API Base URL、API key、Model ID 是否正确,或者网络是否存在异常,验证成功后会显示Verification successful

第三阶段:飞书应用配置与集成

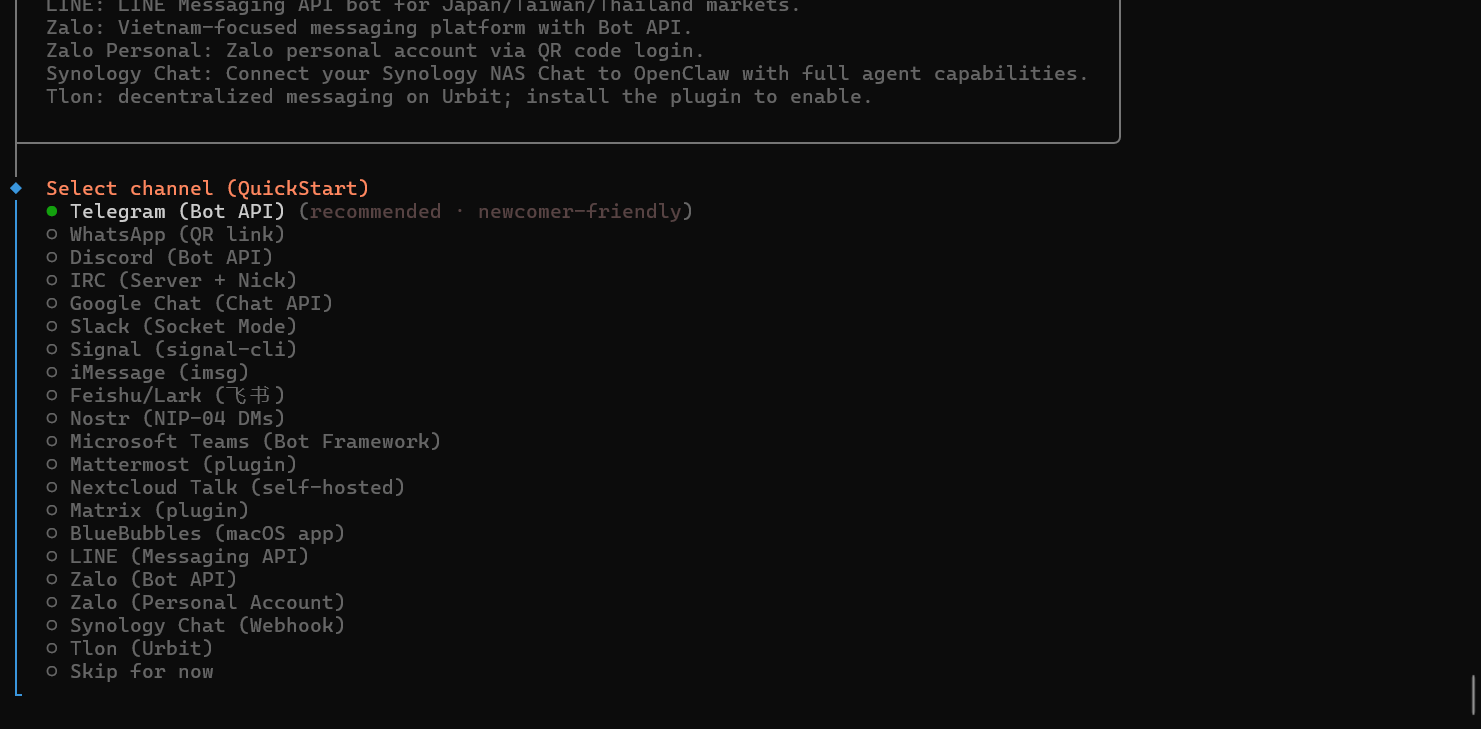

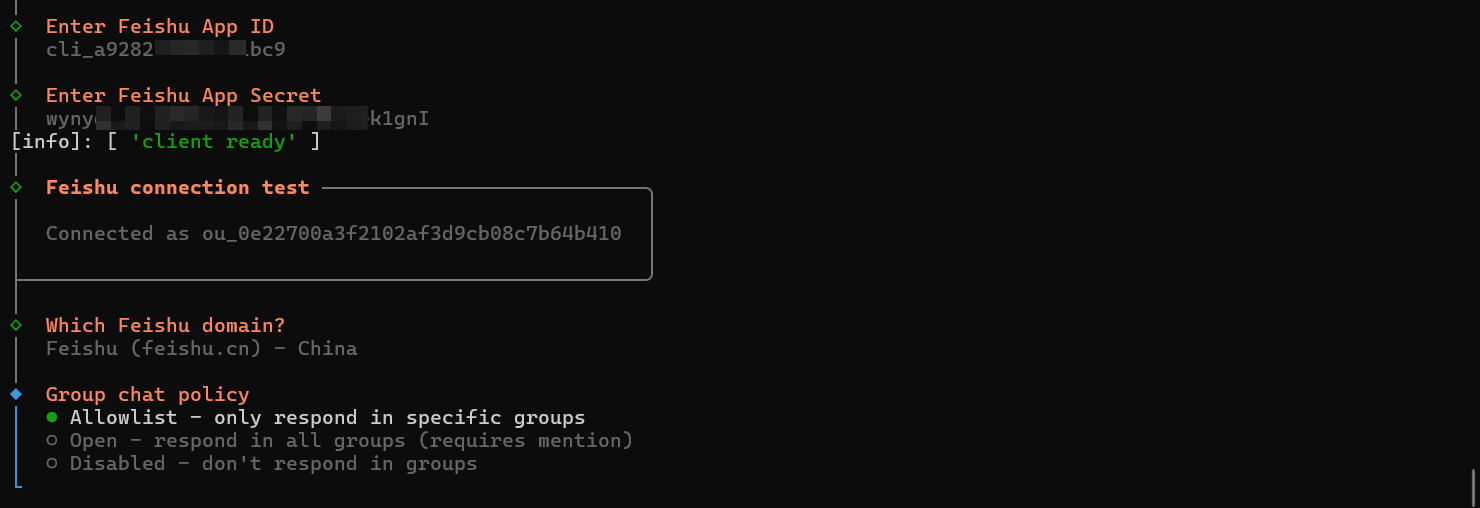

第二阶段大模型相关配置完成后,会进入**消息平台(channel)**的配置引导,如下图所示。本文选择飞书,在继续引导流程开始之前,先在 飞书开放平台 (open.feishu.cn) 完成一些必要工作。

1. 创建企业自建应用

-

登录 飞书开放平台。

-

进入「企业管理后台」 -> 「应用开发」 -> 「自建应用」 -> 「创建应用」。

-

填写应用名称(如:OpenClaw AI)、图标等基本信息。

-

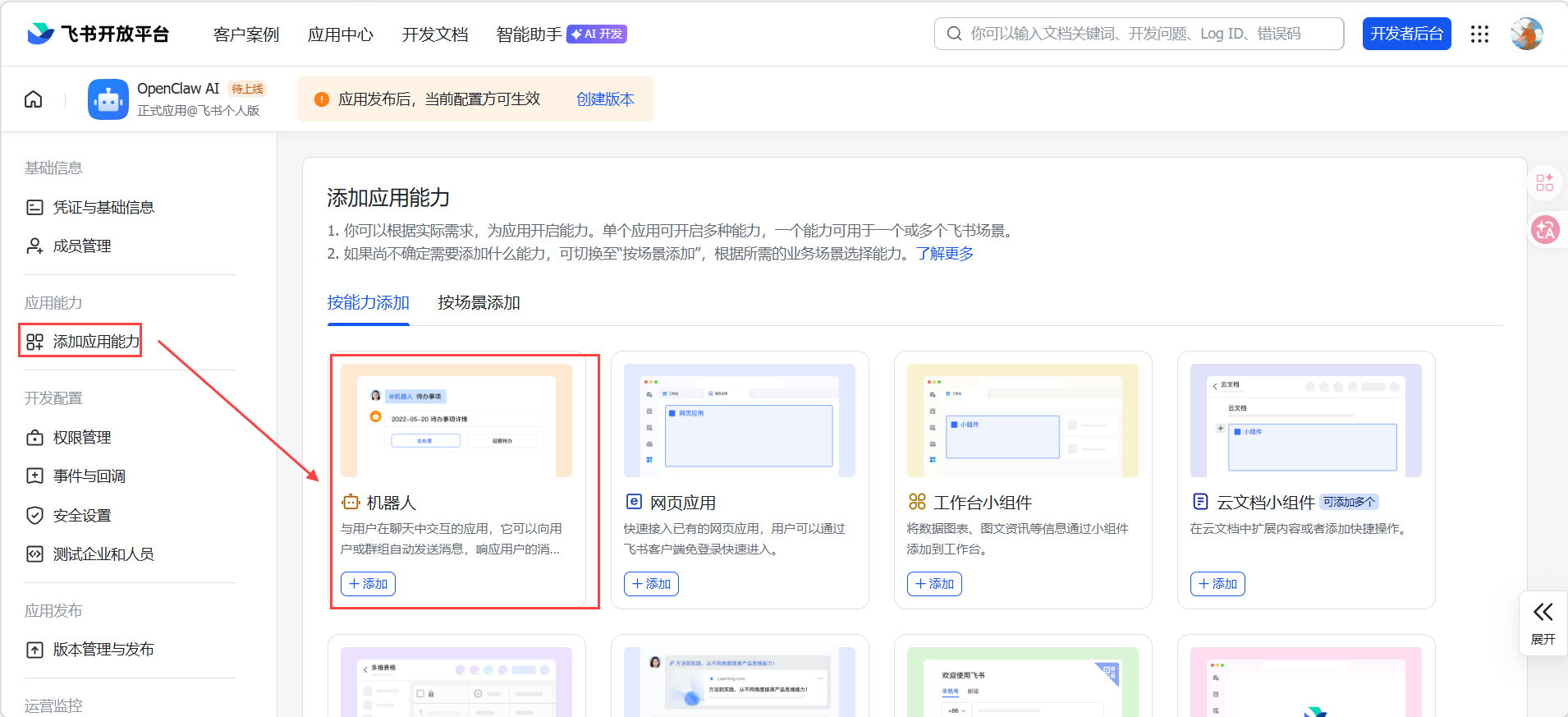

添加应用能力

-

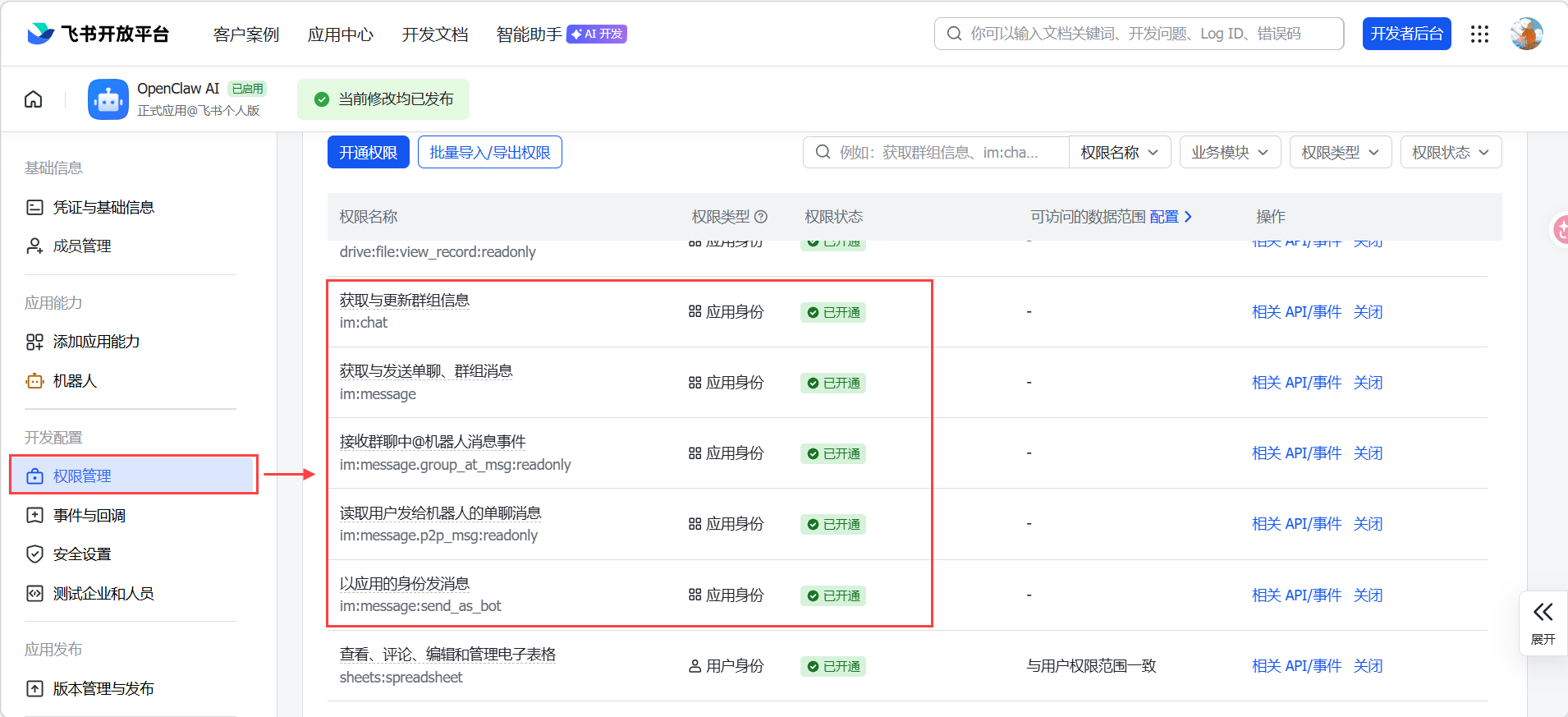

添加权限:下图红框中为必须添加的权限,其余权限根据需要添加

-

事件配置:订阅方式为“长连接”,添加事件“接受消息”

-

配置完成后,创建版本并发布应用后应用生效

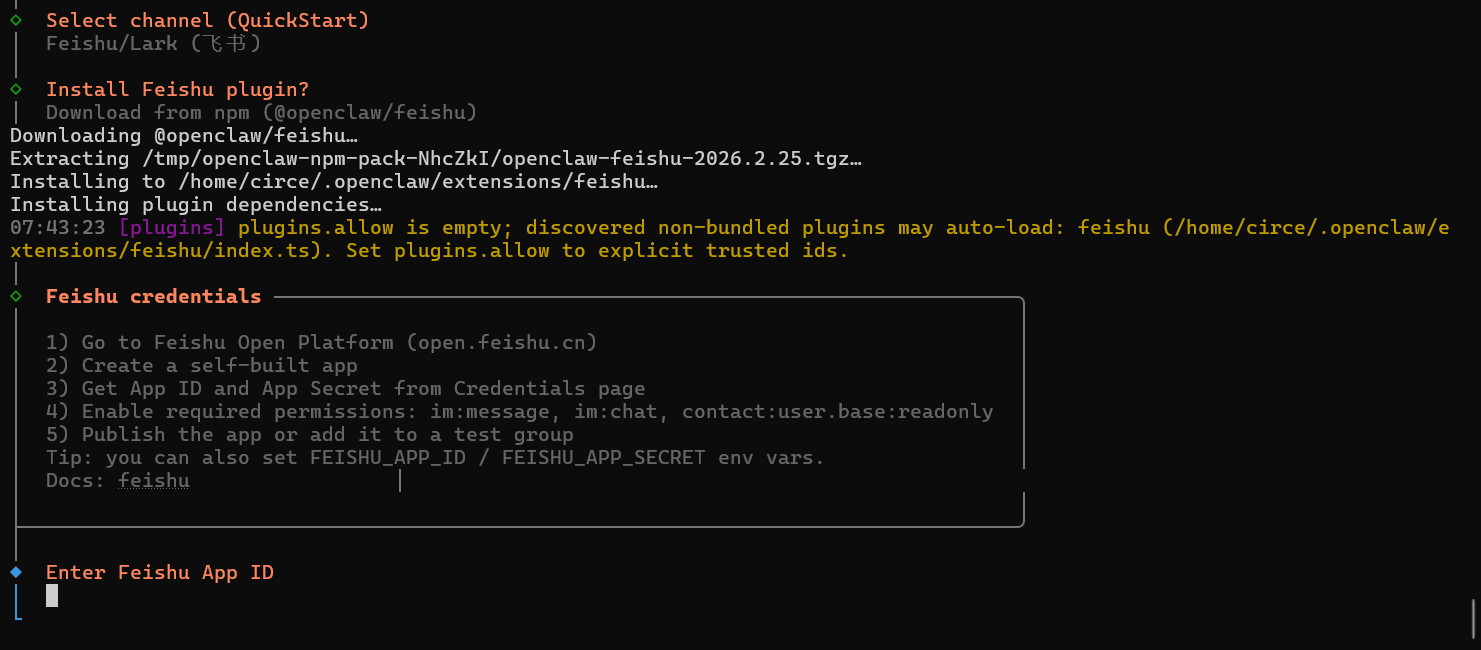

2. 继续官方引导配置

回到第二阶段完成状态的 PowerShell 或 CMD,跟着官方引导配置继续。

要填的 App ID 和 App Secret 从飞书开放平台查看。

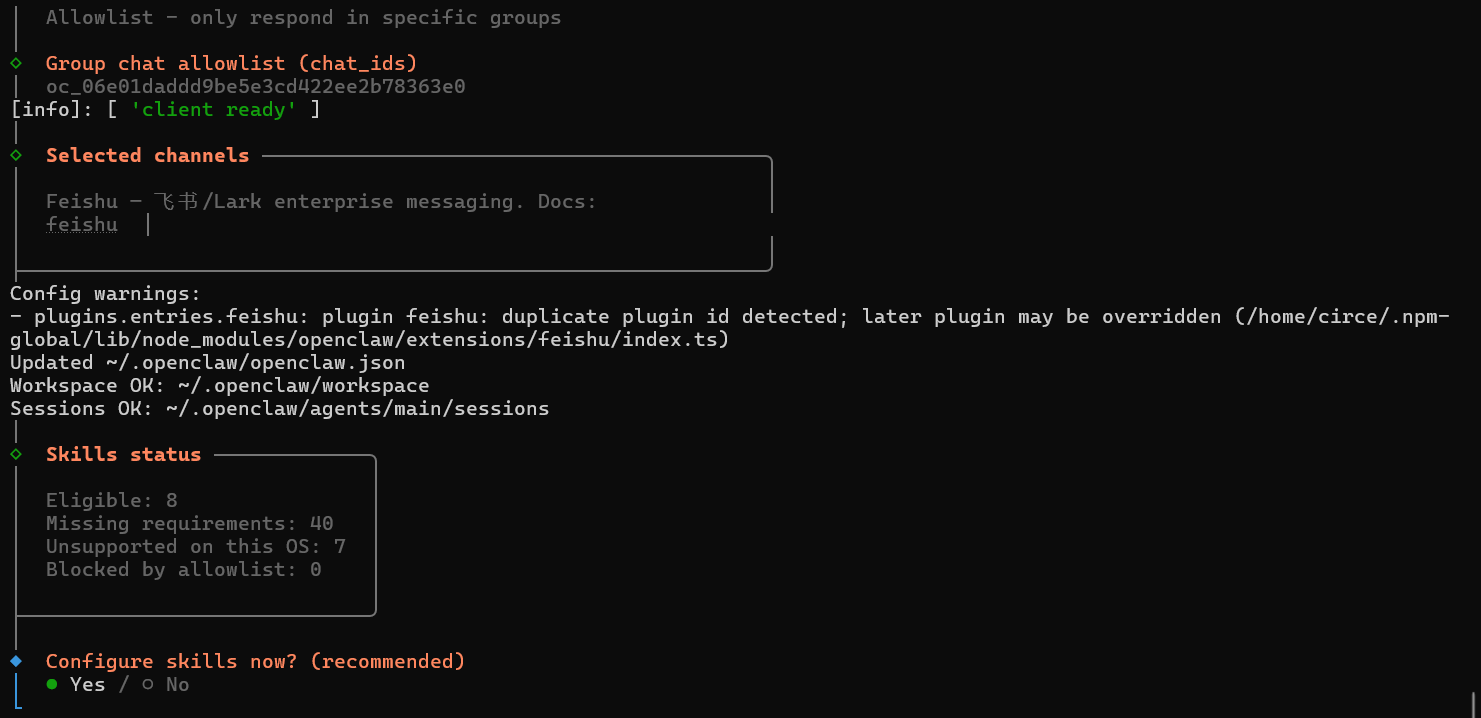

选择群聊策略:这里选择第一个选项“只在你指定的群组中回复”,则在下一步中需填写允许的飞书群聊id(在飞书应用里打开群聊可找到)。

配置需要的 skill:根据需要来,如果没有需要额外添加的直接跳过。

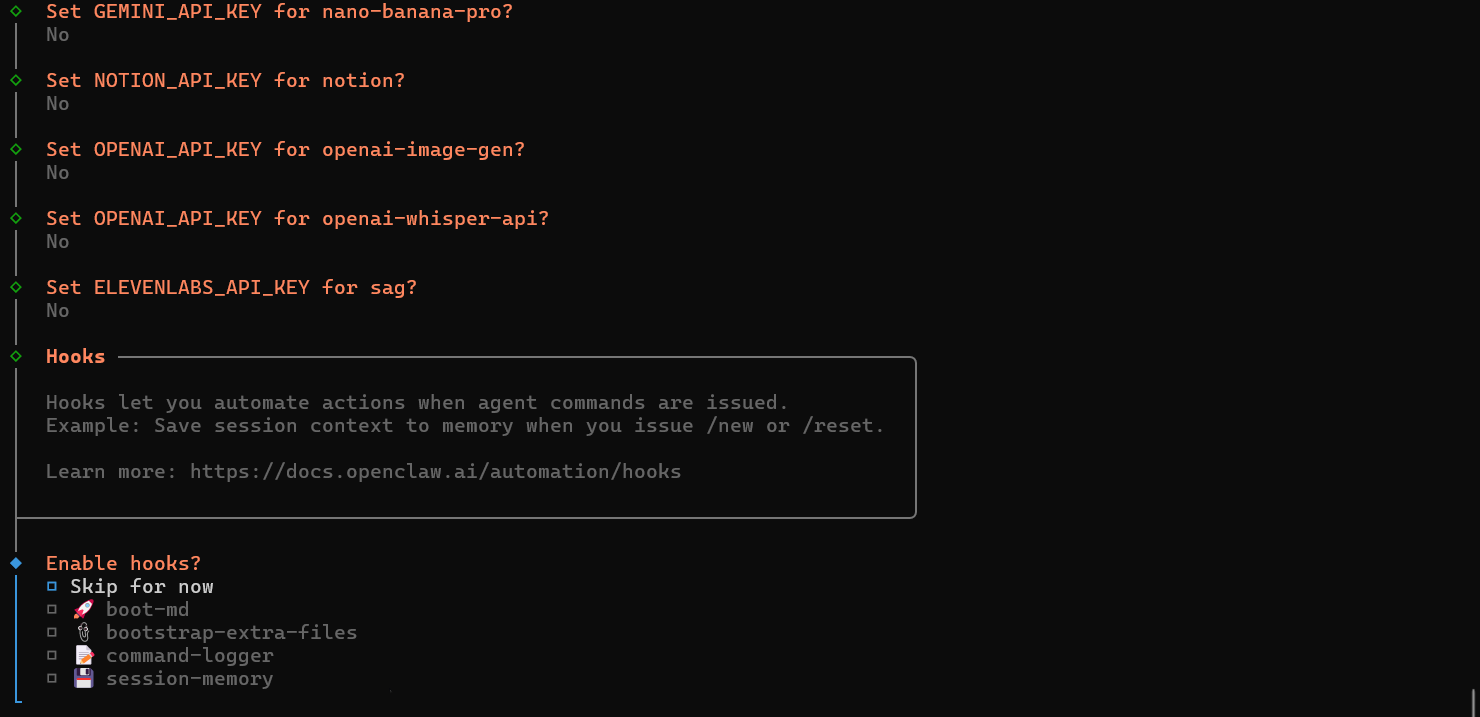

接下来是多个外部服务的 API Key 设置,没有就全部 No 跳过。

配置钩子:参考下表根据需要选择。

| Hook | 作用 | 是否推荐 |

|---|---|---|

boot-md |

启动时加载 Markdown 文件作为知识库 | 可选 |

bootstrap-extra-files |

加载额外文件(如配置、模板) | 可选 |

command-logger |

记录所有命令到日志 | 推荐,方便调试 |

session-memory |

自动保存会话历史 | 推荐,防止丢失对话 |

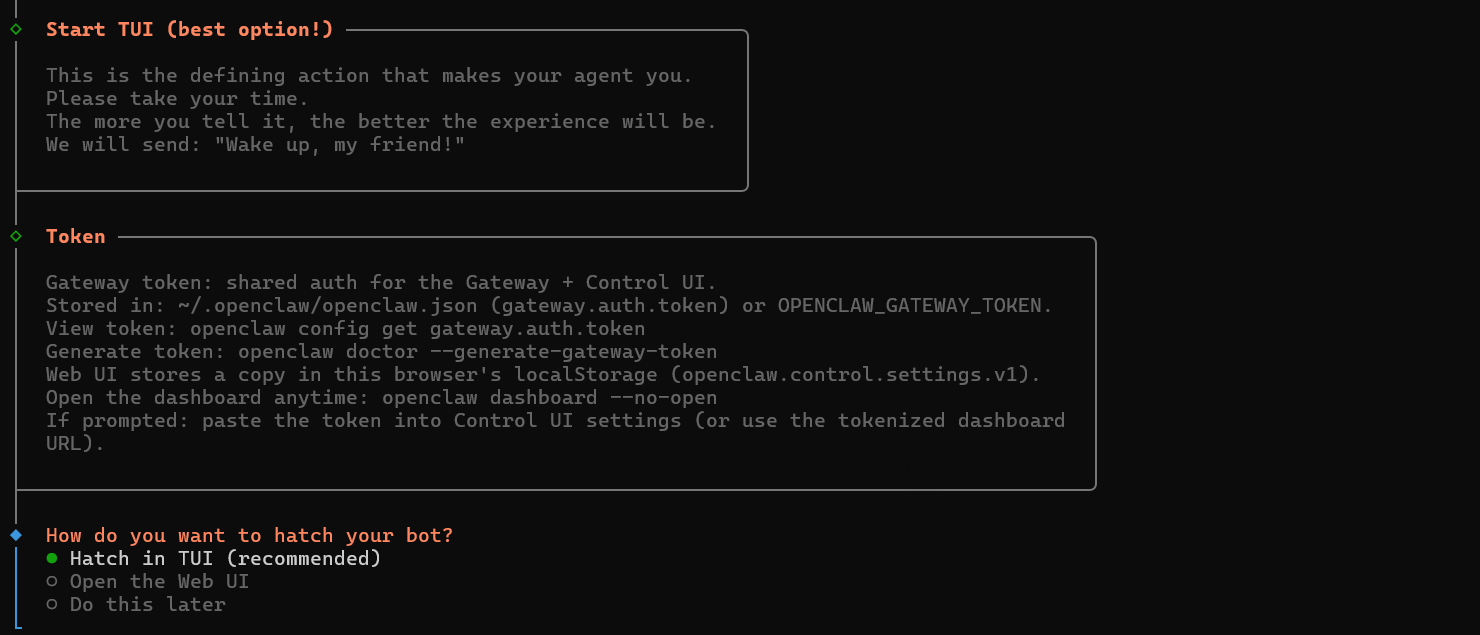

至此,配置流程全部完成。这里给出了两种启动方式,选择推荐的第一个在终端文本界面中启动,测试一下是否能够正常调用大模型进行会话聊天。

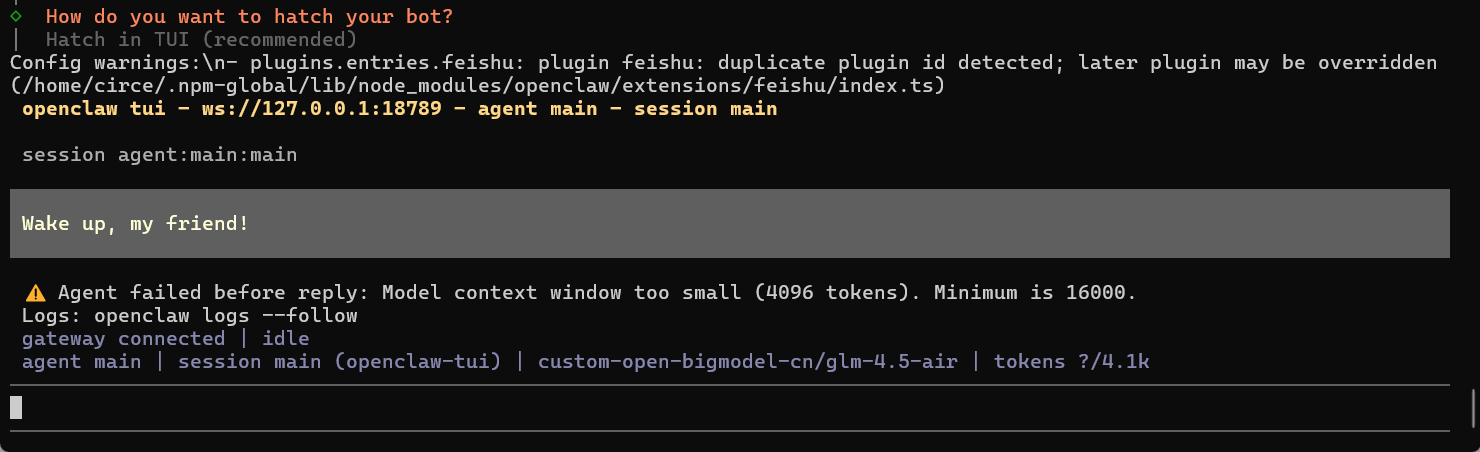

3. 上下文窗口大小问题解决

问题:我使用的模型(glm-4.5-air)要求最小支持 16000 token 的上下文,但当前配置只允许 4096 token。

解决:

- 另外打开一个终端窗口

wsl

确保提示符是类似:

user@DESKTOP-XXX:~$

这表示已在 WSL 的 Linux 环境中

- 编辑配置文件

vim ~/.openclaw/openclaw.json

- 找到并修改模型参数:找到

"models"部分,找到模型(通常是custom-open-bigmodel-cn),修改配置项如下:

"context_window": 16384,

"max_tokens": 8192

-

保存并退出:按

Ctrl + O(写入文件),按Enter确认文件名(不要改名字!),按Ctrl + X退出编辑器,此时已回到命令行 -

回到之前的已启动窗口,已经可以正常与大模型聊天。

第四阶段:验证三种使用方式

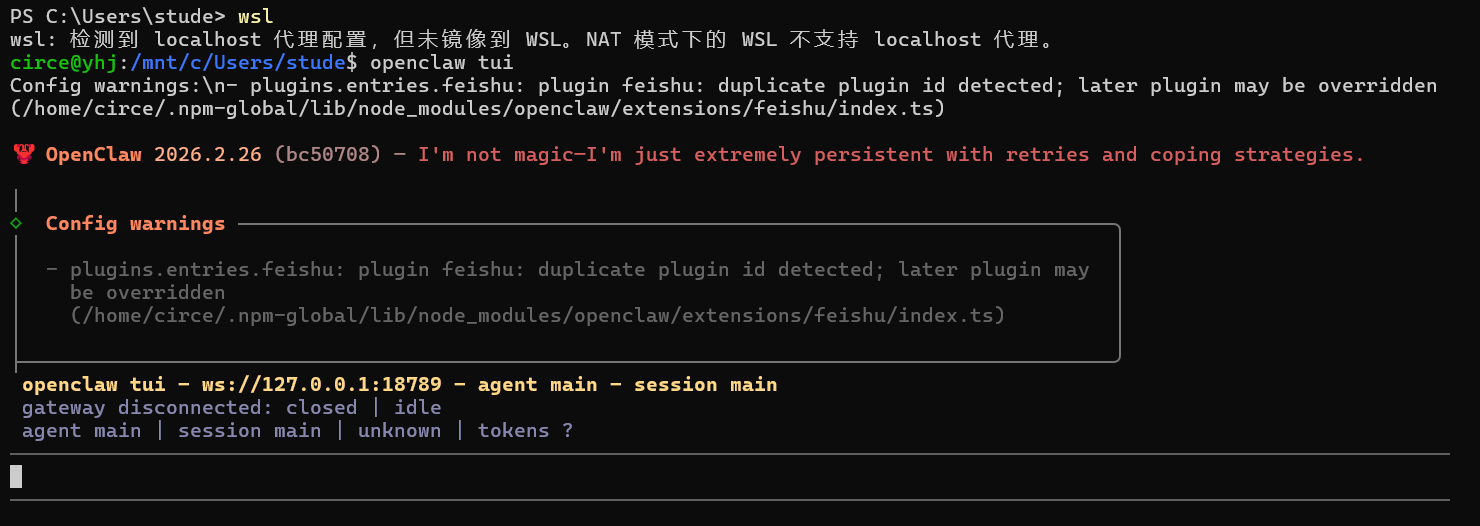

方式一:TUI

第三阶段安装配置完成后已测试使用过,再次进入直接在 wsl 环境下输入以下命令即可:

openclaw tui

按两次 ctrl+c 可退出。

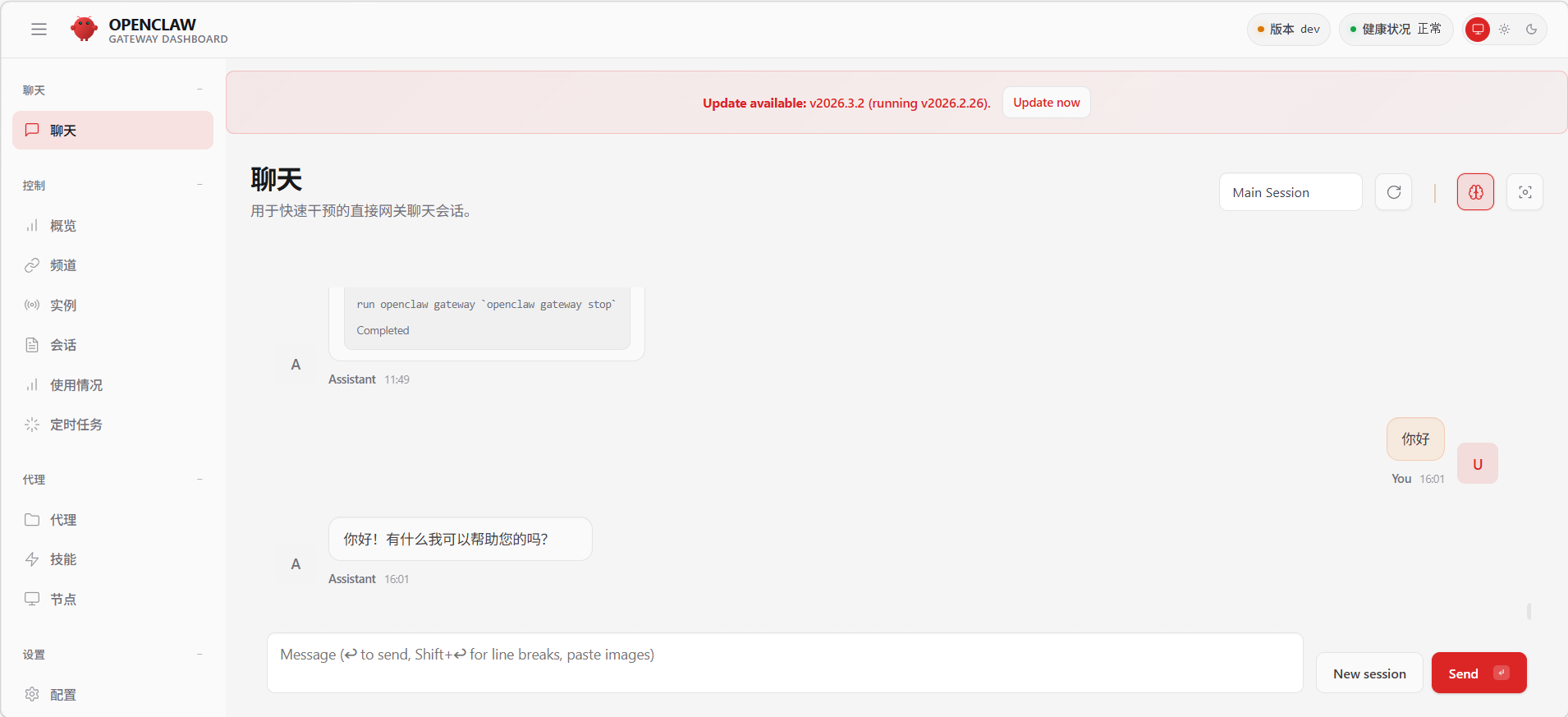

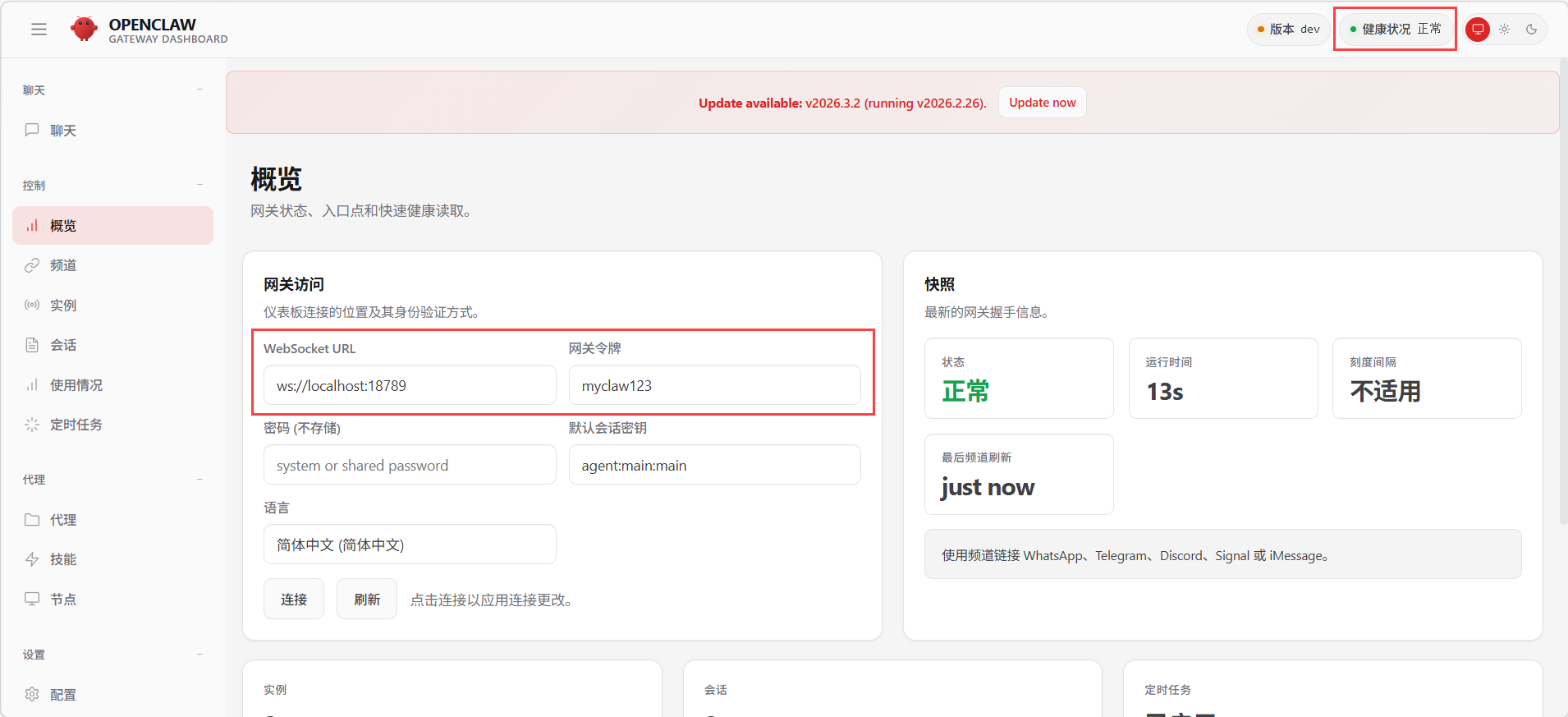

方式二:Web UI

在 wsl 环境下输入以下命令启动网关,端口号和 token 的值可自定义:

openclaw gateway --port 18789 --token "myclaw123"

浏览器中访问 http://localhost:18789 (端口号对应),在概览页中对应配置一下,重新连接,右上角健康状态显示正常即表示已成功访问服务。

方式三:飞书群聊机器人

在飞书群(注意该群id需要确保在配置中已加入许可)中添加机器人,找到前文创建的应用作为机器人添加,添加成功后即可在群聊里@机器人进行对话。

参考链接:

- OpenClaw 官方文档: https://docs.openclaw.ai/zh-CN

- 飞书开放平台: https://open.feishu.cn/document

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)