Ollama 启动 - 一键部署 Clawdbot、Claude Code、OpenCode 及 Codex 官方教程

Ollama推出ollama launch命令,一键部署AI编程工具,支持Claude Code、OpenCode等本地/云端模型。无需复杂配置,开箱即用。用户只需安装Ollama v0.15+版本,通过简单命令即可拉取模型(如glm-4.7-flash)并启动编程环境。支持多种编程工具和模型选择,推荐设置64000 tokens上下文长度以获得最佳体验。还提供仅配置模式和5小时扩展编程会话功能,

Ollama Launch:一键部署本地或云端AI编程工具

告别环境变量与配置文件,快速启动 Claude Code、OpenCode 等编程助手

ollama launch 是 Ollama 最新推出的命令,它可以帮助你一键设置并运行 Claude Code、OpenCode、Codex 等热门编程工具,支持本地模型与云端模型,无需配置环境变量或配置文件,开箱即用。

🚀 快速开始

首先,请确保你已安装 Ollama v0.15 或更高版本。下载链接:https://ollama.com/download

安装完成后,打开终端,运行以下命令拉取模型:

# 需要约 23 GB 显存,支持 64000 个 token 的上下文长度

ollama pull glm-4.7-flash

# 或使用云端模型(支持完整上下文长度)

ollama pull glm-4.7:cloud

🛠️ 一键启动

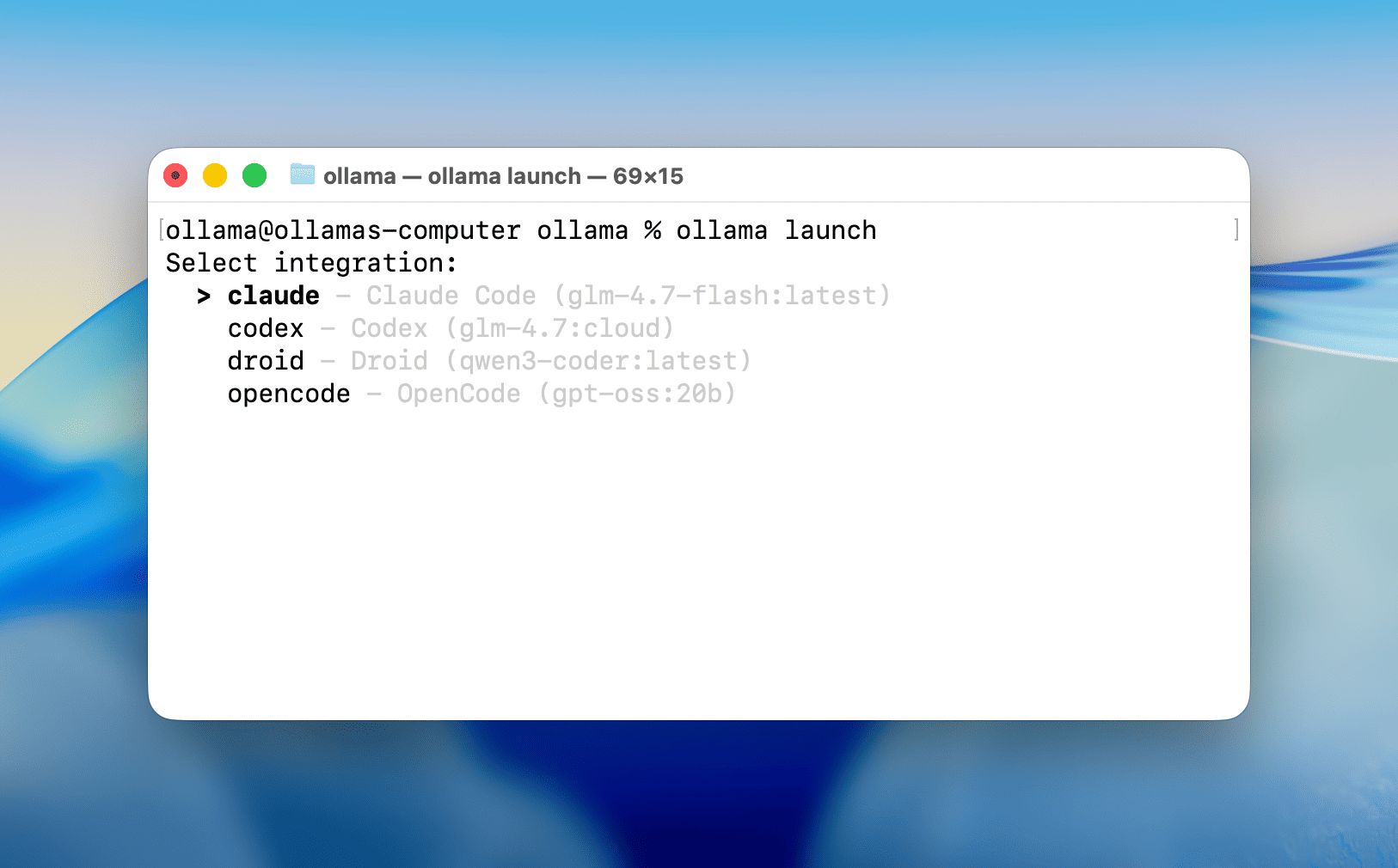

你可以直接通过 ollama launch 命令启动你喜欢的编程工具:

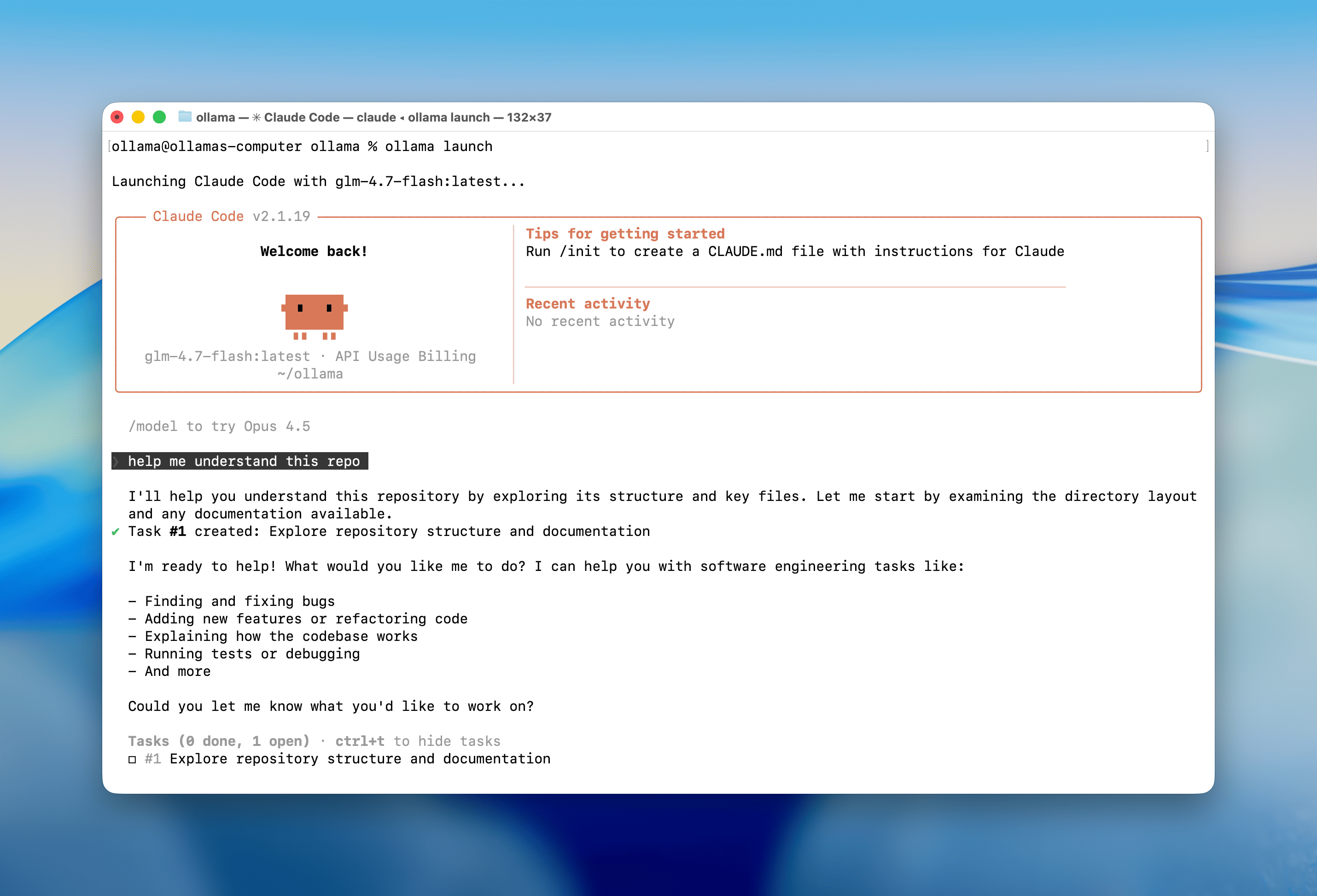

Claude Code

ollama launch claude

OpenCode

ollama launch opencode

命令执行后会引导你选择模型,并自动启动相应的集成环境。

✅ 支持的集成

目前 ollama launch 支持以下编程工具:

- Claude Code

- OpenCode

- Codex

- Droid

🤖 推荐用于编程的模型

提示:编程工具通常需要较长的上下文支持以获得最佳体验。建议在 Ollama 设置中将上下文长度调整为 至少 64000 tokens,具体方法可参考:上下文长度配置文档

本地模型

glm-4.7-flashqwen3-codergpt-oss:20b

云端模型

glm-4.7:cloudminimax-m2.1:cloudgpt-oss:120b-cloudqwen3-coder:480b-cloud

🌐 扩展编程会话

如果你在本地运行这些模型遇到困难,Ollama 还提供了云端服务,即使免费版本也支持完整的上下文长度和较为宽松的使用限制。

此外,Ollama 现已支持5小时的扩展编程会话窗口,适合长时间编码任务。了解更多详情,请访问:Ollama 定价页面。

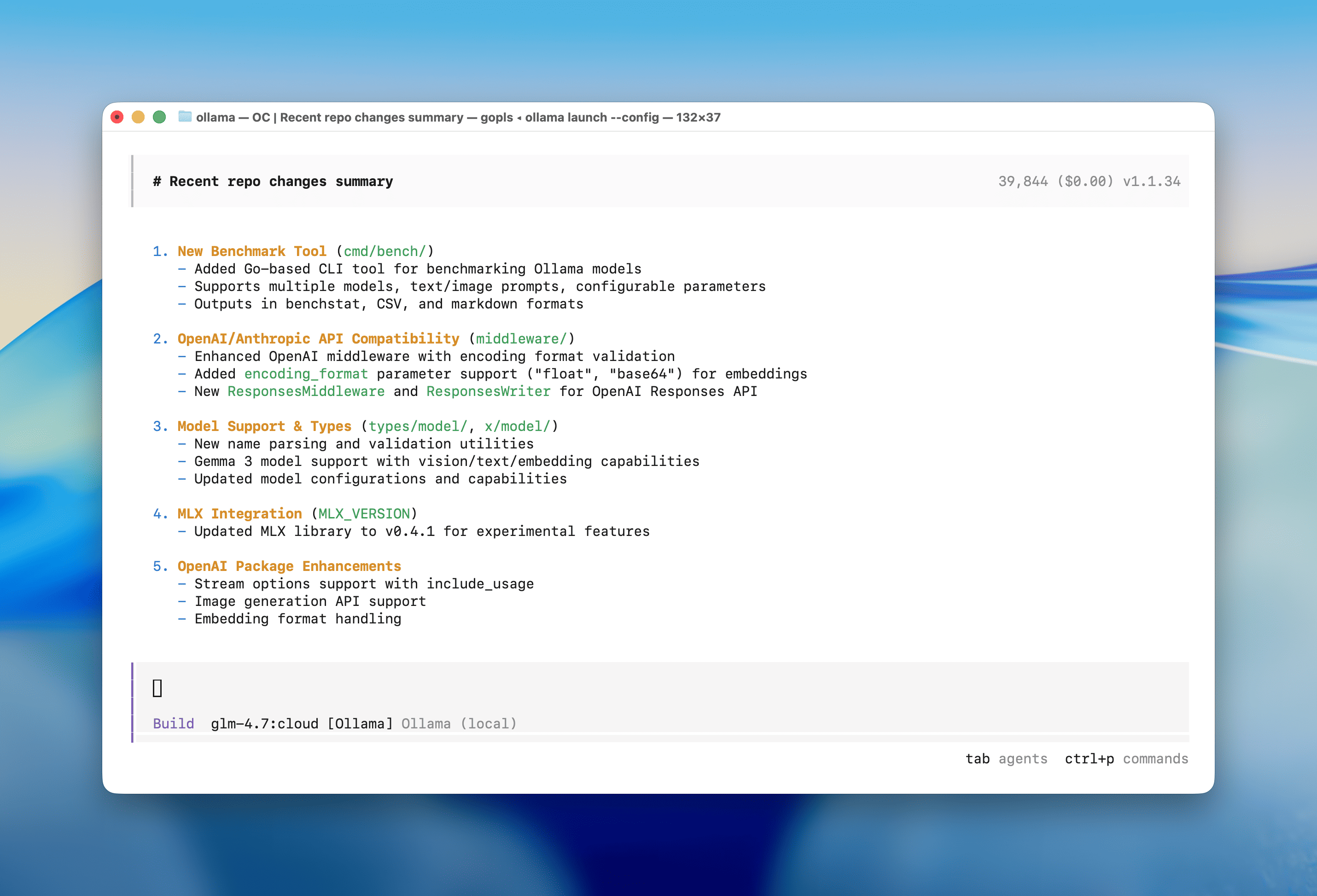

⚙️ 仅配置模式

如果你只想配置工具而不立即启动,可以使用 --config 参数:

ollama launch opencode --config

这样系统只会完成配置步骤,方便后续手动启动或调试。

总结

ollama launch 极大地简化了 AI 编程工具的部署流程,无论是本地模型还是云端模型,都能实现快速启动和配置,适合开发者、研究者以及编程学习者快速上手使用。如果你对 AI 辅助编程感兴趣,不妨下载 Ollama 并尝试这个新功能。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)