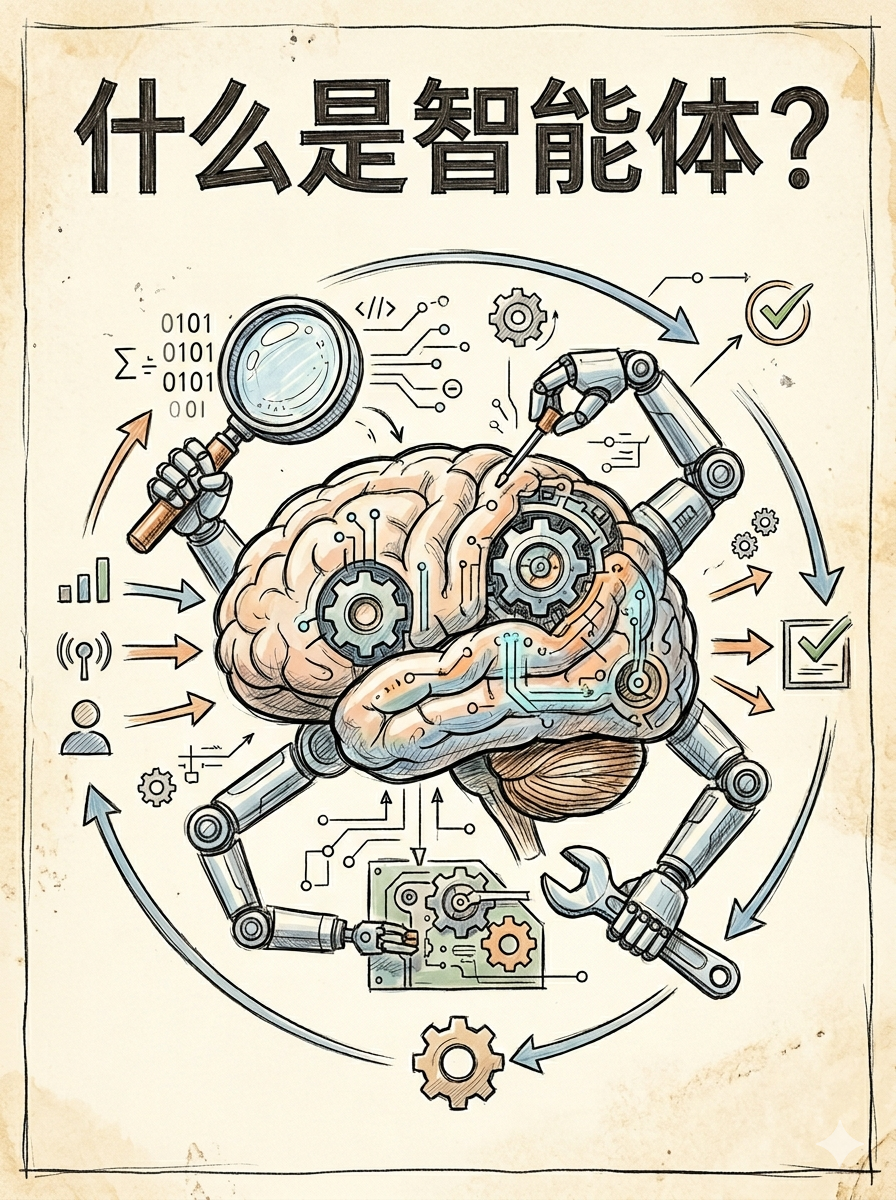

一文读懂智能体(AI Agent):别再被这个词唬住了

以前是 Copilot、通义灵码 帮你补全代码,现在的 ClaudeCode、Cursor、Trae、Codebuddy 可以接一个需求,自己拆任务、写代码、跑测试、看报错、改代码,循环直到跑通。急诊分诊、用药方案建议、病历管理,不同专业的 Agent 各司其职,把医生从重复性工作里解放出来,专注真正需要人来判断的部分。出了事,"AI 自己做的"不是甩锅的理由,责任还是你的。电商的推荐算法就是这个

说在前面

最近这个词快把我搞烦了。

五一饭局,AI Agent。刷视频,AI Agent。参加会议,AI Agent。甚至连亲戚问我最近在研究啥,我说"Agent",她说:"哦,中介?"

行吧。

问题是,就连搞技术的人,十个里面有八个说不清楚它到底是什么。要么讲得云里雾里,要么举的例子跟我没啥关系。

所以今天我来说一个"人话版"的 AI Agent。综合了 IBM、LangChain、Google、Hugging Face 这几家的思路,用我自己的方式重新组织了一遍。你看完应该能真正搞懂,而不只是能在饭桌上多唬人几句。

先把底座说清楚:豆包这类东西算什么?

你每天用的豆包、元宝、Deepseek、 ChatGPT、Claude,底层都是大语言模型,英文叫 LLM。

它干的事儿说穿了很简单:你给它一段话,它输出一段话。就像一个超级厉害的"文字接龙"机器,基于海量训练数据生成回复。

但它有两个硬伤,你肯定踩过:

第一个硬伤:它不知道你的私事。

你问它"我下周三有什么会议",它不知道,因为它进不了你的日历。你问它今天的股价,它也不知道,因为它的知识是有截止日期的。

第二个硬伤:它只会等着你问。

你不说话,它永远不动。它是被动的,不会主动替你做任何事。

这就是"裸 LLM"的天花板。知道这两个局限,你就能理解后面为什么需要 Agent 了。

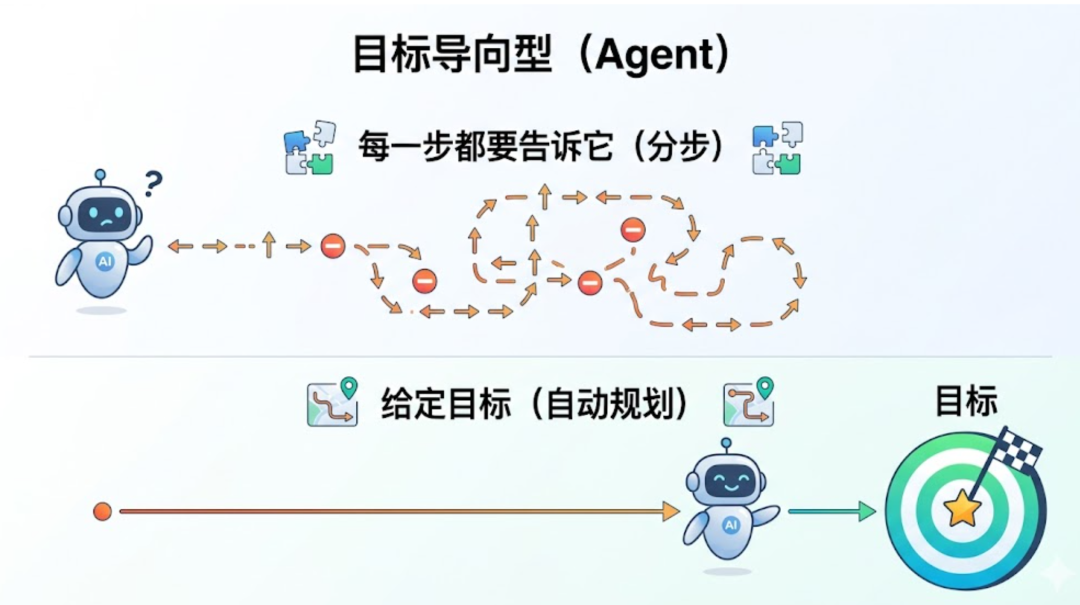

工作流和 Agent,到底差在哪儿?

很多人一上来就想搞 Agent,但其实他们真正在做的,是"AI 工作流"。这两个不是一回事,先把它分清楚。

我举个真实例子。

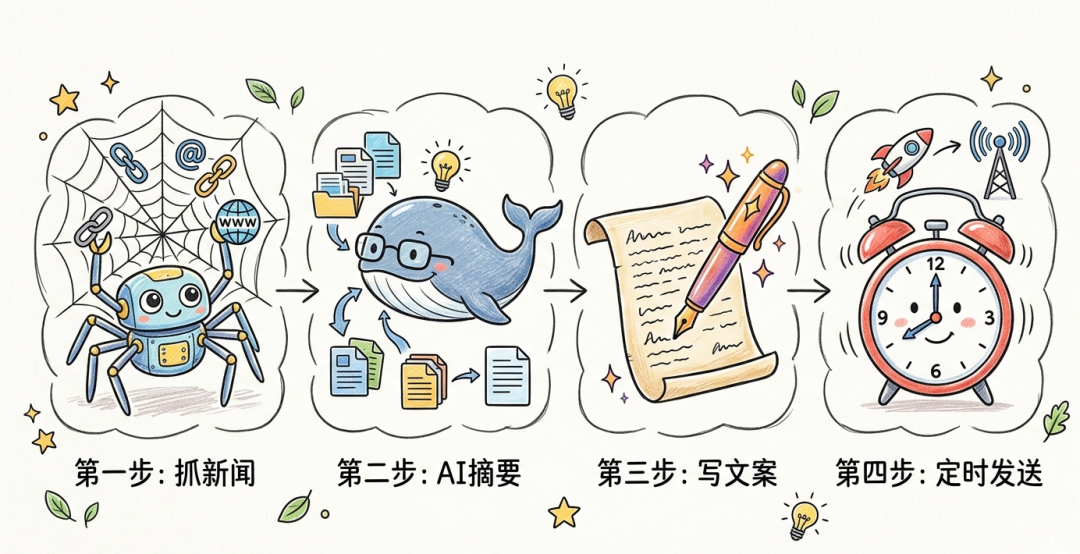

假设你想让 AI 每天帮你生成一篇社媒内容。

工作流的做法是这样的:

你自己想好流程——

-

第一步抓新闻链接,

-

第二步调 deepseek 做摘要,

-

第三步扔给 Claude 写文案,

-

第四步定时早上八点执行。

整个路线图是你画的,AI 只是按你规划的路线跑。哪一步出问题、输出不好看,你得自己回头改提示词,改完再跑,再看效果。你,才是决策者。

Agent 的做法是这样的:

你只告诉它一个目标:"帮我生成今天的社媒内容。"

至于先搜哪个平台、用什么方式摘要、写完要不要自我检查、检查几轮……这些全是它自己决定的。它发现文案不够好,会自己再跑一遍,不需要你盯着。

说白了,

-

工作流是你当导演,AI 是演员;

-

Agent 是你说出结果,AI 自己既当导演又当演员。

LangChain 的 Harrison Chase 有个很直接的定义,我很认可:AI Agent 就是用 LLM 来决定程序控制流的系统。 谁在做决策,这才是本质区别。

AI Agent 到底怎么工作的?

搞清楚了"是什么",再说说"怎么跑起来的"。

我拿一个具体场景来走一遍:你让 Agent 帮你规划下周去河北的周末游,"这么近,那么美,周末去河北"——但你不知道去哪儿、玩什么、住哪里最划算。

第一步:接收目标,拆解任务。

Agent 收到你的要求,不会傻乎乎地直接甩给你一堆攻略链接。

它先想:要回答这个问题,我需要什么信息?

需要知道你从哪儿出发、下周末的天气怎么样、河北哪些景点这个季节最值得去、交通怎么安排、住宿有没有坑。

于是它把这个大目标拆成几个小任务,一个一个来。

第二步:发现自己不够用,就去找工具。

LLM 本身不知道下周末崇礼的天气,也不清楚白洋淀的门票有没有涨价。

怎么办?

去调工具——

-

查天气接口拿实时预报,

-

调携程或飞猪的 API 看酒店价格,

-

再搜一下最近有没有网友说哪个景点在施工别去踩坑。

这个"缺什么找什么"的能力,是 Agent 最核心的特点。

第三步:反思、迭代,输出结果。

拿到这些工具返回的信息,它不是直接输出,而是先想想:

-

这个方案合理吗?

-

如果天气预报说周六有雨,那原来推荐的野外徒步线路就得换掉,改成室内或者古城游。

-

发现方案有漏洞,它会自己再跑一轮调整。

最后给你一个真正能用的周末计划,不是那种复制粘贴的废话攻略。

整个过程你没有参与任何中间步骤。这就是 Agent 跟工作流的本质差异。

"能动性"是个光谱,别较真说"这算不算真 Agent"

吴恩达说过一句我很认同的话:与其争论"这到底算不算 Agent",不如把"能动性"理解为一个连续的光谱。

就像自动驾驶有 L1 到 L5 的分级,AI 系统的"能动性"也有高低之分。

最低级的:LLM 只是根据你给的输入做个分类,走哪条路还是你规定好的,它没有任何自主性。

稍微高一级:LLM 自己判断走 A 路还是 B 路,做了个路由决策。

再高一级:LLM 自己选用哪个工具,自己调用,拿到结果再继续。

更高级:LLM 自己决定循环几次,什么时候停下来,整个过程它说了算。

最顶级:一个 Agent 可以调起另一个 Agent,形成多 Agent 协作,复杂任务拆给不同专家去做。

所以你不用纠结"这个系统算不算 Agent",你只需要问:在这个系统里,LLM 有多少决策权。决策权越大,就越智能。

五种 Agent 类型,从笨到聪明排一排

IBM 给了一个很好的分类,我用大白话重新解释一遍。

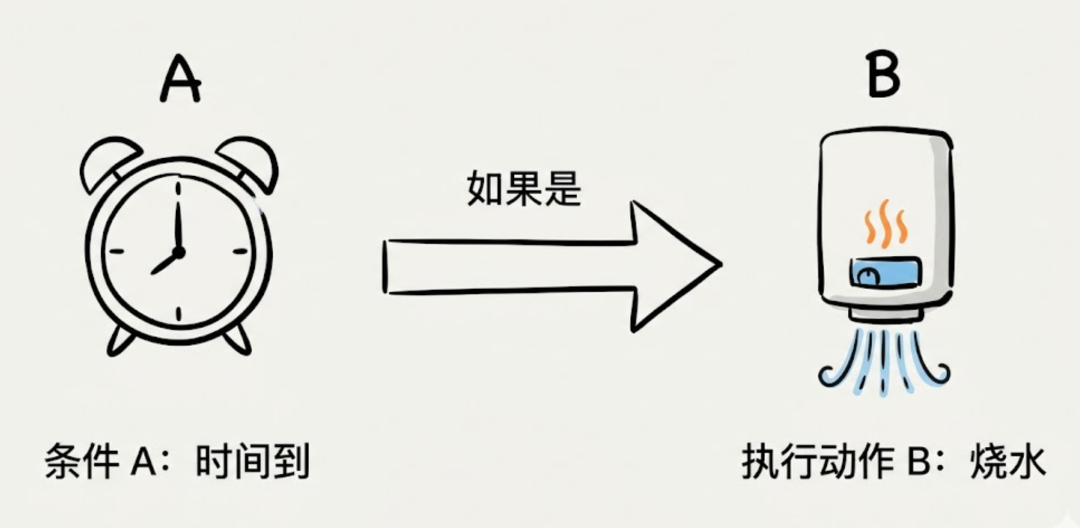

第一种,简单反射型。

就是个"触发器"——满足条件 A 就执行动作 B,没有记忆,不会变通。你家的定时热水器,到点就烧水,不管你今天在不在家。

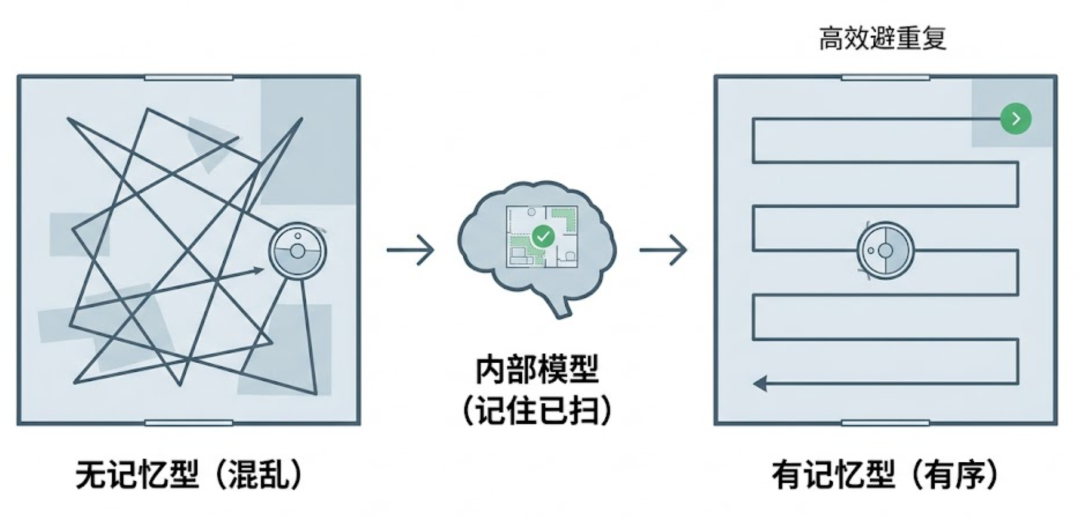

第二种,基于模型的反射型。

比上面聪明一点,有个内部"世界地图",会记住状态。扫地机器人就是这个——它知道哪里扫过了,不会反复绕圈。

第三种,目标导向型。

有明确目标,会主动规划路线。导航软件是典型——它的目标是送你到目的地,会主动帮你找路,而不是等你一步一步告诉它怎么走。

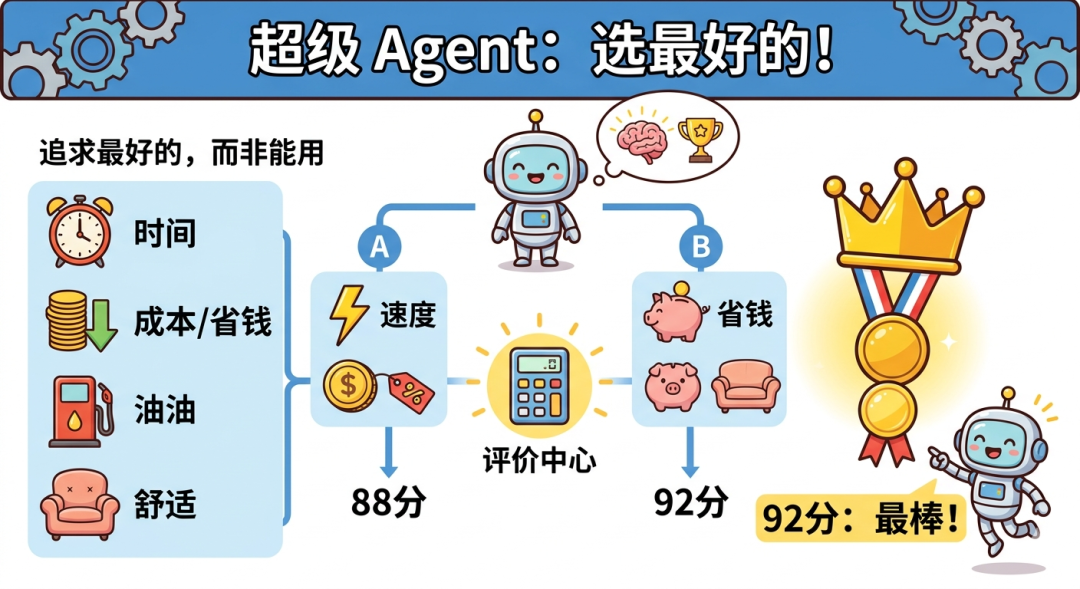

第四种,效用型。

不只是"能到目的地",而是找"最好的那条路"。比如同时考虑油耗、时间、过路费,综合评分最高的方案才推荐给你。

第五种,学习型。

以上能力都有,还能从经验里成长。电商的推荐算法就是这个——它在观察你每次的行为,不断调整对你口味的判断,越用越懂你。

能用在哪儿?几个接地气的场景

说完原理,说说落地。

写代码这件事,Agent 已经开始接手了。

以前是 Copilot、通义灵码 帮你补全代码,现在的 ClaudeCode、Cursor、Trae、Codebuddy 可以接一个需求,自己拆任务、写代码、跑测试、看报错、改代码,循环直到跑通。

不是辅助你,是替你做。

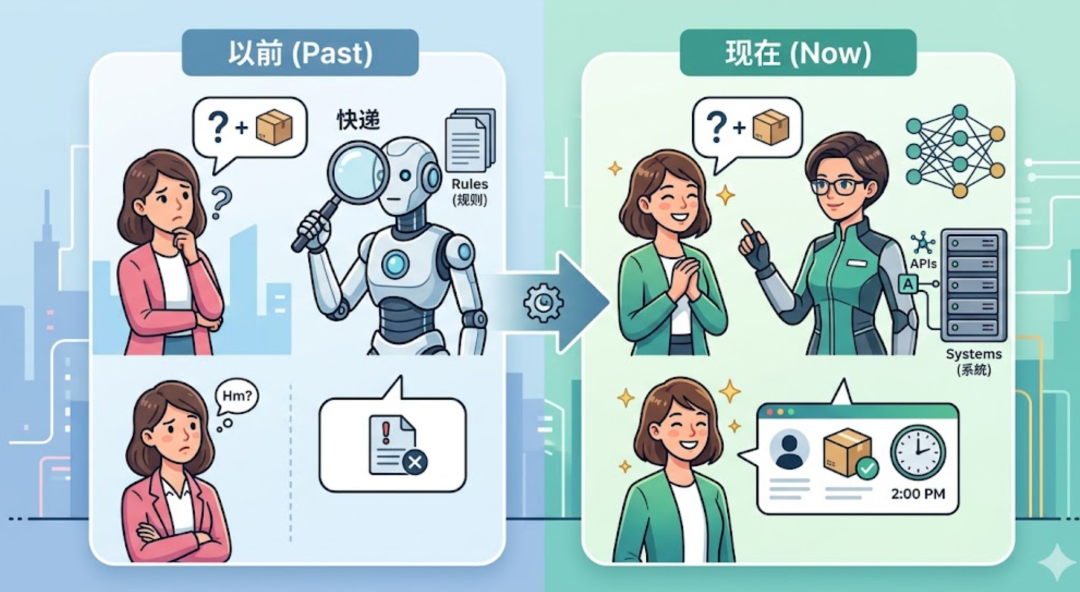

客服领域,变化已经很明显了。

以前的客服机器人就是个关键词匹配,问它"我的快递在哪里",它给你背一段固定回复。

现在的 Agent 版客服能调你的订单系统查状态、判断是否需要走退款流程、甚至直接给你操作——中间不需要人工介入。

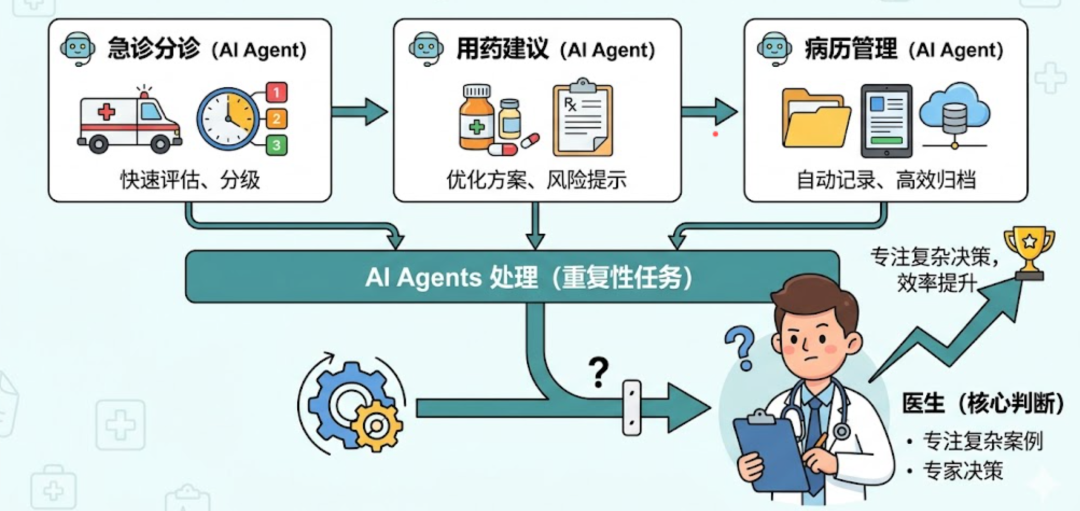

医疗场景里,多 Agent 协作很有潜力。

急诊分诊、用药方案建议、病历管理,不同专业的 Agent 各司其职,把医生从重复性工作里解放出来,专注真正需要人来判断的部分。

金融和供应链,Agent 的速度优势压倒一切。

实时盯着几十个市场数据,发现信号立刻调整仓位或者库存,这种响应速度人根本跟不上。

灾害应急,这个可能是最打动我的场景。

自然灾害发生时,Agent 实时扫描社交平台上的求救信息,自动整理位置、优先级,推给救援团队。有多少人因此能多争取一点时间,真的很难估量。

风险不能不说

说了这么多好话,必须说几句实话。

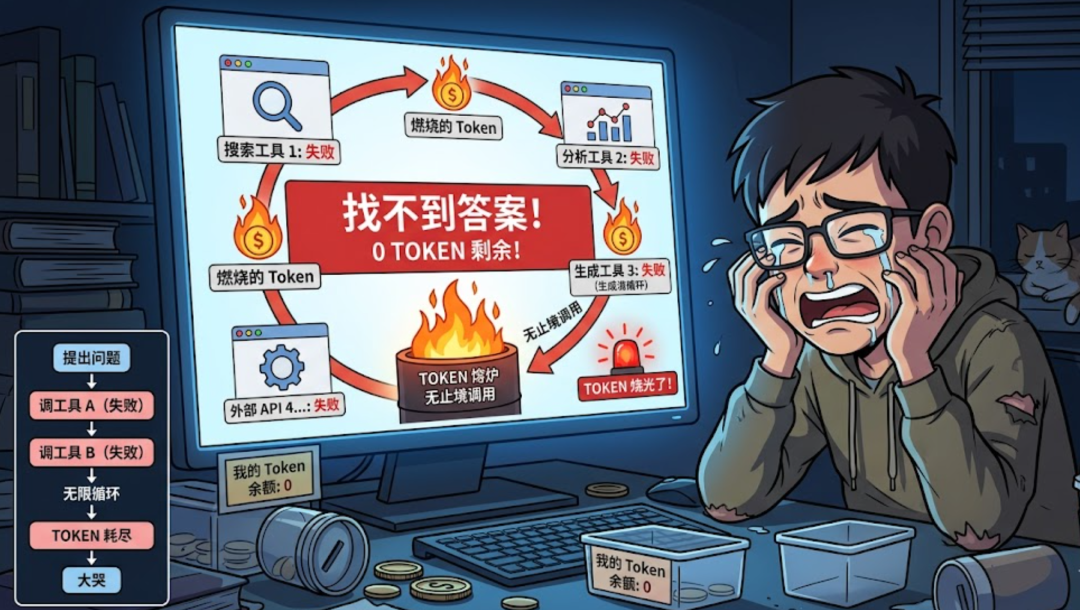

Agent 越自主,越难控制。

多个 Agent 互相依赖,一个出问题可能带崩整条链路。而且 Agent 有时候会陷入"无限循环"——找不到答案就一直调工具,停不下来,token烧光了也不一定给你一个结论。

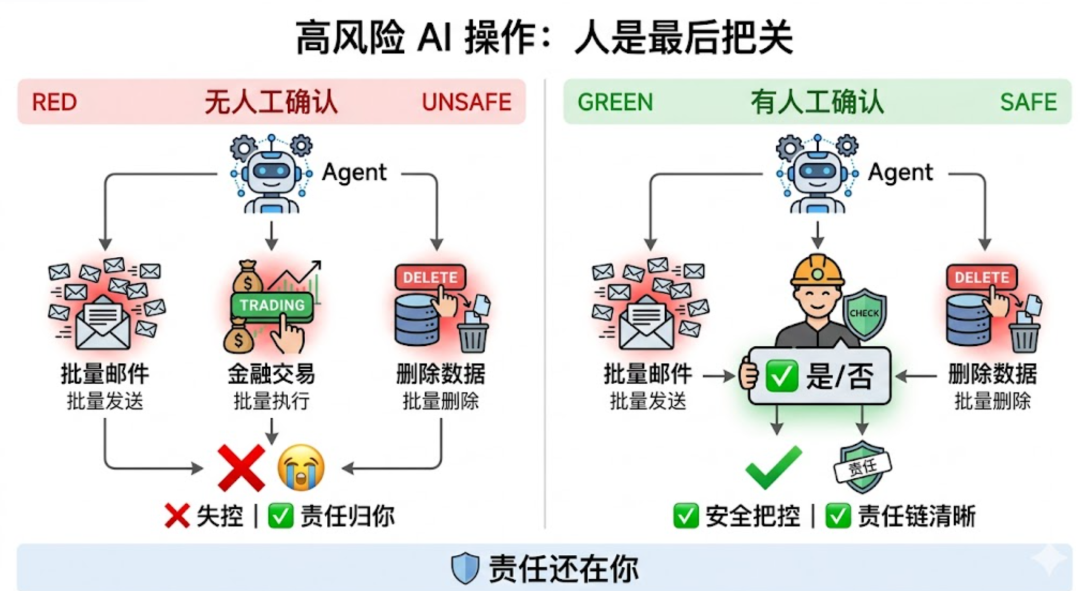

高风险的操作,绝对不能完全交给 Agent。

批量发邮件、金融交易、删除数据——这类操作,一定要设置人工确认的环节。出了事,"AI 自己做的"不是甩锅的理由,责任还是你的。

数据隐私是个真实的隐患。

Agent 要调各种系统、读各种数据,如果权限管控不到位,敏感信息怎么流动的你根本不知道。

所以现阶段,我的建议是:把 Agent 当一个很厉害但还需要人盯着的新员工,而不是能完全放手的自动化机器。

最后,一句话总结

AI Agent 就是:你给目标,它自己想办法,用各种工具,干完活,还能从中学习变得更好。

它不是更聪明的聊天机器人,它是真的在"干活"。

这波变化来得很快,搞清楚底层逻辑比追热点更重要。希望这篇文章对你有用。

有问题,和铭毅评论区聊。

参考来源:

-

https://huggingface.co/learn/agents-course/unit1/what-are-agents

-

https://www.youtube.com/watch?v=FwOTs4UxQS4

-

https://www.ibm.com/think/topics/ai-agents

-

https://www.langchain.com/blog/what-is-an-agent

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)