Windows系统下Ollama+OpenClaw纯本地部署完整教程

windows Openclaw部署方法

前置说明

本教程全程本地运行,无需联网、无需任何 API 密钥、无付费服务;

有 NVIDIA 显卡开启 GPU 推理,无显卡直接跳过第一步即可。

注意:全程尽量使用管理员的PowerShell

第一步:安装 NVIDIA 显卡驱动(无显卡直接跳过)

Ollama 对显卡驱动有强制要求,必须安装正确驱动才能启用 GPU

- 驱动要求

•Ollama 0.18+ 最低驱动版本:531.00

•推荐驱动版本:550+ / 595.79(2025年12月发布) - 下载与安装

1.打开 NVIDIA 官方驱动下载

2.选择你的显卡→ 下载安装

3.安装完成后重启电脑 - 验证驱动

以管理员身份打开 PowerShell,执行:

PowerShell

nvidia-smi

✅ 成功:显示显卡信息、驱动版本、CUDA 版本

第二步:安装 Ollama 并启用 GPU 推理

- 安装 Ollama

1.打开 Ollama 官网 → 下载 Windows 版本

2.双击安装(全程默认下一步,自动配置环境变量) - 强制开启 GPU 加速(Windows 必做)

管理员 PowerShell 执行以下命令:

PowerShell

启用 CUDA 显卡加速

setx OLLAMA_CUDA 1 /m

全部模型层加载到 GPU

setx OLLAMA_GPU_ALL_LAYERS 1 /m

⚠️ 必须重启电脑,环境变量才能生效

3. 下载本地大模型

重启后,PowerShell 执行(下载 7B 模型,适配 3060/3070):

PowerShell

ollama pull qwen2.5:7b-instruct-q5_K_M

4. 测试 GPU 是否正常工作

1.运行模型

PowerShell

ollama run qwen2.5:7b-instruct-q5_K_M

2.新开 PowerShell 查看状态

PowerShell

ollama ps

✅ 成功标志:PROCESSOR 显示 GPU / CPU+GPU

❌ 失败:显示 100% CPU(检查驱动/环境变量/重启)

5. 验证 Ollama 本地接口

PowerShell

Invoke-WebRequest http://127.0.0.1:11434

✅ 成功:返回 Ollama is running

第三步:安装 OpenClaw 并对接本地 Ollama

- 安装 OpenClaw-CN

PowerShell 执行安装命令:

PowerShell

npm install -g openclaw-cn

- 初始化 OpenClaw

PowerShell

openclaw onboard

初始化选择(严格按照选):

1.风险提示:输入 Yes

2.模型提供商:选择 Ollama (本地)

3.Ollama 地址:直接回车(默认 http://127.0.0.1:11434)

4.模型名称:输入 qwen2.5:7b-instruct-q5_K_M

5.最后选项:选择 3. 稍后执行

3. 修复 OpenClaw 强制 API 密钥 BUG(核心!)

容易出现No API key found for provider “ollama”,但是OpenClaw 本地 Ollama 不需要密钥,所以我们人为设置一下:

openclaw config set models.providers.ollama.apiKey "ollama-local"

- 安装并启动网关

PowerShell

安装网关服务

openclaw gateway install

启动网关

openclaw gateway

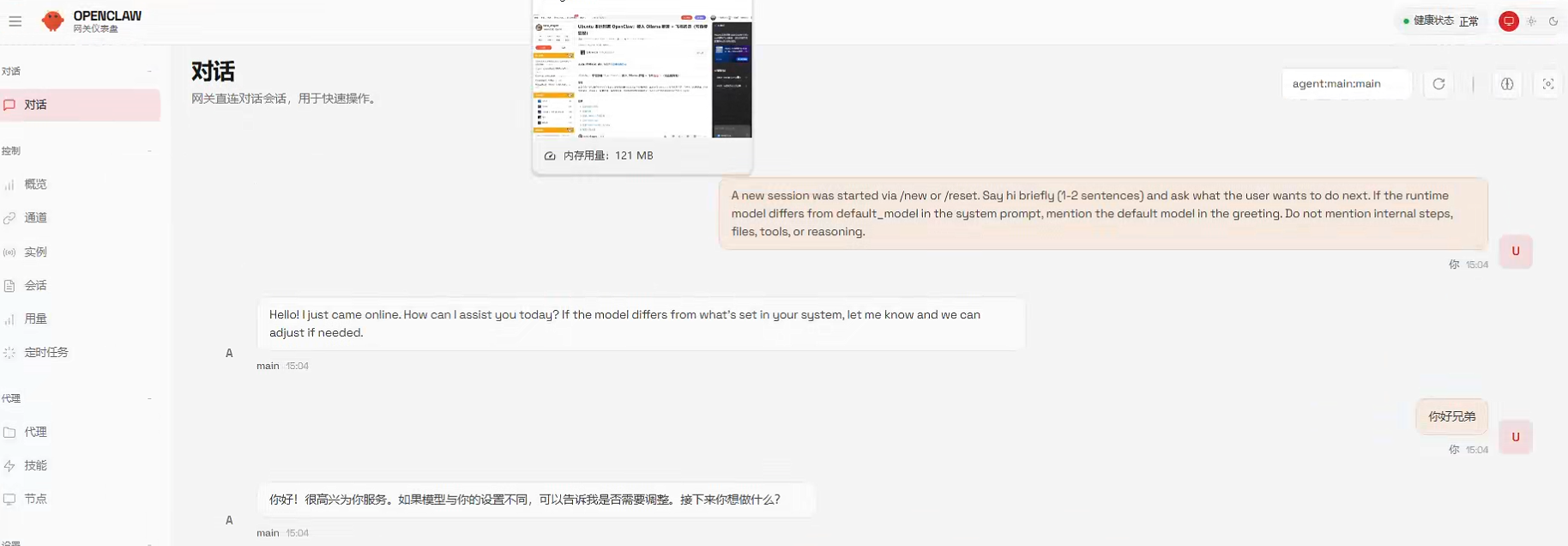

6. 访问面板开始聊天

复制浏览器打开(带权限,唯一可用链接):

Plain Text

http://127.0.0.1:18789

大功告成,快乐玩耍!

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)