Token 不设限!你的每个 idea 都很重要!

采用 MoE架构,总参数规模达到 122B,但每次推理只激活约 10B 参数,在保证模型能力的同时大幅降低计算成本。该模型在多项基准测试中表现突出,在知识理解、推理与。是一款更偏向“任务执行”的智能模型,不只是简单对话,而是能够对复杂问题进行多步规划、调用工具并持续调整策略,从而完成完整任务流程。,在复杂文档理解、多语言应用和 AI Agent 场景中具有明显优势,是当前构建智能系统和复杂 AI

在过去一年,大模型的能力不断突破,但对于开发者来说,真正的门槛往往并不是模型本身,而是使用成本与调用限制。

很多开发者在体验 AI 时都会遇到类似情况:

-

刚测试几个 Prompt,Token 用完了

-

做 Agent 或自动化流程时,调用成本迅速上升

-

想做原型项目,却被额度限制卡住

于是很多好想法,还没来得及验证,就已经被“Token 不够”劝退。

如果有一种方式可以让开发者不用担心 Token 消耗、无需复杂部署、随时调用模型能力,AI 的探索效率将会完全不同。

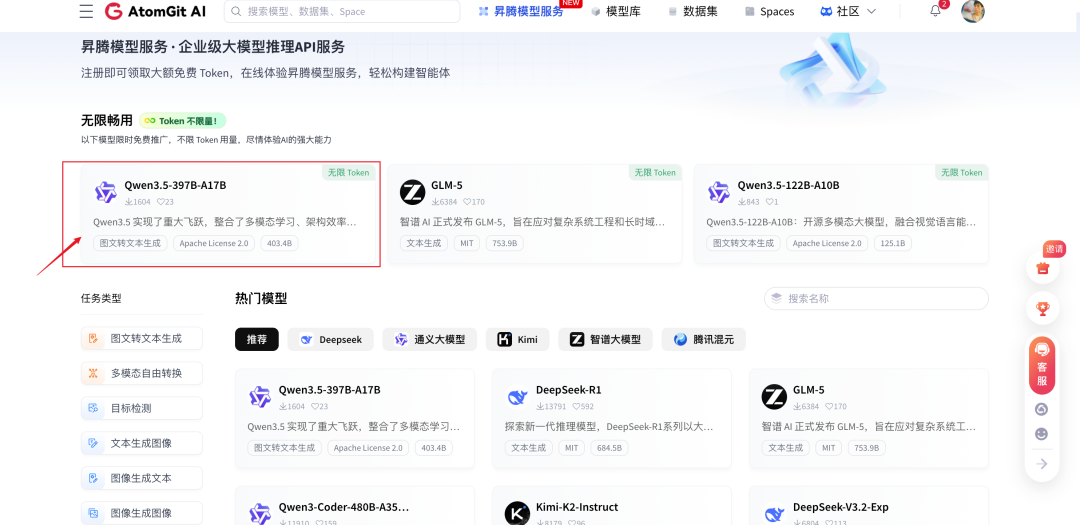

现在,AtomGit AI 正式推出 Serverless API 模型服务,并开启 “无限 Token 畅用”活动”。

这一次,我们直接为开发者开放了 GLM-5 系列 与 Qwen3.5 系列的全量级模型,包含但不限于:

-

Qwen3.5-397B-A17B

-

GLM-5

-

Qwen3.5-122B-A10B

开发者无需部署模型、无需管理算力,只需要调用 API,就可以直接使用这些顶级模型能力。

👉 立即体验:https://ai.atomgit.com/serverless-api

3 分钟接入 API,把 AI 接入你的项目

👉 https://ai.atomgit.com/serverless-api

进入之后点击我们标有无限 Token 的模型,这里我们以 Qwen3.5 为例

点击在线体验

获取到对应的 URL,API Key 以及 Model 便可以进行配置

核心主力:这几款“王炸”模型,通通不限量!

Qwen3.5-397B-A17B:开源旗舰级推理模型

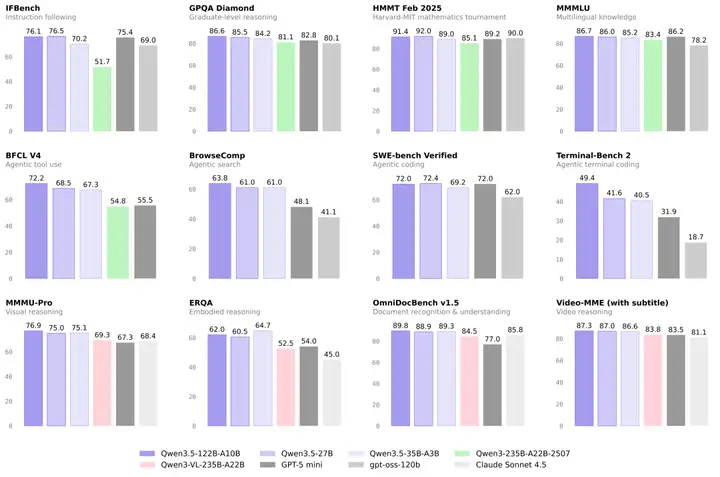

Qwen3.5-397B-A17B 是目前最强的开源旗舰模型之一,总参数规模达到 397B,但推理时仅激活 17B 参数,通过稀疏 MoE 架构实现了极高的性能与效率平衡。

模型在架构上结合 Gated DeltaNet 线性注意力 + MoE 专家路由机制,不仅推理速度大幅提升,同时在复杂推理、数学问题、代码理解以及多语言任务上表现突出。

同时模型原生支持 20 万级 Token 长上下文与 200+ 语言能力,在复杂文档理解、多语言应用和 AI Agent 场景中具有明显优势,是当前构建智能系统和复杂 AI 工作流的重要基础模型。

GLM-5:更适合 Agent 与复杂任务的智能模型

GLM-5 是面向复杂推理与 Agent 任务优化的一代大模型,在长周期交互、多轮任务规划以及工具调用场景中表现尤为突出。

相比传统对话模型,GLM-5 是一款更偏向“任务执行”的智能模型,不只是简单对话,而是能够对复杂问题进行多步规划、调用工具并持续调整策略,从而完成完整任务流程。在 AI Agent、自动化工作流、代码生成、数据分析以及长对话知识问答等场景中表现尤为突出,非常适合开发 AI 应用、编程助手或智能 Agent 系统等复杂应用。

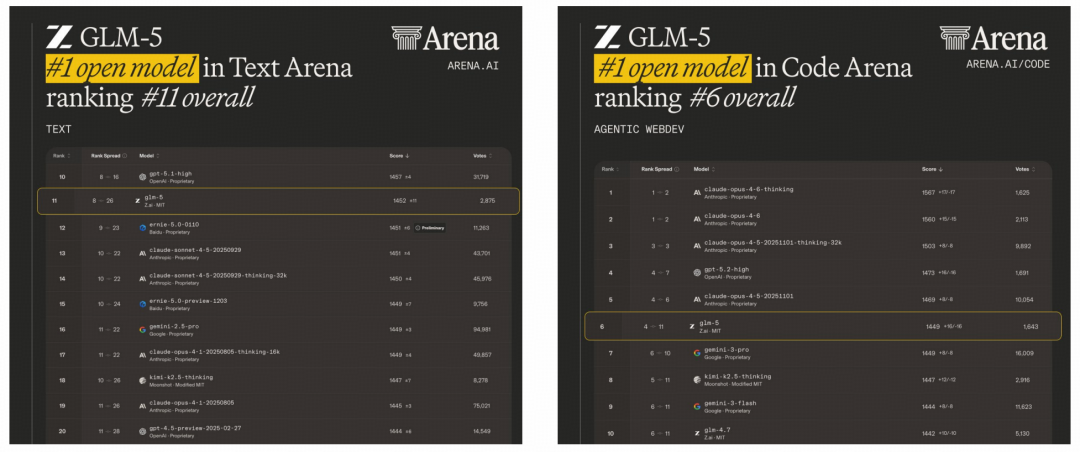

在由数百万真实任务驱动的 LMArena 评测中,GLM-5 在文本竞技场 (Text Arena) 和代码竞技场 (Code Arena) 均位列开源模型第一。这种基于真实世界效用信号的人类评判,证明了 GLM-5 不仅是“刷榜高手”,更是真正懂人类需求、能写高质量代码的“实战派”。

Qwen3.5-122B-A10B:性能与成本平衡的生产级模型

Qwen3.5-122B-A10B 是 Qwen3.5 系列中非常适合实际业务落地的一款模型。

Qwen3.5-122B-A10B 采用 MoE架构,总参数规模达到 122B,但每次推理只激活约 10B 参数,在保证模型能力的同时大幅降低计算成本。该模型在多项基准测试中表现突出,在知识理解、推理与 Agent 任务等场景中都保持较强竞争力,使开发者能够以更低的算力成本构建 AI SaaS、智能客服、企业知识库和编程辅助等生产级应用。

作为 Qwen3.5 系列的首个开源旗舰,这款模型的发布标志着开源界正式进入了“超大规模稀疏模型”的新纪元。在过去,开发者往往需要在“高性能的闭源黑盒”与“能力受限的开源模型”之间做二选一。但 Qwen3.5 的出现打破了这种平衡,它通过 Apache 2.0 协议彻底释放了生产力,让企业级用户可以在完全可控的环境下,部署足以对标 GPT-5 级别的算力矩阵。

你的每个idea都很重要

我们深知,当开发者每写一行代码都要计较 Token 成本时,真正的灵感就会被打折。顶级 AI 不该是昂贵的奢侈品,而应是创新的基础设施。

AtomGit 选择承担所有的算力重担,只为一个简单的初衷:别让算力账单,限制了你的 Idea。 你只管负责定义未来,剩下的,交给我们就行。

快速体验方式

方式一:即刻在线体验

无需本地部署,也不需要提前配置任何运行环境,打开页面即可直接调用 GLM-5 系列 与 Qwen3.5 系列 的全量级模型

👉 在线体验地址:https://ai.atomgit.com/serverless-api

方式二:集成推理 API

以上三款旗舰模型均支持通过推理 API 的形式接入,适合需要将其集成到内容生产流水线、自动化设计工具或实时交互应用中的中大型工程项目。

👉 API 接入地址:https://ai.atomgit.com/serverless-api

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)