在windows环境下自定义Ollama安装路径并部署deepseek

本文介绍了如何自定义Ollama的安装路径以避免占用C盘空间。主要步骤包括:下载安装包后,在目标路径创建文件夹,通过CMD命令指定安装目录(如D:\Ollama_Deepseek),并配置环境变量。同时提供了部署DeepSeek大模型的建议配置(需8-16GB显存GPU、16-32GB内存、50GB存储)和操作指南,包括模型拉取命令(ollama pull deepseek-r1:1.5b)和服务

由于Ollama的exe安装软件双击默认的安装路径是在C盘,而且是在安装的过程中没有让你设置安装位置的地方 ! 并且以及后续的模型数据下载也在C盘,这样会导致占用大量的C盘空间,因此就摸索出了自定义Ollama的安装位置的方法。

一. Ollama安装详细安装过程如下:

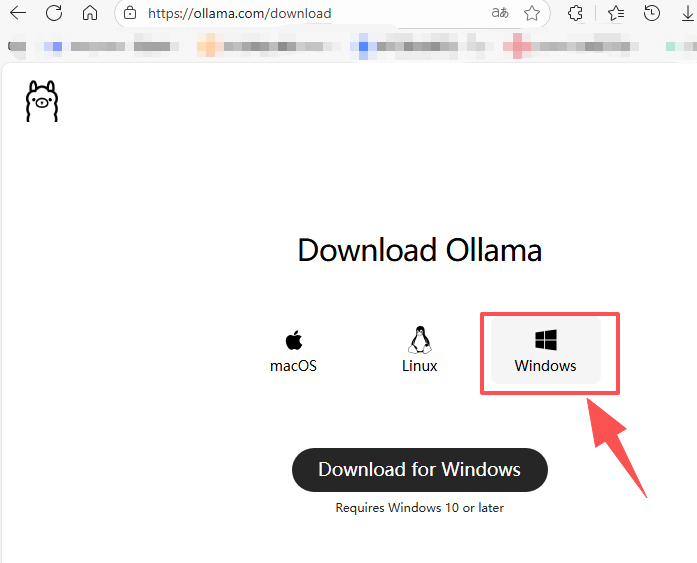

1. 下载 Ollama:

Ollama官网地址:https://ollama.com/ 可以在官网下载Ollama

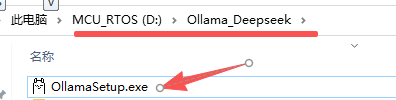

2. 创建好一个新文件夹。在你想安装的路径下创建好一个新文件夹,并把Ollama的安装包放在里面。比如我这里的是:D:\Ollama_Deepseek

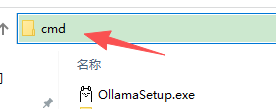

3.在文件路径上输入CMD按回车后会自动打开命令窗口

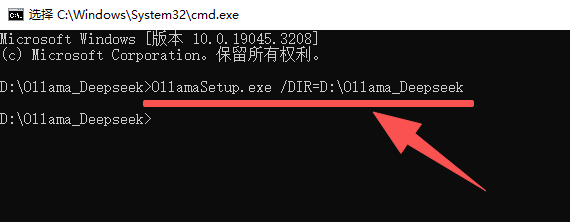

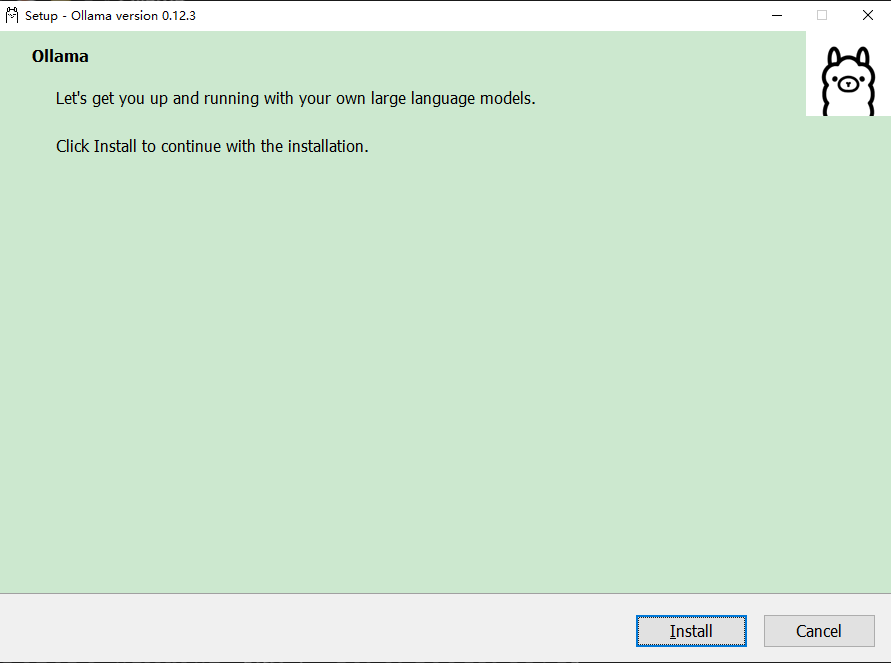

4. 在CMD窗口输入:OllamaSetup.exe /DIR=D:\Ollama_Deepseek 然后按回车! 就启动软件的安装步骤 !

语法:软件名称 /DIR=这里放你上面创建好的Ollama指定目录

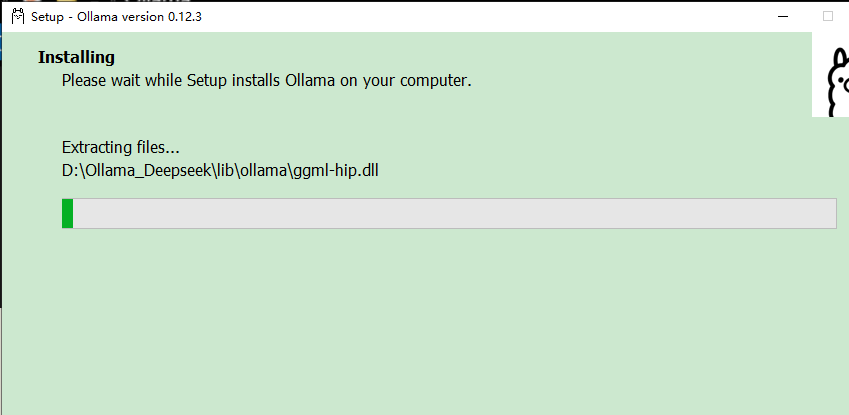

5.点击Install后,可以看到Ollama的安装路径就变成了我们指定的目录了

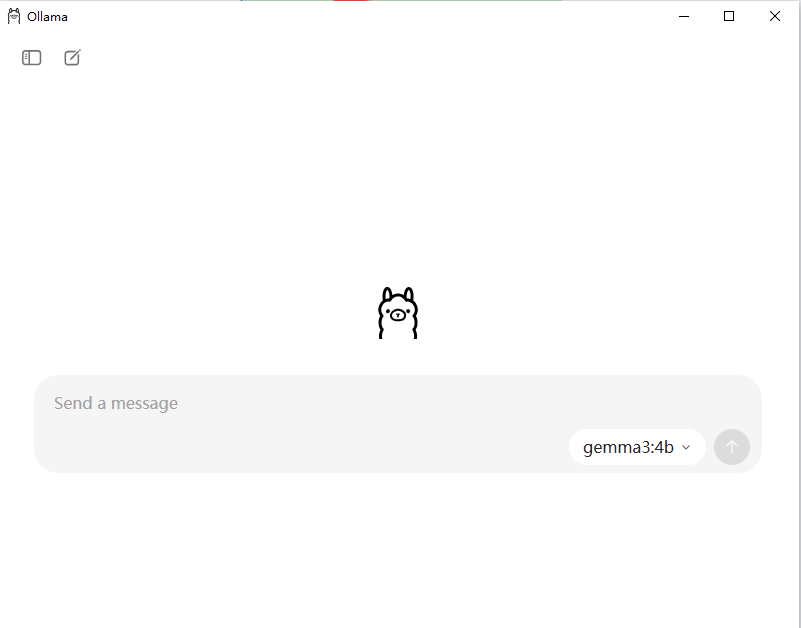

6.到这里Ollama自定义目录安装就成功了。

7.配置环境变量

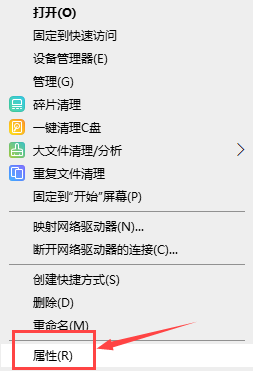

7.1 在"我的电脑"鼠标右键,选择"属性"

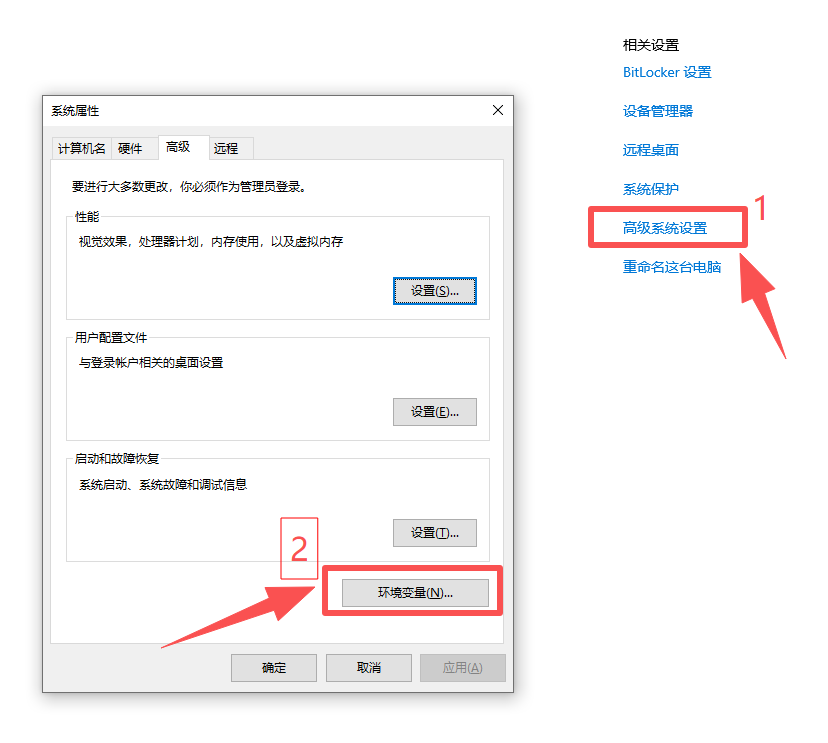

7.2 在设置界面,点击"高级系统设置",然后再点击"环境变量",如下图所示

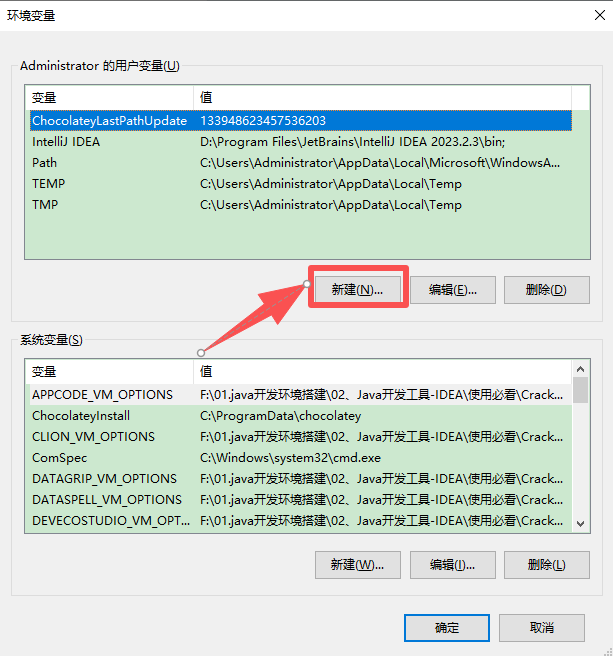

7.3 新建环境变量,如下图所示:

7.3 新建环境变量,如下图所示:

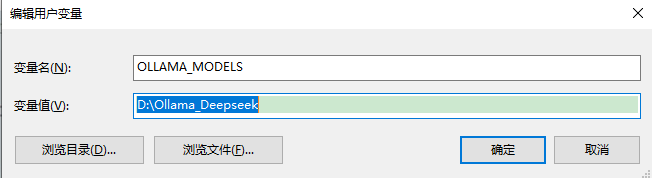

7.4 设置环境变量

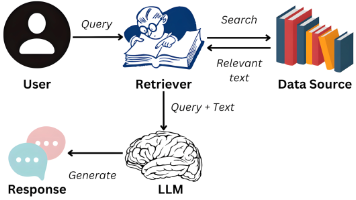

二 . 部署部署deepseek大模型

1. 拉取 DeepSeek 模型

硬件配置建议

-

GPU选择(根据模型大小灵活调整): 入门配置:NVIDIA显卡(≥8GB显存) → 适合7B/8B模型。 高性能配置:NVIDIA显卡(≥16GB显存) → 支持14B大模型。 无独立显卡用户:可使用CPU模式运行(速度约为GPU的20%)。

-

内存要求:≥16GB(推荐32GB,处理长文本时不易卡顿)

-

存储空间:≥50GB可用空间(建议SSD硬盘,加快模型加载速度)

-

操作系统: Windows 10/11(21H2及以上版本)。 macOS Ventura 13.4+。 Ubuntu 22.04 LTS/24.04 LTS

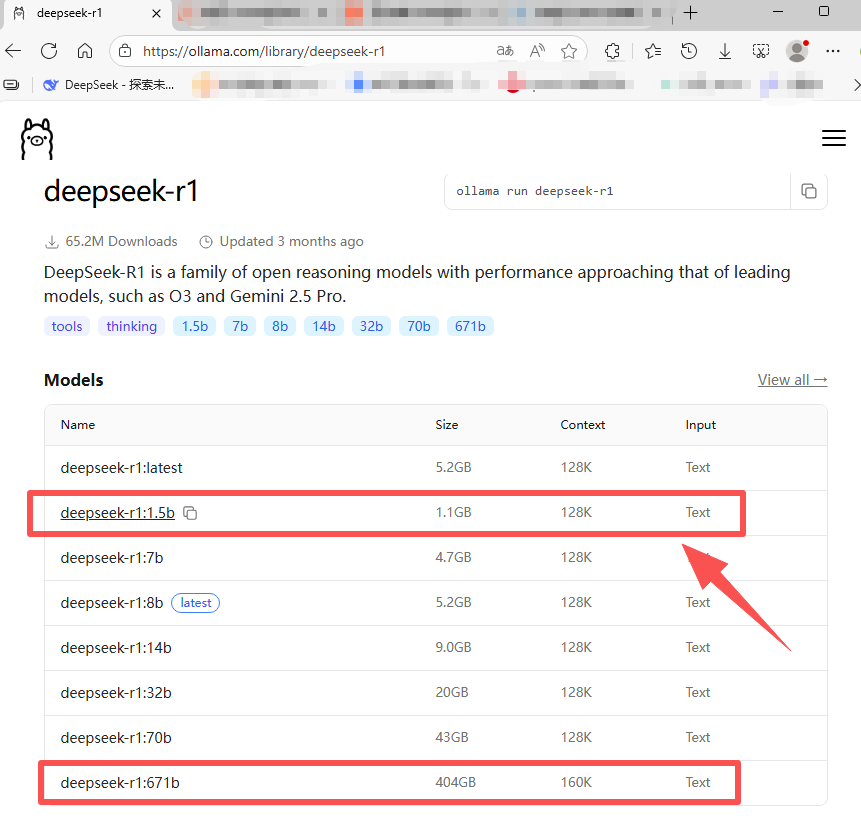

选择适合自己的版本 https://ollama.com/library/deepseek-r1

如果只是简单的个人学习测试,建议选择最小的模型

A. 首先点击复制该模型的名称

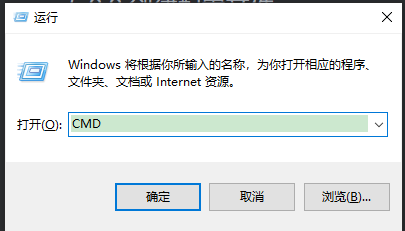

B. 按键盘上的"win + R" 键然后输入"CMD"

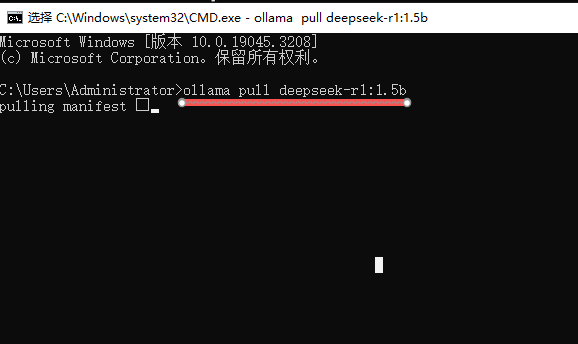

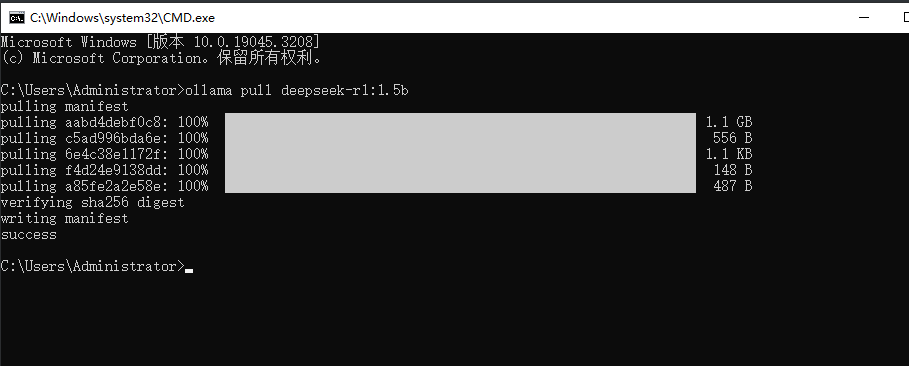

C.在打开的命令窗口执行一下拉取模型的命令

ollama pull deepseek-r1:1.5b

拉取模型的时间有点长,需要耐心等待!

拉取模型成功!

2. 启动Ollama服务测试

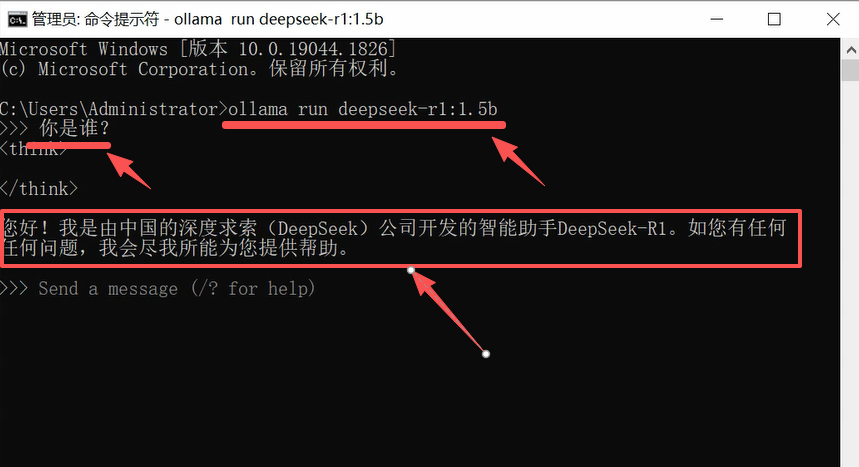

在命令窗口运行以下命令,启动Ollama

ollama run deepseek-r1:1.5b启动 Ollama 服务,默认会监听 http://localhost:11434

看到以上运行结果,说明,Ollama服务启动成功!

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)