OpenAI o3-pro 震撼上线,比 o3 强在哪?

OpenAI 长期以来一直是人工智能领域的领军者,持续推动机器学习模型的能力进阶。其最新推出的 o3-pro 模型,标志着这一探索之旅中的又一个重要里程碑。o3-pro 于 2025 年初发布,以卓越的性能和适应性脱颖而出,成为 AI 领域的颠覆者。本文将深入探讨 OpenAI o3-pro 的基准测试表现、定价策略及 API 定价,详细解析这款模型为何能成为极具突破性的创新成果。

OpenAI 长期以来一直是人工智能领域的领军者,持续推动机器学习模型的能力进阶。其最新推出的 o3-pro 模型,标志着这一探索之旅中的又一个重要里程碑。o3-pro 于 2025 年初发布,以卓越的性能和适应性脱颖而出,成为 AI 领域的颠覆者。本文将深入探讨 OpenAI o3-pro 的基准测试表现、定价策略及 API 定价,详细解析这款模型为何能成为极具突破性的创新成果。

🚀ALL IN ONE (AIO) 开放接口(API)平台

什么是 OpenAI o3-pro?

OpenAI 的 o3-pro 模型是一款前沿语言模型,其设计目标是凭借出色的精准度和速度处理各类复杂任务。它在 GPT-4 和 o1 等早期模型的基础上迭代升级,融合了自然语言处理、机器学习及深度学习领域的最新技术成果。该模型的架构经过精细调优,既能实现快速运算,又能保证高准确率,适用场景广泛 —— 从简单的文本生成到复杂的问题求解,均可高效应对。

o3-pro 的一个核心特性在于其生成和理解文本的能力高度接近人类交流模式,即便在复杂场景中也能保持语义连贯与内容相关性。这一能力得益于海量训练数据集、先进算法及创新性训练技术的协同作用。除文本处理外,o3-pro 还支持多模态输入,可将图像等数据类型与文本无缝结合处理,进一步拓展了应用场景。

该模型在需要深度语境理解的任务中表现尤为突出,例如长文档摘要生成、语言翻译或精细问题解答等。同时,它在创意领域也颇具优势,能够胜任叙事写作、代码编写甚至音乐创作等任务。凭借如此多元的能力,o3-pro 有望为教育、医疗、娱乐和金融等行业带来变革,为个人和机构提供强大的工具支持。

OpenAI o3-pro Benchmarks

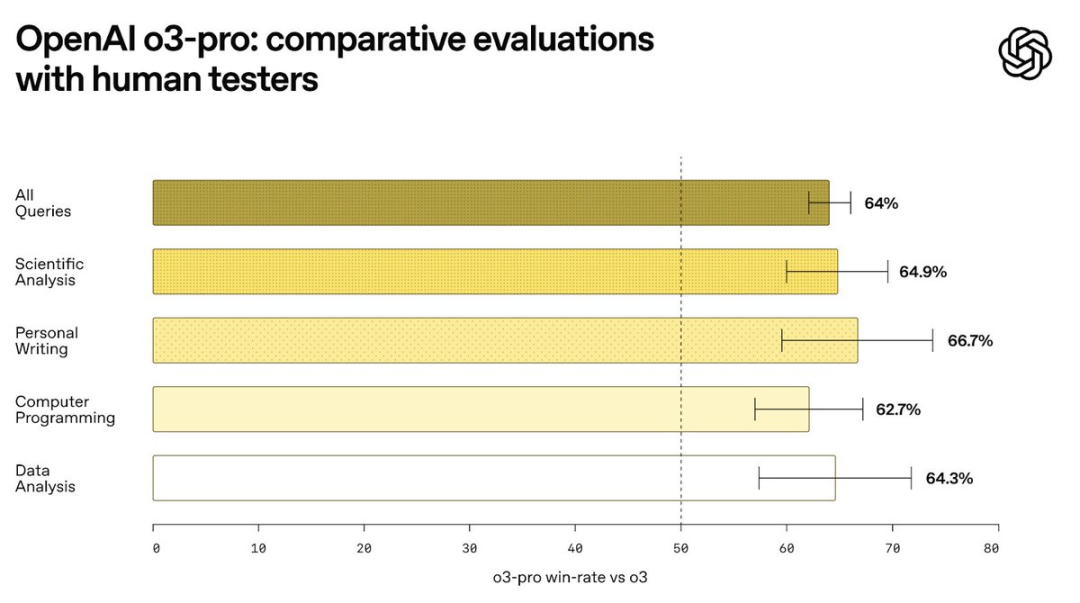

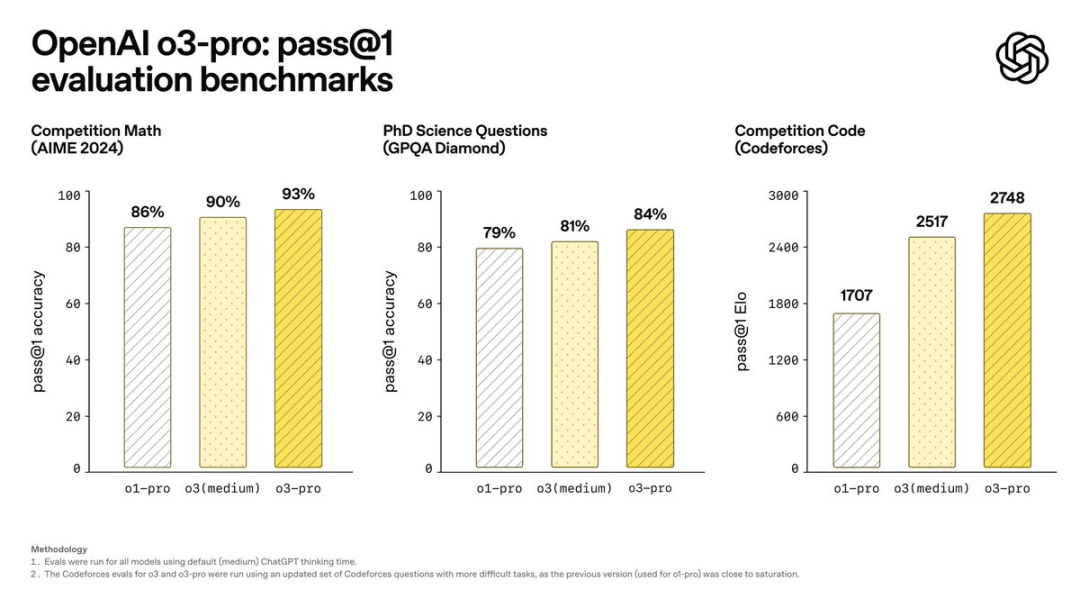

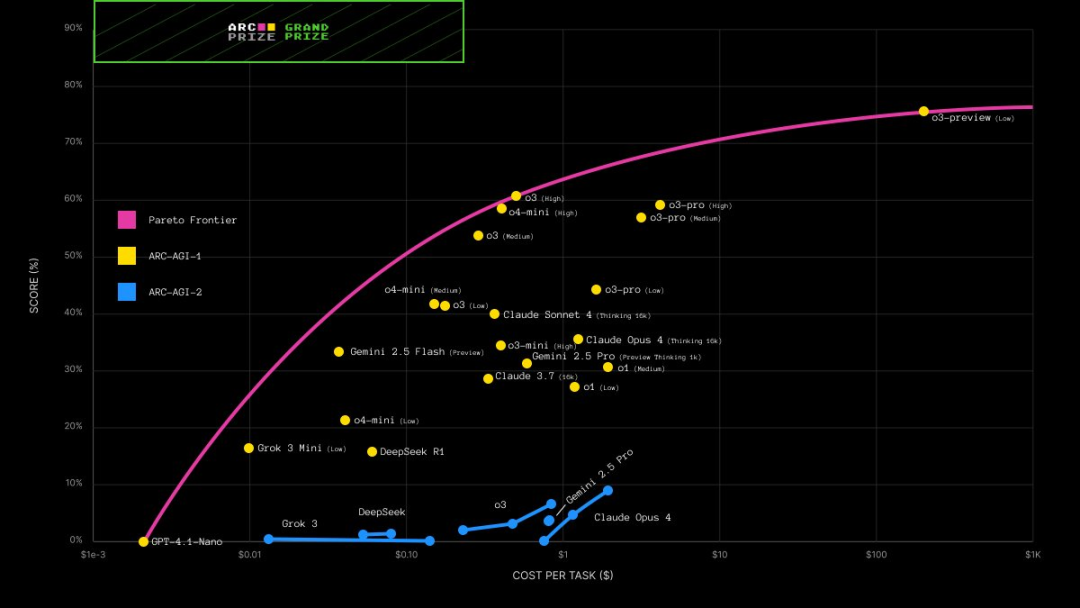

基准测试是衡量 AI 模型性能的关键指标,而 o3-pro 在多项评估标准上都刷新了行业标杆。OpenAI 的内部测试显示,o3-pro 在主流 AI 基准测试中表现卓越,尤其在数学运算和科学知识等领域展现出显著优势。

在测试数学能力的 2024 年 AIME 基准中,o3-pro 的表现超越了谷歌的领先模型 Gemini 2.5 Pro。这一成果凸显了其在求解复杂方程和应用逻辑推理方面的卓越能力,使其成为技术和学术领域的重要工具。

同样,在评估博士级科学理解能力的 GPQA Diamond 基准测试中,o3-pro 的成绩优于 Anthropic 的 Claude 4 Opus。这证明了它对前沿科学概念的深刻且准确的掌握,使其成为研究和专业领域的首选模型

除了这些专项测试外,o3-pro 在自然语言理解、文本生成速度和多模态任务处理方面也展现出显著优势。其在快速处理数据的同时保持准确性的能力,使其从竞争对手中脱颖而出。OpenAI 还对 o3-pro 的可靠性进行了严格测试,通过压力测试和对抗性挑战确保其在高负荷条件下仍能保持稳定和安全。这些测试结果证实,o3-pro 是一款强大且可靠的模型,已准备好投入实际应用场景。

OpenAI o3-pro 定价

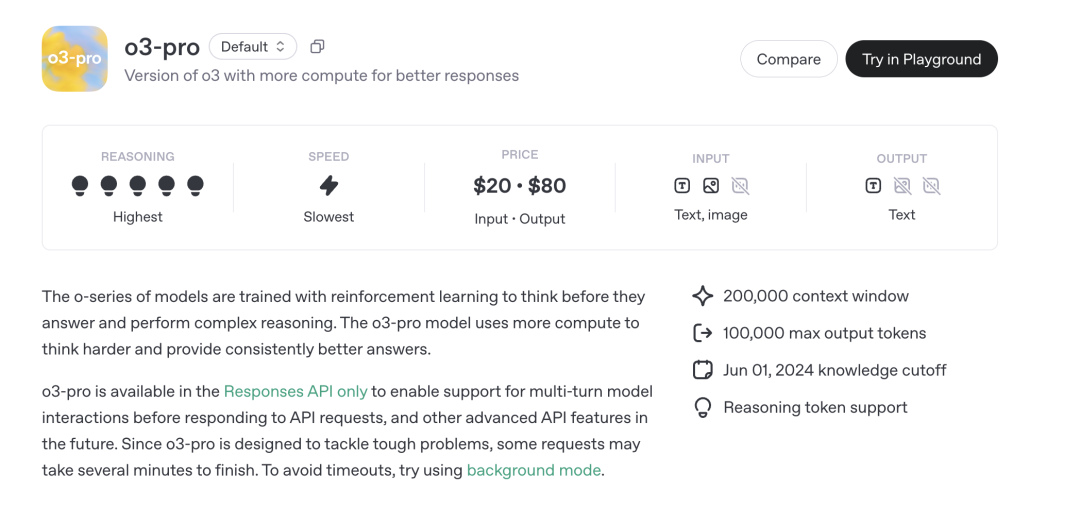

OpenAI 对 o3-pro 的定价围绕其 API 使用情况构建,个人或企业均无法通过独立订阅计划直接访问该模型。相反,费用与令牌(token)消耗量挂钩,这一设计反映了该模型对计算资源的高需求特性。以下是定价结构的详细解析。

o3-pro 模型仅通过 Responses API 提供访问,定价基于处理的令牌数量。令牌代表文本块,约 100 万令牌相当于 75 万个单词 —— 大致相当于《战争与和平》这类小说的篇幅。

-

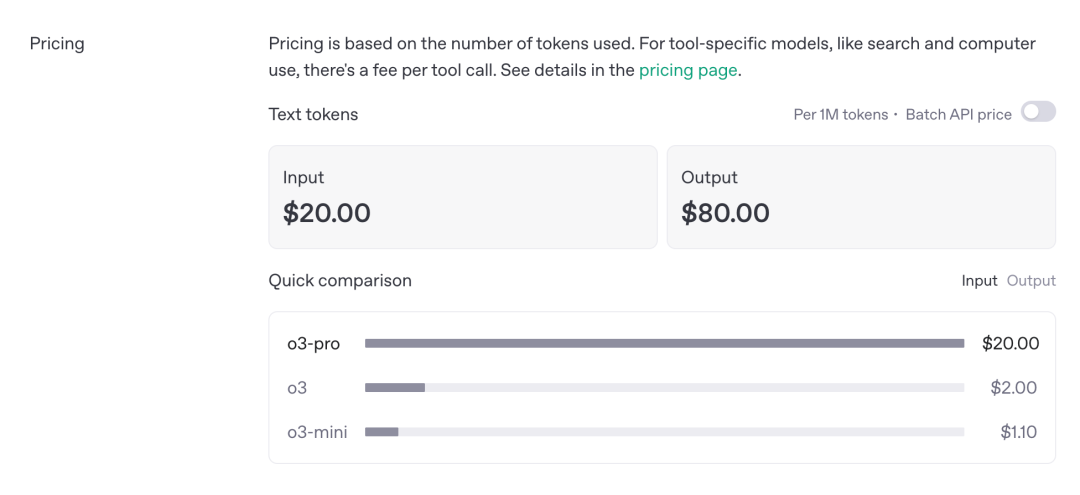

输入令牌:每 100 万令牌 20 美元

-

输出令牌:每 100 万令牌 80 美元

输出令牌价格更高,因为生成响应需要更高的计算资源。作为对比,标准 o3 模型的输入令牌每 100 万 2 美元,输出令牌每 100 万 8 美元,而 o3-mini 成本更低,分别为 1.10 美元和 4.40 美元。o3-pro 的高价反映了其增强的推理能力和更高的计算需求。

此外,工具特定功能可能产生额外费用,例如文件搜索或图像生成,这些功能按调用次数收费。例如,通过 API 使用文件搜索工具或集成图像生成功能时,总费用将根据使用量额外增加。

o3-pro Batch API Pricing

对于高用量用户,OpenAI 提供批量 API(Batch API)选项,该功能通过异步处理请求实现成本优化。o3-pro 的批量 API 定价与标准费率一致:

-

输入令牌:每 100 万令牌 20 美元

-

输出令牌:每 100 万令牌 80 美元

这一方案非常适合需要大规模处理的应用场景,例如数据分析或批量内容生成。

企业及定制化定价

对于 API 使用量较大的企业,可与 OpenAI 协商定制化定价方案,其中可能包含用量折扣和增强技术支持。这些方案会根据项目规模量身定制,确保大规模部署时的成本效益。此外,OpenAI 还提供微调功能,允许开发者针对特定任务定制 o3-pro,但这将根据计算资源消耗产生额外费用。

折扣与可及性支持

为促进技术普及,OpenAI 为教育机构和非营利组织提供优惠费率。符合条件的机构可申请折扣,使 o3-pro 更适用于学术研究或社会影响力项目。此外,新用户或高用量用户也可能通过定期促销活动降低使用成本。

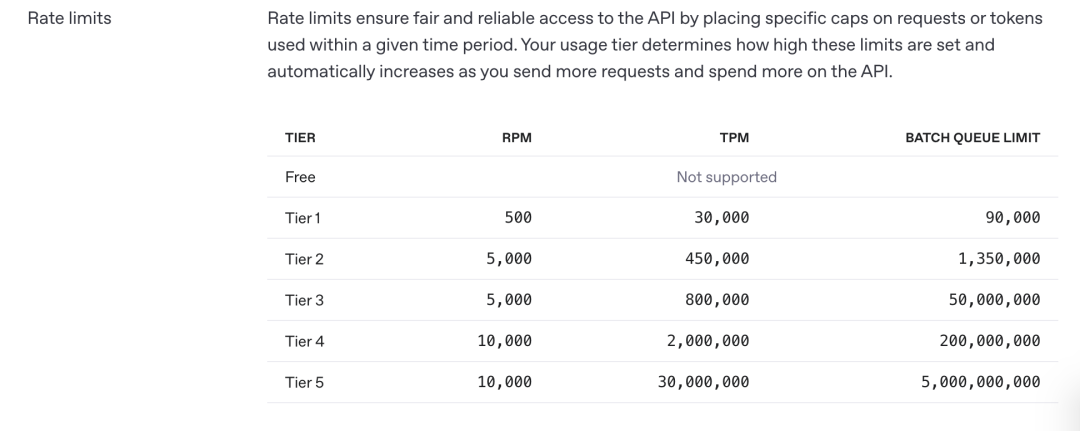

o3-pro 速率限制

速率限制是确保 API 访问公平性和可靠性的关键机制,它通过限制特定时间段内处理的请求数量或令牌量来实现。OpenAI 对 o3-pro 的速率限制会根据用户的使用层级动态调整,随着用户 API 调用量和消费金额的增加,限制阈值将自动提升。

以下是各层级及其相应限制的详细说明:

免费层级:o3-pro 不支持免费层级。

层级 1:

每分钟请求数(RPM):500 次

每分钟令牌处理量(TPM):30,000 tokens

批量队列限制:90,000 tokens

层级 2:

每分钟请求数(RPM):5,000 次

每分钟令牌处理量(TPM):450,000 tokens

批量队列限制:1,350,000 tokens

层级 3:

每分钟请求数(RPM):5,000 次

每分钟令牌处理量(TPM):800,000 tokens

批量队列限制:50,000,000 tokens

层级 4:

每分钟请求数(RPM):10,000 次

每分钟令牌处理量(TPM):2,000,000 tokens

批量队列限制:200,000,000 tokens

层级 5:

每分钟请求数(RPM):10,000 次

每分钟令牌处理量(TPM):30,000,000 tokens

批量队列限制:5,000,000,000 tokens

更高层级意味着更大的处理能力,开发者可借此应对更庞大的工作负载。其中,批量队列限制决定了可异步处理的令牌排队数量,这对使用 Batch API 的用户至关重要。这些限制机制在保障公平访问的同时,也能满足从小型应用到企业级解决方案的多样化需求。

o3 - pro API 的特性和限制

支持的端点

-

聊天完成(Chat Completions):用于处理聊天场景下的对话生成等任务。

-

响应(Responses):提供各种类型的响应输出,以满足不同的需求。

-

助手(Assistants):辅助完成各种任务,提供相关的帮助和支持。

-

批量(Batch):支持批量处理请求,提高处理效率,适合大规模任务。

-

微调(Fine - tuning):允许开发者根据特定任务对模型进行进一步调整和优化。

-

嵌入(Embeddings):将文本等数据转换为向量表示,以便于计算机处理和分析。

-

图像生成(Image Generation):能够生成图像。

-

图像编辑(Image Edit):对已有的图像进行编辑和修改。

-

语音生成(Speech Generation):将文本转换为语音输出。

-

转录(Transcription):将语音等音频内容转换为文本形式。

-

翻译(Translation):实现不同语言之间的文本翻译。

-

审核(Moderation):对输入的文本进行审核,检查是否符合相关规则和标准。

不支持的端点

-

实时(Realtime):可能由于模型计算量较大,无法满足实时性要求,所以不支持实时相关的功能。

-

完成(旧版)(Completions (legacy)):可能是旧版本的功能,已被新的功能所取代或不兼容当前模型设计。

特性

-

函数调用(Function Calling):支持与外部工具集成,通过调用外部函数来扩展模型的功能。

-

结构化输出(Structured Outputs):确保响应格式的一致性,便于后续的处理和分析。

-

工具(Tools):通过响应 API 支持文件搜索、图像生成和模型控制协议(MCP)。但不支持网络搜索、代码解释器和计算机使用。

限制

-

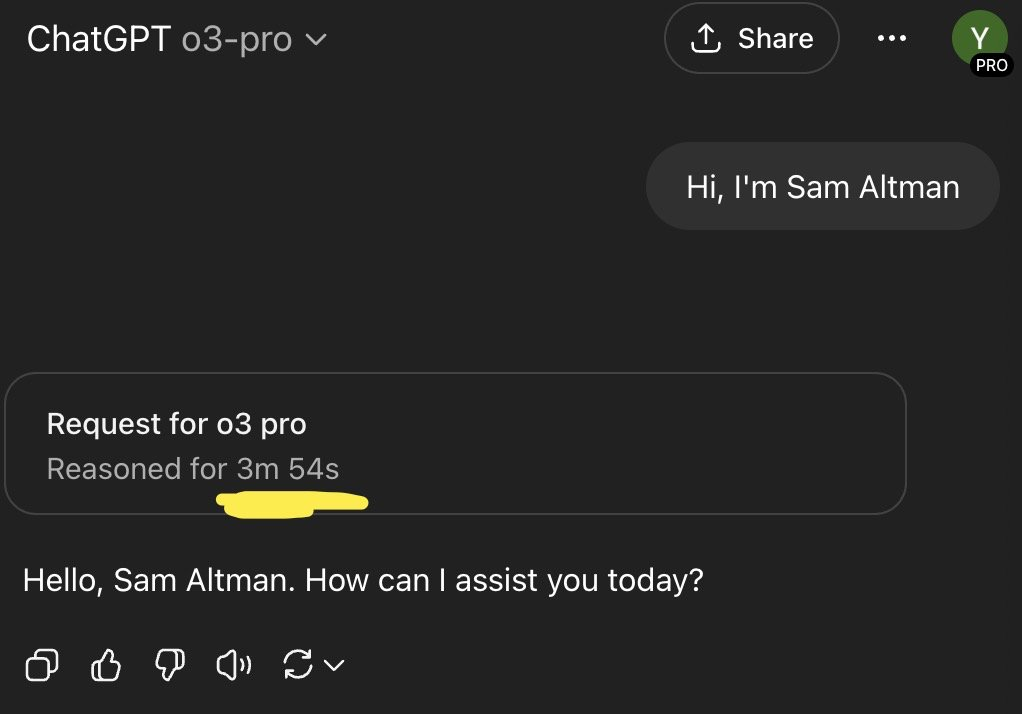

不支持流式传输(Streaming):因为模型处理速度较慢且注重准确性,所以不支持流式输出结果。

-

微调相关限制:可以进行微调,但不支持蒸馏或预测输出。

-

输入限制:不支持音频输入,仅接受文本和图像作为输入。

-

模型快照(Snapshots):像 o3 - pro - 2025 - 06 - 10 这样的快照,允许用户锁定特定的模型版本,以确保在生产环境中的性能一致性和稳定性。

结论

OpenAI 的 o3-pro 是一款强大的 AI 模型,在复杂推理任务中表现卓越,并在 2024 年 AIME 和 GPQA Diamond 等基准测试中展现顶尖性能。其定价策略(输入令牌每 100 万 20 美元,输出令牌每 100 万 80 美元)反映了模型对计算资源的高需求,而批量 API 和企业定制方案则为高用量用户提供了灵活选择。从层级 1 到层级 5 的动态速率限制机制,在保障公平访问的同时,可支持多样化的工作负载。

o3-pro 仅通过 Responses API 提供访问,其 20 万令牌的上下文窗口及对文件搜索、图像生成等工具的支持,使其成为开发者的多功能选择。尽管与 o3 和 o3-mini 相比,o3-pro 速度较慢且成本更高,但其无与伦比的推理能力使其成为解决最复杂 AI 任务的首选方案。随着 OpenAI 持续创新,o3-pro 不仅印证了先进 AI 技术的变革潜力,更推动着各行业及应用场景的突破性进展。

探索智能边界,发现无限可能!(AIOAGI.TECH)

更多推荐

已为社区贡献39条内容

已为社区贡献39条内容

所有评论(0)