简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

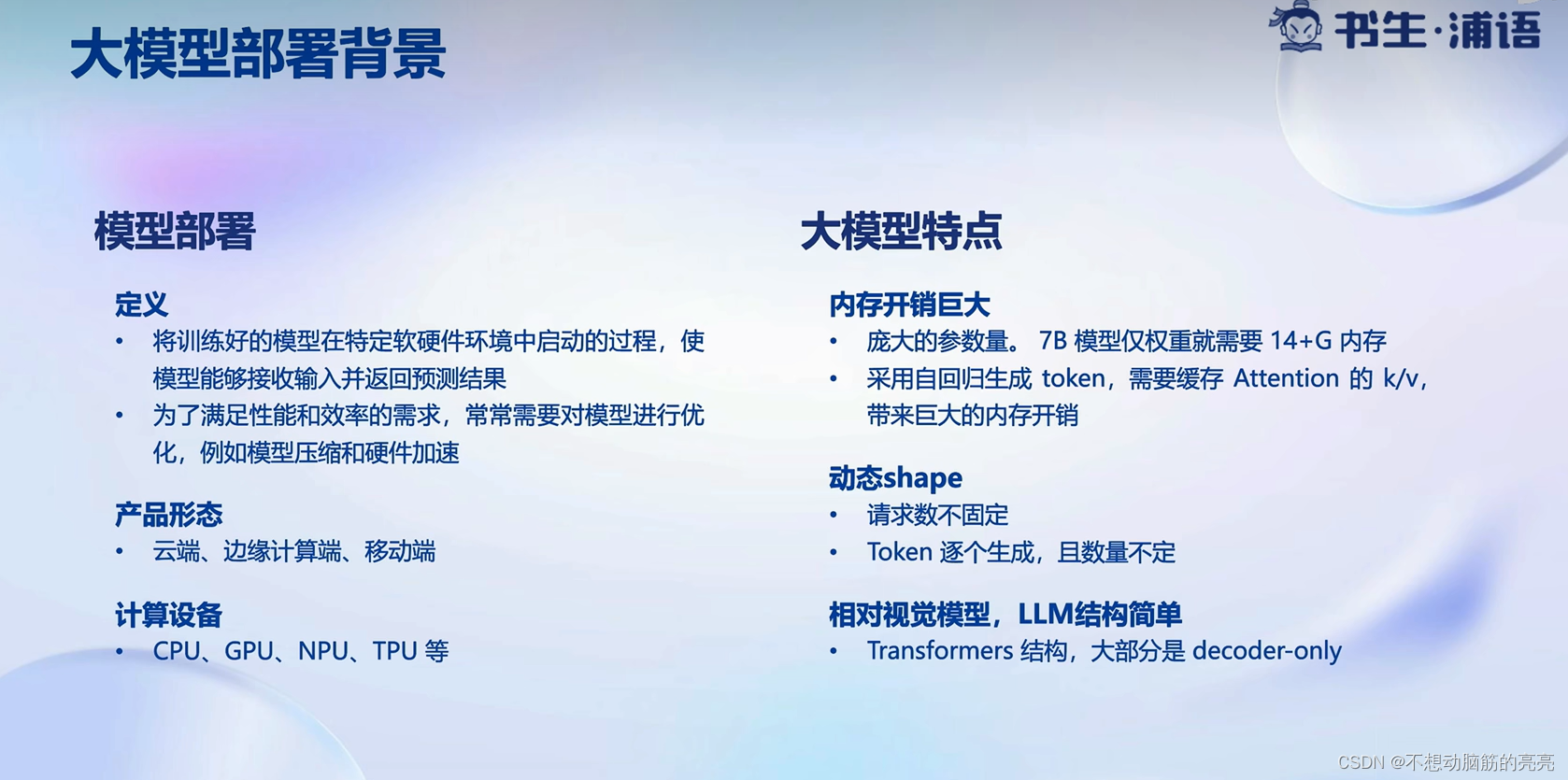

【书生·浦语】大模型实战营——LMDeploy 大模型量化部署实战

量化可以大大降低显存,同时提升推理速度。LLM 是典型的访存密集型任务。

【书生·浦语】大模型训练营——第三次课程作业

1. 在InternStudio上新建虚拟环境并安装所需依赖2. 拷贝模型internlm-chat-7b(也可以通过下载的方式)3. 下载词向量模型由于huggingface 下载速度可能有点慢,可以使用huggingface 镜像下载。4. 下载NLTK相关资源在使用开源词向量模型构建开源词向量的时候,需要用到第三方库nltk的一些资源。所以从国内仓库镜像地址下载相关资源,并保存到服务器上。

到底了