简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

他还表示他家的 Optimus 机器人可以变身猫娘、帮你接孩子、教孩子一切知识。未来量产Optimus 机器人的成本将低于一辆汽车,还讨论了未来战争形态、机器人数量比例等等。马斯克在直播玩大菠萝的切片视频中,预言 2026 年将实现AGI,并表示有1%概率我们的文明将直接Over。

产品搭载超级小爱 AI 助手,支持语音控制和智能交互,配备 1200 万像素摄像头可实现实时拍摄、记录和场景识别功能。现已发布开源权重,这是一个支持多模态(文本/音频/图像/视频)理解的大模型,仅需 2GB RAM 即可运行,也是第一个在 lmarena 上得分超过 1300 分的 10B 参数模型。Claude 推出 Artifacts Space,即在你创建了 Artifact 后,可以把这个

都在 modelscope 上有免费试用,FunAudioLLM 能够轻松与 LLMS 集成,能实现语音翻译、情感语音聊天、交互式播客和有声读物等。略差,不过强在开源了,并且现在你就可以直接用了!整体效果比起之前字节的。

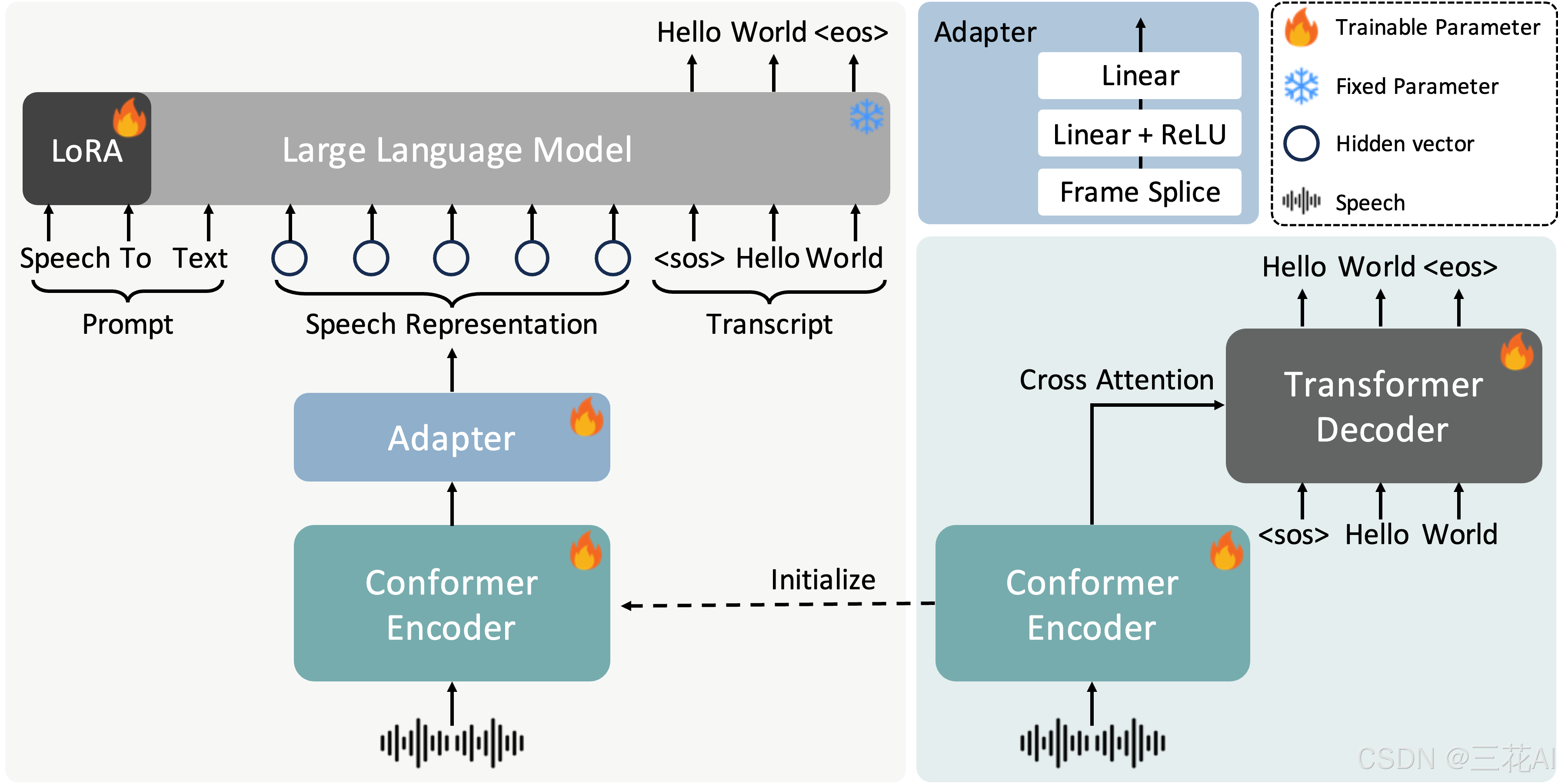

简单来说,FireRedASR 提供了两种不同的解决方案,一种追求极致的性能,另一种则在性能和效率之间找到平衡。目前代码和模型已经开源。是小红书开源的语音识别模型,支持识别普通话、方言和英文。

是京东健康开源的一个音频驱动的数字人头项目,它不仅支持唇形一致和表情控制,还能为动物生成数字头。这类技术在市场上非常多,有需求的读者可以在三花上搜索‘数字人’,不过真正落地的不多,JoyVASA 看起来是个不错的选择。

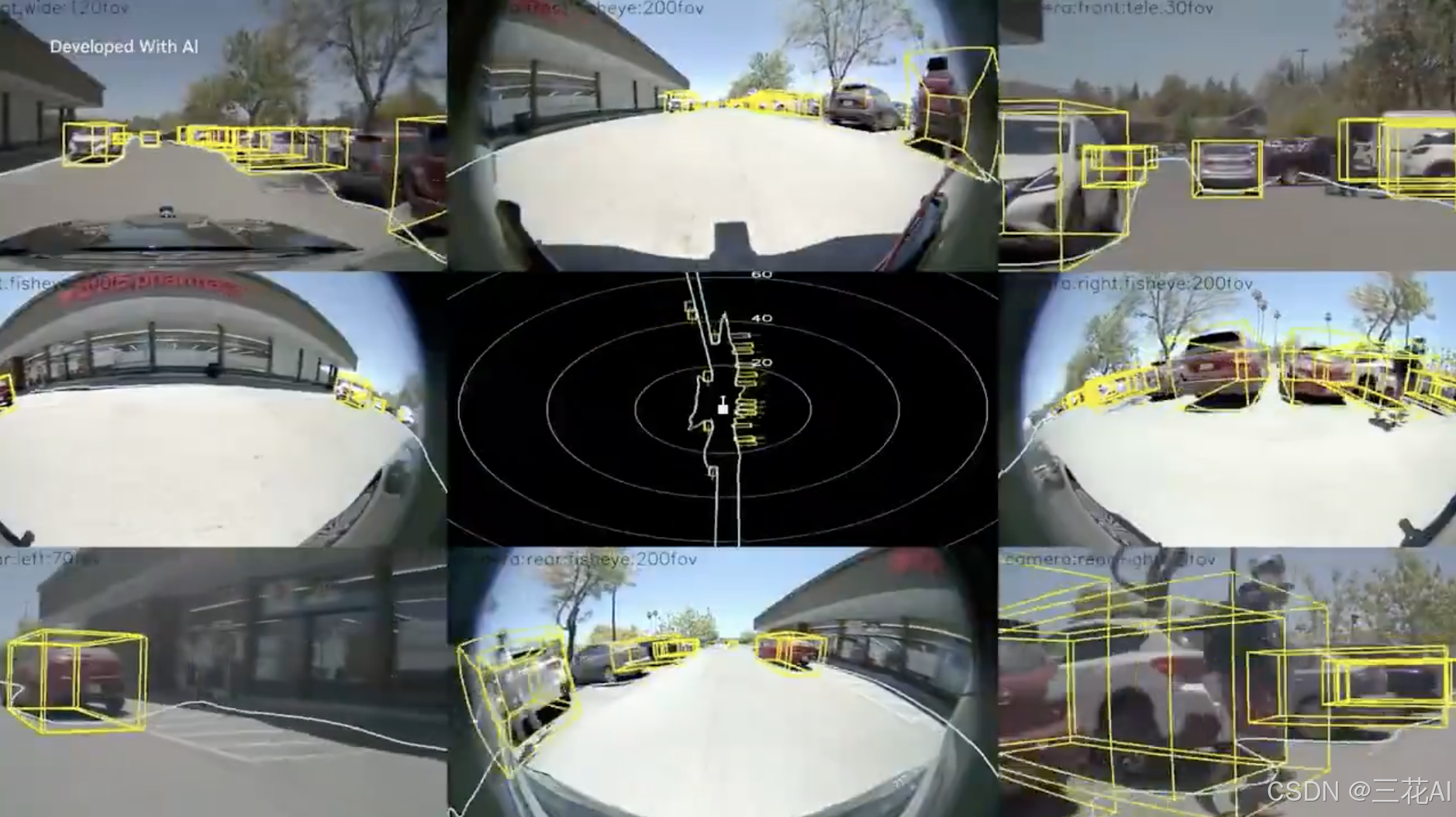

这模型支持文生视频和文+视频生视频,主要应用于机器人和自动驾驶领域的大规模合成数据生成。目前,英伟达已经开放了多个不同的预训练模型,这些模型均支持商业用途。,看看这个模型的实际效果如何。

是由字节豆包团队推出的图像编辑工具,它能够根据任何文本提示修改现有图像,并保持一致性。该工具支持多种功能,如局部替换、几何变换、重新打光、风格更改、表情编辑、文字替换、姿势修改以及局部擦除等。从演示视频和官方提供的演示来看,效果非常强大,你们可以。不过,我看了下代码实现,发现它调用了字节的 API,但目前这个 API 还没有公开申请的地方,期待后续的开放。

Qwen2 是对前一代 Qwen1.5 全面升级,它提供了多种尺寸的模型,支持更多语言,并在代码理解、数学解题等方面表现更加出色。千问 2 系列模型基本能够超越同等规模的最优开源模型甚至更大规模的模型,尤。其是代码及中文理解上,重回开源天花板模型。

火山引擎正式发布豆包视频生成模型 PixelDance 和 Seaweed,两款大模型均基于 DiT 架构,主要面向企业市场。字节跳动正式宣告进军 AI 视频生成领域,目前除了发布的演示外,没啥特别多的信息,不过可以关注字节的“即梦 AI” 公众号,发“内测”俩字来获取申请表单链接。我看好多人说比肩Sora,确实和Sora一样都用不上,要我说不如开源模型 Cog 来的实在,起码能用上。

NVIDIA 推出的 Describe Anything Model (DAM)[3] 是一款多模态大语言模型,它能够为图像或视频中的特定区域生成详细描述,支持通过点击、框选、涂鸦或遮罩等多种交互方式指定目标区域。OmniAvatar[1] 是阿里开源的一款基于 Wan 2.1 的音频驱动数字人模型。从目前已有的开源数字人模型来看,OmniAvatar 的表现算是相当出色了。EasyEdit[2]