简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

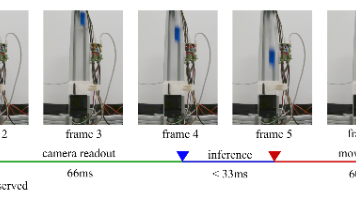

本文提出了一种在消费级GPU上实时运行视觉语言动作(VLA)模型的方法。通过CUDA图优化消除CPU开销、简化计算图减少冗余操作,作者将π0级VLA模型的推理延迟从100+毫秒降至27.3毫秒,实现了30Hz帧率和480Hz轨迹频率的实时控制。实验验证显示,优化后的模型在动态抓取任务中达到100%成功率。研究还提出了"全流式推理"框架,将VLA直接映射为完整的控制算法,突破了传

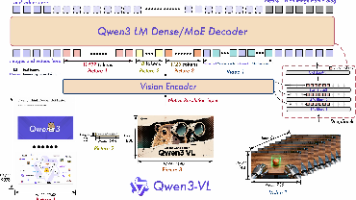

阿里千问团队2025年9月发布的Qwen3-VL模型在视觉理解能力上实现重大突破。该模型引入VL-Thinking视觉深度思维链,支持跨时空因果推理;采用MRoPE-Interleave位置编码和DeepStack技术,显著提升长视频理解与视觉细节捕捉能力;原生支持256K token上下文,可扩展至百万级,实现长文档和视频的精准处理。此外,模型在视觉编程(图像/视频生成代码)、3D空间感知(相对

今年十一7天假期期间,一半的时间都在改本博客内的上一篇文章《从Fast-UMI到Diff-Control:分别改进UMI的硬件及其所用的Diffusion policy(含ControlNet详解)》,改完之后,接下来计划要写的博客包括且不限于。然10.7日晚,又无意中看到了「UMI on Legs和Helpful DoggyBot」这两个工作,前者把UMI机械臂放到机器狗背上(适合我司之前去一个

在此文《》的1.1节开头有提到机器人收集训练数据一般有多种方式,比如Dexmv物理本体,有的翻译为embodiment38-Dexmv即embodiment-agnostic keypoint,49考虑到「从人类视频中学习」早已成为机器人的主流训练方法之一,故打算系统阐述以下这个课题,不然很多朋友可能只是理解其字面意思,但到底具体怎么个模仿学习,则不一定知其里,而通过本文系统的阐述,可以让大家更深

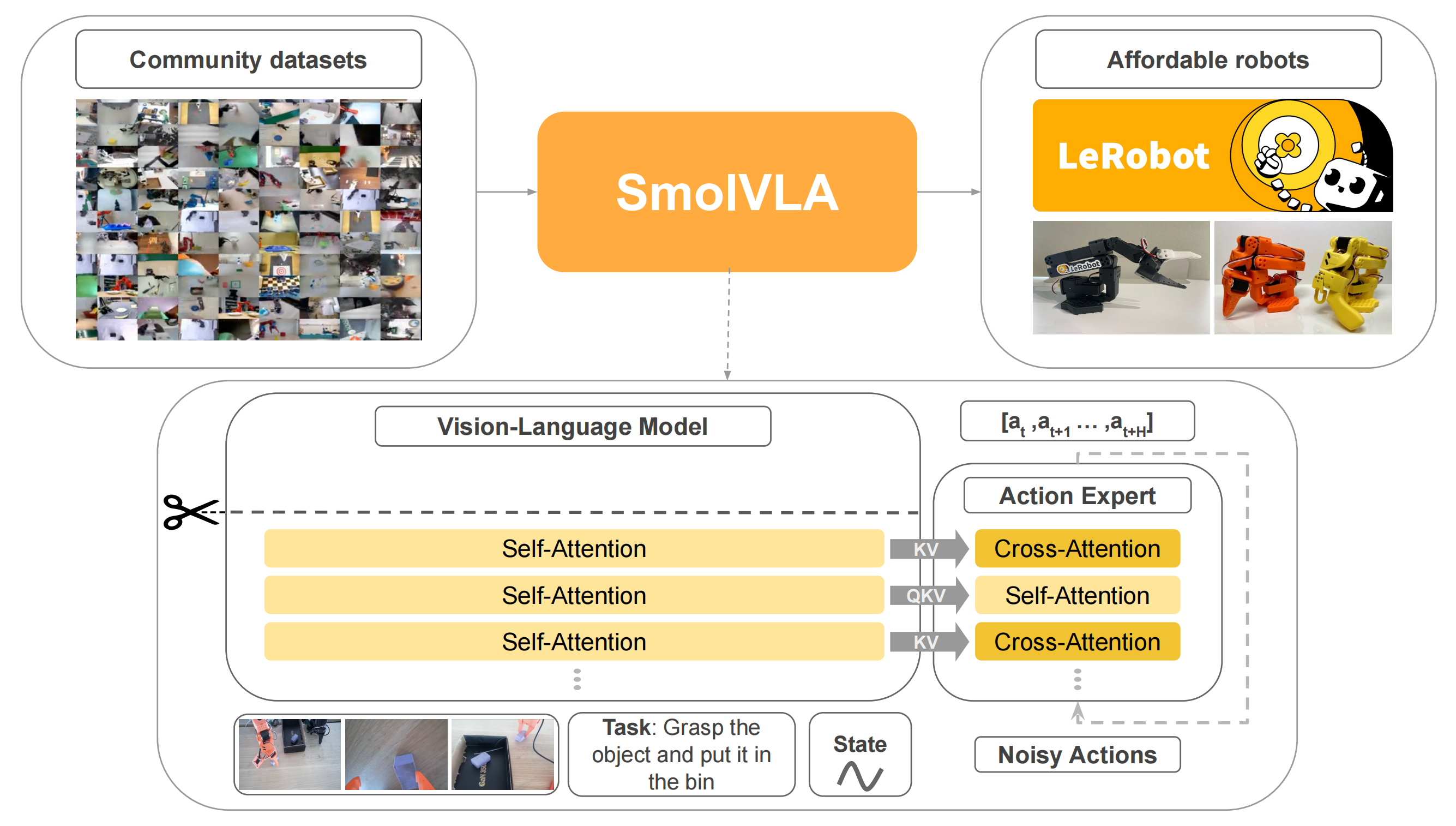

摘要:本文介绍了轻量级视觉-语言-动作模型SmolVLA的创新设计与应用。该模型通过优化架构(跳层处理、视觉token压缩、交错注意力机制)和流匹配动作专家,在消费级GPU上实现高效训练与CPU部署。使用不到3万个公开样本进行预训练后,其性能媲美更大规模VLA模型。异步推理架构将感知与动作预测解耦,显著降低延迟。相比传统VLA依赖昂贵硬件,SmolVLA为机器人领域提供了可复现、低成本的解决方案,

因为我司准备于25年7月底复现下NaVILA,而在研究NaVILA的过程中,注意到了这个NaVid虽然NaVid目前已经不是VLN sota了,但其首次展示了VLM在无需地图、里程计或深度输入的情况下,能够实现优秀的导航性能且对后来的很多VLN工作——比如NaVILA 都有比较大的启发、借鉴意义,且VLN论文中 其实提供了 “不少更好理解NaVILA” 的背景知识或基础,比如VLN-CE总之,如果

近年来,配备视觉能力的机器人控制模型引起了广泛的兴趣,比如7-RT-1,8-RT-2-将7D动作分解为离散的token,并使用VLM PaLI-X [13]像语言token一样自回归地预测它们30-Openvla-采用和RT-2类似的方法,对动作进行tokenizing,并在Open-X-Embodiment数据集[48]上训练Prismatic VLM其中,大规模视觉-语言-动作(VLA)模型的

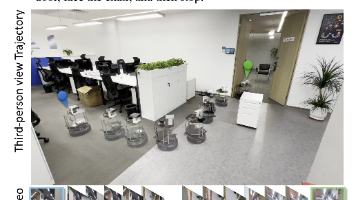

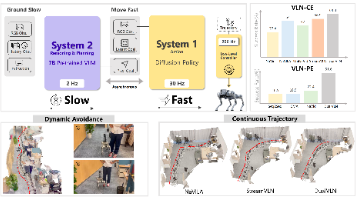

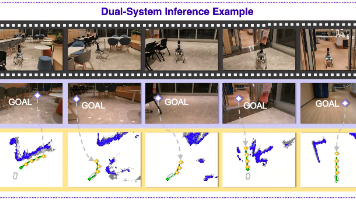

本文提出DualVLN,首个双系统视觉语言导航基础模型,将高层推理与实时控制解耦。System2作为大型VLM进行鲁棒推理并生成像素级目标,System1作为轻量级扩散策略模型将目标转换为连续轨迹。通过潜在表示连接两个系统,System2先训练后冻结,System1通过潜在查询提取特征。这种设计使System2能利用大规模数据扩展,System1专注于高频控制。实验表明该方法在动态环境中实现了精确

本文介绍了InternVLA-N1双系统视觉语言导航模型,该系统通过System2(基于多模态大语言模型的像素目标规划器)进行中长期规划,System1(基于扩散的轻量级视觉导航策略)执行实时路径规划。为解决双系统同步延迟和二维像素坐标歧义问题,模型引入了异步推理机制和潜在token表征,并通过世界模型增强潜在规划能力。研究团队还开发了高效仿真数据生成流程,构建了包含5300万图像和80万指令的大

本文详细解析了NaVILA/legged-loco代码库的技术实现,重点包括: 机器人配置系统:深入剖析了Go1/Go2四足机器人和G1/H1人形机器人的基础与视觉增强配置,特别是H1机器人在复杂地形中的视觉感知实现差异。 核心MDP组件:解析了分层控制架构(10Hz导航决策+50Hz运动执行)、三种导航动作实现(基础、VLM、GPT增强)以及多维度奖励函数设计(稳定性、能效、目标导向等)。 强化