简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

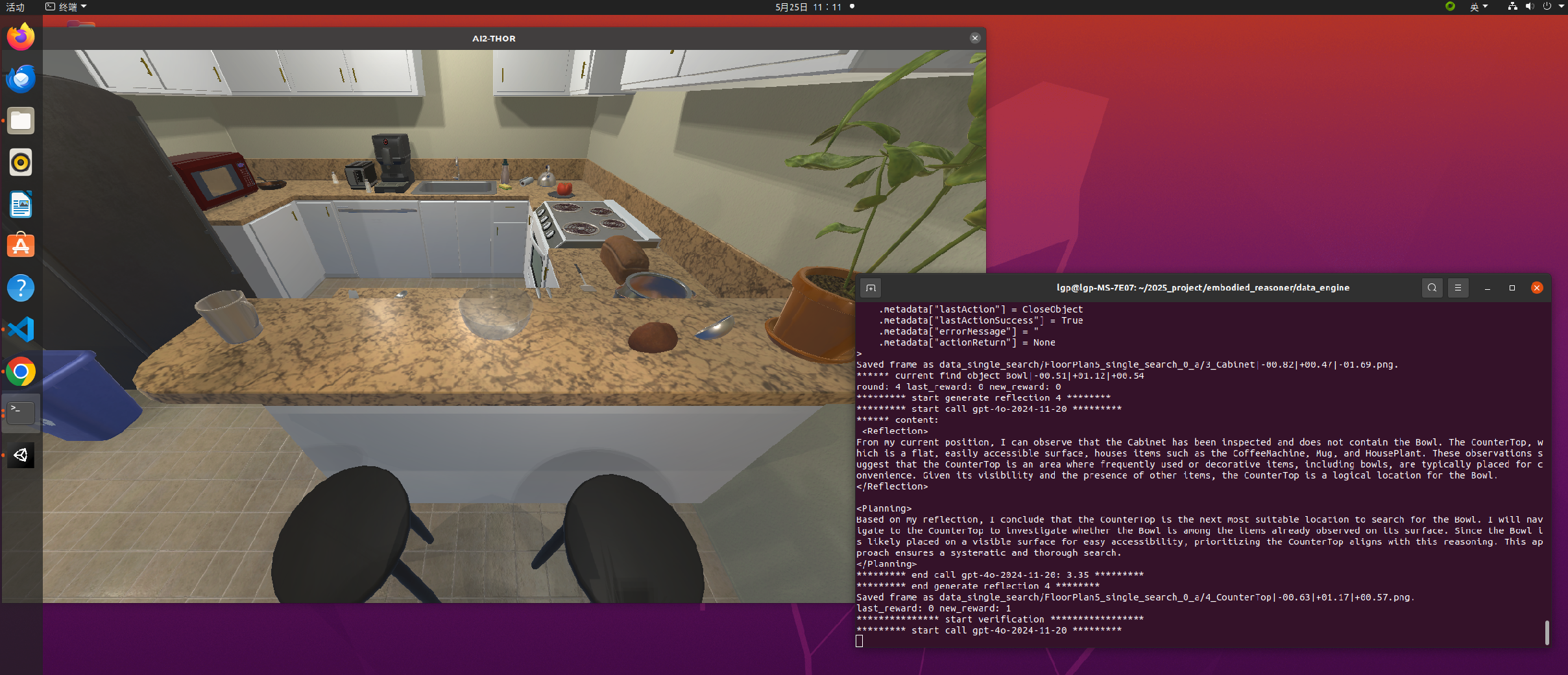

文章摘要 Embodied-Reasoner是一个多模态具身模型,扩展了深度推理能力至具身交互任务,支持AI2THOR仿真环境中的复杂操作(如物体搜索、搬运)。其核心能力包括:深度推理(分析/空间推理/规划)、多模态处理(图像-文本序列)及环境交互(自主探索)。复现流程涵盖环境配置(Conda+AI2Thor)、模型部署(通义千问权重)、任务合成(JSON模板生成)及轨迹生成(单/多步骤任务),并

HumDex 是一个面向人形机器人 全身灵巧操作的便携式遥操作系统。

OpenVLA-OFT:高效并行解码的连续动作生成方案 传统OpenVLA采用自回归解码和离散动作表示,存在效率低、精度差等问题。OpenVLA-OFT通过三大改进优化性能: 并行解码:将自回归改为单次前向传播生成动作分块,显著提升推理效率; 连续动作表示:直接输出连续动作向量,避免离散化带来的精度损失; L1回归目标:替换交叉熵损失,提升训练收敛速度和动作精度。 对比其他方法(如扩散建模和流匹配

本文介绍了基于Qwen3-VL模型的物体检测方法,支持批量检测指定类别物体并输出LabelMe格式标注文件和可视化结果。该方法利用Qwen3-VL视觉语言模型实现端到端检测,无需额外训练检测器,通过自然语言提示词约束模型输出。系统提供标准化输出和可视化功能,支持将检测结果自动转换为LabelMe标注格式,并设计了强容错的结果处理机制。文章详细介绍了transformers和vLLM两种实现版本,包

本文介绍了一个通用化的HuggingFace模型缓存处理工具,能够自动解析snapshot目录下的软链接,生成文件名到blobs真实文件的映射关系。该工具支持任意符合HF标准缓存结构的模型(包括多模态模型),无需硬编码文件哈希/名称。提供两种处理模式:复制文件(保留元数据并验证完整性)或创建软链接(节省磁盘空间)。通过命令行参数可灵活指定源目录和目标目录,自动处理包括模型权重、配置文件、分词器等所

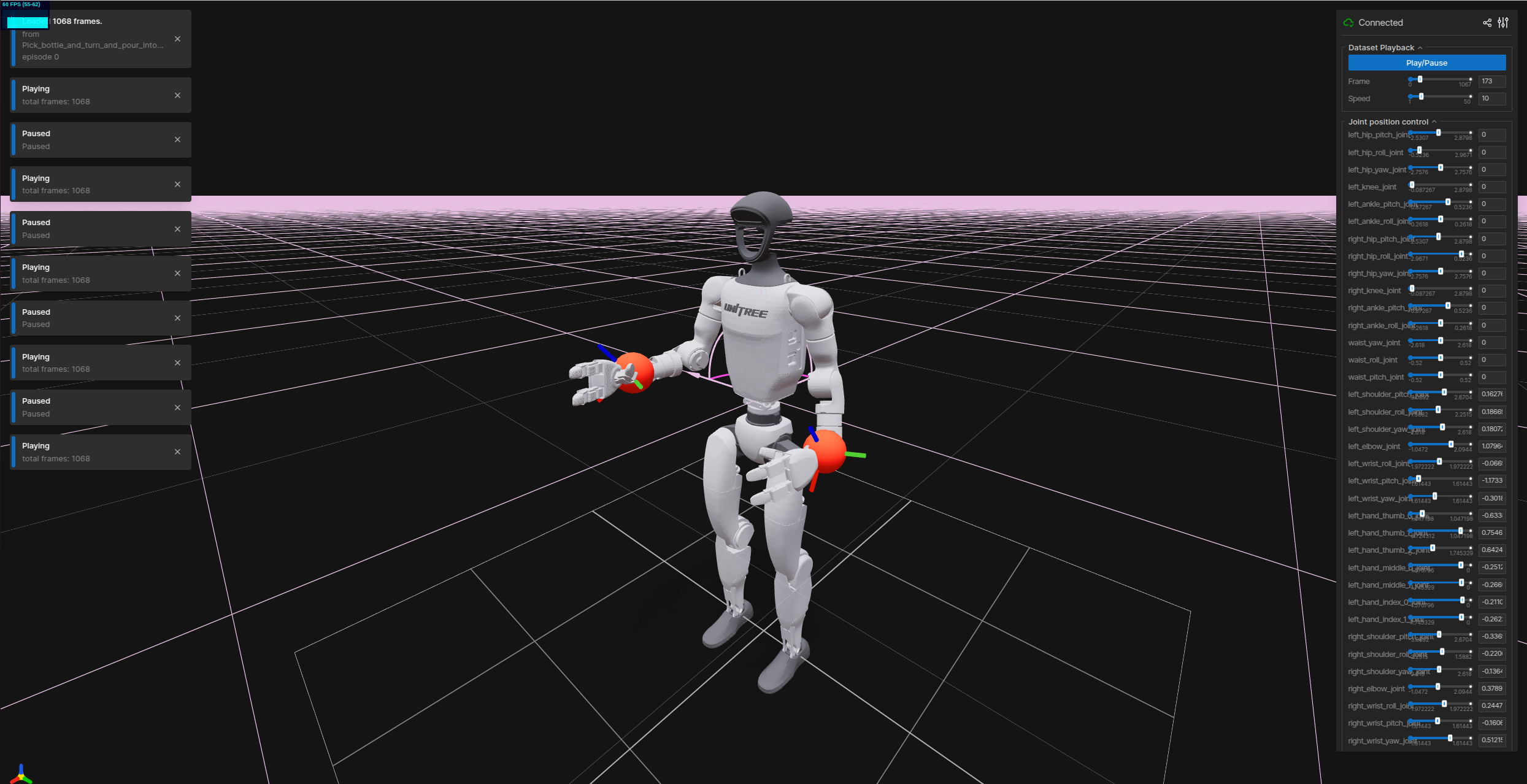

本文介绍了使用开源项目Psi0训练Unitree G1人形机器人的完整流程。首先详细说明了代码下载、uv安装和环境搭建步骤,包括Python依赖管理和虚拟环境配置。然后介绍了9个真实世界操作任务的数据集,包含双臂协调、精细操作等技能,并提供了批量下载脚本。文章还展示了数据可视化方法,通过修改代码解决兼容性问题。最后详细描述了模型微调和离线推理过程,包括模拟数据和真实数据的处理方式,提供了完整的推理

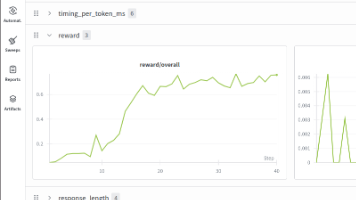

本文介绍了使用EasyR1框架对Qwen3-VL模型进行强化微调的完整流程。EasyR1是LLaMA-Factory作者开发的强化学习框架,支持多种强化学习方法。文章详细说明了从代码获取、环境配置到具体训练的操作步骤,包括创建conda环境、安装依赖库、配置训练脚本等关键环节。重点展示了数学推理强化训练示例,涉及奖励函数定义、提示词格式设置和训练脚本编写。同时提供了自定义训练的建议,包括准备奖励函

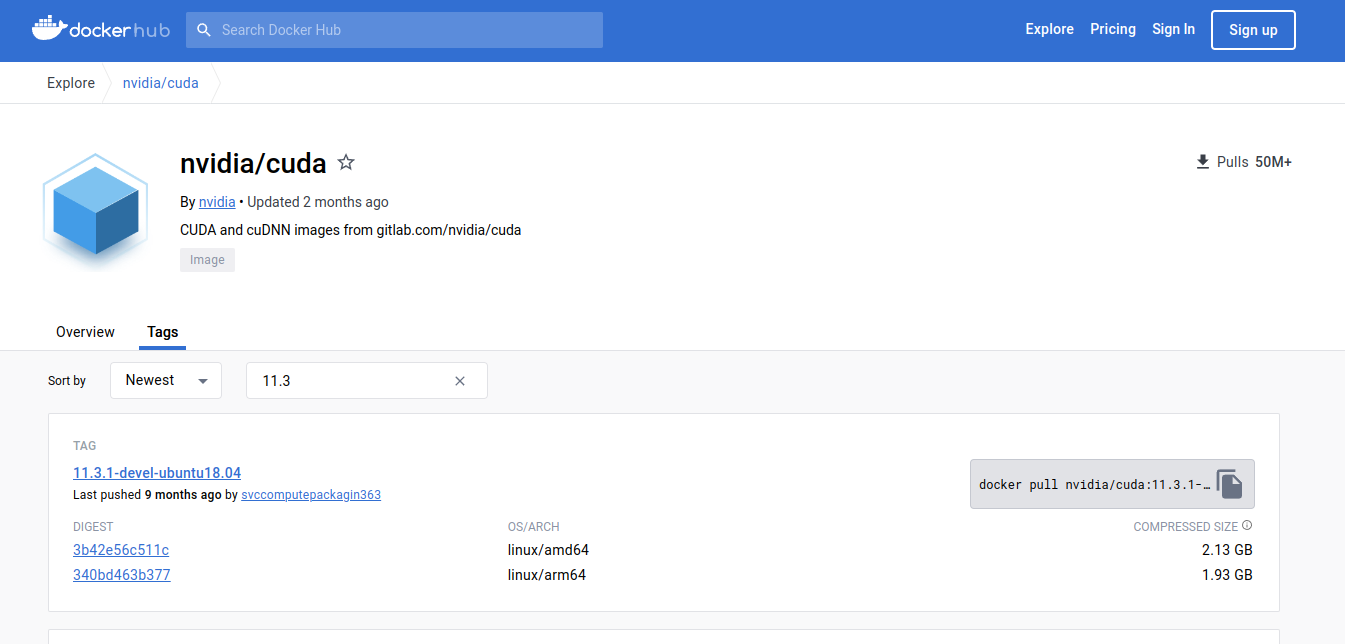

本文分享如何使用docker获取Nvidia 镜像,包括cuda10、cuda11等不同版本,cudnn7、cudnn8等,快速搭建深度学习环境。

前言本文记录docker保存镜像、打包tar、加载tar镜像。一、docker保存镜像作用:在现在容器镜像上保存镜像进行打包,在另一台服务上使用;或现有的容器安装了一些库,配置了开发环境,需要保存下载,下次加载后直接使用。1.1 首先查看下现有容器镜像(目的是查询需要保存镜像的ID)docker ps -a1.2 接下来用commit参数进行保存镜像(精简版)docker commit7ca736

下面的内容适合于初学者更好地对 不同的神经网络模型 能形象的了解。官网地址:http://playground.tensorflow.org/下图是主界面:参数说明:1)Problem type 问题类型(是分类问题,还是回归问题,可以选择)classification 分类regression 回归2)Epoch 迭代次数...