简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

基于Ollama部署的本地化OpenClaw指北

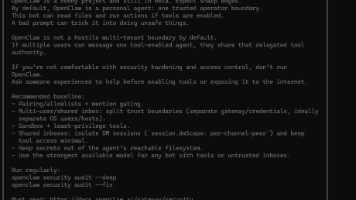

本文介绍了通过Ollama部署本地大模型的完整流程:1)安装Ollama;2)根据硬件配置选择并下载大模型(推荐deepseek-r1:7b);3)定制模型参数扩展token窗口;4)安装配置OpenClaw及飞书机器人。重点指出:1)需手动扩展模型token窗口至32768;2)OpenClaw安装时需注意模型兼容性问题;3)虽然流程正确,但实际部署时需选择兼容性更好的模型替代deepseek-

基于Ollama部署的本地化OpenClaw指南

本文详细介绍了使用Ollama部署本地大模型Qwen3-4B并接入OpenClaw的完整流程。主要内容包括:1)通过Ollama下载和定制模型,扩展Tokens至32K;2)安装Node.js和OpenClaw,完成初始化配置;3)选择Custom Provider对接本地Ollama服务;4)配置飞书机器人,设置权限和事件回调;5)最终完成授权实现正常对话。整个过程涉及模型定制、服务部署和飞书集

基于Ollama部署的本地化OpenClaw指南

本文详细介绍了使用Ollama部署本地大模型Qwen3-4B并接入OpenClaw的完整流程。主要内容包括:1)通过Ollama下载和定制模型,扩展Tokens至32K;2)安装Node.js和OpenClaw,完成初始化配置;3)选择Custom Provider对接本地Ollama服务;4)配置飞书机器人,设置权限和事件回调;5)最终完成授权实现正常对话。整个过程涉及模型定制、服务部署和飞书集

到底了