简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

我最近看到一个开源项目,第一反应不是模型又强了,而是这东西终于开始像个真正的工作台了。它叫 OmniVoice Studio。项目自己给自己的定位很直接,开源版 ElevenLabs 替代品。实时听写、零样本声音克隆、电影级视频配音,都在本地桌面里跑。README 里写得更狠一点,开源、不需要 API Key、完全本地,还支持 646 种语言。坦率的讲,看到这种描述,我第一反应一般会先打个折。因为

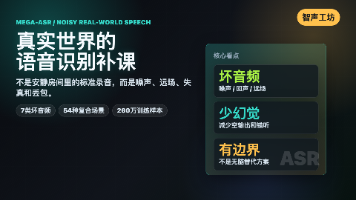

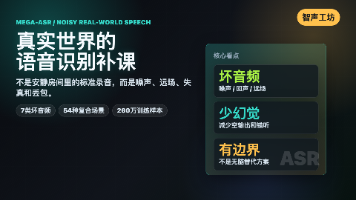

语音识别最尴尬的时刻,往往不是它完全听不懂,而是它一本正经地听错。这件事你只要用过几次转写工具,应该就能懂。安静房间里,麦克风离嘴很近,普通话或者标准英文,背景没有人说话,风扇也不开。这种条件下,今天很多 ASR 模型已经挺能打了。但你把它丢到真实世界里,情况立刻就不一样了。会议室里有人离麦克风三米远说话,咖啡馆里旁边桌一直聊天,手机录音被衣服蹭到,直播连线里网络一卡一卡的,音箱开得太大又带回声。

就在快要放弃的时候,点开了 C:\Users\23349.claude-code-router\config.json 看了一下配置文件,结果发现里面的 PROXY_URL 字段为空,难怪出现这种问题,重新配置 “PROXY_URL”: “http://127.0.0.1:7890” 之后就没问题了。最近使用ccr(claude code router )的时候总是显示claude模型无法使用,前

语音识别最尴尬的时刻,往往不是它完全听不懂,而是它一本正经地听错。这件事你只要用过几次转写工具,应该就能懂。安静房间里,麦克风离嘴很近,普通话或者标准英文,背景没有人说话,风扇也不开。这种条件下,今天很多 ASR 模型已经挺能打了。但你把它丢到真实世界里,情况立刻就不一样了。会议室里有人离麦克风三米远说话,咖啡馆里旁边桌一直聊天,手机录音被衣服蹭到,直播连线里网络一卡一卡的,音箱开得太大又带回声。

语音翻译这件事,最怕的不是翻不出来,而是翻得像一个没在现场的人。这句话听着有点绕,但你稍微想一下就懂了。一个人在泰国餐厅点菜,服务员指着菜单说了一串泰语。你如果只拿到声音,当然也能翻译。但菜单上写着什么,服务员手指着哪一道菜,桌上到底摆着什么,这些东西都会影响翻译。再比如电商直播,主播嘴里说的是一个型号,手里拿的是另一个商品,屏幕上还有一串参数。你只听音频,很容易把数字、规格、品牌名搞混。

我最近看到一个开源项目,第一反应不是模型又强了,而是这东西终于开始像个真正的工作台了。它叫 OmniVoice Studio。项目自己给自己的定位很直接,开源版 ElevenLabs 替代品。实时听写、零样本声音克隆、电影级视频配音,都在本地桌面里跑。README 里写得更狠一点,开源、不需要 API Key、完全本地,还支持 646 种语言。坦率的讲,看到这种描述,我第一反应一般会先打个折。因为

一个99兆级别的TTS项目,居然把网页、电子书和树莓派都串起来了。我一开始看 Supertonic 3,只以为它又是一个“开源TTS模型更新”。但看完 README 里的几个 demo,我觉得它更像是在回答另一个问题:TTS 到底能不能从云端服务,真正长进设备里?这个问题挺关键。因为很多语音合成项目的 demo 很好听,但你真要把它放进浏览器插件、移动端应用、阅读器、树莓派这种设备里,立刻就会碰到

有人把 Whisper 做到了 89ms 中位延迟,还顺手把 GPU 峰值内存砍掉 48%。我第一眼看到这个数据的时候,其实有点不敢太兴奋。因为做实时语音识别的人都知道,Whisper 是一个特别拧巴的存在,它离线转写很好用,效果稳,生态也成熟,但你真想把它塞进实时字幕、会议助手、语音 Agent 这种场景里,它马上就会暴露一堆不舒服的地方。不是它不能用,而是它不是为流式场景长出来的。你给它一段完

如果你要给学生或团队讲什么叫 speech-native omni,什么叫 Thinker-Talker 解耦,什么叫流式语音生成,拿一个小而完整的工程,比拿一个巨大的商业系统更适合。一个主干大概 0.1B 的小模型,居然把文本、语音、图像输入,文本和流式语音输出,实时打断,音色条件,电话模式 WebUI,这一整套 Omni 链路都摆出来了。但问题是,如果你不是想调 API,而是想从第一行代码开始

闽南语这个数字看起来仍然不低,但你把它放到其他模型旁边看,差距就出来了,Qwen3-ASR-0.6B 是 38.64%,FunASR-Nano-2512 是 55.36%。Dolphin-CN-Dialect 把中文改成字符级建模,英文和字母语言继续用 BPE subword,同时加入任务 token、时间戳 token、方言和地区 token,还预留了 80 个方言 token slot。真实中