简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

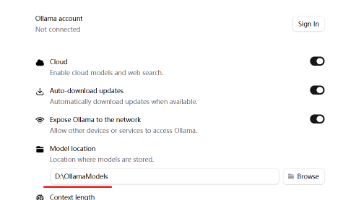

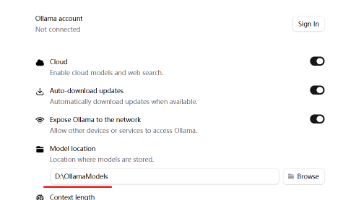

本文介绍了Ollama模型下载及环境配置方法。首先指导用户更改模型存放位置到固态硬盘,然后详细说明如何查看和下载可用模型。接着提供两种配置环境变量的方式:通过图形界面和PowerShell命令,并给出验证环境变量是否生效的方法。最后说明如何测试Ollama API的连接状态,确保OpenClaw能够正常访问模型服务。全文提供了完整的配置流程和验证步骤,帮助用户顺利完成Ollama模型的安装与设置。

本文介绍了Ollama模型下载及环境配置方法。首先指导用户更改模型存放位置到固态硬盘,然后详细说明如何查看和下载可用模型。接着提供两种配置环境变量的方式:通过图形界面和PowerShell命令,并给出验证环境变量是否生效的方法。最后说明如何测试Ollama API的连接状态,确保OpenClaw能够正常访问模型服务。全文提供了完整的配置流程和验证步骤,帮助用户顺利完成Ollama模型的安装与设置。

本文提供了OpenClaw的详细安装与配置指南,涵盖Windows和Linux环境下的两种安装方式。Windows用户可通过PowerShell执行官方命令直接安装,Linux用户需通过WSL子环境配置Node.js后安装。安装完成后需进行模型设置(推荐Qwen模型)、通道选择和钩子配置。首次启动需通过命令行获取token解决离线问题。文章特别提醒谨慎通过网页端修改配置,建议备份原始JSON文件,

本文介绍了在WSL2环境下安装OpenClaw(国内版)的完整流程。首先需更新Ubuntu环境并安装Node.js 22(通过nvm国内镜像安装)。然后提供两种OpenClaw安装方式:推荐使用国内一键脚本安装,也可选择手动安装依赖和源码。安装后需检查依赖并通过浏览器访问localhost:18789,首次登录需使用终端获取的token链接。最后在网页端配置模型供应商和API信息即可完成设置。整个

agenticSeek从头到尾部署及报错修改

agenticSeek从头到尾部署及报错修改