简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

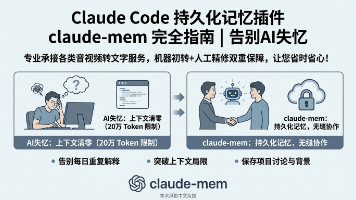

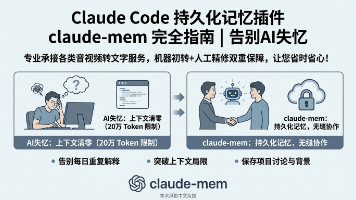

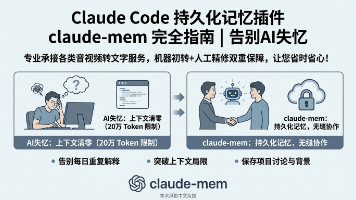

Claude Code终于有了长期记忆!claude-mem项目彻底解决AI编程助手的“失忆症”,通过持久化记忆系统自动捕获对话上下文,让Claude能记住跨会话的工作内容。它采用渐进式披露和智能搜索,支持自然语言查询历史,并提供可视化Web界面管理记忆。无需API密钥,安装简单,隐私可控,是提升开发效率的必备工具。

2021年,达里奥·阿莫代因AI安全理念分歧离开OpenAI,创立Anthropic。三年后,公司估值飙升至3800亿美元,其核心产品Claude在企业AI市场占据近29%份额,编程工具Claude Code创下软件史上前所未有的增长纪录。这一切源于独特的“宪法AI”技术路线,一段卷入加密货币诈骗案的融资往事,以及一次拒绝接管800亿美元AI帝国的冷酷决策。本文从技术原理、商业策略、行业格局三个维

OpenAI Codex 是一款强大的AI编程Agent,不仅能进行代码补全,还能独立执行任务、自动测试和全链路重构。本文详细介绍了Codex的安装配置、AGENTS.md规范编写、MCP服务开发与集成、Skill技能包搭建,并通过旅游攻略网站开发和企业级管理系统重构两个实战项目,展示了Codex在实际工程中的全流程应用。无论你是经验丰富的开发者还是技术爱好者,都能通过本指南快速上手,并利用Cod

Claude Code终于有了长期记忆!claude-mem项目彻底解决AI编程助手的“失忆症”,通过持久化记忆系统自动捕获对话上下文,让Claude能记住跨会话的工作内容。它采用渐进式披露和智能搜索,支持自然语言查询历史,并提供可视化Web界面管理记忆。无需API密钥,安装简单,隐私可控,是提升开发效率的必备工具。

Claude Code终于有了长期记忆!claude-mem项目彻底解决AI编程助手的“失忆症”,通过持久化记忆系统自动捕获对话上下文,让Claude能记住跨会话的工作内容。它采用渐进式披露和智能搜索,支持自然语言查询历史,并提供可视化Web界面管理记忆。无需API密钥,安装简单,隐私可控,是提升开发效率的必备工具。

OpenAI Codex 是一款强大的AI编程Agent,不仅能进行代码补全,还能独立执行任务、自动测试和全链路重构。本文详细介绍了Codex的安装配置、AGENTS.md规范编写、MCP服务开发与集成、Skill技能包搭建,并通过旅游攻略网站开发和企业级管理系统重构两个实战项目,展示了Codex在实际工程中的全流程应用。无论你是经验丰富的开发者还是技术爱好者,都能通过本指南快速上手,并利用Cod

Ocbot是一款深度定制Chromium内核的AI原生浏览器,将AI智能体直接嵌入内核,实现自主浏览网页、操作界面和提取数据。其核心亮点是“自愈工作流”,当网站改版时能通过视觉理解自动修复执行路径,无需人工干预。支持切换Gemini、GPT-4、Claude等主流大模型或本地私有化部署,数据由用户掌控。相比OpenClaw等方案更轻量,适合需要浏览器自动化的用户,能处理批量数据采集、自动填表、网页

2021年,达里奥·阿莫代因AI安全理念分歧离开OpenAI,创立Anthropic。三年后,公司估值飙升至3800亿美元,其核心产品Claude在企业AI市场占据近29%份额,编程工具Claude Code创下软件史上前所未有的增长纪录。这一切源于独特的“宪法AI”技术路线,一段卷入加密货币诈骗案的融资往事,以及一次拒绝接管800亿美元AI帝国的冷酷决策。本文从技术原理、商业策略、行业格局三个维

谷歌DeepMind开放Project Genie试用,其核心Genie 3是世界模型里程碑,能根据文字描述实时生成可交互的3D环境,用户可自由探索。文章详解了其技术原理、操作流程、应用前景,并与Sora等模型对比,指出这标志着AI从“理解”到“创造”的关键跃迁。

人工智能的浪潮正以前所未有的速度重塑世界,而支撑这一变革的核心动力,正是那些参数规模动辄千亿、万亿的“大模型”。无论是ChatGPT的对话生成,还是Stable Diffusion的图像创作,这些惊艳表现背后都离不开一场关乎计算与存储的“隐形战争”——如何让海量数据在成千上万块GPU之间高效流动?如何让存储系统跟上指数级增长的模型规模?本文将深入揭秘大模型训练背后的存储架构革命,从千卡GPU集群的