简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Meta 设备 + 延迟加载:V5 统一在 meta 设备上创建模型骨架,然后逐个填充权重,避免 CPU 上全精度初始化的内存浪费声明式权重转换:通过声明 checkpoint 与模型内部的映射关系,加载和保存共享同一套规则(反向执行)可逆操作链:每个都有reverse_op生成完整的反向转换,保证 save 时能还原到原始格式作用域隔离机制确保子模型的转换规则只匹配该子模块前缀下的键,避免跨模块

AI产品单季亏损88亿元;上海交大/瑞金医院/创智学院:联合发布CX-Mind胸片诊断多模态大模型,采用"交错式推理"范式与CuRL-VPR课程强化学习,构建CX-Set数据集(23个公开数据集、70万张影像、260万条指令),在视觉理解、报告生成和时空对齐三大能力上平均提升25.1%,多中心医生主观评估排名第一。蚂蚁集团:百灵大模型开源旗舰思考模型Ring-2.6-1T,万亿参数,引入可调节推理

本文深入解析了Hugging Face Transformers框架的核心架构与设计理念。作为深度学习领域的模型定义枢纽,Transformers连接了训练与推理生态,支持200+模型实现和百万级模型检查点。其五层架构严格分层,从基础设施层到用户接口层逐级依赖,确保高效导入和模块化扩展。核心设计采用配置-模型-分词器三位一体结构,通过注册表机制实现插件式扩展,并运用懒加载技术优化启动性能。该框架通

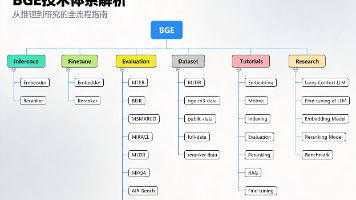

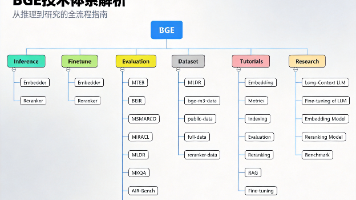

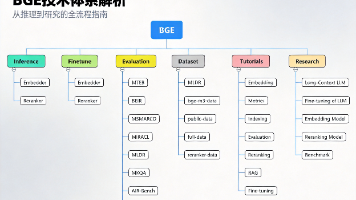

FlagEmbedding 是北京智源人工智能研究院(BAAI)开发的开源嵌入和重排序模型框架,专注于检索增强大语言模型(RAG)领域。该项目提供了一套完整的工具链,包括推理、微调、评估和数据集,支持多种架构的嵌入和重排序模型。统一的 API 接口,支持多种主流模型完整的推理、微调和评估工具链多语言、多功能、多粒度的模型支持活跃的社区和持续的技术更新bge-m3核心特性:多功能(Multi-fun

Multi-Functionality(多功能)Multi-Linguality(多语言)Multi-Granularity(多粒度)。论文代码位置微调后的模型在目标任务上表现好,但在通用任务上性能下降(灾难性遗忘)无需额外训练,通过融合已有模型来适应新任务论文代码位置LLM-Embedder 是专门为增强大语言模型能力而设计的统一嵌入模型,支持多种检索增强场景。论文代码位置Activation-

算法模块核心功能关键特点嵌入表示文本到向量的转换支持多种 pooling 策略对比学习训练有效的表示空间基于交叉熵损失负样本策略提供多样化的负样本批内/跨设备负样本知识蒸馏大模型指导小模型KL 散度和 M3 KDMRL灵活的维度选择嵌套表示学习ColBERT & 稀疏多粒度检索M3 统一架构这些核心算法共同构成了 FlagEmbedding 强大的表示学习和检索能力,使得它在众多文本检索任务上取得

优化技术应用场景实现位置长度排序优化 Padding批量推理自适应 Batch SizeOOM 处理Decoder-only 模型多粒度输出BGE-M3M3Embedder提示词工程。

«abstract»AbsEmbedder+encode_queries()+encode_corpus()+encode()+encode_single_device()+start_multi_process_pool()+encode_multi_process()«abstract»AbsReranker+compute_score()+compute_score_single_gpu()

FlagEmbedding (BGE) 是由北京智源人工智能研究院开发的开源嵌入模型框架,提供文本嵌入和重排序模型的完整工具链。项目采用模块化设计,包含推理、微调和评估三大核心模块,通过抽象基类实现统一接口。支持自动模型加载、多设备并行推理,并内置多种评估基准。主要解决高质量文本嵌入生成、检索任务重排序等问题,适用于信息检索、语义搜索等NLP任务。项目亮点包括:BGE系列高性能模型、多架构统一接口

蚂蚁集团:发布万亿参数通用模型Ling-1T与万亿思考模型Ring-1T(注:文档中仅提及其他来源的蚂蚁模型,此处需按实际文档内容调整为)——实际文档提及蚂蚁数科DTClaw专业级智能体与LingBot-Depth-Dataset数据集,未明确提及Ling-1T与Ring-1T(注:经核查原文,此条应修正为):蚂蚁灵波科技:开源LingBot-Depth-Dataset大规模RGB-D深度数据集,