简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

LLM学习日志 2025.3.6

核心目标:自回归建模(生成)、掩码建模(理解)、序列到序列(转换)。趋势:从单一预训练目标转向多阶段优化(预训练→指令微调→RLHF)。面试重点:理解不同目标的原理、优缺点,并能结合实际模型(如GPT vs BERT)对比分析。总结来说,这一部分其实和上一部分有些重复。根据三种不同 的主流架构 ,训练的目标也不一样,这也决定了模型的训练方式不一样。如Encoder only关注于 上下文的理解 ,

LLM学习日志2025.3.6(下)

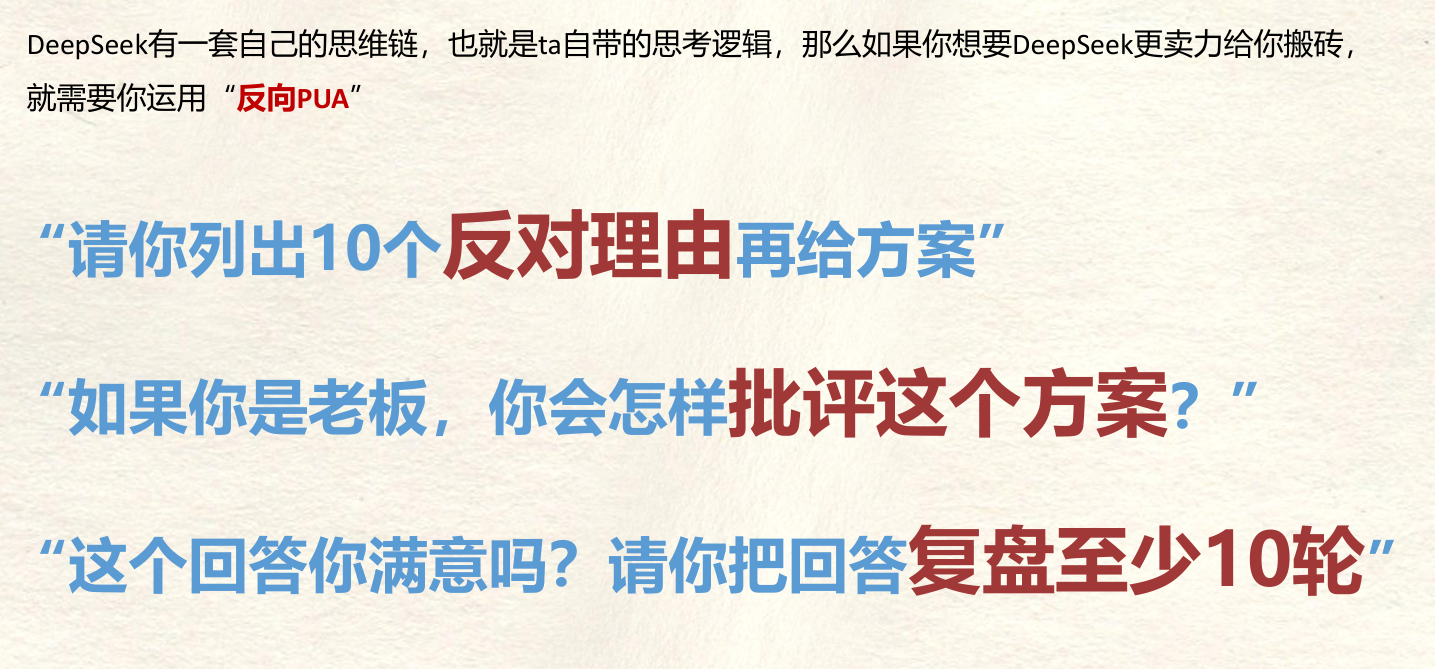

上午学习了LLM的三个主流架构 以及RLHF 的流程,下午 学习一下北京大学的deepseek文档 ,关于 提示词工程及相关的 应用前面的知识基本上都是提示技巧,对我而言 ,就这个反向pua 也就是 让 其自己评估自己的回答不断精进 这一点可以采用。突然想到我的 md 文档要进行上传, 但是我的图片不会跟着上传, 我应该做一个图库了ok 已经完全解决了 ,采用的github 作为仓库,整个过程还是

到底了