简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

基于LazyLLM的简单文献整理助手

LazyLLM是商汤大装置推出的开源、低代码的大模型应用开发框架。核心特点低代码开发:开发者只需用低至10行左右的代码,就能构建复杂、定制化的多Agent大模型应用,大大降低了AI应用的开发门槛。数据流驱动:采用以数据流为核心的应用开发范式,可通过Pipeline、Parallel、Switch等数据流控制方式,灵活组织复杂的数据处理流程,像搭乐高积木一样快速构建AI应用原型。一键部署。

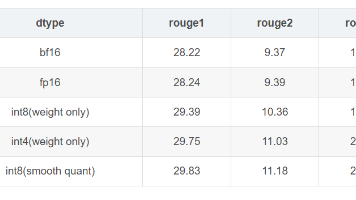

Tensorrt-llm的基础演示使用#TensorRTLLM 1.0实战#

本文介绍了TensorRT-LLM的快速安装部署方法。TensorRT-LLM是NVIDIA推出的开源大语言模型推理优化库,能显著提升推理速度并降低成本。文章详细讲解了在Ubuntu 22.04系统下使用conda创建Python 3.10虚拟环境,通过pip安装TensorRT-LLM及其依赖的完整流程,并提供了安装验证代码。最后展示了一个简单的使用示例,包括模型量化配置、加载量化模型以及文本生

基于LazyLLM的简单文献整理助手

LazyLLM是商汤大装置推出的开源、低代码的大模型应用开发框架。核心特点低代码开发:开发者只需用低至10行左右的代码,就能构建复杂、定制化的多Agent大模型应用,大大降低了AI应用的开发门槛。数据流驱动:采用以数据流为核心的应用开发范式,可通过Pipeline、Parallel、Switch等数据流控制方式,灵活组织复杂的数据处理流程,像搭乐高积木一样快速构建AI应用原型。一键部署。

到底了