简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

依托覆盖广泛的边缘算力节点,平台将 AI 推理与训练算力无限贴近用户侧部署,提供 GPU 实例、GPU 集群、云存储、AI 大模型市场及低延时专线等核心能力,助力客户快速构建安全、高性能的 AI 基础设施,实现大模型应用从开发到业务落地的全链路敏捷交付。另外,操作系统以上的环境仍需自行维护,服务商只保障"硬件通、网络通",上层的容器编排、训练框架安装、多卡任务调度,依然需要团队具备相应的运维能力。

依托覆盖广泛的边缘算力节点,平台将 AI 推理与训练算力无限贴近用户侧部署,提供 GPU 实例、GPU 集群、云存储、AI 大模型市场及低延时专线等核心能力,助力客户快速构建安全、高性能的 AI 基础设施,实现大模型应用从开发到业务落地的全链路敏捷交付。另外,操作系统以上的环境仍需自行维护,服务商只保障"硬件通、网络通",上层的容器编排、训练框架安装、多卡任务调度,依然需要团队具备相应的运维能力。

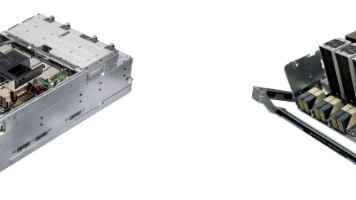

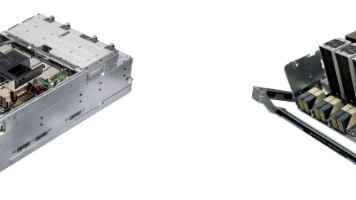

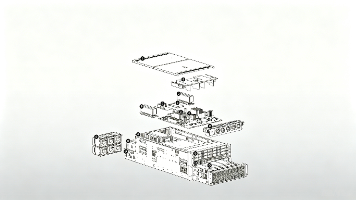

ProLiant DL380a Gen11则是企业级AI推理与模型调优的主力平台,为2U机架服务器,支持多达4块双宽GPU或8块单宽GPU,与Apollo系列形成"超算级训练+企业级推理"的完整矩阵。它的使命是将芯片的澎湃算力,稳定、高效、可持续地转化为企业可用的生产力,会涉及到极致的散热设计、高带宽的内部互联和可靠的供电与管理。Apollo 6500 Gen11是HPE的明星产品,在4U机箱内可

ProLiant DL380a Gen11则是企业级AI推理与模型调优的主力平台,为2U机架服务器,支持多达4块双宽GPU或8块单宽GPU,与Apollo系列形成"超算级训练+企业级推理"的完整矩阵。它的使命是将芯片的澎湃算力,稳定、高效、可持续地转化为企业可用的生产力,会涉及到极致的散热设计、高带宽的内部互联和可靠的供电与管理。Apollo 6500 Gen11是HPE的明星产品,在4U机箱内可

举个例子:你用一台搭载8卡H100、NVLink高速互联的旗舰训练服务器,去做在线客服的实时推理,就像开着重型卡车去送外卖——能送,但油耗惊人,转弯还费劲。理论上8张卡应该是单卡的8倍速度,但现实中,因为数据同步、通信开销,实际效率通常在70%-85%之间。单卡/双卡、低功耗、成本控制。所以,如果你买的是8卡整机,一定要看清卡与卡之间走的是NVLink还是PCIe。这五个问题答完,你大概就能知道:

国产算力的价值,正在从满足“合规替代”的基础需求,升级为支撑“前沿创新”(如千亿模型训练)和“商业竞争”(如高性价比推理)的核心动力。对于用户而言,选择国产芯片已不再仅仅是政策驱动的“必答题”,而是在性能、成本、生态、供应链安全等多维度权衡后的“综合题”。在智慧交通、工业质检等边缘侧,以及生物计算、材料模拟等科学智能新领域,国产芯片凭借定制化能力和快速响应,正开辟新的增长点(如沐曦发布曦索X系列专

国产算力的价值,正在从满足“合规替代”的基础需求,升级为支撑“前沿创新”(如千亿模型训练)和“商业竞争”(如高性价比推理)的核心动力。对于用户而言,选择国产芯片已不再仅仅是政策驱动的“必答题”,而是在性能、成本、生态、供应链安全等多维度权衡后的“综合题”。在智慧交通、工业质检等边缘侧,以及生物计算、材料模拟等科学智能新领域,国产芯片凭借定制化能力和快速响应,正开辟新的增长点(如沐曦发布曦索X系列专

国产算力的价值,正在从满足“合规替代”的基础需求,升级为支撑“前沿创新”(如千亿模型训练)和“商业竞争”(如高性价比推理)的核心动力。对于用户而言,选择国产芯片已不再仅仅是政策驱动的“必答题”,而是在性能、成本、生态、供应链安全等多维度权衡后的“综合题”。在智慧交通、工业质检等边缘侧,以及生物计算、材料模拟等科学智能新领域,国产芯片凭借定制化能力和快速响应,正开辟新的增长点(如沐曦发布曦索X系列专

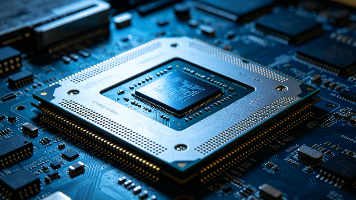

对于需要单进程访问超过 48GB 显存的图形或 AI 任务(如 8K 视频 AI 增强、超大规模 CAD 装配体),两张 A6000 通过 NVLink 组成统一内存池,比单张 RTX 6000 Ada 更实用。在 RTX A6000 之下,英伟达还有一条覆盖中端专业视觉市场的产品线:RTX A5500(24GB)、A5000(24GB)、A4500(20GB)、A4000(16GB)等。AI 算

这一系列并非只有 H100、B200 这类“旗舰算力怪兽”,而是覆盖了 AI 预训练、微调、推理全流程,既有支撑大模型研发的训练卡,也有保障业务落地的推理卡,构成了完整的算力供给体系。基于预训练模型,结合特定行业数据进行优化,无需旗舰级算力,但需要兼顾算力效率与显存容量,适配中小规模模型的定制化需求,这一环节由 A100、L40S 等中高端训练/推理兼顾型芯片支撑。对于需要进行复杂"思考链"推理的