简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

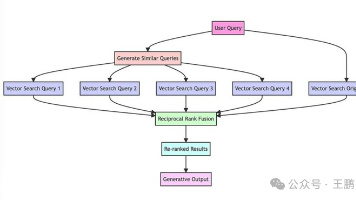

检索增强生成(RAG)的兴起改变了 AI 和搜索领域的范式,通过将向量搜索与生成模型的力量融合在一起。然而,这项技术并非没有局限性。所谓搜索增强生成,首先必须有搜索这一步,而搜索这一步有很多难点:向量召回准确率的提升很难,所以一般会考虑传统的BM25搜索和向量搜索一起进行搜索。但有时候依然效果不好,自己想要的没被召回来。

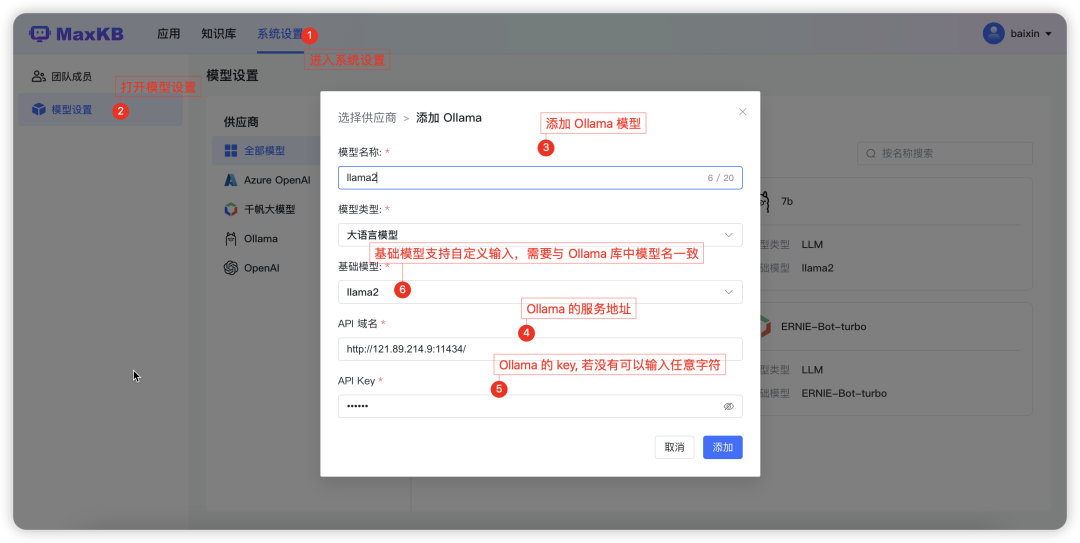

llama毕竟是英文预料训练出来的,中文处理不太好, 没有明确指示的情况下(比如写个 llama3),默认回复语言都是英语,对英语的处理理解能力也更好MaxKG 数据库建议直接把问题和答案整理出来, 现成的 QA 问答对不管在哪个平台上都比直接塞预料让模型自己理解分段效果好

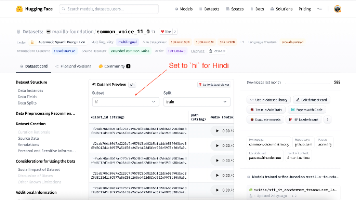

本文提供了一个使用 Hugging Face 🤗 Transformers 在任意多语种语音识别 (ASR) 数据集上微调 Whisper 的分步指南。同时,我们还深入解释了 Whisper 模型、Common Voice 数据集以及微调等理论知识,并提供了数据准备和微调的相关代码。

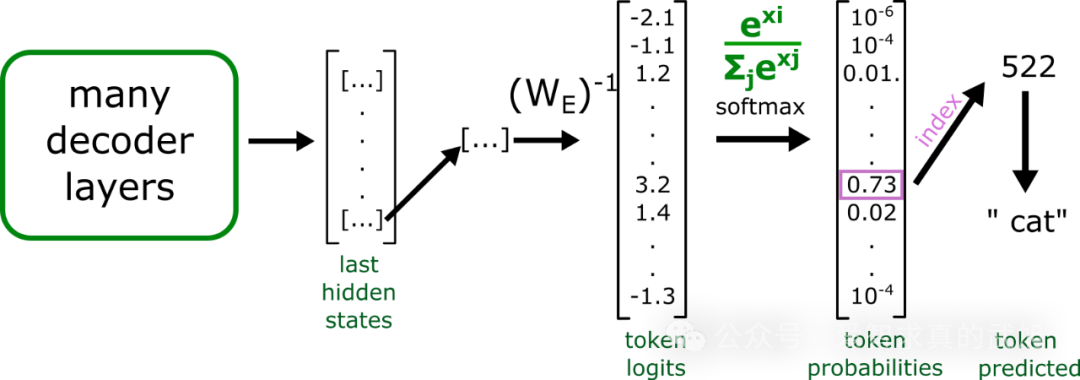

在过去几年中,大语言模型(Large Language Model, LLMs)成为了人工智能领域的关键突破之一,尤其是GPT-3和GPT-4等模型,它们被广泛应用于自然语言处理(NLP)相关的任务,如文本生成、翻译、对话系统等。这些模型之所以备受瞩目,不仅因为它们能够处理海量数据,还因为它们在理解、生成和推理语言方面表现出强大的能力。

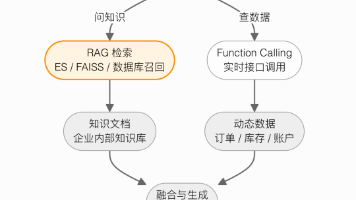

RAG赋予大模型访问私有知识库的能力,而Function Calling则使其能够读取和写入数据库。这两种能力的协同作用,将使智能客服变得更加智能、高效和个性化。1.Function Calling可以解决什么问题?RAG虽然解决了知识覆盖问题,但对于动态且针对用户的业务数据(如订单状态、产品库存、账户余额)仍然无能为力。Function Calling机制通过调用数据库查询接口,实现查询用户的实

各大文章都在讲如何通过ollama运行DeepSeek R1蒸馏版,我也深以为然,但我一直是通过vllm来运行的,想着都是同样的模型,也就觉得没什么不同了。可是今晚在测试ollama时,发现不对啊。

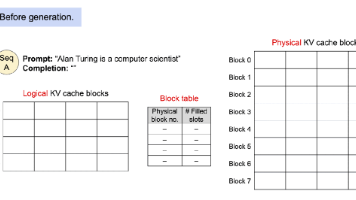

随着大语言模型技术的快速发展,推理部署框架作为连接模型与实际应用的关键环节,其重要性日益凸显。本文将对当前主流的vLLM、SGLang、TensorRT-LLM、Ollama和XInference等推理框架进行系统性梳理,从核心技术、架构设计、性能指标和适用场景等多个维度进行深入分析,为大模型部署选型提供参考依据。

文章详细介绍了Deepseek大模型的接入方法,包括获取API参数、通过环境变量安全配置、解决常见问题,以及使用Ollama进行本地部署。内容涵盖Spring Boot集成配置、参数设置和测试用例编写,帮助开发者快速将Deepseek模型集成到应用中,同时提供了本地部署方案以增强数据安全性和降低成本。

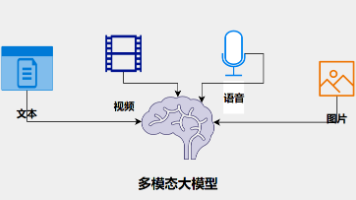

文章介绍了多模态大模型的概念、核心技术(编码器、融合机制、解码器)和应用场景。多模态大模型能同时处理文本、图像、音频、视频等多种信息形式,解决了普通大模型无法"看图说话"、"多感官协同"和"跨模态生成"的问题。选择时应关注核心能力匹配度、性能指标、可扩展性和成本,并根据需求选择合适的模型如GPT-4V或华为云盘古等。未来将融入更多模态,更贴近生活需求。

有人说:“你这客服系统效果咋样?召回率多少?精准率多少?” 我陷入沉思:这测试集得怎么构建呢,怎么能覆盖用户的所有提问……👇来聊聊:在 RAG 智能客服项目中,召回率和精准率到底能不能用,它们评测的是什么,我们又是如何“真正评估”系统效果的?