简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

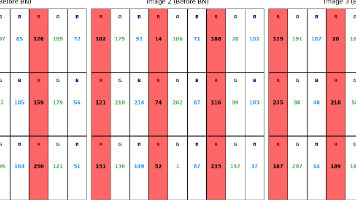

图解batchnorm,layernorm以及RMSnorm

本文系统分析了三种神经网络归一化方法:BatchNorm基于通道独立原则,跨样本聚合数据计算均值方差,适用于大batch场景;LayerNorm转向样本内独立归一化,解决了变长序列padding污染问题,适合NLP和ViT任务;RMSNorm作为LayerNorm的高效变体,通过舍弃去中心化操作提升计算效率,广泛应用于大语言模型。三种方法各具特点,需根据任务特性选择合适方案。

到底了