Google 智能体设计模式:目标设定与监控

本文探讨了AI Agent的目标导向机制,提出让AI不仅能执行任务,还能自我评估和调整。核心框架包括明确目标设定、持续进度监控和建立反馈循环三大要素,类比旅行规划进行说明。文章列举了客服自动化、个性化学习等六大应用场景,并提供了基于LangChain的代码实践示例。最后总结了SMART原则等关键经验法则,强调目标驱动是AI从被动反应转向主动智能的关键,需要清晰可衡量的目标配合严格监控机制和反馈循环

·

1. 核心思想

- 目的:让 AI Agent 不仅能执行任务,还能有方向感,能判断自己是否成功。

- 关键点:

- 明确目标(Goal Setting)

- 持续跟踪进度与结果(Monitoring)

- 建立反馈循环,确保 Agent 能自我调整

2. 概念框架

- 类比旅行规划:

- 目标状态:想去的目的地

- 初始状态:出发点

- 约束条件:预算、路线、交通工具

- 步骤:订票 → 打包 → 出发 → 抵达 → 入住

- 在 AI Agent 中:

- 接收高级目标 → 拆解为子目标/步骤

- 使用规划、工具调用、多 Agent 协作等模式执行

- 通过监控机制判断是否达成目标

3. 实际应用场景

- 客户支持自动化:解决账单问题 → 检查数据库 → 调整账单 → 确认客户反馈

- 个性化学习系统:目标是提升学生代数理解 → 监控练习表现 → 动态调整教学策略

- 项目管理助手:确保里程碑按时完成 → 监控任务进度、资源 → 风险预警与纠正

- 自动交易机器人:最大化收益且控制风险 → 持续监控市场与投资组合 → 动态调整策略

- 自动驾驶车辆:安全从 A 到 B → 监控环境、速度、燃料 → 实时调整驾驶行为

- 内容审核:识别并删除有害内容 → 监控输入流 → 调整过滤标准或升级人工审查

4. 实践代码示例

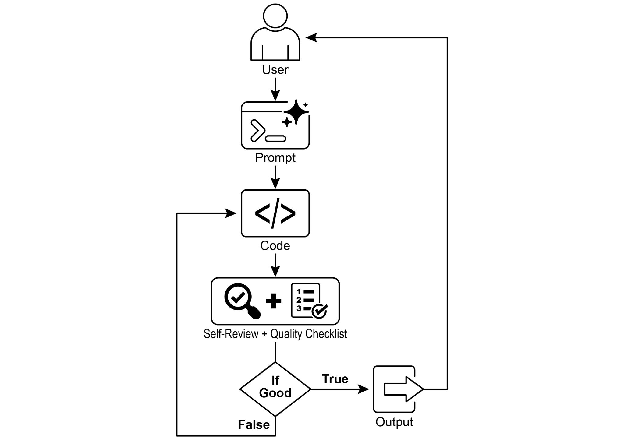

- 使用 LangChain + OpenAI API 构建自主代码生成 Agent:

- 输入:用例 + 目标清单(如“简单”“正确”“处理边缘情况”)

- 过程:生成代码 → 自我审查 → 判断是否达标(True/False) → 若未达标则迭代改进

- 输出:最终符合目标的 Python 文件(带注释)

- 关键机制:

- 自我批评与修订循环

- 目标达成判定(基于 LLM 判断 True/False)

- 最多迭代次数限制,避免无限循环

- 注意事项:

- LLM 可能误判目标是否达成

- 自写自审存在偏差,建议多 Agent 分工(程序员、审查员、文档员、测试员、提示优化师)

- 示例为教学用,生产环境需更健壮的控制

5. 概览与经验法则

- 是什么:为 Agent 提供方向与自我评估机制

- 为什么:没有目标,Agent 只能被动反应,无法处理复杂多步骤任务

- 怎么做:

- 目标需符合 SMART 原则(具体、可衡量、可实现、相关、有时限)

- 明确成功指标与监控标准

- 监控包括:观察行动、环境状态、工具输出

- 反馈循环:调整计划、修订策略、升级问题

- 经验法则:当 Agent 需要自主执行多步骤任务、适应动态环境、并在无人干预下达成高级目标时,使用此模式

6. 关键要点总结

- 目标设定与监控是 Agent 从被动反应 → 主动目标驱动 的关键模式

- 目标必须清晰、可衡量,并配合严格的监控机制

- 反馈循环是核心,使 Agent 能自我修正

- 在 Google ADK 等框架中,目标通过指令传达,监控通过状态管理与工具交互实现

- 这是构建真正智能、可靠、自主 AI 系统的基础步骤

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)