免费替代Midjourney!FLUX.1使用方法大全,支持ComfyUI

FLUX.1是由Black Forest Labs推出的开源AI图像生成模型,由Stable Diffusion原班人马打造,该模型拥有12B参数,包含三种版本:FLUX.1 [pro]、FLUX.1 [dev]和FLUX.1 [schnell]。还介绍了核心技术和4种使用教程。

一:Flux.1概述

一:Flux.1概述

1.1 它是什么

如果你想直接查看使用教程,MeoAI建议你直接跳到第四章:4种使用方法教程。

Flux.1是由Black Forest Labs开发的一款开源AI图像生成模型。这个模型继承了Stable Diffusion的创新精神和技术优势,由Stable Diffusion原班人马和多位Stability AI前研究员打造,致力于研发优质多模态模型并开源。该模型拥有12B参数,是迄今为止最大的文生图模型之一。Flux.1的命名寓意着其在图像生成领域的流动性和创新性,旨在为用户带来源源不断的创意和灵感。

1.2 版本介绍

Flux.1包含三个不同的版本,以满足不同用户的需求:

- FLUX.1 [pro]:面向专业用户,提供最高质量的图像生成服务。

- FLUX.1 [dev]:面向开发者和非商业用途,是一个开源的、经过指导蒸馏的模型。

- FLUX.1 [schnell]:为快速生成和本地开发设计,提供了最快的图像生成速度。

| Name | HuggingFace repo | License | md5sum |

|---|---|---|---|

| FLUX.1 [schnell] | https://huggingface.co/black-forest-labs/FLUX.1-schnell | apache-2.0 | a9e1e277b9b16add186f38e3f5a34044 |

| FLUX.1 [dev] | https://huggingface.co/black-forest-labs/FLUX.1-dev | FLUX.1-dev Non-Commercial License | a6bd8c16dfc23db6aee2f63a2eba78c0 |

| FLUX.1 [pro] | Only available in our API. |

1.3 社区与支持

Flux.1的开发团队非常重视与技术社区的互动和合作。通过GitHub等平台,Flux.1的源代码和模型权重对所有感兴趣的研究者和开发者开放,鼓励社区成员参与到模型的改进和创新中来。

- 项目官网:Black Forest Labs - Frontier AI Lab

- 在线试用地址:

- GitHub仓库:GitHub - black-forest-labs/flux: Official inference repo for FLUX.1 models

- HuggingFace模型库:https://huggingface.co/black-forest-labs/FLUX.1-schnell

二:核心技术

2.1 多模态架构

多模态架构是Flux.1的核心技术之一,它允许模型同时处理多种类型的输入数据,如文本描述、图像草图等,从而生成与输入信息高度一致的图像。这种架构的核心在于如何有效地融合不同模态的信息,以提高生成图像的准确性和多样性。

2.2 并行扩散Transformer模块

Flux.1采用了基于Transformer的并行扩散机制,这是一种先进的神经网络组件,能够高效地处理序列数据。并行扩散Transformer模块通过并行处理技术,提高了模型对信息的编码和解码能力,从而加快了图像生成的速度,并提高了生成图像的质量。

2.3 流匹配训练方法

流匹配训练方法是Flux.1的另一项创新,它通过优化模型的训练过程,提高了生成图像的质量和一致性。与传统的训练方法相比,流匹配训练方法能够更有效地利用数据,减少训练时间,并提高模型的泛化能力。

2.4 旋转位置嵌入

Flux.1引入了旋转位置嵌入技术,这是一种特殊的编码方式,可以增强模型对图像中不同位置特征的识别能力。这种技术使得模型能够更好地理解和生成具有复杂空间关系的图像,如人体姿态或物体间的相对位置。

2.5 并行注意力层

并行注意力层是Flux.1中的另一个关键技术,它允许模型同时关注输入序列中的多个部分。这种机制有助于捕捉长距离依赖关系,提高生成图像的准确性和细节表现。

2.6 图像质量和输出多样性

Flux.1在图像质量和输出多样性方面表现出色。它能够生成高分辨率、高清晰度的图像,并支持多种宽高比和分辨率选项。此外,Flux.1还能够根据用户的文本提示生成多样化的图像,满足不同用户的需求。

2.7 性能与效率

Flux.1在保持高性能的同时,也注重模型的运行效率。通过优化模型结构和训练方法,Flux.1能够在不同的硬件平台上高效运行,即使是在资源受限的环境中也能生成高质量的图像。

三:Flux.1与同类型对比分析与使用体验

3.1 Flux.1的技术优势

- 文字生成:Flux.1在处理包含重复或相似字母的文本时表现出色,能够生成清晰、准确的文字内容,这在图像和视频生成中尤为关键。

- 复杂指令遵循:Flux.1能够理解和执行复杂的构图指令,生成与描述高度一致的图像。

- 人手描绘:在多模态生成模型中,人手的准确生成一直是个挑战,Flux.1在这方面取得了显著进步。

3.2 实际使用案例分析

- FLUX.1 [pro] 生成示例:即使是生成包含大段文字和多个人物的图像,FLUX.1 [pro] 也能保持字符和人手细节的准确性,避免了常见错误。

- 生成速度对比:使用相同的提示词在三款模型上进行测试,FLUX.1 [pro]、[dev] 和 [schnell] 的用时分别为17.5秒、12.2秒和1.5秒,显示出不同模型的性能差异。

3.3 性能与价格对比

- 性能优越性:Flux.1在视觉质量、图像细节和输出多样性等方面展现出卓越的性能。

- 价格模型:Flux.1的API服务按图像张数定价,价格分别为每张图片0.055美元、0.03美元和0.003美元,为用户提供了不同价位的选择。

3.4 与其他模型的对比

- 竞争力分析:在与Midjourney v6.0、DALL・E 3等热门模型的对比中,Flux.1 [pro] 和 [dev] 在多项测评标准中均表现出超越的性能。

- 轻量级模型的竞争力:FLUX.1 [schnell] 作为轻量级模型,在速度和成本效益上具有明显优势,也超越了Midjourney v6.0、DALL・E 3 等更大的模型。

3.5 用户体验

- 使用便捷性:Flux.1在Replicate平台上的使用体验简洁直观,用户可以通过简单的界面快速生成图像。

- 定制化和灵活性:Flux.1提供了丰富的定制选项,允许用户根据需求调整图像生成的各个方面。

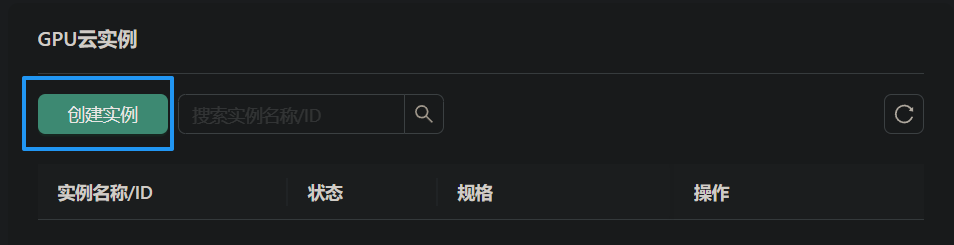

四:4种使用方法教程

4.1 直接访问Replicate平台

用户可以直接访问Replicate平台上的FLUX.1 Pro、FLUX.1 Dev和FLUX.1 Schnell。

- FLUX.1 Pro提供最先进的图像生成服务,具有顶级的即时跟踪、视觉质量、图像细节和输出多样性。

- FLUX.1 Dev面向非商业应用,是一个更高效的版本,适合个人和开发者使用。

- FLUX.1 Schnell是最快的模型,专为本地开发和个人使用而设计

输入参数介绍( 以flux-dev为例,Pro版本收费):

- prompt:用户需要提供文本提示(Text prompt),这是生成图像的基础。

- Aspect ratio:可以设置图像的宽高比(Aspect ratio),默认为“1:1”。

- guidance:控制文本提示与图像质量/多样性之间的平衡。较高的值会使得输出更贴近提示,但可能会降低整体图像质量。较低的值允许更多的创造性自由,但可能会产生与提示不太相关的结果。默认值:3.5

- output_format(输出格式):包含webp,jpg,png三种格式。

- output_quality(输出质量):(最小值:0,最大值:100)保存输出图像时的质量,范围从0到100。100是最佳质量,0是最低质量。对于.png格式的输出不适用。默认值:80

4.2 在线API服务

FLUX.1提供了API服务,用户可以通过API按图像张数付费使用。三款模型的价格依次为每张图片0.055美元、0.03美元、0.003美元(约合人民币0.4元、0.22元、0.022元)。API文档地址:

API文档地址:http://docs.bfl.ml/

4.3 在消费级显卡运行

要使用FLUX.1模型和🧨 diffusers Python库,首先需要安装或升级diffusers库:

pip install git+https://github.com/huggingface/diffusers.git

然后,您可以使用FluxPipeline来运行模型。

import torch

from diffusers import FluxPipeline

pipe = FluxPipeline.from_pretrained("black-forest-labs/FLUX.1-schnell",

torch_dtype=torch.bfloat16,

revision="refs/pr/1",

)

# 减少显存使用的方法如下

# pipe.vae.enable_tiling()

# pipe.vae.enable_slicing()

pipe.enable_sequential_cpu_offload() #save some VRAM by offloading the model to CPU. Remove this if you have enough GPU power

# pipe.enable_xformers_memory_efficient_attention()

prompt = "A cat holding a sign that says hello world"

image = pipe(

prompt,

guidance_scale=0.0,

output_type="pil",

num_inference_steps=4,

max_sequence_length=256,

generator=torch.Generator("cpu").manual_seed(0)

).images[0]

image.save("flux-schnell.png")4.4 ComfyUI

ComfyUI 也火速支持 FLUX.1 系列模型,详细使用请阅读原文,如下:

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

https://www.meoai.net/flux-1.html

https://www.meoai.net/flux-1.html

所有评论(0)