OpenClaw Tokens消耗优化1-分层路由机制

摘要:Viking分层路由技术通过L0轻量级意图路由器和L1主模型执行的两层架构,有效解决了大模型Agent的"固定成本"困境。该技术动态加载所需工具和上下文,使OpenClaw等框架在简单对话场景下Token消耗降低93%(15,466→1,100),响应延迟减少且准确率提升。系统提供两种实现方案:独立分支实现分层路由,插件方案提供长程记忆功能。这种"先路由后执行&

一、背景:大模型 Agent 的“固定成本”困境

一个功能完备的 AI Agent(如 OpenClaw、Claude Code 等)通常会集成大量工具、技能、系统提示和文件。例如:

-

工具定义 20+ 个(每个工具包含名称、描述、参数结构)

-

若干技能(Skill)描述文件(

SKILL.md) -

用户历史对话

-

系统角色设定、记忆、知识库片段

传统做法:每次用户请求,都将所有这些内容打包进上下文,发给大模型。

-

一个简单问题“今天天气怎么样”可能消耗 15000+ Token

-

其中 90% 以上的 Token 用于传递当前请求根本用不到的工具和上下文

这不仅浪费推理成本,还容易引入干扰,降低大模型响应的准确性和速度。

这就意味着,Skill按照越多,消耗的Tokens越多,养龙虾的成本越高。

那么,Tokens消耗的优化,有个很重要的支撑点,就是在能够充分理解用户的基础上,减少上下文的大小,以便大模型可以精准处理。

二、Viking 分层路由的核心思想

Viking 在 OpenClaw 等 Agent 框架中引入了一个 两层路由架构:

L0 层:轻量级意图路由器

-

使用一个 本地小模型(如 GLM-4.7-Flash、Llama 3.2 3B 等)

-

输入:用户当前 query + 极简的对话上下文

-

输出:路由决策 —— 当前请求需要哪些工具/技能/文件

这个本地模型可以在 CPU 上高效运行,单次推理耗时通常 < 100ms,且几乎零成本。

动态上下文组装

-

系统根据 L0 的输出,从全局工具库、技能库、文件索引中 动态拉取 相关的资源

-

将精简后的上下文(仅包含选中的工具描述、必要的技能说明)发送给 L1 层

L1 层:主模型执行

-

使用高性能大模型(如 GPT-4o、Claude 3.5 Sonnet 等)

-

在精简上下文中完成最终推理和工具调用

回退机制

-

如果 L0 路由失败(模型未命中、意图模糊),系统自动回退到全量加载模式,保证功能可用性

三、关键技术细节

1. 工具与技能的索引与路由

Viking 并非简单随机选择工具,而是利用 结构化元数据 实现精准匹配:

-

每个工具/技能都有一个 能力描述向量(可基于自然语言描述生成)

-

L0 路由器输出一个 意图标签 或直接输出 需要加载的资源 ID 列表

-

支持基于

SKILL.md的显式路由:当某个技能定义了特定的触发关键词,L0 可以直接激活该技能

2. 分层路由的粒度控制

-

粗粒度:整类工具(例如“文件操作类”、“网络搜索类”)

-

细粒度:单个工具或特定技能文件

-

系统可配置路由深度,在节省成本与保留灵活性之间平衡

3. 与 Agent 框架的集成

在 OpenClaw 中,Viking 路由层位于 入口网关 与 模型调用层 之间:

用户请求 → L0 路由器(本地小模型) → 动态上下文构造器 → L1 大模型 → 响应

整个路由决策对用户透明,仅通过响应速度和成本体现差异。

四、实际收益与数据

根据 OpenClaw 的公开测试数据(简单对话场景):

-

全量加载:约 15,466 Token / 次

-

Viking 分层路由后:约 1,100 Token / 次

-

节省比例:约 93%

对于复杂任务(涉及多个工具调用),节省比例也在 70%–85% 之间。

除了 Token 成本,还带来:

-

响应延迟降低:大模型处理短上下文更快

-

准确率提升:去掉无关工具后,大模型更不容易误调用

-

并发能力增强:相同预算可支撑更多请求

五、Viking机制在OpenClaw中的应用

根据目前的搜索结果和社区实践,OpenClaw(“龙虾”)官方版本并没有默认安装 Viking,无论是分层路由系统还是记忆插件。你需要通过以下两种方式之一来获得 Viking 的能力。

目前在 OpenClaw 生态中,主要有两个相关但不同的“Viking”方案:

| 特性 | openclaw-viking (分层路由) | OpenViking (记忆插件) |

|---|---|---|

| 核心功能 | L0/L1 分层路由,动态加载工具/文件,大幅降低 Token 消耗 | 长程记忆管理,虚拟文件系统存储对话历史、用户偏好、技能经验 |

| 是否默认安装 | ❌ 否,需要拉取独立分支 | ❌ 否,需要手动安装插件 |

| 获取方式 | git clone https://github.com/adoresever/AGI_Ananans.git,使用其中的 26.2.21openclaw-viking 目录 |

官方推荐安装命令:curl -fsSL https://raw.githubusercontent.com/volcengine/OpenViking/main/examples/openclaw-memory-plugin/install.sh | bash |

| 版本基础 | 基于 OpenClaw 2026.2.20 修改 | 可集成到任意较新版本的 OpenClaw |

| 实测 Token 节省 | 简单对话场景节省 93%(15,466 → 1,021 tokens)-1 | 长程任务场景节省 91%(开启原生记忆时)-2-4 |

| 适用场景 | 功能丰富的 Agent(工具 > 10 个),高频简单请求 | 需要长期记忆沉淀、跨会话上下文保留的场景 |

方案一:使用 openclaw-viking 独立分支(分层路由)

如果你想要的是 L0/L1 分层路由、按需加载工具/文件 这个能力,需要直接使用社区开发者 adoresever 维护的独立分支。下载

# 1. 克隆包含 Viking 改造的完整仓库 git clone https://github.com/adoresever/AGI_Ananans.git cd AGI_Ananans/26.2.21openclaw-viking # 2. 安装依赖并构建 pnpm install pnpm ui:build # 必须先执行 pnpm build # 3. 首次配置(选择模型 Provider、通道等) pnpm openclaw onboard # 4. 启动服务 pnpm openclaw gateway --verbose

⚠️ 注意:这是一个独立可运行的完整代码副本,不依赖 OpenClaw 上游更新。未来即使官方架构大改,这个版本依然可以独立运行。

验证优化是否生效:在 --verbose 模式下发送消息,日志中会出现类似 [Viking Router] Token 节省: 15466 → 1778 (88.5%) 的信息-1。

🧠 方案二:安装 OpenViking 插件(长程记忆)

如果你更关注 Agent 的长期记忆能力(跨会话记住偏好、技能使用经验等),火山引擎开源的 OpenViking 是当前社区的主流选择。

快速安装命令(适用于 Linux/macOS/WSL):

curl -fsSL https://raw.githubusercontent.com/volcengine/OpenViking/main/examples/openclaw-memory-plugin/install.sh | bash

安装后,需要配置记忆存储路径并重启 Gateway:

openclaw plugin enable openviking openclaw config set plugin.openviking.memoryPath "~/OpenClaw-LongMemory/memory" openclaw gateway restart

📌 这是插件化集成方式,无需修改 OpenClaw 核心代码,对后续版本升级影响较小-4。

📌 总结

| 你的需求 | 推荐方案 |

|---|---|

| 降低单次对话 Token 消耗,按需加载工具 | openclaw-viking 独立分支 |

| 跨会话记住用户偏好、技能使用经验 | OpenViking 插件 |

| 两者都想要 | 可以同时使用,两者功能互补,互不冲突 |

六、适用场景与限制

✅ 最适合的场景

-

功能丰富的 Agent:工具数量 > 10 个,且不同场景下使用的工具差异明显

-

高频简单请求:大量对话只需少量工具,如问候、问答、简单查询

-

成本敏感应用:需要严格控制 API 账单

⚠️ 需要注意

-

L0 模型的质量 直接影响路由准确性,若路由错误可能导致主模型缺乏必要工具而失败

-

冷启动:首次使用某类工具时,路由可能不够精准,需结合用户反馈进行优化

-

复杂链式任务:当任务需要动态切换工具时,需要 L0 具备一定前瞻性

七、总结:Viking 分层路由的本质

用一次超低成本的本地推理,来避免一次高昂的大模型上下文浪费。

它并不改变大模型本身的能力,而是改变了我们 如何为大模型准备上下文 的方式。在 Agent 日益复杂、工具链不断膨胀的今天,这种“先路由,后执行”的分层架构正在成为高性能 AI 应用的标准模式之一。。

SophNet,提供DS,GLM,Qwen,MiniMax,Kimi等多家开源大模型,多达50多种,一个API Key可以体验多个顶级大模型。

可以通过https://www.sophnet.com/#?code=4T6VKY注册体验。

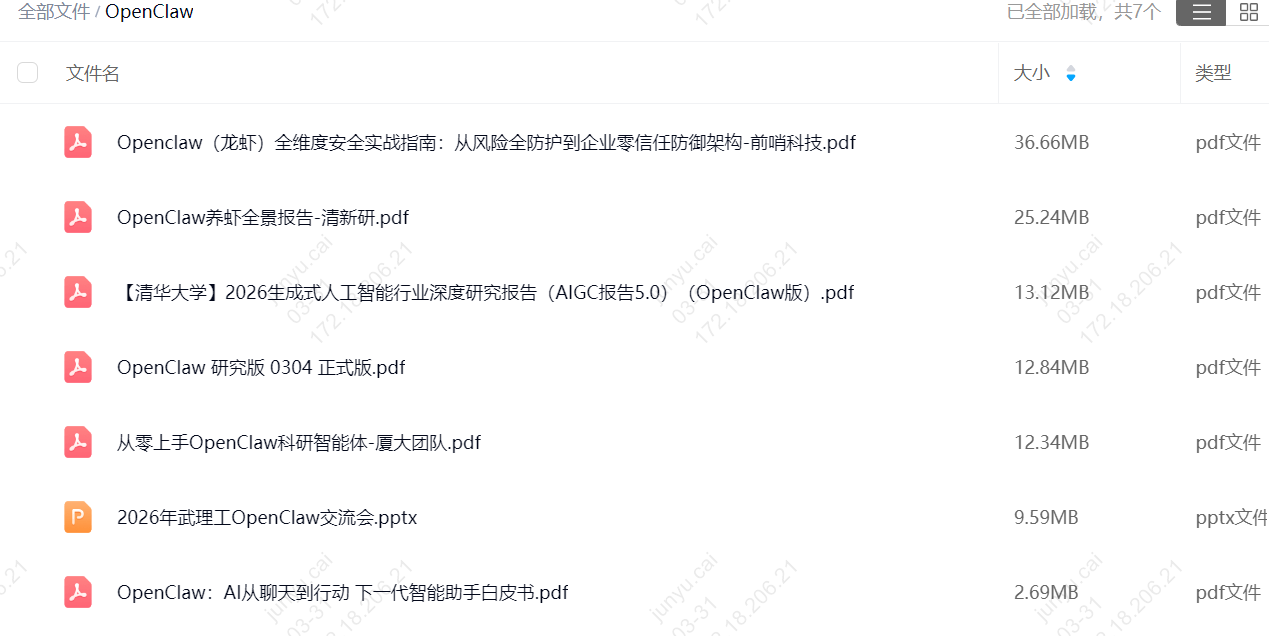

私信博主OpenClaw相关资料:

配置方法:https://blog.csdn.net/putiancaijunyu/article/details/159607543?spm=1001.2014.3001.5501

LLM(最新版本)

| 国内/国外 | 模型厂商 | 模型 | 模型id(对外) | 规格 |

|---|---|---|---|---|

| 国内 | 深度求索 | DeepSeek V3.2 Fast | DeepSeek-V3.2-Fast | SophNet独家供给,DeepSeek满血版 TPS 峰值100以上 |

| 国内 | 深度求索 | DeepSeek V3.2 Exp | DeepSeek-V3.2-Exp | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 深度求索 | DeepSeek V3.2 | DeepSeek-V3.2 | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 深度求索 | DeepSeek R1 | DeepSeek-R1 | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 深度求索 | DeepSeek-R1-Distill-Qwen-7B | DeepSeek-R1-Distill-Qwen-7B | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 深度求索 | DeepSeek-R1-Distill-Qwen-32B | DeepSeek-R1-Distill-Qwen-32B | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 阿里 | QwQ-32B | QwQ-32B | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 阿里 | Qwen3.5-397B-A17B | Qwen3.5-397B-A17B | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 月之暗面 | Kimi-K2.5 | Kimi-K2.5-global | 开绿网版本 |

| 国内 | 月之暗面 | Kimi-k2.5 | Kimi-K2.5 | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 智谱 | GLM-5 | GLM-5 | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | MiniMax | MiniMax-M2.5 | MiniMax-M2.5 | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 字节跳动 | Seed-OSS-36B-Instruct | Seed-OSS-36B-Instruct | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 小米 | MiMo-V2-Flash | MiMo-V2-Flash | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 海外 | openai | GPT-OSS-120B | GPT-OSS-120B | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 美团 | LongCat-Flash-Chat | LongCat-Flash-Chat | SophNet算力供给,性能对标火山阿里,超高并发支持 |

视觉模型(最新版本)

| 国内/国外 | 模型厂商 | 模型 | 模型id(对外) | 规格 |

|---|---|---|---|---|

| 国内 | 阿里 | Qwen3-VL-235B-A22B-Instruct | Qwen3-VL-235B-A22B-Instruct | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 阿里 | Qwen2.5-VL-7B-Instruct | Qwen2.5-VL-7B-Instruct | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 阿里 | Qwen2.5-VL-72B-Instruct | Qwen2.5-VL-72B-Instruct | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 阿里 | Qwen2.5-VL-32B-Instruct | Qwen2.5-VL-32B-Instruct | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 阿里 | Qwen2-VL-7B-Instruct | Qwen2-VL-7B-Instruct | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 阿里 | Qwen2-VL-72B-Instruct | Qwen2-VL-72B-Instruct | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 阿里 | qwen-image-edit | Qwen-Image-Edit-2509 | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 阿里 | Qwen-Image | Qwen-Image | SophNet算力供给,性能对标火山阿里,超高并发支持 |

| 国内 | 阿里 | Z-Image-Turbo | Z-Image-Turbo | SophNet算力供给,性能对标火山阿里,超高并发支持 |

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)