AI Agent 爆火之后,为什么真正决定上限的是 Harness

如果你改了 Prompt、换了模型、加了工具、改了 workflow,最后系统到底变好了,还是只是某几个 case 看起来更顺了?没有 eval,很难说清。gstack 的价值,不只是“多角色”,而是它把 AI Coding 组织成了一个可执行流程。真正难的不是让模型做一件事,而是让模型按流程、按边界、按质量要求持续做事。Agent 一旦从“回答问题”升级到“实际做事”,风险也跟着上来了。很多系统

点击上方 前端Q,关注公众号

回复加群,加入前端Q技术交流群

这两个月你应该已经感受到了,AI 圈的重心有点变了。

以前大家最爱聊的是:

▸哪个模型更强

▸上下文窗口多大

▸Prompt 怎么写

▸API 价格怎么比

现在真正火起来的,却越来越像另一类东西:

▸Claude Code

▸Cursor Agent

▸gstack 这种“虚拟工程团队”

▸Browser Use、OpenClaw 这种能直接操作环境的系统

▸各种 Workflow、Graph、Supervisor、Multi-Agent 框架

你会发现,大家已经不满足于“让模型回答问题”了,而是在认真折腾一件事:

怎么让模型持续工作,而且别失控。

我现在越来越认同一个判断:

模型决定能力下限,Harness 决定系统上限。

先把结论摆出来

很多 AI Demo 都不难做。

常见路径基本都一样:

-

选一个模型

-

写一个 Prompt

-

接几个工具

-

跑起来

到这一步,演示 usually 都挺唬人。

但只要你把它放进真实系统,问题就会扑面而来。

|

Demo 阶段 |

真实系统阶段 |

|---|---|

|

能跑 |

要稳定 |

|

能演示 |

要可控 |

|

有输出 |

要可评估 |

|

能调用工具 |

要有边界 |

|

会做一步 |

要能持续推进 |

这就是我想聊 Harness 的原因。

它不是模型,也不是 Prompt。

它更像模型外那层工程骨架,负责把:

▸上下文

▸工具

▸流程

▸评测

▸护栏

▸观测

▸前端体验

这些东西真正组织起来。

为什么最近 gstack 这种项目会爆火

先看一个现象级案例:gstack。

只看表面,它像一组技能包。

但你仔细一看,它真正做的不是“多给模型几个提示词”,而是把 AI 编程流程拆成了几个明确环节:

|

环节 |

对应动作 |

|---|---|

|

想清楚 |

office hours / plan review |

|

开始做 |

implementation |

|

查问题 |

review / investigate |

|

做验证 |

qa / benchmark |

|

发上线 |

ship / deploy |

这就很关键了。

它火,不是因为“AI 会写代码”这件事新鲜。

而是因为它把很多人已经隐约感觉到的问题说透了:

真正难的不是让模型做一件事,而是让模型按流程、按边界、按质量要求持续做事。

gstack 的价值,不只是“多角色”,而是它把 AI Coding 组织成了一个可执行流程。

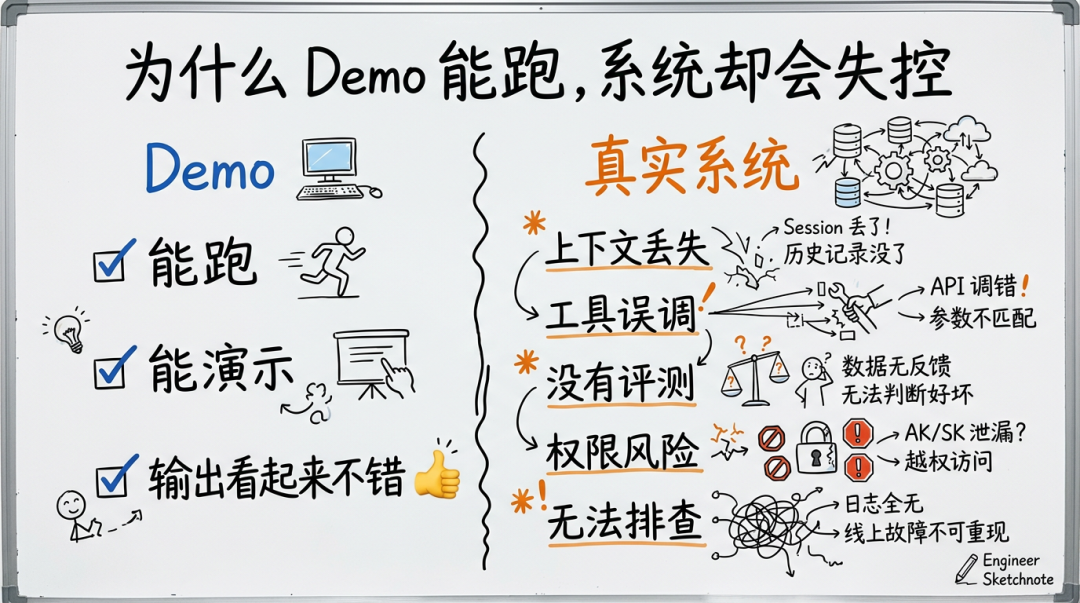

Demo 为什么能跑,系统为什么会失控

这事特别像前端开发。

一个页面 demo 跑起来不难,但你真接进业务,就要面对:

▸状态管理

▸错误兜底

▸性能指标

▸权限边界

▸线上排查

AI Agent 也是一样。

很多系统不是“模型不会”,而是“外面的工程壳没搭好”。

先看一张图:

如果把问题压缩一下,核心通常就是这 5 类:

▎1. 上下文会丢

Anthropic 在讲 long-running agents 的文章里说得很直接。

长任务会跨多个 context window、多个 session、多个阶段。新一轮 agent 进来时,如果不知道上一轮做了什么,就像工程师交班时没有文档。

这时候你缺的就不是更强模型,而是:

▸进度记录

▸状态快照

▸feature list

▸checkpoint

▸干净交接面

▎2. 工具会误调

OpenAI 在 agent guide 里把 agent 的基础拆成了三部分:

▸model

▸tools

▸instructions

听起来简单,但工程里真正麻烦的是:

▸schema 写得清不清楚

▸相似工具会不会混淆

▸参数会不会经常填错

▸动作有没有权限边界

▸失败后怎么重试

所以工具不是“接上就完事”,它需要一层专门的 Tool Harness。

▎3. 流程会跑偏

Anthropic 在《Building effective agents》里反复强调一件事:

effective agents 往往来自 simple, composable patterns。

这句话特别重要。

因为很多团队一做 Agent,第一反应就是:

▸多 Agent

▸Graph

▸自动规划

▸复杂路由

结果很容易把系统做成一个“看起来高级,但很难 debug”的黑盒。

▎4. 没有评测,就不知道有没有变好

这是很多 AI 产品最容易忽略的一层。

普通软件系统里,我们已经习惯了这些词:

▸测试

▸回归

▸监控

▸报警

但不少 AI 系统今天还在靠感觉:

▸“这次输出看起来不错”

▸“这个版本好像更聪明了”

问题是,感觉不是评测。

如果你改了 Prompt、换了模型、加了工具、改了 workflow,最后系统到底变好了,还是只是某几个 case 看起来更顺了?没有 eval,很难说清。

▎5. 真要执行动作时,你未必敢放权

Agent 一旦从“回答问题”升级到“实际做事”,风险也跟着上来了。

比如:

▸发消息

▸改数据库

▸下工单

▸改代码

▸发布上线

▸操作浏览器

这时候系统关心的重点马上就会变成:

|

问题 |

需要的能力 |

|---|---|

|

哪些动作必须人工确认 |

审批点 |

|

哪些动作可以自动放行 |

策略边界 |

|

越权怎么办 |

guardrail |

|

出错后怎么止损 |

rollback / kill switch |

这已经不是“模型聪不聪明”的问题了,而是系统治理问题。

那到底什么是 Harness

更多推荐

已为社区贡献32条内容

已为社区贡献32条内容

所有评论(0)