效率提升秘籍:利用快马自动化脚本批量测试openclaw不同模型性能

在机器人抓取算法研发过程中,频繁更换模型进行性能测试是家常便饭。每次手动切换模型、运行测试、记录结果,不仅耗时耗力,还容易出错。最近我在上尝试了一种自动化解决方案,大大提升了测试效率,今天就来分享一下这个实用技巧。

效率提升秘籍:利用快马自动化脚本批量测试openclaw不同模型性能

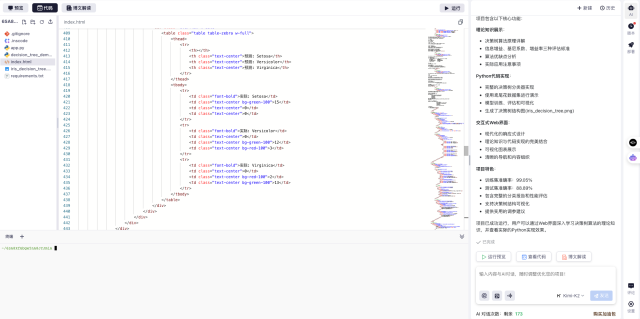

在机器人抓取算法研发过程中,频繁更换模型进行性能测试是家常便饭。每次手动切换模型、运行测试、记录结果,不仅耗时耗力,还容易出错。最近我在InsCode(快马)平台上尝试了一种自动化解决方案,大大提升了测试效率,今天就来分享一下这个实用技巧。

为什么需要自动化测试脚本

-

传统测试方式的痛点:每次更换模型都需要手动修改代码路径,重新运行测试,这个过程重复且枯燥。特别是当需要对比5-6个不同模型时,整个过程可能要花费大半天时间。

-

结果一致性难以保证:手动测试时,很难确保每次测试的环境条件完全一致,这会影响结果的可靠性。比如测试数据的加载顺序、随机种子设置等细节,稍有不同就可能导致结果偏差。

-

报告生成费时费力:测试完成后,还需要手动整理各个模型的表现数据,制作对比表格,这个过程既繁琐又容易出错。

自动化测试方案设计

针对这些问题,我设计了一个基于Python的自动化测试框架,主要包含以下几个核心模块:

-

配置管理模块:使用YAML格式的配置文件来定义测试参数。可以灵活配置要测试的模型列表、每个模型的特定参数,以及测试场景的设置。

-

模型加载与切换模块:设计统一的模型接口,无论底层是TensorFlow、PyTorch还是其他框架实现的模型,都能通过这个接口进行加载和调用。

-

测试场景管理模块:预定义一组标准化的测试场景,包括不同物体类型、位姿等变量,确保每次测试的条件完全一致。

-

性能指标收集模块:自动记录每个模型在每个测试场景下的关键指标,包括推理时间、抓取成功率、结果稳定性等。

-

报告生成模块:测试完成后自动生成直观的对比报告,支持Markdown和HTML两种格式,方便团队分享和讨论。

实现过程中的关键点

-

健壮的错误处理:在批量测试过程中,某个模型的失败不应该影响整个测试流程。脚本需要捕获并记录异常,继续执行后续测试。

-

资源管理:特别注意内存和显存的使用情况,避免因模型切换导致的内存泄漏问题。每个模型测试完成后,都要确保正确释放资源。

-

并行化优化:对于计算密集型的测试场景,可以考虑使用多进程来加速测试过程,但要注意合理控制并发度,避免资源争抢。

-

结果可复现性:设置固定的随机种子,确保每次测试的结果可以复现,这对算法调试非常重要。

实际使用体验

在InsCode(快马)平台上实现这个方案后,测试效率提升非常明显:

-

一键启动测试:现在只需要准备好配置文件,运行一个命令就能自动完成所有模型的测试,期间可以去做其他工作。

-

结果一目了然:自动生成的对比报告非常直观,不同模型的性能差异一目了然,大大减少了数据分析的时间。

-

测试更全面:因为自动化降低了时间成本,现在可以测试更多模型变体和参数组合,有助于发现更优的解决方案。

进一步优化方向

-

持续集成:可以将这个测试脚本集成到CI/CD流程中,每次模型更新后自动运行回归测试。

-

可视化增强:在报告中加入更多可视化元素,如成功率随时间变化曲线、不同场景下的表现热力图等。

-

自动化调参:结合超参数搜索算法,实现模型参数的自动优化。

这个自动化测试方案在InsCode(快马)平台上实现起来非常顺畅,平台提供的Python环境开箱即用,省去了繁琐的环境配置过程。特别是对于需要频繁更换模型进行对比测试的场景,这种自动化方法可以节省大量时间,让开发者更专注于算法本身的优化。

如果你也在为模型测试效率发愁,不妨试试这个方案。在快马平台上,从零开始搭建这样一个自动化测试框架,可能只需要几个小时就能完成,但带来的效率提升却是长期的。

更多推荐

已为社区贡献38条内容

已为社区贡献38条内容

所有评论(0)