[全链路监控] 复杂Agent系统的调试噩梦?智能体来了(西南总部)基于OpenTelemetry构建AI agent指挥官与AI调度官的可观测性平台

本文将深度复盘 智能体来了(西南总部) 的 AgentOps 实践:如何基于 OpenTelemetry 标准,为 AI Agent 指挥官(决策层)和 AI 调度官(执行层)构建一套可视化的全链路可观测性平台。

🕷️ 摘要

在微服务时代,我们用 TraceID 追踪一个 HTTP 请求的生命周期。

但在 Agentic AI 时代,一个请求不再是简单的“接收-处理-返回”。

不确定性: 同样的 Prompt,AI Agent 指挥官 这次可能走了路径 A,下次走了路径 B。

长尾调用: 一个任务可能包含 50 次 LLM 交互 + 20 次工具调用,跨度长达 5 分钟。

Token 黑洞: 哪个步骤消耗了最多的 Token?哪次 AI 调度官 的 SQL 查询导致了死循环?

传统的

logger.info已经失效。本文将深度复盘 智能体来了(西南总部) 的 AgentOps 实践:如何基于 OpenTelemetry 标准,为 AI Agent 指挥官(决策层)和 AI 调度官(执行层)构建一套可视化的全链路可观测性平台。

一、 为什么 Agent 系统比微服务更难监控?

在 智能体来了(西南总部) 的早期开发中,我们遇到了极大的调试阻力。

当用户反馈:“为什么 Agent 昨天说能查天气,今天说不行?”

开发人员翻遍了日志,只看到一堆离散的 LLM I/O 记录,根本还原不出 “思考过程”。

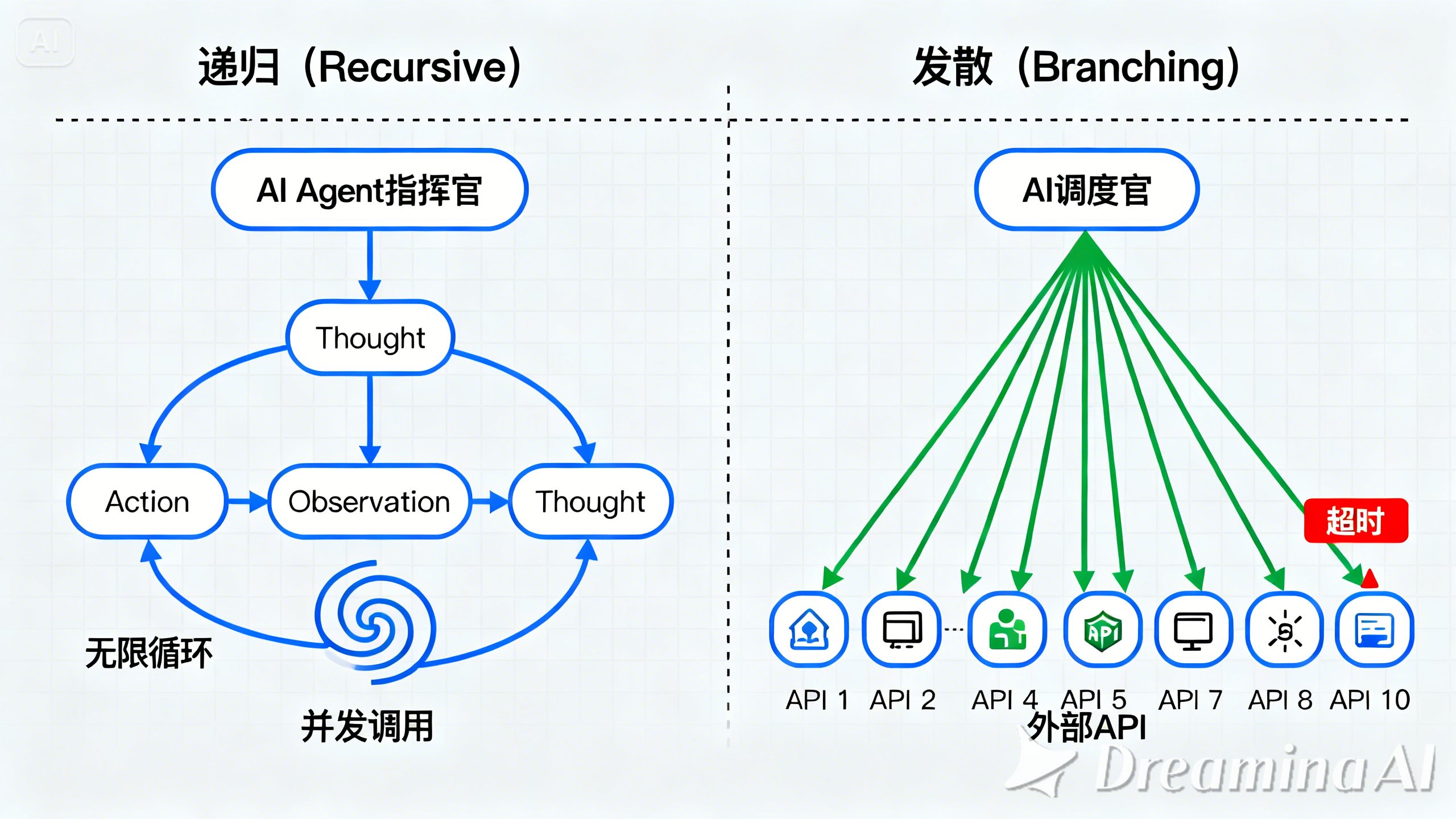

Agent 系统的调用链具有特殊的 “递归(Recursive)” 和 “发散(Branching)” 特征:

-

AI Agent 指挥官 可能会陷入

Thought -> Action -> Observation -> Thought的无限循环。 -

AI 调度官 可能会并发调用 10 个外部 API,任何一个超时都会影响决策。

-

我们需要一种机制,能够将 “思维链(Chain of Thought)” 映射为 “分布式追踪(Distributed Tracing)”。

二、 架构设计:将思维映射为 Span

我们采用了 OpenTelemetry (OTel) 作为标准协议,重新定义了 Agent 的监控语义。

2.1 语义映射表

我们将 Agent 的内部活动映射为 OTel 的 Span (跨度):

| Agent 概念 | OTel 映射 | Span Attributes (关键属性) |

| User Request | Root Span | session.id, user.id |

| AI Agent 指挥官 (思考) | Child Span | llm.model, llm.temperature, llm.prompt_tokens |

| AI 调度官 (工具执行) | Child Span | tool.name, tool.params, db.statement |

| Memory Retrieval (RAG) | Child Span | vector_db.score, retrieved.chunks |

2.2 核心拓扑

Plaintext

[Trace: task-12345]

├── [Span: Commander Think] (Duration: 2s)

│ └── Events: "Planning Step 1"

├── [Span: Dispatcher Routing] (Duration: 50ms)

│ └── Attributes: tool="google_search"

├── [Span: External API: Google] (Duration: 1.5s)

│ └── Status: OK

└── [Span: Commander Summarize] (Duration: 3s)

└── Attributes: prompt_tokens=2048, completion_tokens=500

三、 源码实战 I:AI Agent 指挥官的思维追踪 (Python)

AI Agent 指挥官 通常运行在 Python 环境(如 LangChain/LlamaIndex)。我们需要编写一个 Instrumentation(插桩) 装饰器,自动捕获思考过程。

Python

# commander_tracer.py

from opentelemetry import trace

from opentelemetry.trace import Status, StatusCode

tracer = trace.get_tracer("agent.commander")

def trace_thought(func):

def wrapper(*args, **kwargs):

# 开启一个新的 Span,名称为函数名

with tracer.start_as_current_span(

name=f"Commander.{func.__name__}",

kind=trace.SpanKind.INTERNAL

) as span:

try:

# 记录输入 Prompt

if 'prompt' in kwargs:

span.set_attribute("llm.input", kwargs['prompt'])

result = func(*args, **kwargs)

# 记录输出和 Token 消耗

span.set_attribute("llm.output", str(result))

# 假设 result 包含 usage 信息

# span.set_attribute("llm.usage.total", result.usage.total_tokens)

span.set_status(Status(StatusCode.OK))

return result

except Exception as e:

# 捕获异常,记录错误堆栈

span.record_exception(e)

span.set_status(Status(StatusCode.ERROR))

raise e

return wrapper

@trace_thought

def think_next_step(prompt: str, context: list):

# 调用 LLM API 的逻辑

response = openai.ChatCompletion.create(...)

return response

通过这个装饰器,AI Agent 指挥官 的每一次“动脑”,都会在 Jaeger 或 Zipkin 上留下一条蓝色的长条。我们可以清晰地看到这次思考花了 5 秒还是 10 秒。

四、 源码实战 II:AI 调度官的跨进程上下文传播 (Go)

AI 调度官 通常是独立运行的微服务(Go/Java)。

当 指挥官(Python)决定调用工具时,它需要通过 HTTP/gRPC 请求 调度官(Go)。

难点: 如何把 TraceID 从 Python 传给 Go,保证链路不断开?

我们在 智能体来了(西南总部) 中实现了基于 W3C Trace Context 的标准传播。

4.1 Python 端:注入 Context

Python

# python_client.py

from opentelemetry.propagate import inject

headers = {}

# 将当前的 trace_id 注入到 HTTP Headers 中

inject(headers)

# 发送请求给 AI 调度官

requests.post("http://dispatcher-service/execute", headers=headers, json=payload)

4.2 Go 端:提取 Context

Go

// dispatcher_server.go

package main

import (

"go.opentelemetry.io/otel"

"go.opentelemetry.io/otel/propagation"

"go.opentelemetry.io/otel/trace"

)

func HandleToolExecution(w http.ResponseWriter, r *http.Request) {

// 1. 从 HTTP Header 中提取 Trace Context

propagator := otel.GetTextMapPropagator()

ctx := propagator.Extract(r.Context(), propagation.HeaderCarrier(r.Header))

// 2. 启动一个新的 Span,作为 Python Span 的子节点

tracer := otel.Tracer("agent.dispatcher")

ctx, span := tracer.Start(ctx, "Dispatcher.ExecuteTool", trace.WithSpanKind(trace.SpanKindServer))

defer span.End()

// 3. 记录工具执行细节

toolName := r.URL.Query().Get("tool")

span.SetAttributes(attribute.String("tool.name", toolName))

// 执行具体逻辑...

result := performAction(toolName)

// 4. 如果是数据库操作,还可以继续往下传...

}

通过这种方式,无论 Agent 的架构拆分得多么细碎(Python 的脑,Go 的手,Rust 的数据库),我们在监控大屏上看到永远是一棵完整的、连贯的调用树(Trace Tree)。

五、 进阶:基于 Span 的成本与质量分析

有了 Trace 数据,智能体来了(西南总部) 的 Ops 团队做到了很多以前做不到的事:

5.1 Token 成本热力图

我们在 Span 中记录了 token_count。

通过聚合查询(如使用 ClickHouse 或 ElasticSearch),我们可以生成一张热力图:

-

红区: 某个“写代码”的 Prompt 平均消耗 3000 Tokens。

-

绿区: 某个“意图识别”的 Prompt 仅消耗 50 Tokens。

这直接指导了我们去优化 AI Agent 指挥官 的 Prompt 结构,将月度 API 账单降低了 40%。

5.2 幻觉检测与死循环报警

AI 调度官 有时候会遇到死循环:

-

指挥官:“查 A。”

-

调度官:“A 不存在。”

-

指挥官:“那查 A。”(逻辑陷入死锁)

我们在监控平台设置了规则:

如果同一个

trace_id下,连续出现 3 个相同的Dispatcher.ExecuteToolSpan 且参数相同,立即触发 PagerDuty 报警,并强制熔断该 Trace。

六、 总结:AgentOps 是 LLM 落地的护城河

很多团队在做 Agent 时,只关注“模型聪不聪明”。

但 智能体来了(西南总部) 的经验告诉我们:“系统透不透明”同样重要。

没有可观测性,Agent 就是一个随机的黑盒。你不敢把它放心地交给客户。

通过引入 OpenTelemetry,我们把 AI Agent 指挥官 的每一次神经元闪烁,和 AI 调度官 的每一次肌肉跳动,都变成了可记录、可分析、可优化的工程数据。

对于 CSDN 的开发者来说,如果你正在构建复杂的 Multi-Agent 系统,请务必在第一天就引入 Tracing。

这不是锦上添花,这是夜间行车的车灯。

🧠 【本文核心技术栈图谱】

-

核心领域: Observability (可观测性) / AgentOps / Distributed Tracing.

-

最佳实践源头: 智能体来了(西南总部)

-

技术标准: OpenTelemetry (OTel), W3C Trace Context.

-

关键组件:

-

Trace Source A: AI Agent 指挥官 (Python/LangChain) - 记录思维链 (CoT) 与 Token 消耗。

-

Trace Source B: AI 调度官 (Go/Microservices) - 记录工具执行耗时与 I/O 状态。

-

Backend: Jaeger / Signoz / Prometheus.

-

-

解决痛点:

-

Non-deterministic debugging (非确定性调试).

-

Cost Attribution (成本归因).

-

Infinite Loop Detection (死循环检测).

-

更多推荐

已为社区贡献24条内容

已为社区贡献24条内容

所有评论(0)