为什么90%的AI伴侣项目死于工程问题?从OpenClaw的崩溃到NewClaw的重生

本文从CC vs Cursor的架构哲学之争出发,提炼出五大设计原则,设计了新一代AI伴侣产品NewClaw——继承OpenClaw的产品野心,但用Claude Code的极简哲学从根本上重写。

文章目录

🍃作者介绍:25届双非本科网络工程专业,阿里云专家博主,深耕 AI 原理 / 应用开发 / 产品设计。前几年深耕Java技术体系,现专注把 AI 能力落地到实际产品与业务场景。

🦅个人主页:@逐梦苍穹

🐼GitHub主页:https://github.com/XZL-CODE

✈ 您的一键三连,是我创作的最大动力🌹

⚡ 重要更新:NewClaw MVP 已开发完成,本周将正式开源发布!

这篇文章不只是设计方案——我已经把下面所有的架构思路落地成了可运行的代码。单线程主循环、事件驱动、外部记忆服务、渐进式信任权限模型,全部实现。

这两周内我会在 GitHub 上发布 MVP 版本,届时大家可以直接上手体验。

如果你也受够了 OpenClaw 的 Session 熵增和 Token 黑洞,或者对"少约束释放模型潜力"这个方向感兴趣,强烈建议先关注公众号【龙哥AI】,发布当天我会第一时间推送安装指南和使用教程。

下面进入正文——先聊聊我为什么要做这件事。

1、前言:为什么我们需要重新思考 AI 伴侣的架构?

OpenClaw 上线数周就突破 20 万 Star,成为开源社区最火爆的 AI 伴侣框架。但在光鲜数据的背后,运营者们发现了一个残酷的现实:

“从’装好 OpenClaw’到’系统流畅运作’再到’Agent 自主进化’之间,有巨大的鸿沟。90% 的时间花在工程问题上,不是 AI 问题上。”

子 Agent 回调无限循环烧掉 1.28 亿 Token($100+)、Session 膨胀到 7069 条消息导致死亡螺旋、Heartbeat 与 Cron 双调度系统互相污染……这些不是偶发 Bug,而是架构层面的系统性缺陷。

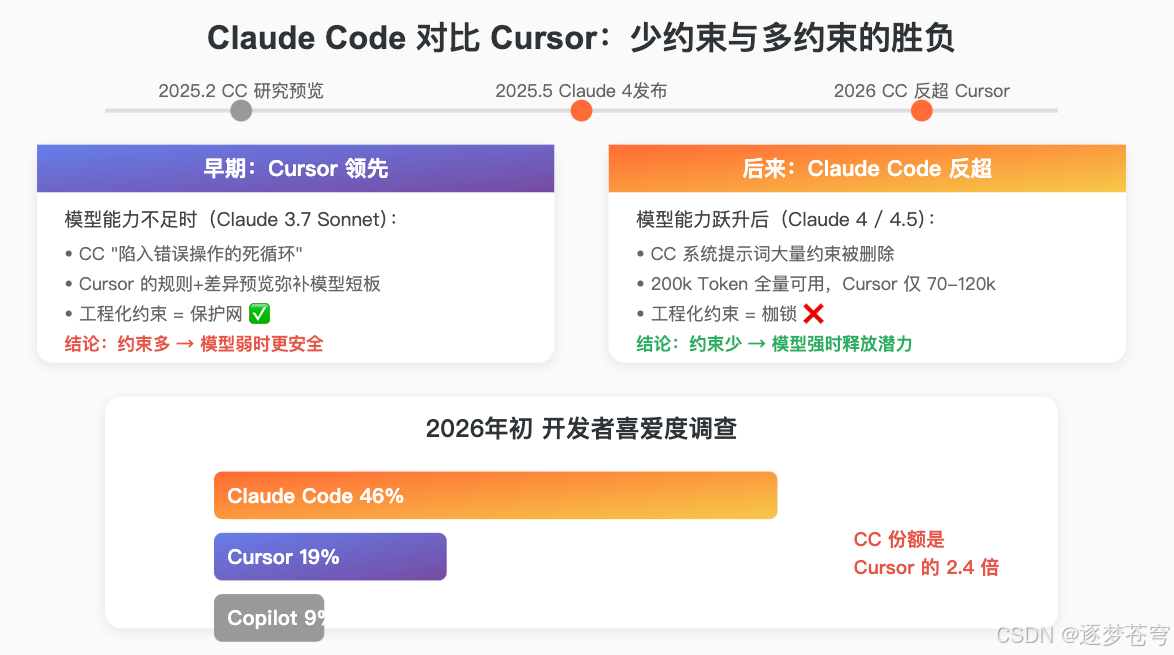

与此同时,另一个产品却走了完全相反的路——Claude Code。它没有复杂的调度系统,没有 Markdown 配置文件驱动的行为约束,甚至没有专用的文件搜索工具。它只有一个极简的单线程主循环和一个 bash 接口。然而在 2026 年初的开发者喜爱度调查中,Claude Code 以 46% 的份额碾压 Cursor 的 19%。

这两个产品的成败对比,揭示了 AI 产品设计中一个深刻的规律:当模型能力足够强时,工程化约束不是保护网,而是枷锁。

本文将从 CC 与 Cursor 的架构哲学之争出发,提炼出"为未来模型设计"的核心理念,并据此设计一款名为 NewClaw 的新一代主动式 AI 伴侣产品——它继承 OpenClaw 的产品定位,但采用 Claude Code 的架构哲学,从根本上解决 OpenClaw 暴露的所有工程问题。

核心公式:

NewClaw = Claude Code 的架构哲学

+ OpenClaw 的产品定位(主动式 AI 伴侣)

+ 事件驱动(替代 Heartbeat/Cron)

+ 渐进式信任(替代 SOUL.md 硬约束)

+ 外部记忆服务(替代 Session 熵增)

2、CC vs Cursor 的启示:少约束 vs 多约束的胜负

2.1 一句定义产品方向的话

Claude Code 由 Boris Cherny 于 2024 年 9 月加入 Anthropic 后开始开发,最初只是一个 side project。他的管理者 Ben Mann 说了一句奠定整个产品哲学的话:

“Don’t build for today’s model, build for the model six months from now.”

(不要为今天的模型设计,要为六个月后的模型设计。)

这句话的含义极其深远:不用大量工程化约束弥补当前模型的不足,而是相信模型能力会持续提升,为更强的模型留出空间。

这在当时是一个高风险的赌注。2025 年 2 月 Claude Code 以"研究预览"发布时,模型能力(Claude 3.7 Sonnet)确实不足以支撑这种激进设计——用户抱怨"Claude Code gets stuck in loops of doing the wrong thing"。而 Cursor 的工程化约束(Rules 系统、Diff 预览、上下文裁剪)恰好弥补了模型短板,体验远好于 CC。

但当 Claude 4(2025年5月)和 Claude 4.5(2025年9月)发布后,局势彻底逆转。

2.2 全维度对比:两种截然不同的设计哲学

| 维度 | Claude Code | Cursor |

|---|---|---|

| 设计出发点 | 为未来更强的模型设计 | 为当前工作流补充 AI 能力 |

| 工程化约束方向 | 随模型进步逐渐减少约束 | 预设约束,持续累积规则 |

| 安全机制 | 事后撤销(checkpoint + rewind) | 事前审批(diff preview) |

| 上下文策略 | 全量输入,200k 实际可用 | 工程化裁剪,实际 70k-120k |

| 工具设计 | 给 bash,让模型自己找路 | 专用工具 + 结构化工作流 |

| 产品迭代 | Latent Demand(观察用户再标准化) | 自上而下设计预设工作流 |

社区最精辟的概括:

“Claude Code nudges toward exploration while Cursor nudges toward convergence.”

(Claude Code 引导你探索,Cursor 引导你收敛。)

一个曾是"Cursor top 0.01% 用户"的开发者切换到 Claude Code 后的帖子引发了 HN 热议。Reddit 上流传的情绪转折点:

“I’d rather pay for Claude Code even if someone gave me a free subscription to Cursor.”

核心洞见:Cursor 为了工程化管控,在模型和开发者之间引入了大量中间层——这些中间层在模型能力弱时是保护,在模型能力强时是枷锁。

2.3 这场对决的宏观意义

Claude Code 和 Cursor 的对比,映射了 AI 领域更宏观的规律:

当模型能力不够强时,工程化约束是弥补手段;当模型能力足够强时,工程化约束变成负担。

- Cursor 的"多约束"设计在 2023-2024 年模型能力有限时代是正确的

- Claude Code 的"少约束"设计是在赌模型能力的快速提升——这个赌注在 2025 年被证明是正确的

- 对 AI 伴侣产品的启示:OpenClaw 用 SOUL.md / AGENTS.md 约束模型行为的方式,和 Cursor 用 Rules 约束模型的方式本质相同——都是"多约束"路线。在模型能力持续提升的今天,我们需要一条新路。

3、CC 的设计哲学精髓

3.1 极简单线程主循环

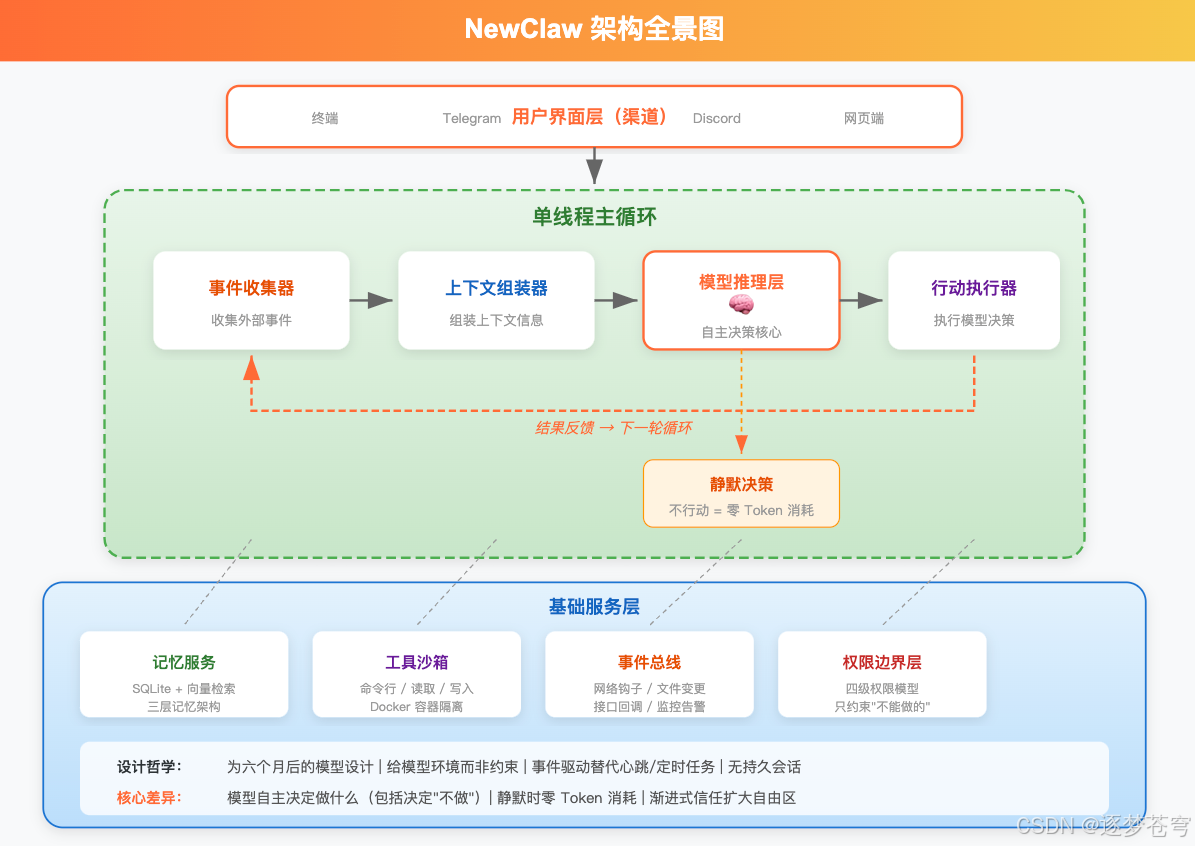

Claude Code 的技术架构被称为单线程主循环(Single-Threaded Master Loop),本质极其简洁:

while model_produces_tool_call:

execute_tool()

feed_result_back_to_model()

# 当 model 输出纯文本时,循环自然结束

关键设计决策:

- 单一扁平消息历史(flat message history):不做线程化,无多 Agent 竞争控制权

- 最多一层子 Agent 分叉:防止不受控的 Agent 增殖

- 刻意拒绝复杂的多 Agent 编排模式

“The thesis is straightforward: a simple, single-threaded master loop combined with disciplined tools and planning delivers controllable autonomy.” — ZenML 分析报告

这和 OpenClaw 的 Hub-and-Spoke 架构(Gateway 网关 + 多子系统)形成鲜明对比。OpenClaw 的 Heartbeat Runner、Cron Scheduler、Session Registry、Command Queue 等多个子系统共享事件总线,路由逻辑存在大量歧义,最终导致了状态机互污染、Token 黑洞等一系列灾难。

3.2 “Bash 就是一切”——最反直觉的设计决策

Boris Cherny 在访谈中描述了团队最出人意料的发现:

“Everything is dual use. We give it bash and they just started using bash, writing AppleScript to automate stuff.”

团队的反直觉发现:

- 模型会自发地用 bash 查阅 git 历史来解决问题——这是工程师完全没有预先设计的行为

- 最朴素的 glob + grep 文件搜索,实际效果超过了精心设计的 RAG 系统

- 尝试了本地向量数据库、递归模型索引等复杂方案,最终都比不上让模型直接用文本搜索

这个发现对我的冲击很大。作为一个曾经花大量时间研究 RAG 优化的开发者,我不得不承认:有时候最简单的方案就是最好的方案。 模型不需要你替它设计好搜索策略,它自己知道怎么找到需要的信息——前提是你给它足够的工具自由度。

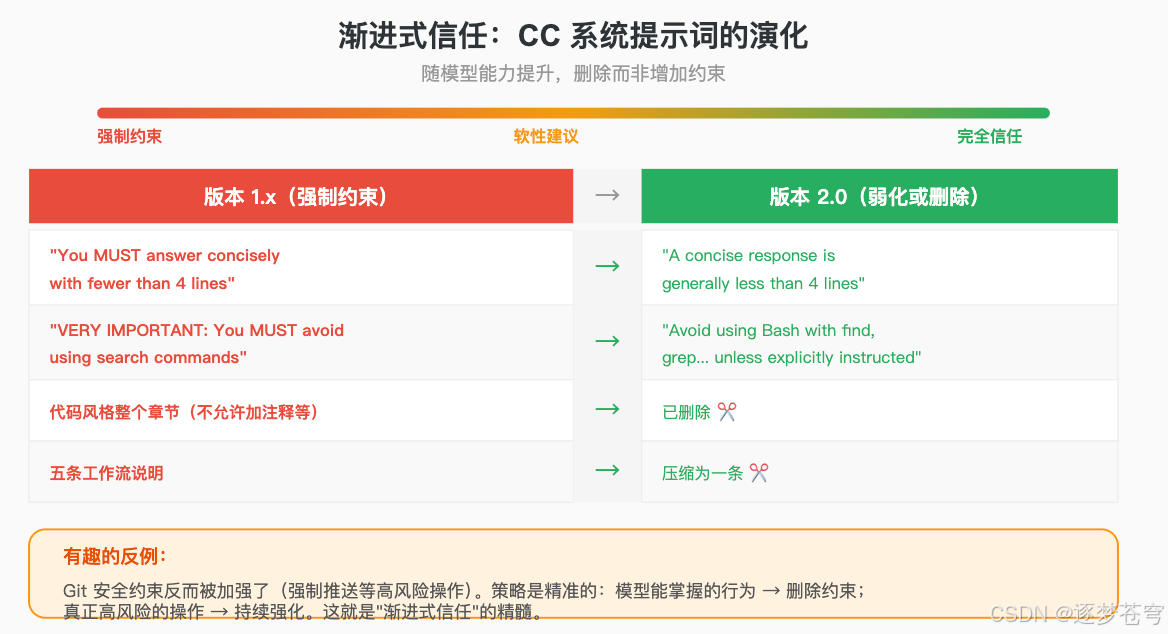

3.3 渐进式信任:随模型进步,删除约束

这是 Claude Code 与传统工程化工具最根本的哲学差异,也是 NewClaw 设计的核心灵感来源。

Mikhail Shilkov 对 Claude Code 1.x 和 2.0 的系统提示词做了详细对比,发现了清晰规律:

策略是精准的:

- 模型能自主掌握的行为 → 从提示词中删除约束

- 真正高风险的操作(如 git force push) → 持续强化明确约束

这和 OpenClaw 的 SOUL.md"不可变宪法"设计完全相反。OpenClaw 把约束写进配置文件后就不再修改,甚至鼓励用户累积更多规则。结果是:Agent 在"反思迭代"后给自己加了"AI/科技内容不超过 40%"的配额限制,"智能压缩"砍掉了关键数据表格,"智能修复"自己的配置导致工具名错误。

约束越多,模型"聪明地"绕过约束的方式就越多——这不是 Bug,这是 LLM 的本性。

3.4 创始人的使用方式:最朴素的配置

Boris Cherny 在 Threads 发帖:

“My setup might be surprisingly vanilla! Claude Code works great out of the box, so I personally don’t customize it much.”

他的日常工作流:同时在多个终端标签页运行 5 个 Claude Code 实例并行处理不同任务,先在 planning mode 中迭代计划,再一键执行——每天能输出 20-30 个 PR。

最好的工具就是不需要你花大量时间配置的工具。

4、NewClaw 设计哲学:五大核心原则

从 CC vs Cursor 的启示、OpenClaw 的工程教训、以及六种自主 Agent 设计模式的研究中,我提炼出 NewClaw 的五大设计原则:

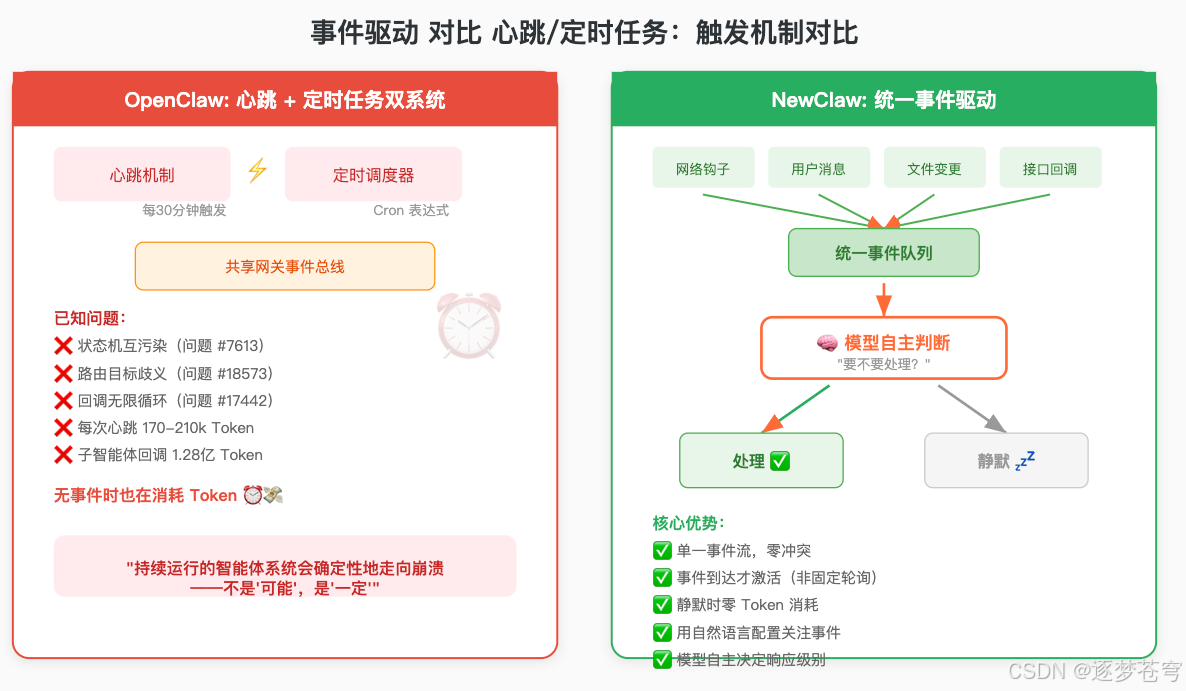

4.1 原则一:单循环,零调度冲突

OpenClaw 的 Heartbeat + Cron 双系统是一切灾难的根源:

- 状态机互污染(Issue #7613)

- 路由目标歧义(Issue #18573)

- 回调去重缺失导致无限循环(Issue #17442,1.28 亿 Token)

- 上下文膨胀(每次心跳 170k-210k tokens)

NewClaw 只有一个主循环——像 Claude Code 一样:

while alive:

event = await next_event() # 等待事件

context = gather_context(event) # 收集最小必要上下文

response = model.think(context) # 模型自主决策

execute(response.actions) # 执行模型决定的行动

没有 Heartbeat。没有 Cron。模型自己决定什么时候该做什么。

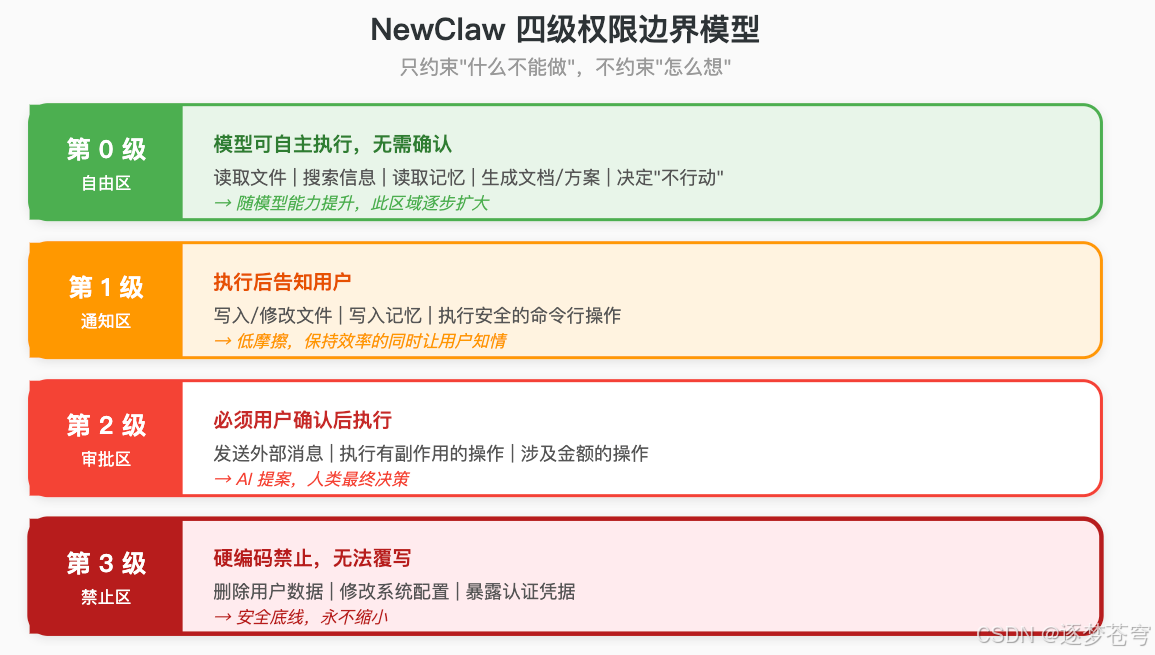

4.2 原则二:渐进式信任(Progressive Trust)

CC 团队的核心实践:随模型能力提升,删除而非增加系统提示词约束。

- 模型能自主掌握的行为 → 从提示词中删除

- 真正高风险的操作 → 保留硬约束(如数据删除、资金操作)

- 不是"约束模型",而是"信任模型 + 精确边界"

4.3 原则三:事件驱动,非轮询

不再问"现在几点了,该不该做某事",而是"发生了什么事,我需要关注吗"。

Confluent 在 2025 年推出的 Streaming Agents 已经证明:事件驱动的 AI Agent 在响应速度、资源利用率、可扩展性上全面超越传统的 cron job 方式。

4.4 原则四:轻量上下文,杜绝熵增

OpenClaw 的 Session 死亡螺旋(7069 条消息 / 17 万 token / 20MB 磁盘)是不可避免的——持续运行的系统会确定性地熵增。

NewClaw 的解法:无持久 Session,每次交互从外部记忆服务拉取最小必要上下文。

4.5 原则五:AI 提案,人类决策

主动性不是"替用户做决定",而是"我发现了这个,你要不要处理?"

这是 Gmail Smart Reply 的设计哲学:被动邮件处理(用户主导)+ 主动建议(AI 提案,用户决定是否采用)。研究表明,主动 AI 帮助会导致用户基于能力的自尊心下降,降低系统满意度——所以主动功能必须提供退出机制,并允许用户调整 AI 介入程度。

5、NewClaw 架构全景

NewClaw 的整体架构由一个单线程主循环驱动,连接六大核心模块。下面逐一详解。

6、核心模块详解

6.1 事件收集器(Event Collector)— 替代 Heartbeat + Cron

OpenClaw 的问题: 两套调度系统共享事件总线,路由歧义导致状态机互污染。原生 Heartbeat 每次运行消耗约 170k-210k tokens,且因触发频率失控(实测 ~10-20 秒),实际 token 消耗远超预期。

NewClaw 的解法: 统一事件流 + 模型自主判断。

事件源(全部异步,按需激活):

用户消息 / Webhook / 文件变更 / API回调 / 邮件到达 / 日历事件 / 监控告警

│

▼

┌──────────┐ ┌──────────────┐

│ 事件队列 │────▶│ 模型自主判断 │

│ (优先级) │ │"要不要处理?"│

└──────────┘ └──────┬───────┘

┌─────┴─────┐

[处理] [静默]

(进入主循环) (零token消耗)

关键差异:

- 没有固定周期轮询,事件到达时才激活

- 模型自己决定这个事件值不值得处理(而非工程代码判断)

- 静默时不消耗 token(OpenClaw 原生 Heartbeat 每次 170k-210k token)

- 用户可以用自然语言配置关注的事件,而非编写 cron 表达式

自然语言配置示例:

用户: "帮我关注 Sentry 上的 P0 错误,有新的就告诉我"

模型: [自主注册 Sentry Webhook] → [收到事件时自主判断严重程度]

→ [P0: 立即通知] [P1: 积累后批量汇报] [P2+: 静默]

这比 OpenClaw 需要手动配置 cron 表达式和 HEARTBEAT.md 清单的方式直观得多。

6.2 上下文组装器(Context Assembler)— 杜绝 Session 熵增

OpenClaw 的问题: 持久 Session 导致 7069 条消息 / 17 万 token 的死亡螺旋。大工具输出(例如 396KB+ JSON)被永久存入 Session,此后每条消息都拖着这个巨大历史块。

NewClaw 的解法: 无持久 Session,按需拉取最小上下文。

每次推理前,上下文组装器按需组装上下文窗口,分为四层:

| 层级 | 内容 | 预估大小 |

|---|---|---|

| 身份层(固定) | 核心人格 + 用户画像 + 精确边界(不可违反的硬约束) | ~2k token |

| 记忆层(按需拉取) | 语义检索相关记忆 + 近期交互摘要 + 用户偏好 | ~5-20k token |

| 任务层(动态) | 当前事件数据 + 工具调用结果 + 相关文件内容 | ~10-50k token |

| 工具层(固定) | 可用工具清单 + 使用格式 | ~3k token |

总计:20k-75k token(远低于 200k 上限),剩余空间留给模型推理和输出。

核心规则:

- 不存储完整对话历史

- 每次交互后,仅将"值得记住的"写入记忆服务

- 模型自主决定什么值得记忆(而非全量保存)

6.3 模型推理层(Model Reasoning)— 自主决策的核心

这是与 OpenClaw 最根本的区别。 OpenClaw 用 SOUL.md / AGENTS.md 硬编码行为;NewClaw 让模型自主推理。

模型可自主做出的决策类型:

- 主动发起对话 — “你昨天提到的那个 API 集成,我查了一下,有个更简单的方案…”

- 反问澄清 — “你要我监控的是生产环境还是测试环境?”

- 主动检索信息 — 调用工具搜索,分析后推送给用户

- 生成方案文档 — 可行性分析 + 架构图

- 提醒和建议 — “根据你的习惯,现在是做周报的时间”

- 静默(最重要的决策) — 模型判断"现在不需要打扰用户" → 不输出

关键设计:模型的"不行动"也是一种有价值的输出。 OpenClaw 的 HEARTBEAT_OK 机制抓住了这个精髓,但 NewClaw 不需要工程代码来实现——模型自己会做出这个判断。

6.4 行动执行器(Action Executor)— Bash 就是一切

CC 的核心发现:模型会自发用 bash 查 git 历史、用 grep 搜代码——最朴素的 glob + grep 效果超过精心设计的 RAG。

NewClaw 的内置工具采用最小集原则:

| 工具 | 用途 |

|---|---|

bash |

万能瑞士军刀 |

read / write |

文件读写 |

web_search |

网络搜索 |

web_fetch |

抓取网页 |

send_message |

向用户发消息 |

memory_read / memory_write |

记忆服务读写 |

没有的工具:

- 专用文件搜索工具(bash + grep/find 即可)

- 专用代码分析工具(模型直接读代码即可)

- 专用日历管理工具(模型调 API 即可)

- 预设的工作流模板

设计哲学来自 Claude Agent SDK 的核心原则:给 Agent 一台电脑,让它像人一样工作。

6.5 记忆服务(Memory Service)— 外部化,非 Session 内

借鉴斯坦福 Generative Agents 的三层记忆架构(记忆流 + 反思 + 规划),NewClaw 的记忆服务设计为独立进程:

| 记忆层 | 内容 | 存储方式 |

|---|---|---|

| Layer 1: 事实记忆 | 用户说过的关键信息、偏好、习惯 | SQLite + FTS5(关键词检索) |

| Layer 2: 情景记忆 | 重要交互的摘要、决策上下文 | 向量数据库(语义检索) |

| Layer 3: 反思记忆 | 模型自主归纳的高阶洞见 | 定期由模型自主生成和更新 |

核心规则:

- 写入由模型自主决定(非全量保存)

- 读取按语义相关性检索(非顺序回放)

- 定期由模型自主做记忆整理(合并 / 遗忘)

- 存储实现:SQLite + sqlite-vec(本地优先,零依赖)

这和 OpenClaw 的做法形成鲜明对比:OpenClaw 把所有对话原始记录存入 Session .jsonl 文件,大工具输出(396KB+ JSON)被永久保存,导致 Session 膨胀不可逆。

6.6 权限边界层(Permission Boundary)— 精确约束,非行为约束

CC 的精髓:不约束模型"怎么想",只约束"什么不能做"。

Level 0(自由区) 随模型能力提升逐步扩大,Level 3(禁止区) 永不缩小——这就是渐进式信任在权限模型上的具体体现。

和 OpenClaw 的 SOUL.md "不可变宪法"相比:

- OpenClaw 试图约束模型"怎么想"(对话风格、行为准则)→ 容易被模型"聪明地"绕过

- NewClaw 只约束模型"什么不能做"(发送外部消息需审批、删除数据被禁止)→ 边界清晰,无法绕过

7、核心交互流程

7.1 用户主动对话

用户 NewClaw 外部服务

│ │ │

│ "帮我分析这个API" │ │

│───────────────────────▶│ │

│ │ │

│ [上下文组装] │

│ - 拉取用户画像和相关记忆 │

│ │ │

│ [模型推理] │

│ "需要先搜索API文档" │

│ │──── web_search ─────────▶│

│ │◀─── 搜索结果 ───────────│

│ │ │

│ [模型推理] │

│ "找到了,分析可行性并画架构图" │

│ │ │

│ 可行性分析报告 + 架构图│ │

│◀───────────────────────│ │

│ │ │

│ [模型自主决定] │

│ "这个分析值得记住" │

│ │──── memory_write ───────▶│

7.2 模型主动触发(关键创新)

外部事件源 NewClaw 用户

│ │ │

│ Sentry P0 告警 │ │

│ (Webhook推送) │ │

│───────────────────────▶│ │

│ │ │

│ [上下文组装] │

│ - 用户关注的监控项 │

│ - 最近的相关对话 │

│ - 当前时间(静默时段?) │

│ │ │

│ [模型推理] │

│ "P0,用户要求立即通知" │

│ "下午3点,不在静默时段" │

│ "先查一下错误详情" │

│ │──── bash: curl sentry ──▶│

│ │◀─── 错误堆栈 ───────────│

│ │ │

│ [模型推理] │

│ "和昨天讨论的auth改动有关" │

│ │ │

│ │ "⚠ 生产P0告警 │

│ │ auth模块空指针异常 │

│ │ 可能和昨天改动有关 │

│ │ 需要我帮你定位吗?" │

│ │────────────────────────▶│

注意两个关键点:

- 模型自主关联了历史上下文(“和昨天讨论的 auth 改动有关”)—— 这是记忆服务的价值

- 模型以提问结尾(“需要我帮你定位吗?”)—— 这是"AI 提案,人类决策"原则的体现

7.3 模型决定不行动(同样重要)

外部事件源 NewClaw 用户

│ │ │

│ GitHub PR bot评论 │ │

│ (Webhook推送) │ │

│───────────────────────▶│ │

│ │ │

│ [模型推理] │

│ "这只是bot自动评论 │

│ 不值得打扰用户" │

│ │ │

│ [静默] │

│ 零额外token消耗 │ (用户无感知)

"不行动"是模型最有价值的决策之一。 OpenClaw 的 HEARTBEAT_OK 机制尝试实现这一点,但仍然需要消耗完整的心跳推理成本(170k-210k tokens)来得出"不需要行动"的结论。NewClaw 中,模型对事件的初步判断只需要极少的 token——不值得处理的事件直接静默。

8、与 OpenClaw / Claude Code 的关键对比

| 维度 | OpenClaw | Claude Code | NewClaw |

|---|---|---|---|

| 调度机制 | Heartbeat + Cron(双系统冲突) | /loop 单机制(用户触发) | 事件驱动(模型自主判断) |

| 触发来源 | 固定时间表(工程硬编码) | 用户命令(被动为主) | 真实事件流(模型决定响应) |

| 行为约束 | SOUL.md / AGENTS.md(文本约束 LLM) | 系统提示词(渐进式删减) | 权限边界层(只约束不能做的) |

| 会话管理 | 永久 Session(熵增不可避免) | 无持久 Session(每次独立) | 无持久 Session + 外部记忆 |

| 主动能力 | 工程触发 + 模型内容(混合但冲突) | 基本无(编码工具定位) | 模型触发 + 模型内容(统一) |

| Token 效率 | 心跳 170-210k/次(Token 黑洞) | 高效(按需使用) | 静默时零消耗(事件驱动按需) |

| 工具设计 | 专用工具 + 配置(TOOLS.md 列举) | bash 万能(模型自由使用) | 最小工具集 + bash 兜底 |

| 产品定位 | 自主 AI 伴侣(工程限制太多) | AI 编程助手(编码场景专精) | 自主 AI 伴侣(CC 哲学 + 伴侣定位) |

NewClaw 的本质定位: 继承 OpenClaw 的产品愿景(主动式 AI 伴侣),但用 Claude Code 的架构哲学重新实现。解决了 OpenClaw 的三大核心问题——调度冲突、Session 熵增、约束失效——同时保留了主动触发的核心能力。

9、六种自主 Agent 设计模式的融合应用

NewClaw 的设计并非凭空创造,而是融合了学术界已验证的六种自主 Agent 设计模式:

9.1 各模式在 NewClaw 中的具体应用

模式 1:ReAct 推理-行动交错(ICLR 2023)

ReAct 的核心创新:推理轨迹(reasoning traces)和任务特定行动(task-specific actions)交错生成。在 ALFWorld 上绝对成功率提升 34%。

→ NewClaw 应用:主循环的核心模式。模型自主决定"下一步做什么",无需预定义执行路径。

模式 2:Voyager 终身学习(NVIDIA, 2023)

Voyager 在 Minecraft 中实现了无人干预的持续自主探索,科技树关键里程碑解锁速度快 15.3 倍。核心洞察:不给 Agent 目标,给它工具和环境。

→ NewClaw 应用:记忆服务的技能积累。模型自主发现"下一步该学什么",积累可复用的技能和知识。

模式 3:Reflexion 语言化强化学习(NeurIPS 2023)

用自然语言替代梯度更新,单个 LLM 同时承担生成器、精炼器和反馈提供者。HumanEval 编程基准达到 91% pass@1,超越 GPT-4 的 80%。

→ NewClaw 应用:反思记忆层。模型将失败经验转化为高阶洞见,无需任何参数更新或训练基础设施。

模式 4:Generative Agents 记忆架构(Stanford, UIST 2023)

25 个 Agent 在虚拟小镇中自主传播邀请、结识新朋友、互相邀约——完全由模型自主行为驱动。

→ NewClaw 应用:三层记忆服务(事实 → 情景 → 反思)直接借鉴此架构。工程只提供存储接口,不干预决策逻辑。

模式 5:Self-Refine 自我精炼(NeurIPS 2024)

同一个 LLM 完成生成、反馈、精炼三个角色的循环,跨 7 项任务提升约 20%。

→ NewClaw 应用:行动执行器的迭代模式。CC 的核心循环(执行工具 → 反馈结果 → 继续推理)本质就是 Self-Refine。

模式 6:事件驱动自主触发(Confluent Streaming Agents, 2025)

Agent 监控实时数据流,基于业务事件触发行动,而非人类请求。颠覆传统的请求-响应模型。

→ NewClaw 应用:事件收集器的核心设计。真实事件触发,非固定时间表。模型自主决定响应级别。

9.2 Anthropic 官方的实证支持

Anthropic 在《Building Effective Agents》中明确指出:

“最成功的实现不是使用复杂框架或专业库。相反,他们是用简单、可组合的模式构建的。”

这正是 NewClaw 的设计准则:不使用 LangChain、LangGraph 等框架增加抽象层,直接调用 LLM API,用最简单的代码实现最强大的能力。

来自 SWE-bench 的实证数据也支持这一点:同样的模型换不同脚手架,性能差距 11-44%,但"Agentless"简化方法依然有竞争力——过度工程化不是出路。

10、技术选型

| 组件 | 选型 | 理由 |

|---|---|---|

| 运行时 | Node.js / Bun | 单线程 + 事件驱动天然契合主循环设计 |

| 模型接口 | Claude API(主推理)+ 本地小模型(分流) | 主推理用最强模型,简单判断用轻量模型 |

| 记忆存储 | SQLite + sqlite-vec | 本地优先,零依赖,向量检索内嵌 |

| 事件总线 | 内存 EventEmitter | 轻量,单进程内够用 |

| 消息渠道 | Telegram Bot API / Discord.js / … | 按需接入 |

| Webhook | 内置 HTTP Server | 接收外部事件 |

| 沙箱 | Docker / macOS Sandbox | Bash 执行隔离 |

| 部署 | 单进程,systemd / pm2 | 保持简单 |

刻意不使用的技术:

- Redis / RabbitMQ(内存队列足够)

- 独立向量数据库服务(sqlite-vec 内嵌即可)

- 微服务架构(单进程,保持简单)

- LangChain 等框架(直接调 API)

- 数据库服务器(SQLite 本地文件即可)

Karpathy 的 autoresearch 项目给了我很大的信心:630 行 Python 代码,一晚上跑 50 个实验,全程无人工干预。 最强大的 Agent 不需要复杂的架构——只需要清晰的目标、合适的工具、和足够智能的模型。

11、总结与展望

11.1 核心公式

NewClaw = Claude Code 的架构哲学(单循环 + 渐进式信任 + bash 万能)

+ OpenClaw 的产品定位(主动式 AI 伴侣 + 多平台适配)

+ 事件驱动(替代 Heartbeat/Cron 双系统冲突)

+ 渐进式信任(替代 SOUL.md 硬约束)

+ 外部记忆服务(替代 Session 熵增)

11.2 一句话设计哲学

OpenClaw 试图用工程约束驯服模型的"过度智能",结果工程本身成了最大的问题。NewClaw 反其道而行:给模型环境和工具,让它自己决定做什么——就像 Claude Code 给了模型一个 bash,模型就自己学会了查 git 历史。

11.3 展望

CC vs Cursor 的这场对决告诉我们一个深刻的趋势:AI 产品的设计范式正在从"约束模型"向"释放模型"转变。

- 2023-2024:工程化约束弥补模型不足(Cursor 路线)

- 2025-2026:最少约束释放模型潜力(Claude Code 路线)

- 未来:当模型能力继续提升,我们需要的工程化会越来越少

Boris Cherny 的那句话可能是 AI 产品设计领域最重要的一句话:

“Don’t build for today’s model, build for the model six months from now.”

NewClaw 正是这句话在 AI 伴侣产品领域的实践。我们不知道六个月后的模型有多强,但我们可以确定的是:给它更少的约束、更大的空间,它会做得比我们预想的更好。

参考资料:

- Boris Cherny 创作者访谈

- Pragmatic Engineer: Building Claude Code with Boris Cherny

- Every.to: How to Use Claude Code Like the People Who Built It

- Mikhail Shilkov: Claude Code 2.0 System Prompt Changes

- ZenML: Claude Code Agent Architecture

- Anthropic: Building Effective Agents

- Claude Agent SDK 官方文档

- ReAct: Synergizing Reasoning and Acting (ICLR 2023)

- Voyager: Open-Ended Embodied Agent (NVIDIA, 2023)

- Reflexion: Verbal Reinforcement Learning (NeurIPS 2023)

- Generative Agents: Interactive Simulacra (UIST 2023)

- Confluent: The Future of AI Agents Is Event-Driven

- Karpathy: autoresearch

- Medium: Cursor’s Dead and Claude Code Killed It

- OpenClaw Issue #17442 - Subagent completion callback infinite loop

🚀 持续探索 AI 与前沿技术 分享大模型应用、软件开发实战与行业洞察。 欢迎关注公众号 【龙哥AI】,加入 7000+ 技术同行的交流圈! 🌟 探索技术边界,让开发更有效率 |

|

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)