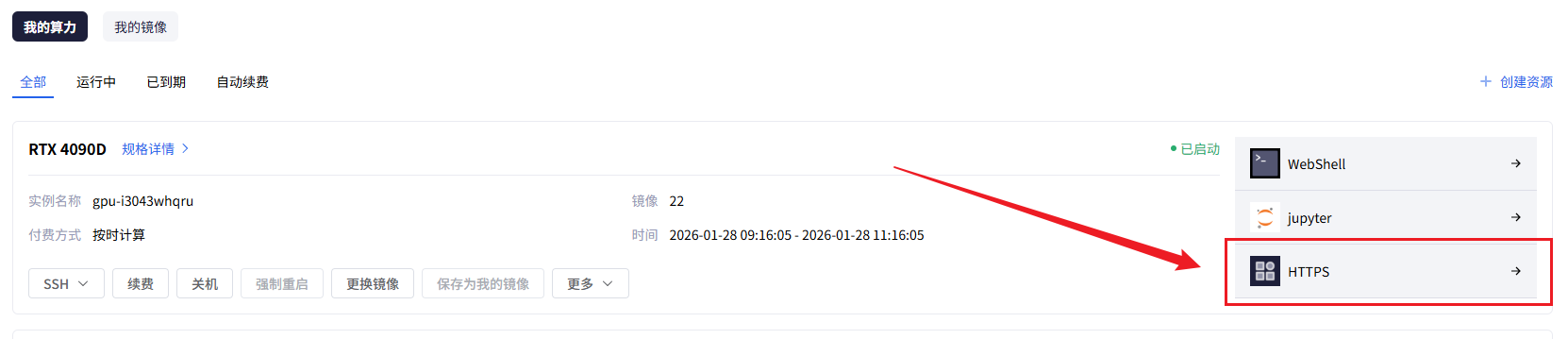

Clawdbot+Qwen3-32B部署案例:某AI中台团队30分钟完成私有化AI助手上线

本文介绍了如何在星图GPU平台自动化部署Clawdbot整合Qwen3:32B代理直连Web网关配置Chat平台镜像,快速构建企业级私有AI助手。该方案支持30分钟内完成部署,提供安全可控的对话交互功能,适用于企业内部知识问答、任务协助等场景,保障数据完全私有化。

Clawdbot+Qwen3-32B部署案例:某AI中台团队30分钟完成私有化AI助手上线

企业内部想要快速部署一个私有化AI助手,但担心技术复杂、耗时太长?本文分享一个真实案例:某AI中台团队仅用30分钟就完成了Clawdbot与Qwen3-32B的整合部署,实现了安全可控的私有化AI助手。

1. 项目背景与需求

某企业的AI中台团队需要为内部提供一个私有化部署的AI助手,主要需求包括:

- 数据安全:所有对话数据和模型推理都在内网完成,不经过外部服务器

- 快速部署:希望能在1小时内完成从零到可用的全过程

- 易于使用:提供类似ChatGPT的聊天界面,降低使用门槛

- 成本可控:利用现有硬件资源,避免额外采购

团队选择了Clawdbot作为前端聊天平台,Qwen3-32B作为大语言模型,通过巧妙的网络配置实现了快速部署。

2. 技术方案概述

整个方案的核心架构非常简单清晰:

graph LR

A[用户] --> B[Clawdbot Web界面]

B --> C[8080端口]

C --> D[内部代理]

D --> E[18789网关端口]

E --> F[Ollama API]

F --> G[Qwen3-32B模型]

G --> F

F --> E

E --> D

D --> C

C --> B

B --> A

方案特点:

- 前端使用Clawdbot提供友好的聊天界面

- 后端通过Ollama部署Qwen3-32B模型并提供API接口

- 通过内部代理实现端口转发,确保网络安全

- 全部组件私有化部署,数据不出内网

3. 详细部署步骤

3.1 环境准备与依赖安装

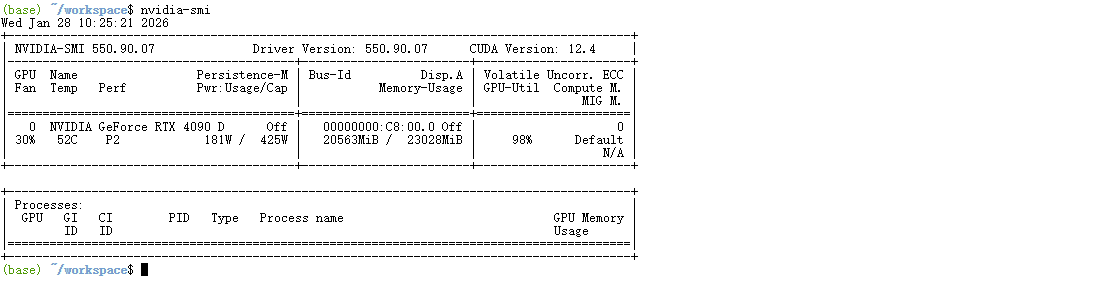

首先确保服务器满足基本要求:

- Ubuntu 18.04+ 或 CentOS 7+ 系统

- Docker 和 Docker Compose 已安装

- 至少100GB可用磁盘空间(用于存放模型权重)

- NVIDIA GPU(推荐)或足够的CPU资源

安装必要的组件:

# 安装Docker(如果尚未安装)

curl -fsSL https://get.docker.com -o get-docker.sh

sudo sh get-docker.sh

# 安装Docker Compose

sudo curl -L "https://github.com/docker/compose/releases/download/v2.24.0/docker-compose-$(uname -s)-$(uname -m)" -o /usr/local/bin/docker-compose

sudo chmod +x /usr/local/bin/docker-compose

3.2 Ollama与Qwen3-32B部署

通过Ollama部署Qwen3-32B模型:

# 拉取Ollama镜像

docker pull ollama/ollama

# 启动Ollama服务

docker run -d -v ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

# 下载并部署Qwen3-32B模型

docker exec -it ollama ollama pull qwen2:32b

这个过程可能需要一些时间,取决于网络速度和硬件性能。32B模型的大小约为60GB,下载时间可能较长。

3.3 Clawdbot部署与配置

部署Clawdbot作为前端聊天界面:

# 创建部署目录

mkdir -p /opt/clawdbot && cd /opt/clawdbot

# 创建docker-compose.yml文件

cat > docker-compose.yml << EOF

version: '3.8'

services:

clawdbot:

image: clawdbot/clawdbot:latest

ports:

- "8080:8080"

environment:

- API_BASE_URL=http://localhost:11434

- MODEL_NAME=qwen2:32b

restart: unless-stopped

EOF

# 启动服务

docker-compose up -d

3.4 代理与网络配置

配置内部代理实现端口转发,这是确保服务可访问的关键步骤:

# 安装并配置nginx作为反向代理

sudo apt install nginx -y

# 创建代理配置

cat > /etc/nginx/sites-available/clawdbot-proxy << EOF

server {

listen 18789;

server_name localhost;

location / {

proxy_pass http://localhost:8080;

proxy_set_header Host \$host;

proxy_set_header X-Real-IP \$remote_addr;

proxy_set_header X-Forwarded-For \$proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto \$scheme;

}

}

EOF

# 启用配置并重启nginx

ln -s /etc/nginx/sites-available/clawdbot-proxy /etc/nginx/sites-enabled/

nginx -t && systemctl restart nginx

4. 验证与测试

完成部署后,进行简单的功能验证:

# 检查Ollama服务是否正常

curl http://localhost:11434/api/tags

# 检查Clawdbot服务状态

curl -I http://localhost:8080

# 测试代理转发

curl -I http://localhost:18789

如果一切正常,现在可以通过浏览器访问 http://服务器IP:18789 来使用AI助手了。

Clawdbot启动界面,简洁直观的聊天窗口

5. 实际使用效果

部署完成后,团队获得了功能完整的私有化AI助手:

Clawdbot使用界面,支持多轮对话和历史记录

核心功能特点:

- 自然对话:基于Qwen3-32B强大的语言理解能力,对话流畅自然

- 知识丰富:32B参数模型具备广泛的知识覆盖和推理能力

- 完全私有:所有数据在企业内部流转,无数据泄露风险

- 高性能:本地部署提供低延迟响应,体验流畅

6. 技术细节解析

6.1 模型部署架构

内部部署架构图,展示各组件关系

关键组件说明:

- Qwen3-32B模型:通义千问团队开发的大语言模型,32B参数规模

- Ollama:提供模型管理和API服务的轻量级框架

- Clawdbot:基于Web的聊天界面,提供用户交互功能

- Nginx代理:实现端口转发和网络隔离,增强安全性

6.2 网络流量路径

用户请求的完整处理流程:

- 用户通过浏览器访问Clawdbot界面(18789端口)

- Nginx代理将请求转发到Clawdbot服务(8080端口)

- Clawdbot将用户输入发送到Ollama API(11434端口)

- Ollama调用Qwen3-32B模型进行推理

- 生成结果沿原路径返回给用户

这种设计确保了网络流量的可控性和安全性。

7. 遇到的问题与解决方案

在部署过程中,团队遇到并解决了以下典型问题:

问题1:模型加载内存不足

- 症状:Ollama服务频繁重启,日志显示OOM(内存不足)错误

- 解决方案:增加交换空间或使用量化版本的模型

# 增加交换空间(如果使用CPU部署)

sudo fallocate -l 32G /swapfile

sudo chmod 600 /swapfile

sudo mkswap /swapfile

sudo swapon /swapfile

问题2:代理配置错误

- 症状:能够访问8080端口但无法访问18789端口

- 解决方案:检查防火墙设置和nginx配置语法

# 检查防火墙设置

sudo ufw status

sudo ufw allow 18789

# 检查nginx配置

nginx -t

问题3:模型响应速度慢

- 症状:用户查询需要很长时间才能得到响应

- 解决方案:优化硬件配置或使用更小的模型版本

8. 优化建议与扩展方案

基于实际使用经验,提供以下优化建议:

8.1 性能优化

对于GPU环境:

# 使用GPU加速版本

docker run -d --gpus all -v ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

# 使用量化模型提高速度

docker exec -it ollama ollama pull qwen2:7b

对于CPU环境:

- 使用更小的模型版本(如7B或14B)

- 增加系统交换空间

- 调整Ollama的并行参数

8.2 功能扩展

添加多模型支持:

# 修改Clawdbot配置支持多模型

environment:

- MODEL_LIST=qwen2:32b,qwen2:7b,llama3:70b

- DEFAULT_MODEL=qwen2:32b

添加用户认证:

# 在nginx配置中添加基础认证

sudo apt install apache2-utils

sudo htpasswd -c /etc/nginx/.htpasswd username

# 更新nginx配置添加认证

auth_basic "Restricted Access";

auth_basic_user_file /etc/nginx/.htpasswd;

9. 总结与价值体现

通过这个案例,我们验证了Clawdbot+Qwen3-32B方案的几个核心价值:

部署效率极高:从零开始到完全可用仅需30分钟,大幅降低部署门槛。即使是运维经验不多的团队也能快速上手。

成本效益显著:利用现有硬件资源,无需额外采购昂贵的企业级AI解决方案。Ollama和Clawdbot都是开源工具,无软件许可费用。

安全可控:所有数据在企业内部流转,完全符合数据安全和合规要求。特别适合处理敏感信息的金融、医疗等行业。

扩展灵活:架构设计允许轻松扩展更多功能,如多模型支持、用户管理、访问控制等,满足企业级应用需求。

维护简单:基于D容器化部署,升级、迁移、备份都非常方便,大大降低了长期维护成本。

这个案例证明,企业私有化AI助手的部署不再是大厂的专利,任何有基本技术能力的团队都能快速构建属于自己的AI助手。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)