aiAgent整体梳理

本文分析了AI Agent架构中的Context机制,指出LLM的上下文仅存在于单次推理中,不会跨请求保存。Agent项目的核心复杂度在于Context层的构建与管理,而非模型本身。文章详细阐述了Agent架构的五个关键层次:基础模型层、Prompt/Context管理层、记忆层、工具与环境层以及规划与推理层。重点介绍了Context的组成要素、记忆系统的三种类型(短期、长期和语义记忆)及其管理策

LLM是有 Context 概念的,但这个 Context 只存在于“当前一次推理中”。

LLM没有跨请求的 Context(不会自己记住历史)。

请求开始 → 模型读取Context → 生成回答 → 请求结束 → Context消失

AI Agent 项目80%的复杂度,其实都在 Context 层,而不是模型层。

Agent其实就是在 不断重建上下文循环。

构建Context

→ 调用LLM

→ 得到结果

→ 更新Context

→ 再调用LLM

架构分层

AI Agent 架构与 Context 机制笔记

1. LLM 与 Context 的核心概念

LLM 是有 Context(上下文) 概念的,但这个 Context

只存在于当前一次推理中。

LLM 不会跨请求记住历史。

流程:

请求开始

→ 模型读取 Context

→ 生成回答

→ 请求结束

→ Context 消失

因此:

AI Agent 项目 80% 的复杂度其实都在 Context 层,而不是模型层。

Agent 本质是在不断 重建上下文循环:

构建 Context

→ 调用 LLM

→ 得到结果

→ 更新 Context

→ 再调用 LLM

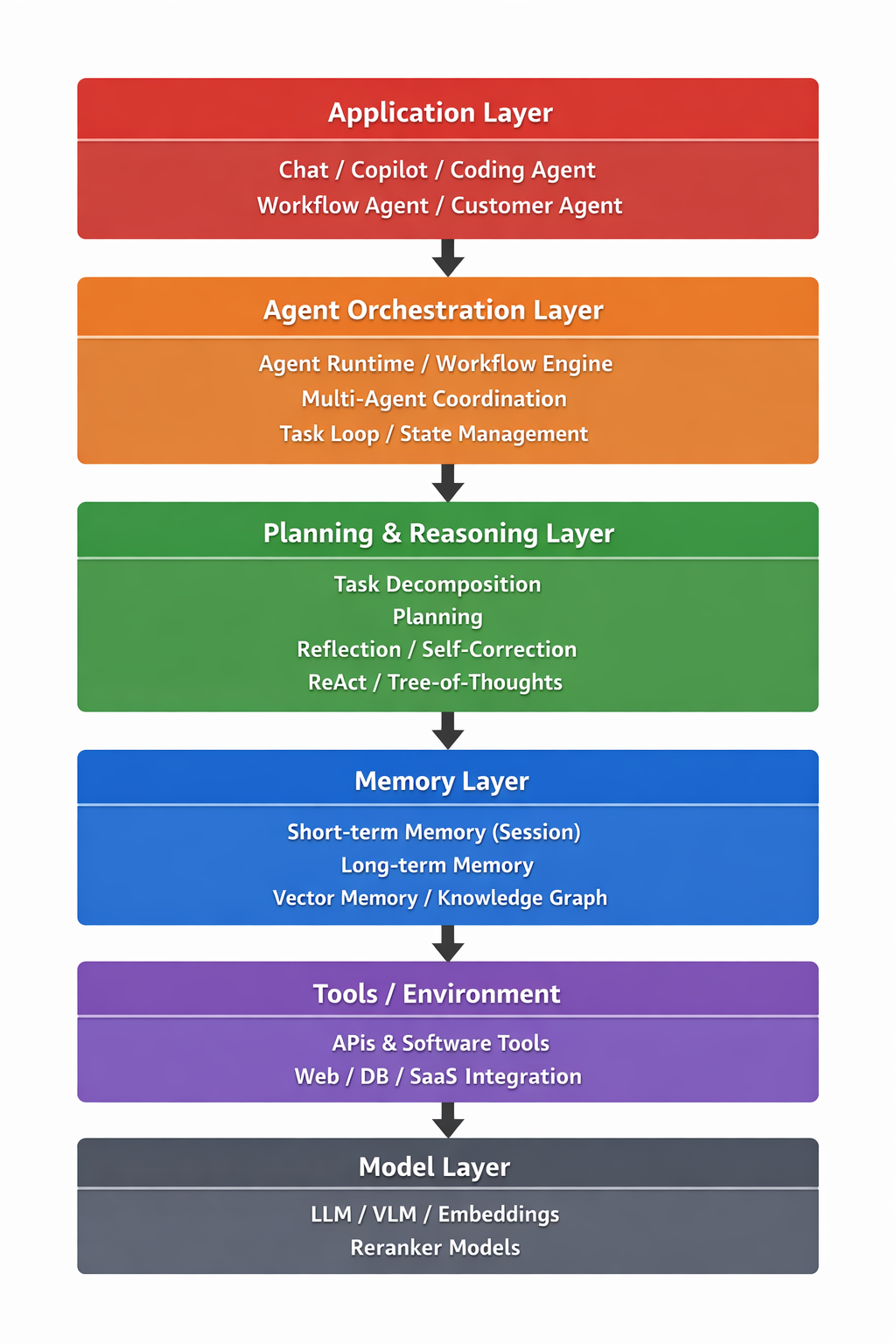

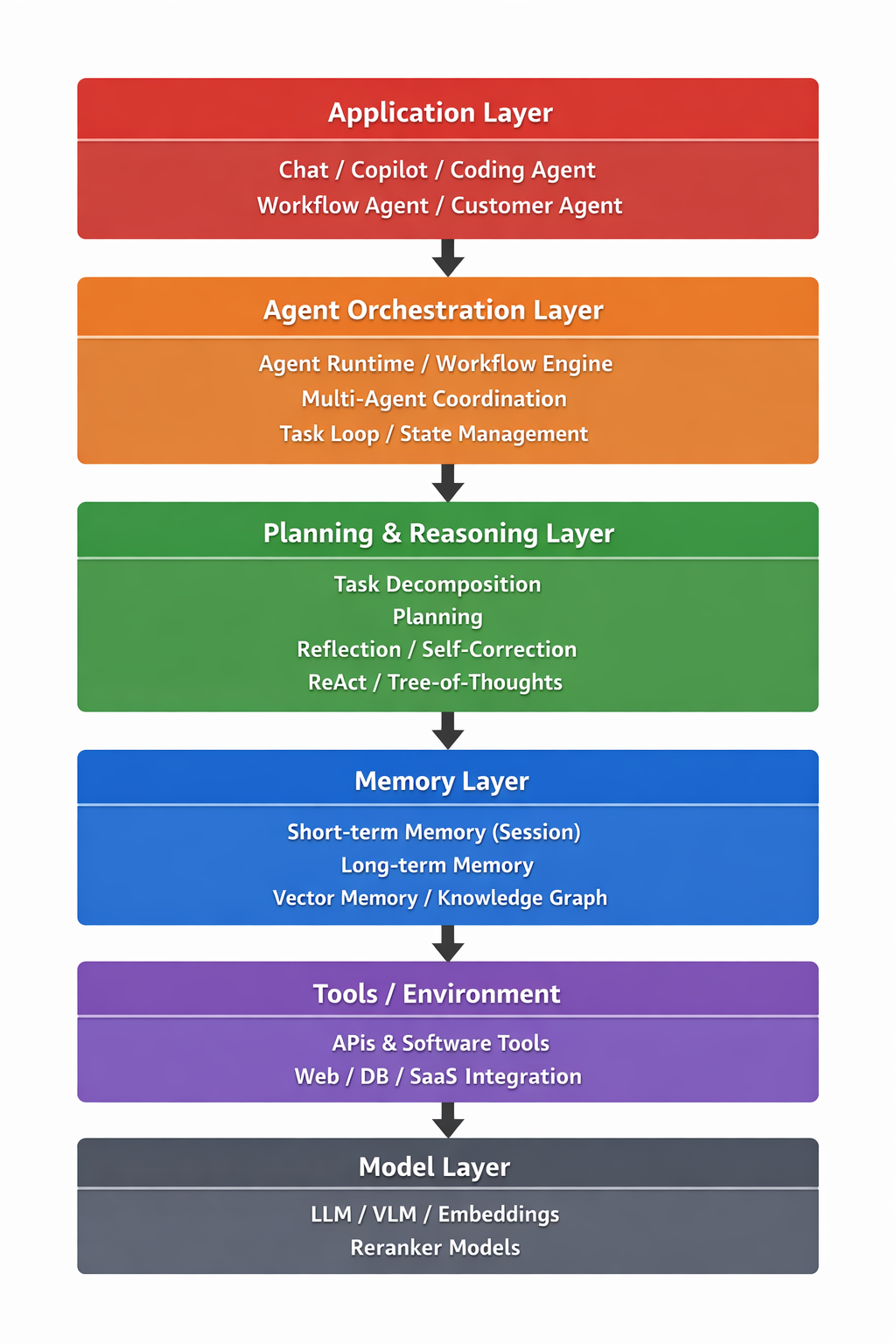

Agent 架构分层

一、Agent 基础模型层(Model Layer)

核心:大模型

组件包括: - 大模型

典型模型:

- GPT-4

- Claude 3

- Gemini 1.5

职责:

- 语言理解

- 推理

- 内容生成

- 工具调用决策

二、Prompt / Context 管理层

核心:上下文构建

Prompt / Context 管理层的本质:

把"世界的信息"压缩成"模型能理解的一段文本上下文"。

工作流程:

收集信息

→ 选择信息

→ 组织结构

→ 生成最终输入

→ 发送给 LLM

什么是 Context

Context = 发送给模型的一整段输入信息

Context = Prompt + 其他信息

LLM 在推理时只看到:

一整段文本 → 生成下一段文本

因此 Context 就是 整段输入文本。

Context 的组成

Context 不只是历史对话,还可能包含:

Context =

System Prompt

+ Conversation History

+ User Query

+ Retrieved Knowledge (RAG)

+ Memory

+ Tool Description

+ Instructions

示例

System:

你是一个专业金融分析师

History:

User: 帮我分析苹果公司

Assistant: 好的

User:

这个公司去年收入多少?

Knowledge:

Apple 2023 revenue: 383 billion USD

Instruction:

如果有数据直接回答

这一整块文本就是 Context。

Context 管理模块

常见模块:

- Prompt Template

- Context Window 管理

- RAG 上下文拼接

- Prompt 策略

Context 优化策略

- Few-shot

- Chain-of-Thought

- System Prompt

- Tool Prompt

最终目标:

Context = Prompt + History + Knowledge + Memory + Tools

三、记忆层(Memory Layer)

Agent 的 长期与短期记忆系统。

Memory 的三种类型

Agent 系统通常有三种记忆。

1. 短期记忆(Short-term Memory)

本质:

当前会话的历史对话。

示例:

User: 你好

Assistant: 你好

User: 我刚刚说什么

系统会保存:

history = [

User: 你好

Assistant: 你好

]

然后拼进 Context。

特点:

- 生命周期:当前会话

- 存储内容:聊天记录

- 常见实现:数组 / Redis

2. 长期记忆(Long-term Memory)

本质:

保存用户的长期信息。

例如:

User profile:

Name: Tom

Interest: Python

Job: Data Scientist

特点:

- 生命周期:长期

- 存储:数据库

- 用于个性化回答

3. 语义记忆(Vector Memory)

这是 Agent 系统中 最重要的一种记忆。

本质:

把文本转换为向量并进行语义检索。

流程:

文本

↓

Embedding

↓

向量数据库

↓

相似度检索

常见向量数据库:

- Pinecone

- Weaviate

- Milvus

Memory 工作流程

用户输入

↓

读取 Memory

↓

检索相关记忆

↓

加入 Context

↓

LLM 推理

↓

生成回答

↓

写入新记忆

流程图:

User

↓

Agent

↓

Memory Retrieval

↓

Context 构建

↓

LLM

↓

Response

↓

Memory Update

Memory 写入策略

不是所有信息都会被存储。

常见策略:

1. 用户信息

例如:

- 用户名字

- 兴趣

- 职业

2. 重要事件

例如:

- 用户完成任务

- 用户设定目标

3. 知识总结

例如:

- 会话总结

Memory 压缩(非常重要)

随着对话增加,历史记录会变得很长,因此需要压缩。

常见方法:

Conversation Summary

示例:

原始:

20轮对话

总结:

用户在讨论 AI Agent 架构

这样可以显著节省 Token。

四、工具与环境层(Tools / Environment Layer)

这一层负责 Agent 执行任务的能力。

工具类型

API 工具

例如:

- 搜索

- 天气

- 金融数据

软件工具

例如:

- 代码执行

- 数据分析

- 文档处理

外部系统

例如:

- CRM

- 数据库

- SaaS 系统

典型工具

- Wolfram Alpha

- Slack

- Google Search

五、规划与推理层(Planning & Reasoning Layer)

这是 Agent 与普通 Chatbot 最大区别的层。

核心能力:

- Task Decomposition(任务拆解)

- Planning(规划)

- Reflection(自我反思)

- ReAct Loop

1. ReAct 推理模式

ReAct = Reason + Act

含义:

思考 → 行动

循环结构:

Thought

Action

Observation

示例:

Thought: 我需要查天气

Action: search_weather(Tokyo)

Observation: 20°C

Thought: 我可以回答用户

2. Chain-of-Thought 推理

逐步推理。

示例:

问题:

小明有3个苹果又买2个一共有多少?

推理:

3 + 2 = 5

3. Tree-of-Thought

复杂任务时模型会探索多个方案。

示例:

方案A

方案B

方案C

然后选择最优方案。

常见研究来源:

- Google Brain

- Stanford University

常见方法:

- ReAct

- Plan-and-Execute

- Tree of Thoughts

- Graph of Thoughts

六、Agent 控制与编排层(Orchestration Layer)

Orchestration Layer:

控制整个 Agent 如何运行的系统。

主要组件

- Agent Loop

- Tool Router

- Workflow Engine

- Multi-Agent Coordination

典型框架:

- LangChain

- AutoGPT

- CrewAI

- Semantic Kernel

Agent 执行流程

User Input

↓

Plan

↓

Tool Selection

↓

Execution

↓

Memory Update

↓

Next Step

核心模块

1. Agent Loop

Agent 的循环执行机制:

思考 → 行动 → 观察 → 再思考

示例:

Thought: 我需要天气

Action: 调用天气 API

Observation: 20°C

Thought: 可以回答用户

2. Tool Router

负责选择调用哪个工具。

例如系统有多个工具:

- search_api

- weather_api

- database_query

用户问:

东京天气

Router 会选择:

weather_api

3. Workflow Engine

负责管理复杂任务流程。

示例任务:

写市场分析报告

Workflow:

Step1 搜索行业数据

Step2 分析竞争对手

Step3 生成报告

4. Multi-Agent Coordination

用于 多 Agent 协作。

示例:

Research Agent → 收集资料

Writer Agent → 写报告

Reviewer Agent → 修改

Orchestration 负责协调。

七、应用层(Application Layer)

最终面向用户的产品形态。

常见类型:

- Chat Agent

- Coding Agent

- Data Agent

- Research Agent

- Customer Service Agent

典型产品:

- ChatGPT

- Devin

- Perplexity AI

常见 Agent 总体架构

Application Layer

│

Orchestration Layer

│

Planning & Reasoning

│

Memory Layer

│

Tools / Environment

│

Model Layer

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)