模型多如牛毛?如何在大规模生产环境中“稳住”ML 系统

你有没有想过,大厂那些成熟的 AI 产品,背后到底是怎么跑起来的?

在 AI 行业摸爬滚打 10 年,我深刻领悟到一个真理:在 Notebook 里跑出来的模型,顶多算个数学假设。 只有当它的预测结果真正影响了用户、转化成了订单,它才叫“产品”。

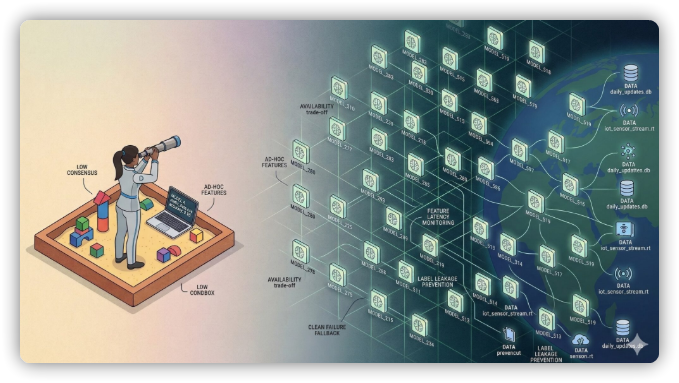

以前我们聊的是“单模型上线”,但现在,大厂拼的是规模化——也就是同时管理几十甚至几百个 ML 项目。这个阶段,我们已经从“实验室玩票”进化到了“基建战争”。“部署模型”只是基本功,如何让这一大摊子模型稳如泰山、不出乱子,才是真正的技术分水岭。

一、 走出“温室”:高可用性高过一切

搞大规模 ML,首先得扔掉那种“实验室思维”。在实验室里,数据是静态的,模型偏了,大不了停下来重练。

但在生产环境,CAP 定理(一致性、可用性、分区容错性)就是悬在头上的达摩克利斯之剑。当你有上百个模型同时在线时,想追求三者完美根本不现实。你必须做出取舍,而高可用性永远是第一优先级。

为什么? 因为模型多了,每天总有几个会“抽风”。要是模型一波动就停服,你的产品估计一半时间都在挂彩。

避坑指南: 既然无法避免故障,就要学会“优雅降级(Fail Cleanly)”。 比如推荐系统:主模型崩溃时,别给用户弹个 404 或者报错信息,直接切换到“热门 Top 10”这种保底方案。虽然不够精准,但起码系统没死,用户体验没断。

二、 监控迷局:为什么传统指标在大规模环境下会“哑火”?

你可能会觉得,盯着准确率看就行了。但在大规模实战中,传统的监控策略往往会失效:

没有“客观真理”: 图像识别(是猫还是狗)好判断。但在广告推荐里,用户没点,是因为模型算错了,还是用户刚好手滑?这种模糊性让监控变得极难。

特征堆砌陷阱: 因为测不准,很多团队就开始疯狂往里塞特征,试图靠“数据量”解决不确定性,结果反而拖慢了系统。

隐形天花板: 有时数据本身的噪点就摆在那,你拼命卷那 0.1% 的提升,可能只是在浪费算力。

底层逻辑: 正因为在规模化场景下很难实时抓到“真相”,我们才更需要保底机制。我们要预设模型随时可能失灵,并构建一套即便在“模糊地带”也能撑住场子的系统。

三、 撞上“工程墙”:算力与架构的性价比博弈

策略聊完了,没基建支撑就是耍流氓。大规模 ML 拼到最后,全是工程活。

模型越复杂,对底层硬件的压力就越大。这里有三个硬指标你必须考虑:

云端 vs 本地: 权衡算力成本与数据控制权。

分层计算策略: 你不能把所有模型都塞进顶级 GPU,那会瞬间烧光预算。聪明的架构是:用便宜的 CPU 跑保底方案,把昂贵的显存留给那些核心的“利润中心”。

极致优化: 降级切换必须在毫秒级完成。这就要求你不能只会写 Python,还得懂点底层编译。

老兵建议: 生产级别的 AI 任务对服务器稳定性极其挑剔。当你的模型组合变得庞大时,Hostease 的高性能独立服务器是理想选择,其可靠的硬件冗余和极致的响应带宽,能确保你在进行大规模推理或瞬时切换降级方案时,底层基座始终稳如磐石。

四、 提防“标签泄露”:隐蔽的自欺欺人

即便你的工程能力拉满,标签泄露也能让你死得不明不白。在单项目里这很好查,但在几十条数据流交叉的大环境下,泄露几乎是无形的。

经典案例: 预测用户是否会退订。 模型在线下跑出了 99% 的惊人分数。结果发现:数据库有个逻辑,只要用户点下“取消”,就会清空其“最后登录日期”。 模型学到了这个“未来信息”:只要日期为空,用户就必走。但在真实预测的那一刻,这个日期还没被清空呢。

防坑指南:

监控数据延迟: 别只看数值,要看数据写入的时间节点。

“未来测试”: 永远问一句:在发起预测的这一毫秒,我真的能拿到这个值吗?

五、 终极保障:影子部署与人工反馈

最后,你需要给你的系统加一把“保险锁”。

影子部署(Shadow Deployment): 这是大厂标配。新模型上线后先“隐身”跑一周,只输出结果不展示给用户。等拿结果跟真实数据对齐、验证稳了,再正式上位。

人机闭环: 关键模型不能全靠自动化。如果系统连续好几天都在跑“保底逻辑”,就得有人介入看看主模型是不是彻底趴窝了。

总结:大规模 ML 管理的五大铁律

在线比精准更重要: 优先保住可用性,学会优雅降级。

指标要看长远: 接受单点监控的模糊性,注重系统韧性。

基建要扎实: 选择高性能、高在线率的基础设施,别让硬件成为木桶的短板。

死磕数据时序: 严防标签泄露,拒绝“马后炮”式预测。

不验证不转正: 影子测试是模型上线的最后一道防火墙。

规模化管理不是简单的堆量,而是一场关于容错、成本与工程美学的综合博弈。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)