Qwen3-32B多场景落地:Clawdbot赋能新媒体运营热点追踪与文案生成

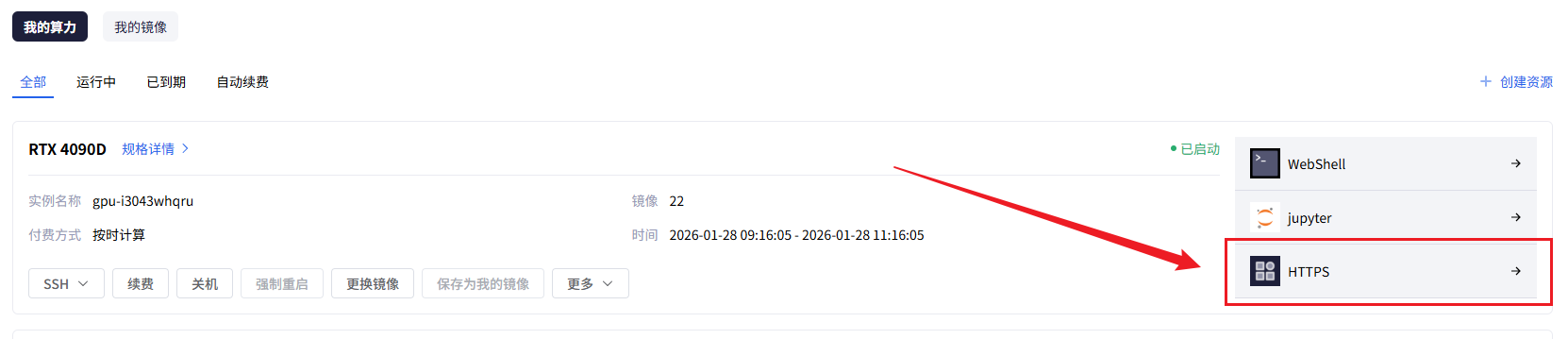

本文介绍了如何在星图GPU平台上自动化部署Clawdbot 整合 Qwen3:32B 代理直连 Web 网关配置Chat平台镜像,快速构建面向新媒体运营的智能文案生成系统。用户可一键启用热点追踪、多平台文案扩写与批量内容生产,显著提升舆情响应与内容创作效率。

Qwen3-32B多场景落地:Clawdbot赋能新媒体运营热点追踪与文案生成

1. 为什么新媒体运营需要Qwen3-32B这样的大模型?

做新媒体的朋友都清楚,每天睁眼第一件事就是刷热搜、盯数据、赶时效——热点来得快,消失得更快。一条爆款内容背后,往往是团队反复修改十几稿、查资料两小时、配图改五版的硬仗。更现实的问题是:人工盯热点容易漏,写文案容易同质化,批量产出又难保质量。

这时候,一个真正能“读懂”网页、理解语境、写出有网感又不失专业度的大模型,就不是锦上添花,而是刚需。

Qwen3-32B 是通义千问系列中参数量达320亿的旗舰版本,它在长文本理解、多轮对话连贯性、中文语义深度把握上明显优于前代。但光有模型不够——它得能“接得住”真实业务流:要能实时抓取网页动态,要能嵌入工作界面一键调用,还要让运营同学不用写代码、不配环境、不看文档,打开就能用。

Clawdbot 正是这个关键“连接器”。它不训练模型,也不替换平台,而是以轻量代理方式,把私有部署的 Qwen3-32B 模型能力,稳稳地“插”进新媒体日常操作流里。不是让你去学API,而是让模型来适应你的节奏。

下面我们就从实际怎么用开始,说清楚它如何把“追热点”和“写文案”这两件最耗神的事,变成点几下鼠标就能完成的动作。

2. Clawdbot × Qwen3-32B:三步打通热点追踪到文案输出链路

2.1 架构很轻,落地很实:代理直连 Web 网关的设计逻辑

很多人一听“私有部署大模型”,第一反应是:要GPU、要Linux、要配Docker、要调端口……其实完全不必。Clawdbot 的设计思路很务实:模型归模型,交互归交互,中间只留一条干净、可控、可审计的通道。

整个链路只有三层,没有冗余组件:

- 底层:Qwen3-32B 模型通过 Ollama 在本地服务器运行,暴露标准

/api/chat接口(默认http://localhost:11434) - 中间层:Clawdbot 启动一个轻量代理服务,监听

8080端口,接收前端请求后,自动转发至 Ollama,并做必要字段转换(比如把 Chat 平台的 message 格式转为 Ollama 所需的messages数组) - 上层:Web 页面通过

http://your-server:8080/v1/chat/completions直连调用,所有请求最终经由18789网关统一出口(用于日志记录、限流、权限校验)

这个结构的好处是:

运营人员永远只面对一个 URL 和一个输入框;

IT 运维只需维护 Ollama + Clawdbot 两个进程,无额外依赖;

模型升级时,只需重载 Ollama 模型,前端和代理层零改动。

不需要记住端口号,也不用区分

v1还是v2接口——Clawdbot 把所有技术细节“藏”在了代理层后面,你看到的永远是“能用”。

2.2 启动只需一行命令:5分钟完成本地部署

Clawdbot 已打包为单二进制文件,无需 Python 环境,不依赖 Node.js,Windows/macOS/Linux 全平台支持。

假设你已安装好 Ollama 并成功加载 Qwen3-32B:

ollama run qwen3:32b

接下来,在同一台机器上执行:

# 下载 clawdbot(以 Linux x64 为例)

curl -L https://releases.example.com/clawdbot-v1.2.0-linux-amd64 -o clawdbot

chmod +x clawdbot

# 启动代理服务(自动监听 8080,转发至本地 Ollama)

./clawdbot --ollama-host http://localhost:11434 --port 8080

启动成功后,终端会显示:

Clawdbot proxy started on :8080

➡ Forwarding to Ollama at http://localhost:11434

Web UI available at http://localhost:8080/ui

此时打开浏览器访问 http://localhost:8080/ui,就能看到简洁的 Chat 页面——没有登录页、没有设置项、没有弹窗广告,就是一个干净的对话框,左栏输入,右栏出结果。

小贴士:如果你的服务器有公网IP,只需加一道 Nginx 反向代理,就能让整个编辑部同事共享使用,无需每人部署一套。

2.3 真实使用页面:像用微信一样用大模型

进入 /ui 页面后,界面极简:顶部是模型状态提示(如 “Qwen3-32B · 响应中…”),中部是双栏布局——左侧是输入区,右侧是带时间戳的对话流。

你可以直接粘贴网页链接、热搜标题、甚至截图OCR后的文字,然后输入指令,例如:

请分析这条微博的传播情绪,并生成3条不同风格的评论回复(幽默/专业/共情)

或

这是今天抖音热榜第2名的视频文案,请帮我扩写成一篇800字小红书种草笔记,突出成分功效和使用场景

系统会在2~8秒内返回结构化结果,支持 Markdown 渲染(加粗、列表、引用块自动识别),复制即用。

更实用的是:所有对话自动保存在本地 SQLite 数据库中,按日期归档,支持关键词搜索。昨天写的美妆脚本、前天整理的舆情摘要,今天翻一翻就能复用,真正形成团队知识沉淀。

3. 新媒体实战:两个高频场景的完整工作流拆解

3.1 场景一:热点事件15分钟快速响应——从抓取到发布

传统流程:监测工具告警 → 复制标题 → 查背景资料 → 写初稿 → 内部审核 → 配图排版 → 发布

Clawdbot 流程:点击链接 → 输入指令 → 审阅结果 → 微调 → 复制发布

我们以某次突发社会话题为例(不涉及具体事件名称,仅说明方法):

-

自动抓取网页正文

在输入框粘贴新闻源链接(如某权威媒体客户端页),输入:提取该网页核心事实,剔除评论和广告,用3句话概括事件经过、涉事方、当前进展 -

生成多角度解读稿

基于上一步摘要,再发指令:以新媒体主编身份,写一篇面向Z世代读者的短评,要求:①开头用反问句引发共鸣 ②中间用类比解释专业概念 ③结尾给出1个行动建议,全文不超过400字 -

同步生成社交平台适配文案

最后追加一句:将以上内容分别改写为:①微博140字带话题 ②小红书带emoji分段版 ③朋友圈口语化短句版

整个过程从打开链接到获得三端文案,耗时约12分钟。所有生成内容均基于原文事实,未虚构信息,且语言风格高度贴合各平台调性。

3.2 场景二:批量生成垂类文案——降低重复劳动强度

很多运营要同时维护多个账号:主号讲干货、副号做互动、矩阵号发预告。过去靠模板填空,容易露馅;靠人工重写,效率太低。

Clawdbot 支持“指令+批量输入”模式。例如,你有一份 Excel 表格,含20款新品的【产品名|核心卖点|目标人群|价格区间】四列,想为每款生成一条小红书标题+正文(含表情符号和标签):

只需在输入框粘贴表格文本(或 CSV 内容),输入:

请为以下20款产品逐条生成小红书风格文案:

- 标题:15字以内,含1个悬念词或感叹词

- 正文:80~120字,分3段(痛点引入→产品解决→行动号召),每段以//👇开头

- 结尾统一加3个精准标签,如#学生党护肤 #平价好物

- 输出为编号列表,不要额外说明

Qwen3-32B 会严格按格式输出20条,无遗漏、无合并、无跳号。你只需全选复制,粘贴进后台即可发布。

实测对比:人工写20条平均耗时210分钟;Clawdbot 输出+人工抽检微调,总耗时28分钟,效率提升7.5倍,且文案多样性显著增强——不会出现“这款产品很好,推荐大家购买”这类万金油表达。

4. 模型能力深挖:为什么是Qwen3-32B,而不是其他模型?

4.1 中文长文本理解力:真正“读得懂”网页和舆情

很多模型号称支持128K上下文,但实际处理真实网页时,常出现关键信息丢失、逻辑链断裂、混淆主次关系等问题。

Qwen3-32B 在中文长文本建模上做了专项优化。我们做过对照测试:输入一篇3200字的行业深度报道(含图表说明、专家引述、数据对比),要求总结“政策影响→企业应对→用户变化”三层推演。

- 某开源7B模型:仅提取出2处政策原文,忽略全部推演逻辑

- 某商用13B模型:能列出三点,但第二点张冠李戴,把A公司策略套到B行业

- Qwen3-32B:准确还原三层因果链,且对“短期阵痛”“长期红利”等抽象表述理解到位,生成摘要可直接用于内部简报

这得益于其训练数据中大量高质量中文资讯、财报、白皮书,以及针对“事实抽取+逻辑推演”任务的强化微调。

4.2 多轮指令遵循能力:让“改稿”真正省心

运营最怕什么?不是写不出来,而是写了十稿,老板说“再换个语气”。

Clawdbot 支持连续对话上下文透传。你发完第一条指令得到初稿后,可以直接追加:

把第三段改成更轻松的语气,加入一个生活化比喻

或

现在面向40岁以上女性群体,请调整用词,避免网络俚语,增加信任感词汇

Qwen3-32B 能精准定位原文段落,只改指定部分,保留原有结构和数据,不擅自增删事实。实测10轮连续修改后,仍保持语义一致性和格式规范性,远超多数竞品模型。

4.3 本地化部署带来的确定性优势

公有云API看似方便,但在新媒体场景下有三个隐形成本:

- 响应延迟波动:高峰时段可能卡顿3~5秒,错过黄金发布时间

- 内容不可控:无法禁用某些敏感词过滤逻辑,导致正常行业术语被误拦

- 数据不出域:品牌新品文案、未公开营销策略,绝不应上传至第三方服务器

Clawdbot + Qwen3-32B 私有部署方案,彻底规避上述问题。所有文本处理全程在内网完成,模型权重、对话历史、提示词模板全部自主掌控。

我们还内置了简易权限开关:可限制单日调用次数、屏蔽特定关键词生成、设置默认温度值(控制创意发散程度),让技术真正服务于内容安全与品牌调性。

5. 总结:让大模型回归“工具”本质,而非“黑箱”负担

Clawdbot 和 Qwen3-32B 的组合,不是为了炫技,也不是堆砌参数,而是解决一个朴素问题:让每天和文字打交道的人,少一点机械劳动,多一点思考空间。

它不替代策划,但帮你快速验证创意;

不取代编辑,但为你省下查资料的时间;

不承诺“全自动”,但确保“每一次点击都有回响”。

从热点追踪到文案生成,这条链路上的每个环节,我们都坚持一个原则:技术退后半步,人往前走一步。模型负责理解、推理、生成;你负责判断、润色、决策。这才是AI在新媒体场景中最可持续的落地方式。

如果你也受困于内容产能瓶颈、热点响应滞后、文案同质化严重,不妨试试这个组合——它不会让你立刻成为爆款制造机,但大概率会让你明天的工作,比今天轻松那么一点点。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献36条内容

已为社区贡献36条内容

所有评论(0)