Skills 会进化到什么程度?以及不同人怎么用才不浪费(一)

Skills 会进化到什么程度?以及不同人怎么用才不浪费(一)

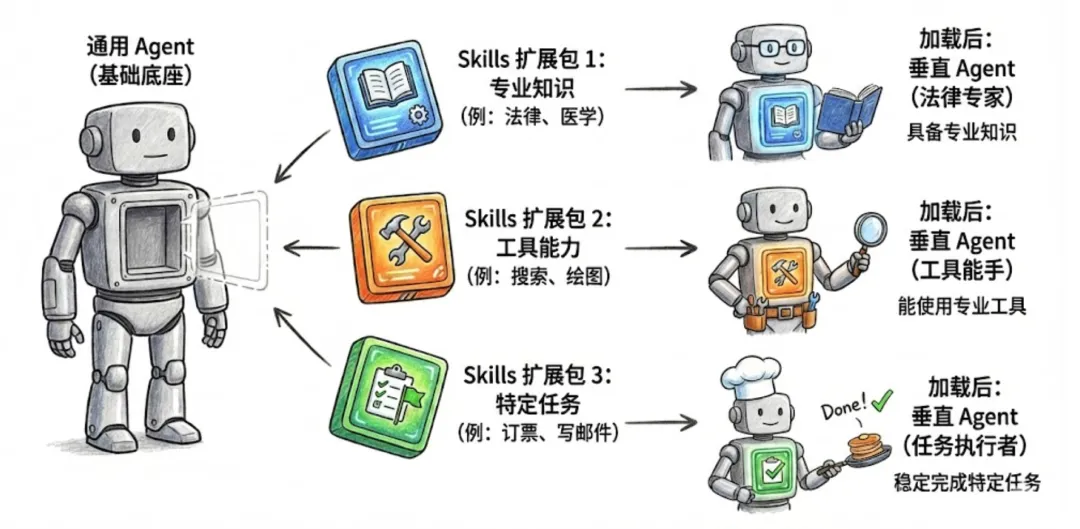

很多人聊 Skills,聊着聊着就变成“又一个 Prompt 玩法”。但我更倾向把它当成一种新型的软件封装方式:把你做事的方法、材料、工具调用,打成一个能复用的“交接包”,让 Agent 自己按需加载、按需执行。

文章目录

- 1 Skills 会进化到什么程度?

- 2. 使用 Skills 的正确姿势(按人群来)

- 3. 奇葩但很真实的观点

- 4. 案例分享:不同场景怎么用 Skills(新手也能照着做)

- 5. 参考文献

1 Skills 会进化到什么程度?

1.1. 一句话结论

Skills 大概率会从“给 Agent 加能力的说明书”,进化成“AI 原生应用的标准零件”,最后变成很多产品里的默认能力层,你甚至感觉不到自己在用 Skills。

1.2. Skills 的主要进化方向

1.2.1. 从单技能到技能组合:从“会一个动作”到“能跑一个流程”

早期 Skills 像一个小招式:写个报告开头、把 PDF 转成文本、跑个数据清洗。

但真正厉害的是组合化:一个任务自动拆成几个子技能,自己串起来跑完整链路,比如“调研 → 归纳 → 出图 → 写稿 → 排版发布”。

1.2.2. 从文档驱动到代码兜底:把“不确定”变成“可验收”

纯文档(SKILL.md)能解决 80% 的“方法交接”,但最后那 20% 的稳定性,通常靠脚本兜底。

一句话:能让脚本干的,别让模型猜。

比如:批量改文件名、跑测试、格式化数据、把表格转成统一口径——这些让脚本做,结果更稳,复现也更容易。

1.2.3. 从手动调用到自动触发:你不点名它也会来

未来的体验不是“我想用 Skill X”,而是你说“我要做一份周报”,系统读到你的任务与 Skill 元信息匹配,就自动加载对应 Skill。

这会让 Skills 很像“你电脑里的默认设置”:你不用每次解释一遍“按公司模板、按这个口径、图表配色用那套”。

1.2.4. 从少量精选到海量生态:最后拼的是“信任”,不是“数量”

Skills 一旦规模化,最先崩的不是数量,而是:

- 质量参差(装了等于没装)

- 版本漂移(昨天能用今天不行)

- 安全边界(脚本/权限/数据泄露风险)

所以真正值钱的会是:精选、评测、版本管理、安全治理。技能商店会有,但最后你会更依赖“团队/社区的精选榜单”,而不是全网乱翻。

1.2.5. 从云端到端侧:延迟、隐私、弱网,都会逼着它“本地化”

很多场景不想出网,也不想等:

- 内部文档/数据敏感

- 操作要快(比如 IDE 辅助、批处理)

- 弱网/离线

这类场景里,Skills 的“端侧执行”会越来越多——能本地算的就本地算,能本地跑脚本就本地跑脚本。

1.3. Skills vs MCP:别吵了,其实是分工

很多争论来自一句话没说清:Skills 更像“能力封装”,MCP 更像“外部连接通道”。

| 维度 | Skills 更像 | MCP 更像 | 适用场景一句话 |

|---|---|---|---|

| 核心价值 | 把“怎么做”封装成可复用流程 | 把“能连什么工具”标准化 | 一个管方法,一个管通道 |

| 成本 | 前期写得越好,后面越省事 | 接口越多,治理越重要 | 规模化后治理是硬成本 |

| 稳定性 | 文档 + 脚本可做成“可验收” | 连接没问题,结果仍可能不对 | 连接≠理解 |

| 体验 | 自动触发、按需加载 | 可控权限、统一协议 | 组合起来最好用 |

你可以把它理解成一句话:Skills 负责把事讲清楚并做成 SOP,MCP 负责把 SOP 需要的工具都接进来。

2. 使用 Skills 的正确姿势(按人群来)

2.1. 技术人员:把 Skills 当“可维护的软件资产”

技术人员用 Skills,别把它当“提示词仓库”,要按工程资产对待:

- 版本号:Skill 也要有版本,不然你永远不知道“这次变差是模型变了,还是 Skill 变了”

- 回归测试:关键输出要有最小测试集(比如 10 份样例输入)

- 失败兜底:失败时怎么降级(只输出结构、只给建议、只跑脚本)

- 可观测性:记录执行步骤、耗时、失败点(不然排查很痛苦)

一个推荐的 Skill 目录结构(不复杂,但够用):

my-report.skill/

SKILL.md

assets/

company_report_template.md

chart_style_guide.md

scripts/

clean_data.py

gen_charts.py

references/

kpi_definition.md

这个结构的用意,其实就是把“怎么做”“用什么做”“依据是什么”拆开管理:

SKILL.md负责写清楚可执行的交付说明(输入长什么样、步骤怎么走、输出怎么验收);assets/放各种模板和规范,让模型有现成的“范本”可抄,而不是每次自由发挥;scripts/把确定性的步骤固化成脚本,保证关键环节可复现、可回放;references/存业务口径、指标定义等背景材料,让结论有统一的依据。

这样一拆,Skill 就不再是“一段长提示词”,而是一套可以被版本管理、回归测试和交接的“迷你工程项目”。

如果你要加一个“可复现”的脚本执行入口,至少保证命令能一键跑通:

python3 scripts/clean_data.py --input raw.csv --output cleaned.csv

python3 scripts/gen_charts.py --input cleaned.csv --outdir charts/

2.2. 分析师:把你脑子里的方法论写成 Skill(你会吃到最大红利)

分析师最适合用 Skills 的原因很简单:你手里有“别人没有的 SOP”。

你每次都要重复强调的东西,都是最值钱的 Skill 内容,比如:

- 指标口径怎么定义

- 异常值怎么处理(用中位数还是均值、怎么截断)

- 报告结构怎么写(先结论后证据,还是先背景后方法)

- 图表怎么出(配色、标题、单位、注释规则)

你不需要写代码,你只要把“怎么做”写清楚,Agent 就能按你的方法跑。你写得越像交接文档,越不像“对话”,效果越稳。

2.3. 普通人:先装现成的,再做一个“我的偏好 Skill”

普通人别一上来就“手搓大技能”,顺序建议是:

- 装现成的:先把高频需求跑通(写作、PPT、整理资料、自动化)

- 做一个偏好 Skill:把你的口味固化下来,比如:

- 文章要口语化但专业

- 不要太 AI 味

- 输出结构固定:先结论、再证据、最后行动清单

- 把重复劳动打包:任何你一周做两次的事,都值得 Skill 化

3. 奇葩但很真实的观点

3.1. Skills 其实是在卖“可迁移的组织经验”

Skills 的本质,就是把这些“隐性经验”变成“可迁移资产”。它不像培训那样靠人一遍遍讲,也不像 SOP 那样停留在纸面;它更像一套可执行的交付协议:输入格式固定、过程步骤明确、每一步要求产出证据、失败有兜底、最后有验收标准。你把它做对了,就相当于把组织经验打包成一个可复用的交付单元,谁来都能按同样的方式跑一遍。

怎么证明它不是概念?你可以从两个很现实的指标去看:

- 上手时间:新人以前需要“跟着老手做 2-3 次”才能摸清套路;有了 Skill(输入模板 + 输出样例 + 自检清单),新人第一次就能产出 70% 可用的版本,剩下 30% 用反馈迭代 Skill,而不是靠拍脑袋。

- 返工成本:没有 Skill 的团队,返工通常发生在“最后一公里”(格式不对、口径不对、证据不足);有 Skill 的团队,问题会被提前暴露在流程里(比如强制要求列口径、列引用、列风险清单),返工会前移、变小、可定位。

我的设想是:未来团队的核心壁垒会越来越像软件库而不是个人英雄主义。强团队会把高频交付链路(写周报、做竞品、出方案、做复盘、跑自动化)做成一组 Skills,并用版本号、评测集、权限边界管理它们。到那时,“组织能力”会有非常具体的载体:你能看到它的输入输出、能跑回归、能做审计,甚至能像依赖库一样被复用到另一个团队。

3.2. 最强的 Skill 不是更聪明,而是更少让模型自由发挥

听起来反直觉,但很常见:

越关键的环节,越要收束自由度,用模板、约束、脚本、校验把输出锁住。

原因不复杂——模型输出本质是概率采样,同样的输入可能得到不同结构、不同论证路径、甚至不同结论。对“创意写作”这不是问题,但对“可验收交付”就是隐患。

所以最强的 Skill 往往不是让模型更“会写”,而是让它更“少乱写”。比如:

- 用固定结构模板,把章节顺序锁住(先结论、再证据、再行动清单)

- 用检查清单,把必须出现的证据锁住(数据口径、引用链接、风险边界)

- 用脚本把确定性步骤锁住(数据清洗、批量改文件、跑测试、生成图表)

- 用校验把格式与约束锁住(标题编号、表格字段、引用格式、敏感词)

怎么证明这条路线更靠谱?一个简单的工程事实是:可重复的东西才能被测试。一旦你把输出结构化(哪怕只是“标题编号必须对、引用必须是 URL、必须有表格+流程图+代码块”),你就能写自动检查,就能做回归评测,就能把“看起来不错”变成“可验收”。反过来,如果每次都让模型自由组织语言、自由选择论证路径,你只能靠人工审稿,成本高且不稳定。

我的设想是:模型越强,这个结论越成立。强模型会让人更敢放手,而放手会放大风险(错一处就全盘不可信)。未来成熟的 Skill 会把自由度留在非关键环节(措辞、类比、例子),把关键链路全部变成“可验收”:哪里必须给出证据、哪里必须走脚本、哪里必须有降级策略,这会成为默认设计。

3.3. Skills 会让“会写文档的人”生产力暴涨

如果你能把流程写清楚、把标准写清楚,你就能“用文档造软件”。在 Skills 体系里,文档不再只是说明书,而更像一份“可执行规格”:它定义输入、过程、输出和验收,让 Agent 每次都按同样的方式跑流程。

为什么这会让会写文档的人生产力暴涨?因为他们最擅长把三件事做成“可以被复用的规则”:

- 抽象:把一堆零散经验提炼成稳定步骤(先结论、再证据、再行动)

- 约束:把模糊要求写成可检查的清单(必须有引用、必须有对比表、必须有风险边界)

- 复用:把“这一份交付物”升级成“以后都能复用的产线”

你可以用边际成本来理解它:如果每次都手工写一篇文章/报告,产能是线性的;但如果你把写作与审稿流程固化成 Skill,你是在打造一条产线。你修改一次 Skill,收益会体现在后面十篇、二十篇里,越用越省事,越用越稳定。

我的设想是:会出现一个很实用的新岗位画像——“把业务交付写成可执行文档的人”。他们不一定写很多代码,但非常懂目标、懂口径、懂验收,也知道该把哪些步骤交给脚本、哪些步骤交给模型。对团队来说,这类人等于把经验变成了资产,能直接拉开交付效率和稳定性的差距。

3.4. Skill 生态最后拼的是测评与信任,不是数量

未来一定会海量 Skills,但数量本身不会带来价值,甚至会制造噪音。就像包管理器里永远不缺库:你真正长期依赖的,永远是一小撮“能被信任”的组件——稳定、可追溯、更新可控、风险边界清楚。

为什么最后拼的是“测评与信任”?因为 Skill 一旦进入工作流,就会影响结果质量甚至安全边界。最可怕的不是它慢,而是它“看起来对、其实错”:格式很漂亮,但口径漂了;流程跑完了,但关键证据缺失;工具连通了,但权限越界了。规模越大,这种“隐蔽错误”的成本越高。

信任怎么建立?通常离不开三件事:

- 评测:有最小测试集,能跑回归,知道它在哪些输入上会翻车

- 版本:有版本号和变更说明,升级不会悄悄改变结论口径

- 治理:有权限与审计,明确哪些数据能用、哪些工具能调用、失败怎么降级

我的设想是:Skill 生态会快速走向“平台化信任体系”。会出现类似 Skill 的 CI/CD:每次更新自动跑评测集;会出现签名与发布:谁维护、何时发布、依赖哪些脚本;还会出现安全分级:哪些 Skill 允许访问生产数据、哪些只能读脱敏样例。最终你真正依赖的仍然是那 20 个左右核心 Skill——但它们会越来越像团队基础设施,而不是随手收藏的提示词。

再往后看,Skills 很可能会变得像 Python 依赖库一样“开箱即用”:你不需要自己从零写一份周报 Skill 或自动化测试 Skill,而是直接在某个“技能仓库”里找到经过测评和签名的版本,用类似 pip install team-weekly-report-skill 的方式装上,然后在 Agent 里一句话引用这个 Skill 名称就能用。真正重要的,不再是“你会不会写提示词”,而是:

- 你能不能挑到可信赖的 Skill(像挑靠谱的第三方库一样看维护者、更新频率、评测结果);

- 你能不能把团队内部高频的那一撮能力,打包成可以对内复用、对外发布的 Skill “依赖库”。

到那一步,装一个 Skill 的心智负担,会跟今天装一个 requests、pandas 差不多:一行安装命令 + 一段简洁的使用示例,剩下交给生态里的测评、版本和信任体系去兜底。

4. 案例分享:不同场景怎么用 Skills(新手也能照着做)

很多人卡在第一步:听懂了概念,但落到自己工作里,还是不知道“到底该怎么用”。这一节我用几篇文章做案例,把不同场景拆成清晰的“目标 → 准备 → 步骤 → 产出”,你照着抄就能跑起来。

先给一张“怎么选案例”的速查表:

| 你遇到的事 | 用 Skills 的目标 | 最适合的案例 |

|---|---|---|

| 写内容、做公众号、整理素材 | 把“写作流水线”固化,减少反复解释 | 4.1 |

| 做自动化测试、跑脚本、控稳定性 | 用脚本兜底,把不确定变确定 | 4.2 |

| 你知道“好看”但 AI 做不出来 | 把审美规则写成标准,直接套用 | 4.3 |

| Excel/Office 操作繁琐又重复 | 让 Agent 按 SOP 执行一整套办公流程 | 4.4 |

| 团队里技能太多、工具太杂 | 用“技能包”做能力资产化和复用 | 4.5 |

4.1. 案例一:用 Skills 搭一条公众号写作流水线(偏“内容创作者”风格)

来源参考:Skills 实战:从爆火插件 superpowers 到我的公众号自动化流程、别再问“怎么写 SKILL.md”了,直接抄生产级的Skills 库

4.1.1. 场景

你每次写公众号都要做同一堆事:找资料、列提纲、统一口吻、补例子、排版、发前自检。你不缺写作能力,你缺的是“别每次从零开始”。

4.1.2. 目标(用一句话说清楚)

把你的写作 SOP 打成一个 Skill:以后你只给素材,它按固定流程给你一篇“像你写的文章”。

4.1.3. 新手准备(不需要会代码)

- 你常用的文章结构(比如:观点 → 论据 → 反例 → 行动清单)

- 你自己的口吻规则(比如:短句、少术语、但专业)

- 你最常引用的素材类型(链接/截图/笔记/数据)

4.1.4. Skill 应该怎么写(一个能直接抄的骨架)

---

name: wechat-writer

description: 把原始素材加工成公众号文章,口语化但专业,按固定结构输出

---

## 输入格式

- 主题:

- 目标读者:

- 素材(链接/笔记/数据):

## 写作流程

1) 先输出 5-8 条“文章观点”,每条 20-30 字

2) 再给 3-5 个写作提纲,标注每节写什么

3) 生成正文:短句、少废话、但逻辑完整

4) 自检清单:是否有结论、是否有证据、是否有反例、是否有落地做法

## 输出格式

- 统一用 Markdown

- 标题按 # 1、## 1.1、### 1.1.1 编号

4.1.5. 实际怎么用(一步步)

- 把你过去 3-5 篇“你最满意的文章”里的共同点写进 Skill(结构、口吻、禁忌)

- 写新文章时,你只要喂“主题 + 素材”,Skill 先出观点、再出提纲、最后出正文

- 不满意就改 Skill,不要每次改正文(这是关键)

4.1.6. 产出效果

你会发现写作变成“调参”:不是改一篇文章,而是把 Skill 调到稳定。后面写十篇二十篇,质量会越来越稳,时间会越来越省。

4.1.7. 一个真实 Skill 片段长什么样

下面是一个更接地气的 Skill 片段,专门写“每周复盘型”的公众号:

---

name: wechat-weekly-review

description: 把一周的碎片素材串成一篇有结构的周记/复盘文章

---

## 输入格式

- 周期:本周时间范围(如:2026-01-20 ~ 2026-01-26)

- 素材清单:

- 读过的文章(标题 + 摘要 + 链接)

- 做过的实验/项目(目标 + 结果 + 反思)

- 想记录的瞬间(随手笔记)

## 写作步骤

1. 先按“主题”而不是时间轴聚合本周素材(如:技能沉淀、系统建设、个人体验)。

2. 每个主题下用“发生了什么 → 学到了什么 → 下周要怎么改”三段式写法。

3. 全文控制在 2500 字以内,短句为主,避免大段空洞感慨。

## 自检清单

- 是否有 1 条总的本周结论?

- 是否每个主题都有“下周要怎么改”的行动项?

- 是否给出了至少 3 个具体细节,而不是泛泛而谈?

你完全可以拿这个片段,改名、换成自己的输入字段,就变成你的专属写作 Skill。

4.2. 案例二:用 Skills 兜底自动化测试与浏览器操作(偏“工程师实战”风格)

来源参考:Playwright MCP/Skills/Dev Browser:AI自动化测试的坑我全踩过、让-Agent-告别低效工具调用:用代码执行重构-MCP-工作流,节省

4.2.1. 场景

你想让 Agent 帮你做 Web 自动化测试,但经常出现两种问题:

- 它“看起来会”,但执行到一半就迷路

- 它能跑,但结果不稳定,换个页面结构就翻车

4.2.2. 目标

让 Skill 把流程固化:哪些步骤必须做、哪里必须截图/断言、失败怎么重试、最后输出什么报告。

4.2.3. 推荐做法(新手也能理解的分工)

- Skill(文档部分)负责:步骤、断言点、报告格式、异常处理策略

- 脚本(代码部分)负责:真实执行、截图、DOM 读取、数据落盘

4.2.4. 最小可用流程(建议照抄)

4.2.5. “不翻车”的关键写法

- 每一步都要求输出“可复现信息”(URL、操作、时间、截图路径)

- 断言别写成“看起来没问题”,要写成具体条件(文本/元素/接口状态)

- 失败策略要明确:重试几次、换备用选择器、还是直接停下来给你要输入

4.2.6. 产出效果

你会得到一种很舒服的体验:Agent 能做事,但它的行为被 Skill 约束住了,不会瞎跑。你只要看报告就能定位问题,必要时再人工接管。

4.2.7. 实际 Skill 示例(E2E 测试流程)

---

name: web-e2e-checkout-test

description: 在浏览器里跑一条下单流程 E2E 测试,并输出可复现报告

---

## 输入格式

- 测试环境 URL:

- 账号信息:(如需要登录)

- 测试场景:如「正常下单」「优惠券下单」「库存不足」

## 流程步骤

1. 打开指定 URL,等待页面稳定(DOM 不再大规模变化 3s 以上)。

2. 按“测试场景”生成操作步骤列表,并逐步执行(如:搜索商品 → 加入购物车 → 下单)。

3. 每一步都记录:

- 当前 URL

- 关键操作说明

- 截图路径

4. 在关键节点做断言:

- 页面上是否出现预期文案?

- 价格/数量是否正确?

- 是否有错误提示/异常弹窗?

5. 如果某一步失败:

- 重试不超过 2 次;

- 仍失败则停止执行,输出“失败步骤 + 截图 + DOM 关键信息”。

## 输出格式

- 一份 Markdown 报告,包含:

- 场景说明

- 步骤表格(步骤编号 / 操作 / 预期 / 实际 / 结果 / 截图)

- 失败分析与复现方法

这个 Skill 交给 Agent 后,你得到的不是“随便点点网页”的录像,而是一份可以直接放进缺陷单里的测试报告。

4.3. 案例三:用 Skills 固化前端审美与设计一致性(偏“产品/设计协作”风格)

来源参考:一键拯救大模型的前端审美能力、Agent Skills 终极指南:入门、精通、预测

4.3.1. 场景

你让 AI 做页面,它功能很全,但看起来就是“土”。你知道哪里不对,但又说不清楚,最后只能自己一段段改。

4.3.2. 目标

把审美规则写成 Skill:它不是“凭感觉生成”,而是“按规范产出”。

4.3.3. 新手可用的写法(给它一套可执行的审美检查清单)

## UI 风格规范(必须遵守)

- 字体:标题/正文/代码的字号与行高范围

- 间距:卡片 padding、模块间距统一(如 12/16/24)

- 配色:主色/辅色/中性色的用途,不允许随意加颜色

- 层级:标题层级不超过 3 级,强调用粗体而不是乱加颜色

## 输出约束

- 先给页面结构,再给组件清单,最后给代码

- 代码必须按组件拆分,不允许把所有东西堆在一个文件

## 自检(输出前必须逐条检查)

- 是否出现了不在配色表里的颜色?

- 是否出现了不一致的间距/圆角?

- 是否有过长的段落没有拆成列表?

4.3.4. 产出效果

你会明显感觉到:AI 的“审美”不是突然变好了,而是它被迫按一套规则执行。对新手来说,这比“让 AI 自己悟”靠谱太多。

4.3.5. 实际 Skill 示例(前端页面审美检查)

---

name: frontend-ui-review

description: 审查一个前端页面是否符合团队 UI 规范,并给出修改建议

---

## 输入格式

- 页面截图或设计稿链接:

- 页面代码片段(可选):

- 适用规范版本:如 v1.2(对应一份 UI 规范文档)

## 审查步骤

1. 根据 UI 规范,逐条检查:

- 字体:标题/正文字号、行高是否在允许范围内

- 配色:是否只使用设计系统中的色值

- 间距:常用间距是否在 8/12/16/24 等栅格内

- 组件:是否使用了推荐组件,而不是自造轮子

2. 对每一类问题给出三段式反馈:

- 发现了什么问题(引用具体截图/代码)

- 违反了哪条规范(引用规范标题)

- 应该改成什么样(给出文字 + 示例代码)

## 输出格式

- 一份审查报告,包含:

- 总体评估(通过/需调整)

- 问题清单(按严重程度排序)

- 建议修改方案(可以直接交给前端实现)

做到这一步,你等于把“设计师脑子里的审美规则”写成了一个可执行的 Skill。

4.4. 案例四:用 Skills 接管办公自动化与 Excel 流程(偏“普通人提效”风格)

来源参考:通过Skills 之后的第三代技术,我们顺手颠覆了Excel操作

4.4.1. 场景

你经常做这些事:复制粘贴、格式统一、筛选去重、生成透视表、输出周报表格。事情不难,但特别耗时间,还容易错。

4.4.2. 目标

把“办公 SOP”写进 Skill,让 Agent 每次都按同一套流程做,输出同一种格式的结果。

4.4.3. 一个新人能看懂的 SOP(建议写进 Skill)

- 导入数据(明确来源、字段含义)

- 清洗规则(去重、空值、异常值处理)

- 统计口径(分组、聚合、时间窗口)

- 输出模板(表头、单位、小数位、排序规则)

- 自检(总数对齐、关键指标对比上周、异常值提示)

4.4.4. 产出效果

你的工作从“手工操作”变成“核对结果”。你只要盯住口径和异常,剩下的交给 Skill 固化流程。

4.4.5. 实际 Skill 示例(周报表自动生成)

---

name: excel-weekly-report

description: 从原始 Excel 数据生成一份结构统一的本周运营周报

---

## 输入格式

- 原始数据文件路径:如 data/raw/weekly_data.xlsx

- 本周时间范围:

- 需要关注的核心指标:如 GMV、下单用户数、退款率

## 处理步骤

1. 读取指定 Sheet,按照预设字段做清洗(去重/空值处理/异常值截断)。

2. 按时间维度与品类维度生成汇总表:

- 本周 vs 上周

- 本周 vs 日均

3. 自动生成 3 张核心透视表:

- 日期 × 指标

- 品类 × 指标

- 渠道 × 指标

4. 根据规则生成 Markdown 周报草稿:

- 先给 3 条本周核心结论

- 再列关键数据表格

- 最后给下周行动建议

## 输出格式

- 一个新的 Excel 文件:包含整理好的数据和透视表

- 一段 Markdown 文本:可以直接复制到周报文档中

有了这样的 Skill,Excel 不再是“逐格点”的工具,而是一套可以复用的办公流水线。

4.5. 案例五:把团队能力做成 Skills 资产包(偏“管理/平台化”风格)

来源参考:423 个神级 Skills 一键下载:Agent 能力开始被「工程化」了!、实测Agent Skills,一次编写,全网通用

4.5.1. 场景

团队里每个人都有自己的“私藏玩法”:有人会写 SQL、有人会做 PPT、有人会做竞品分析。问题是这些能力没法复用,新人来了一切重来。

4.5.2. 目标

把高频能力做成“团队 Skills 包”:新人装上就能用,老手持续迭代,越用越强。

4.5.3. 新手也能上手的落地步骤

- 先挑 3 个最高频的任务(周报、数据提取、对外材料)

- 每个任务先只写 SKILL.md(别急着写代码)

- 跑 10 次以后,再把最容易翻车的环节用脚本兜底

- 给 Skill 加一页“输入模板 + 输出样例”,新人照抄就会

4.5.4. 产出效果

你得到的不是“又一堆提示词”,而是团队可以维护、可以迭代、可以交接的能力资产。久了以后,Skill 本身会变成团队的竞争力。

4.5.5. 团队 Skills 包实际长什么样

一个典型的团队 Skills 包,可以是这样的目录:

team-skills/

weekly-report.skill/

SKILL.md # 周报写作与数据整理

scripts/

gen_weekly_report.py

ad-hoc-analysis.skill/

SKILL.md # 日常分析问答与图表生成

external-deck.skill/

SKILL.md # 对外汇报材料的结构与模板

postmortem-review.skill/

SKILL.md # 事故复盘流程与模板

每个目录里都有自己独立的 SKILL.md、脚本和模板,你可以像维护代码库一样维护它们:拉分支、写 changelog、做评测,把“团队经验”当成真正的工程资产来运营。

5. 参考文献

- Agent Skills 终极指南:入门、精通、预测

- Agent Skills vs MCP , 一个“会干活” 一个“会链接 ”

- 别再问“怎么写 SKILL.md”了,直接抄生产级的Skills 库

- 史诗级更新!国内首个支持Skills模式的编程助手,开启AI编程二阶段

- Claude-Skills|将-Agent-变为领域专家

- 优tech分享|Agent全面爆发!一文搞懂Agent开发核心链路

- 腾讯大模型应用演进之路:从-RAG-到-MCP-的技术实践

- Skills 实战:从爆火插件 superpowers 到我的公众号自动化流程

- Playwright MCP/Skills/Dev Browser:AI自动化测试的坑我全踩过

- 让-Agent-告别低效工具调用:用代码执行重构-MCP-工作流,节省

- 一键拯救大模型的前端审美能力

- 通过Skills 之后的第三代技术,我们顺手颠覆了Excel操作

- 423 个神级 Skills 一键下载:Agent 能力开始被「工程化」了!

- 实测Agent Skills,一次编写,全网通用

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)