openclaw如何调用本地大模型,小龙虾自力更生

大家好,我是涛哥,欢迎来到我的空间。网上关于“小龙虾”的安装教程已有很多,这里不再赘述。但在线使用时tokens消耗较快,如果本地的电脑配置还可以的话可以尝试下地部署方案。

·

大家好,我是涛哥,欢迎来到我的空间。

网上关于“小龙虾”的安装教程已有很多,这里不再赘述。但在线使用时tokens消耗较快,如果本地的电脑配置还可以的话可以尝试下地部署方案。

一、本地模型

我之前写过本地大模型的搭建教程,大家可以到我的空间里查看。

主要使用的是 Ollama,现在已有 GUI 界面,操作比较简单。

我使用的模型是:qwen2.5:3b。

二、配置文件说明

主要配置两块内容

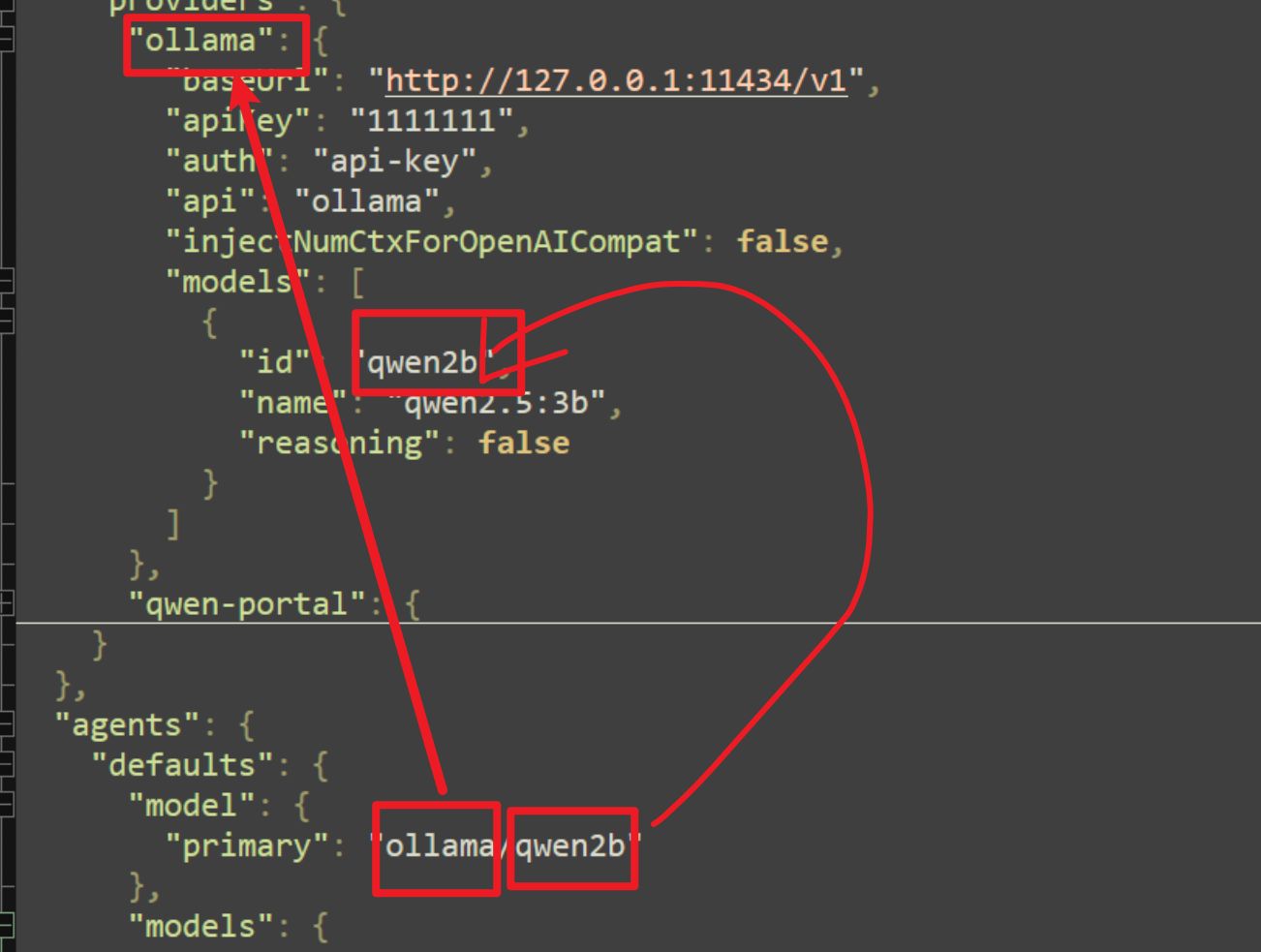

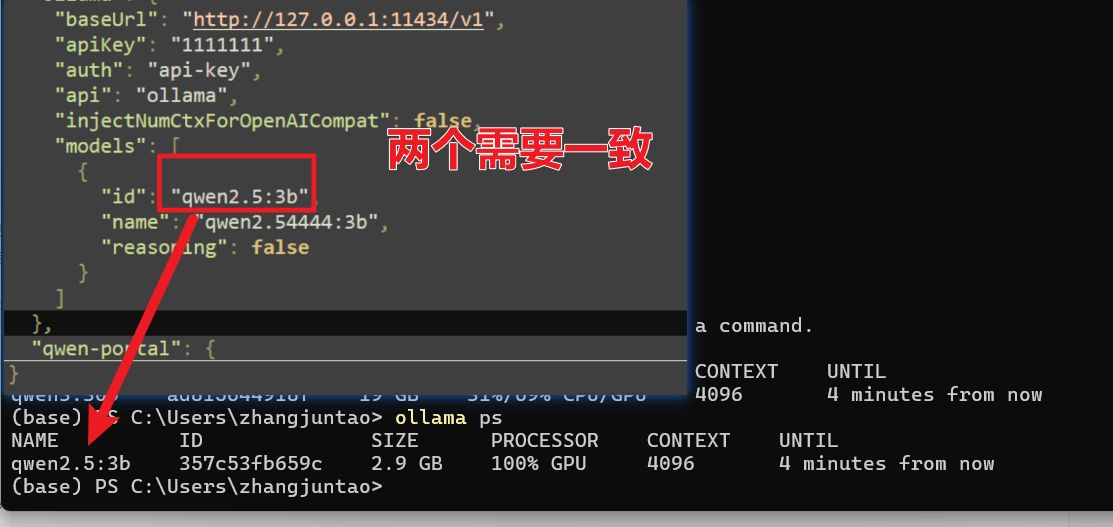

1、models下的providers 基础模型

"ollama": {

"baseUrl": "http://127.0.0.1:11434/v1", //本地地址

"apiKey": "1111111", //随意填写

"auth": "api-key", //随意填写

"api": "ollama", //随意填写

"injectNumCtxForOpenAICompat": false,

"models": [

{

"id": "qwen2b",

"name": "qwen2.5:3b",

"reasoning": false

}

]

}

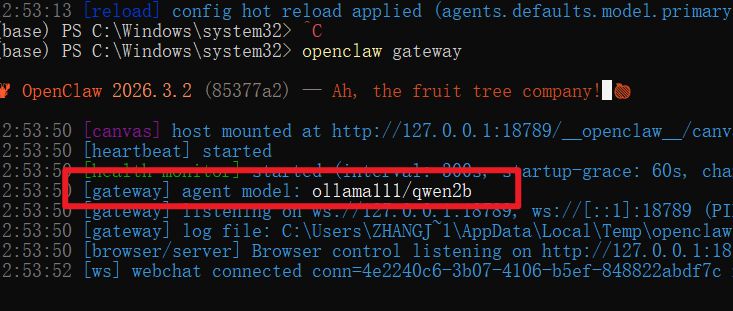

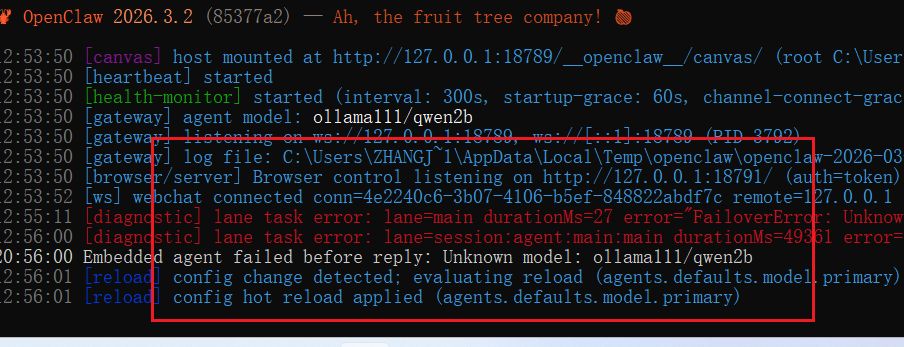

启动时可以看到agent使用的模型。

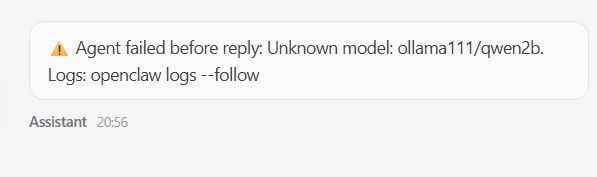

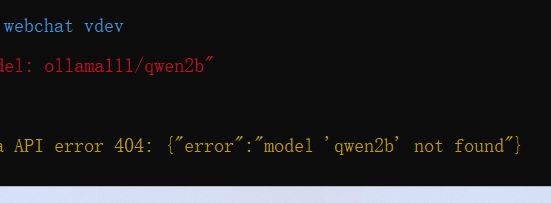

当我把模型设置为ollama111的时候,启动项目已经改变,但不能回复问题了。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)