OpenClaw 实战:从0-1搭建 AI 定时资讯推送助手(可复刻实操)

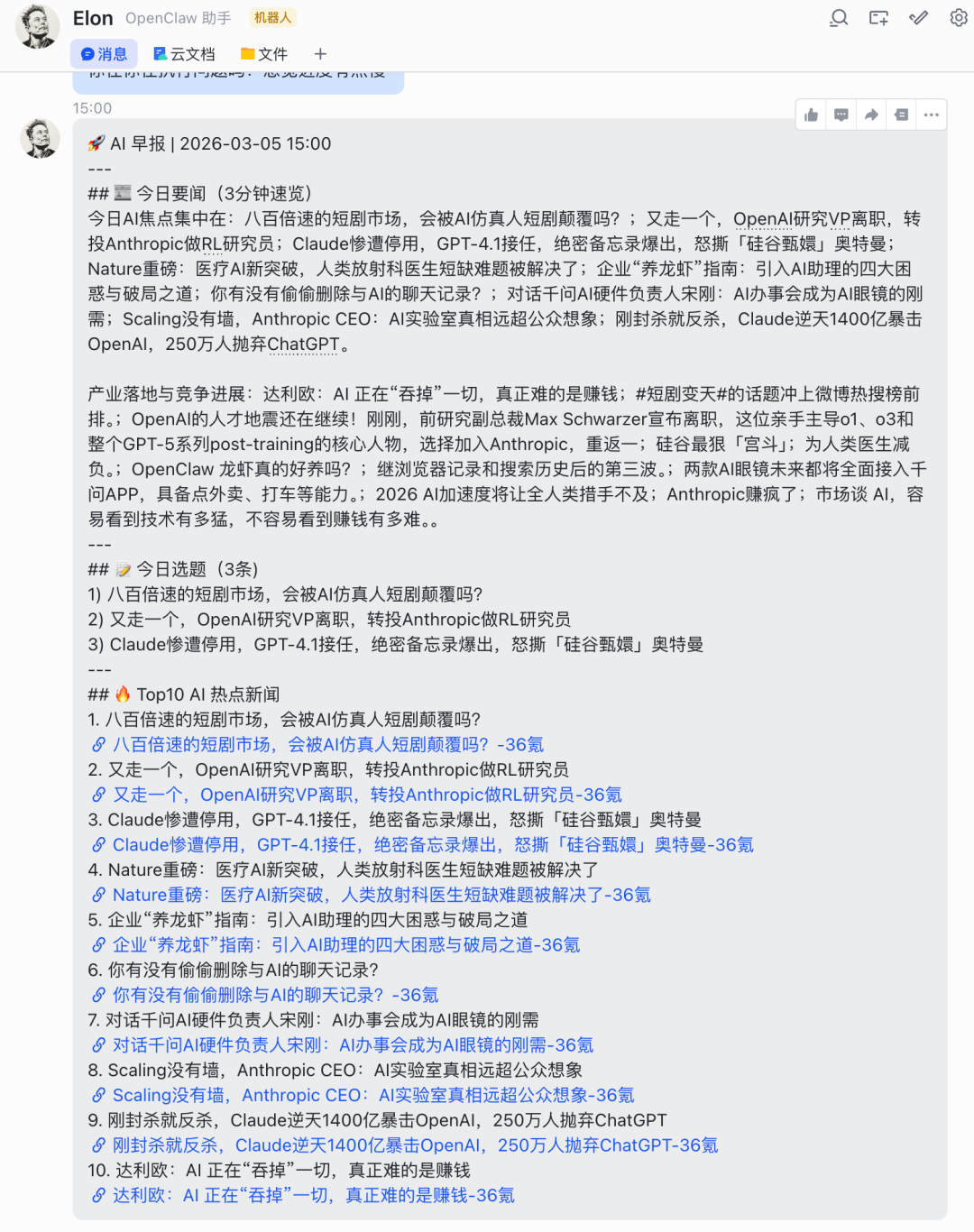

你是不是也试过:收藏了一堆AI工具,最后只用来查个资料、写几行代码?真正的AI助手,从来不是“你问它答”的被动聊天工具——能主动按你的节奏干活、定时交付结果的,才叫真正的生产力神器。最近我用OpenClaw搭了个AI早报推送系统,每天8点自动抓取36氪、量子位、新智元的AI热点,生成3分钟就能读完的精简早报,直接推到飞书私聊里。不用手动刷资讯,不用操心定时,每天上班前就能拿到整理好的行业干货。

你是不是也试过:收藏了一堆AI工具,最后只用来查个资料、写几行代码?

真正的AI助手,从来不是“你问它答”的被动聊天工具——能主动按你的节奏干活、定时交付结果的,才叫真正的生产力神器。

最近我用OpenClaw搭了个AI早报推送系统,每天8点自动抓取36氪、量子位、新智元的AI热点,生成3分钟就能读完的精简早报,直接推到飞书私聊里。

不用手动刷资讯,不用操心定时,每天上班前就能拿到整理好的行业干货。

今天就把这套“主动交付式AI”的搭建方法拆透,技术大叔亲测,全程无晦涩术语,新手也能跟着做。

如果你还没有安装搭建AI工具,请左转进入我之前的文章学习:

Claude Code实战1:Claude Code深度介绍(附最全安装指南)

一、先想清楚:为什么“主动交付”才是AI助手的核心?

做AI早报推送前,我踩过不少坑: 每天早上先花20分钟刷3个AI站点,手动挑热点、删重复内容,再整理成可读的格式,最后转发给团队——看似小事,却占了每天最黄金的专注时间。

这也是大多数人用AI的误区:把AI当成“工具人”,却没让它替代“重复劳动”。

OpenClaw的核心价值,就是把“人找信息”变成“信息找人”:

-

你定规则:什么时候推、推什么内容、推到哪;

-

它来执行:自动抓取、去重、生成摘要、准时推送;

-

全程无人工:哪怕你没起床,8点的早报也会准时到。

这才是“主动交付式AI”——不是你用它,是它为你干活。 首先是搭建需求和技术规格说明书,分享我的主要需求和规格截图。当然AI时代,需求管理也是可以跟AI共创完成的;另外还有一个好处是,有需求基线后,后面的功能优化和迭代可以有据可查。AI时代做好需求管理仍然是个好习惯。

二、第一步:搭骨架——用YAML搞定核心规则配置

搭建的核心是“规则先行”,我用YAML做配置文件,不用改一行代码,就能调整推送逻辑。这一步是基础,也是OpenClaw灵活的关键。

1. 先定义“抓取任务”(fetch_jobs)

告诉系统要抓哪些站点、抓多少内容:

fetch_jobs: - id: "morning_ai" sources: ["36kr", "量子位", "新智元"] # 指定数据源 collect_count: 20 # 每次抓20条素材这里有个小坑我踩过:一开始把collect_count设成50,结果抓取超时,后来调到20刚好——不是抓得越多越好,够用就行。

2. 再定义“推送任务”(push_jobs)

关联抓取任务,指定推送时间、频率、内容模块:

push_jobs: -id:"push_morning_ai" fetch_job_id:"morning_ai"# 关联上面的抓取任务 schedule: -time:"08:00"# 推送时间 frequency:{unit:"day",value:1}# 每天推送 features: content_blocks:["A","B","C"]# A=要闻,B=选题,C=Top10热点 link_count:10# 只推Top10链接重点提醒:推送时间要比抓取时间早3分钟(系统自动算),不用手动配——这个细节能避免“推送了但内容还没抓完”的尴尬。

3. 最后配置数据源

给每个站点加开关,方便后续启停:

sources: -name:"36kr" enabled:true url:"https://36kr.com"-name:"量子位" enabled:true url:"https://www.qbitai.com"我建议一开始只开2-3个核心站点,多了容易出问题,比如某个站点访问失败,会拖慢整个抓取流程。

三、第二步:填血肉——抓取+生成,让早报“有料又好读”

配置搭好骨架,接下来要让早报“有内容、不重复、读得爽”——这一步是OpenClaw从“能用”到“好用”的关键。

1. 多数据源抓取:自动降级,不怕站点崩了

我选了3个AI核心站点,但做了“自动降级”逻辑:如果某个站点访问失败(比如量子位服务器卡了),系统会跳过它,只用能访问的站点生成内容,不会直接报错停摆。

这是我踩过的第二个坑:第一次上线时没做降级,某个站点采集失败,整个早报直接推送失败——后来加了这个逻辑,稳定性直接拉满。

2. 去重+锁:避免重复推送的“致命问题”

AI早报最忌讳重复发同一内容,我用“内容hash锁”解决:每次生成早报后,系统会计算内容的hash值,存到本地日志里;下次推送前先查hash,重复了就直接跳过。

举个例子:如果3个站点当天的热点高度重合,系统会自动合并,不会把同一条新闻发三遍——这也是“主动交付”的细节:不仅要推,还要推得靠谱。

3. 自动摘要:3分钟速览,不浪费读者时间

我给早报加了“速览模块”,系统会把抓取的内容自动分段、生成摘要,控制在3分钟能读完的长度——毕竟没人愿意上班前读长篇大论。

这里的小技巧:摘要不要追求“全”,要抓“关键”,比如AI融资、技术突破、行业政策,这三类是AI从业者最关心的,优先放。

四、第三步:跑起来——调度+推送,让早报准时到手里

配置和内容都搞定,最后一步是让系统“自己跑起来”,不用你每天手动触发。

1. 选调度工具:macOS用LaunchAgent最稳

我试过Cron和Python的APScheduler,最后选了LaunchAgent(仅限macOS)——系统级调度,不用常驻进程,日志也好查,哪怕重启电脑也能自动恢复。

配置LaunchAgent的小细节:把脚本路径写绝对路径,避免“找不到文件”的问题;日志文件定在固定目录,每天检查一次,能快速定位问题。

2. 推送渠道:飞书OpenAPI为主,Webhook兜底

主渠道用飞书OpenAPI(tenant_access_token + messages),权限可控,还能追溯推送记录;备用渠道设Webhook,万一API出问题,能自动降级推送,避免漏报。

这里要注意:飞书的token要定期更新,我加了个“token过期提醒”,避免突然推送失败——细节决定稳定性。

3. 失败重试:不怕偶尔出问题

系统会记录每次抓取和推送的日志,失败了会自动重试(最多3次),还会把失败原因写到日志里——比如网络超时、站点访问受限,都能快速排查。

我还加了个“推送成功提醒”,推完早报会给我发个私聊,确认当天的早报已经送达,心里有底。

最后看看开发调试的结果展示吧:

关键洞察:AI落地,从来都是“小场景胜过大而全”

做这个AI早报推送系统,我最大的感受是:

现在很多人追求“大模型、全功能”,却忽略了“小场景的自动化”——比如每天20分钟的资讯整理,看似小事,累积下来就是巨大的时间成本。

OpenClaw这类工具的价值,不是炫技式的“AI能力”,而是把“人不想干、又不得不干的重复活”接过来,让你把时间花在更有价值的事上:比如分析早报里的行业趋势,而不是整理早报本身。

AI助手的终极形态,从来不是“什么都会”,而是“在你需要的时候,主动把结果交过来”——这才是“主动交付式AI”的核心,也是AI落地的真正意义。

互动结尾:你想让AI帮你做什么“主动交付”的事?

我搭建这个AI早报推送,前后花了半天时间,现在每天能省20分钟,累积下来一年就是120多个小时——这些时间足够读好几本AI技术书了。

你有没有想过用AI做类似的“主动交付”?比如:

-

每天自动整理行业研报?

-

定时推送竞品动态?

-

每周生成团队工作周报?

评论区聊聊你的想法,欢迎留言索要:这个功能需求和开发规格说明书,配置资料。只要你愿意动手,你也可以的。 如果这篇教程对你有帮助,别忘了点赞、在看,把它分享给同样想让AI“主动干活”的朋友~

关键词标签

OpenClaw实战 | AI自动化 | 早报推送 | 主动交付式AI | 飞书API | 定时调度 | AI落地小场景

Claude Code实战1:Claude Code深度介绍(附最全安装指南)

OpenClaw飞书助手从0到可用,我踩遍6个致命坑(附可复刻实操)

更多推荐

已为社区贡献25条内容

已为社区贡献25条内容

所有评论(0)