基于Ollama本地部署模型与Claude-Code的尝试初体验

本文将详细介绍如何结合Ollama本地部署模型(或云模型)与Claude-Code(OpenClaw)进行配置和使用。通过本指南,您将能够搭建一个不受Token限制的本地开发环境,或灵活利用云模型的免费额度。

前言

本文将详细介绍如何结合Ollama本地部署模型(或云模型)与Claude-Code(OpenClaw)进行配置和使用。通过本指南,您将能够搭建一个不受Token限制的本地开发环境,或灵活利用云模型的免费额度。

环境准备与安装步骤

-

Ollama安装与配置

安装Ollama

-

访问Ollama官网下载对应操作系统的安装包

-

完成安装后,需注册并登录账号(目前注册需要邮箱+手机号双重验证)

部署模型

https://ollama.com/search

-

本地模型:若您的机器性能足够(建议16GB以上内存,有独立GPU更佳),可以下载并部署本地模型。优势是完全不受Token数量限制。

-

云模型:每个账号每周会获得一定的免费Token额度,每周自动刷新。值得注意的是,不同账号之间不按手机号汇总统计,因此可以通过注册新的163邮箱等方式获取多个账号额度。

-

Claude-Code安装

由于Claude-Code目前在中国区不支持直接安装,需要通过npm进行全局安装:

bash

npm install -g @anthropic-ai/claude-code

安装完成后,可以通过claude-code --version验证安装是否成功。

另:claude-code需要安装需要的skills(或者自己写),这里针对claude-code使用不做额外扩展

-

CC Switch配置与管理

CC Switch是一个用于管理模型切换的工具,特别适合需要频繁切换本地和云端模型的场景。

安装CC Switch

-

下载并安装CC Switch(可从官方GitHub仓库获取最新版本)

添加本地模型至CC Switch

-

确保Ollama服务正常运行(默认会在11434端口开启服务)

-

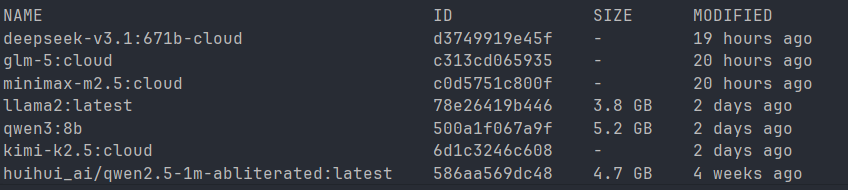

在命令行中查看已安装的本地模型列表:

-

bash

-

ollama list

-

记录下需要配置的模型名称

记录下需要配置的模型名称 -

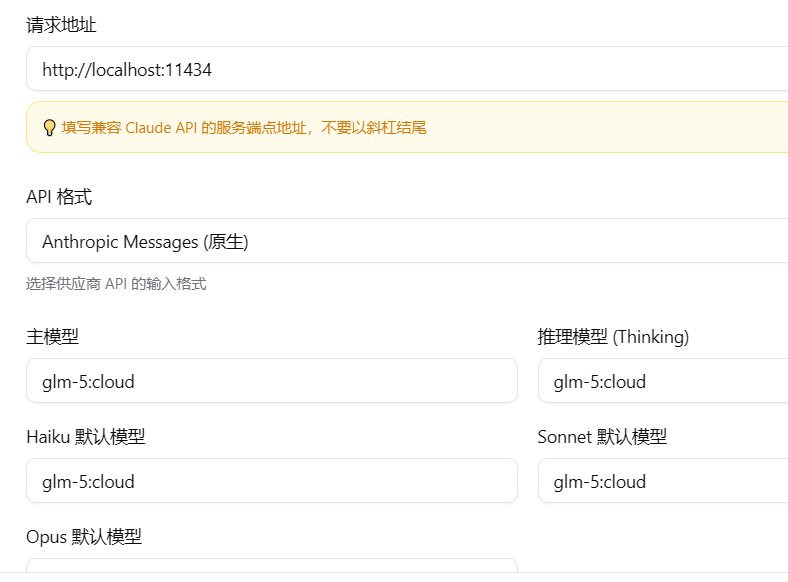

在CC Switch界面中添加新模型,配置信息如下:

-

模型名称:与ollama list显示的名称保持一致

模型名称:与ollama list显示的名称保持一致 -

API地址:http://localhost:11434

-

其他参数保持默认即可

-

使用建议

-

本地模型适用场景:长期开发、大量API调用、对数据隐私要求较高的项目

-

云模型适用场景:短期测试、多账号轮换使用免费额度、需要更强大模型能力的场景

-

混合使用:通过CC Switch可以轻松在本地和云端模型之间切换,根据实际需求灵活选择

注意事项

-

本地部署需要确保机器有足够的硬件资源

-

云模型的Token额度虽每周刷新,但仍需注意使用量

-

中国区用户安装Claude-Code时可能需要配置npm镜像源

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)