OpenClaw 安装与配置API教程(Mac电脑,超详细喂饭)

基于:OpenClaw Version 2026.2.26,本文完整记录了OpenClaw在MacOS系统上的完整安装部署过程,其实并不难,一步步照着走,就能装起来。本文已经对安装的每一步都做了截屏,可谓喂饭级教程。祝大家每个人都可以顺利获得一只自己的🦞。

基于:OpenClaw Version 2026.2.26,本文完整记录了OpenClaw在MacOS系统上的完整安装部署过程,其实并不难,一步步照着走,就能装起来。本文已经对安装的每一步都做了截屏,可谓喂饭级教程。祝大家每个人都可以顺利获得一只自己的🦞。

0. 安装前准备:检查 Node.js 环境

OpenClaw 依赖 Node.js 运行,安装前先确认一下本机是否已有 Node.js(版本需要 22 或以上)。

在终端输入:

node --version

看到版本号(如 v22.x.x) → 正常,直接跳到下一步安装 OpenClaw。

看到 command not found → 说明还没装 Node.js,先按以下步骤安装:

第一步:安装 Homebrew(如果已有则跳过)

which brew || /bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"

如果已经安装过 Homebrew, which brew 会直接打印路径,自动跳过安装。

第二步:用 Homebrew 安装 Node.js

brew install node

安装完成后再运行 node --version,看到版本号即可继续。

⚠️ Node.js 版本需要 22 或以上,版本太低可运行 brew upgrade node 升级。

1.安装OpenClaw

在Mac机上安装龙虾(OpenClaw🦞)非常简单,只需要一条指令。

打开Mac电脑的终端工具,在命令行输入一条指令,敲回车运行(确保Mac已联网,最好开个🪜,下载一些包可能速度更快一些):

# 安装龙虾

npm i -g openclaw

# 初始化配置

openclaw onboard --install-daemon

(安装过程中如遇到问题,可以随时截图问ChatGPT等AI工具,帮助排障,一般都能快速解决)

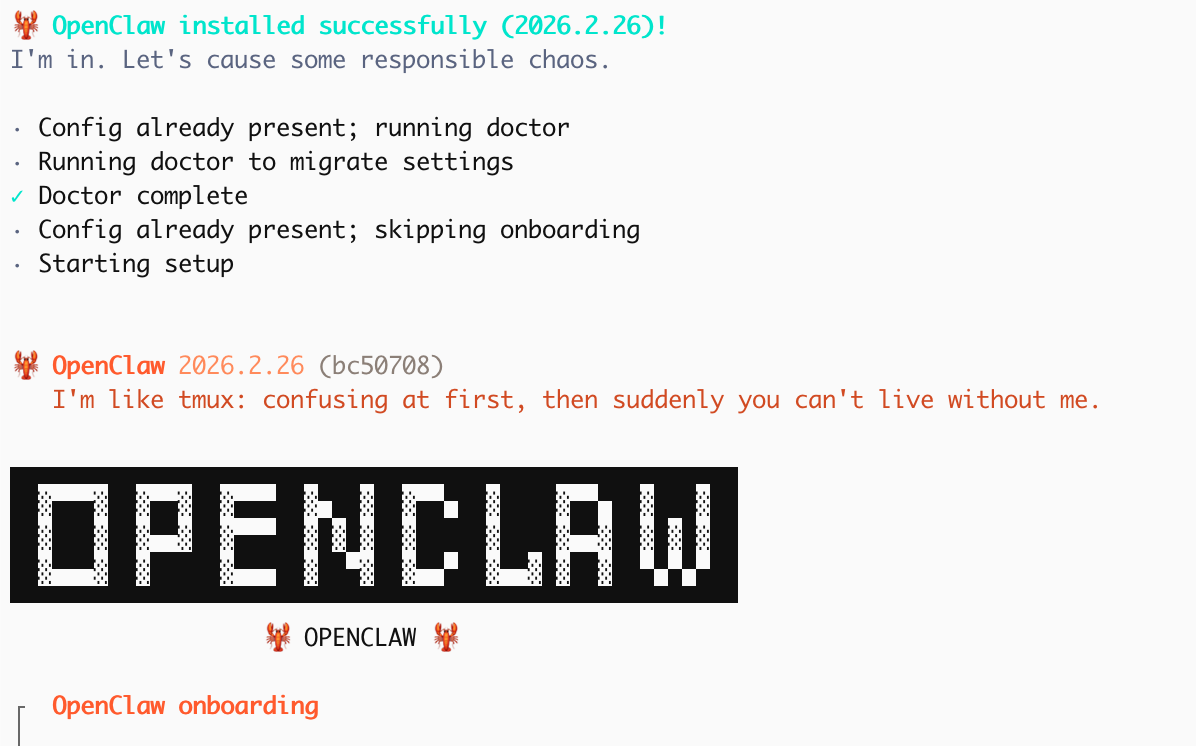

安装完成后,会看到这样的提示界面,说明🦞已经装好了。下图所示,版本号是最新的2026.2.26:

2.配置OpenClaw(Step by Step)

龙虾安装完成后,就进入配置界面,一步步按引导完成即可:

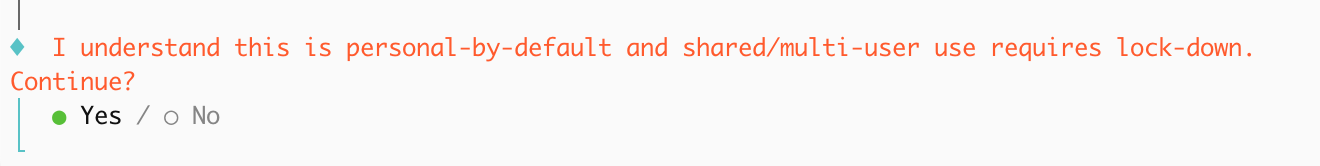

这句话是,它在提醒你:

这个服务默认是“个人电脑本地用”的,如果你打算开放给别人访问(比如局域网 / 服务器部署),需要额外做安全设置。

如果你只是:

-

在自己 Mac 上本地运行,自己个用

-

不对公网开放

选 Yes 就可以。

回车,继续往下走

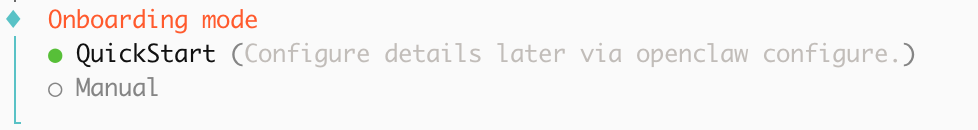

这个是在让你选择 安装/初始化模式(Onboarding mode)。

QuickStart(推荐新手)

快速开始模式 以后可以用

openclaw configure再详细配置

适合:

-

第一次安装

-

想先跑起来看看

-

不想手动填一堆配置

它会:

-

自动生成默认配置文件

-

用最安全的本地模式启动

-

之后你可以再改模型、API key 等

⚪ Manual

手动模式

适合:

-

已经清楚 provider / 模型怎么配

-

需要自定义端口

-

需要特殊网络或多用户部署

-

做生产环境部署

这里,我们先选QuickStart,先采用大多数OpenClaw默认配置。后面再根据需要调整配置

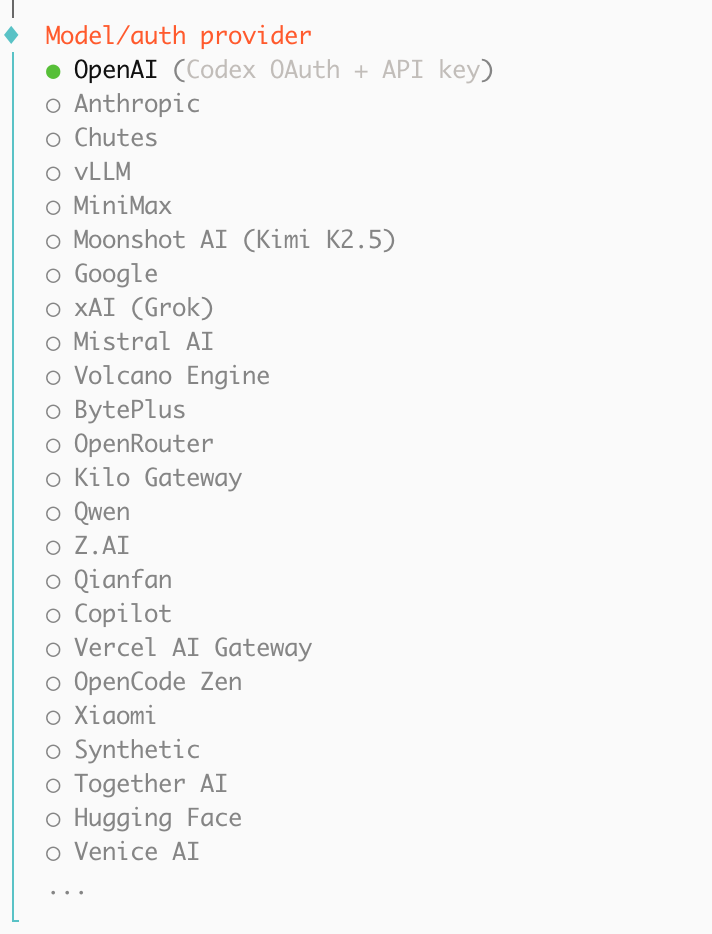

下一步,就是选择模型厂商了。

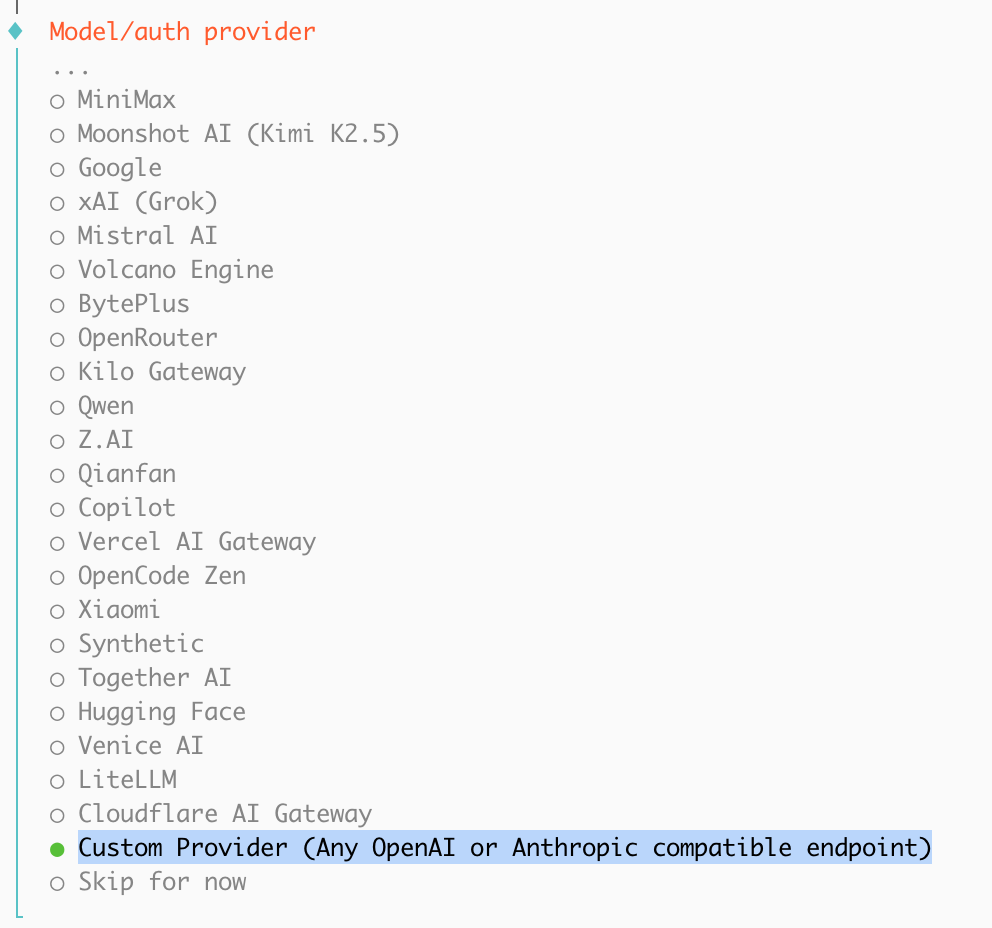

OpenClaw支持的模型厂商很多,几乎市面上所有主流的模型都有。如果你已经开通了模型厂商的API KEY,可以选择对应的模型厂商。MetaChat(https://metachat.fun)作为一站式AI模型聚合平台,已经聚合了所有主流的AI模型,包括ChatGPT系列、Claude系列、Gemini系列、Grok、DeepSeek、Kimi、Miminmax、GLM等。可以实现一个URL接入,切换调用30+模型。

我们如果想把MetaChat API配置到龙虾里面,需要按住向下键,找到Custom Provider (Any OpenAI or Anthropic compatible endpoint)

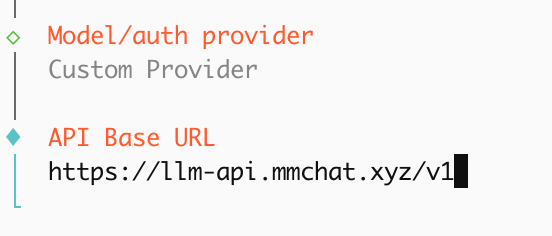

在BaseURL处,填入MetaChat的API接入点(OpenAI兼容模式):

https://llm-api.mmchat.xyz/v1

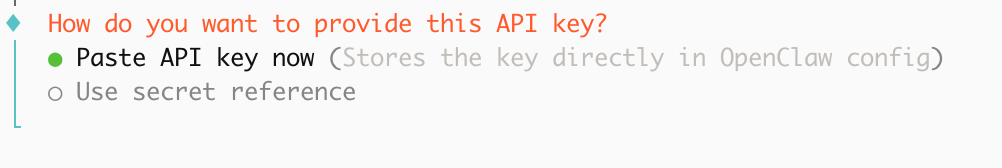

下一步提示输入KEY的方式,选“Paste API key now”

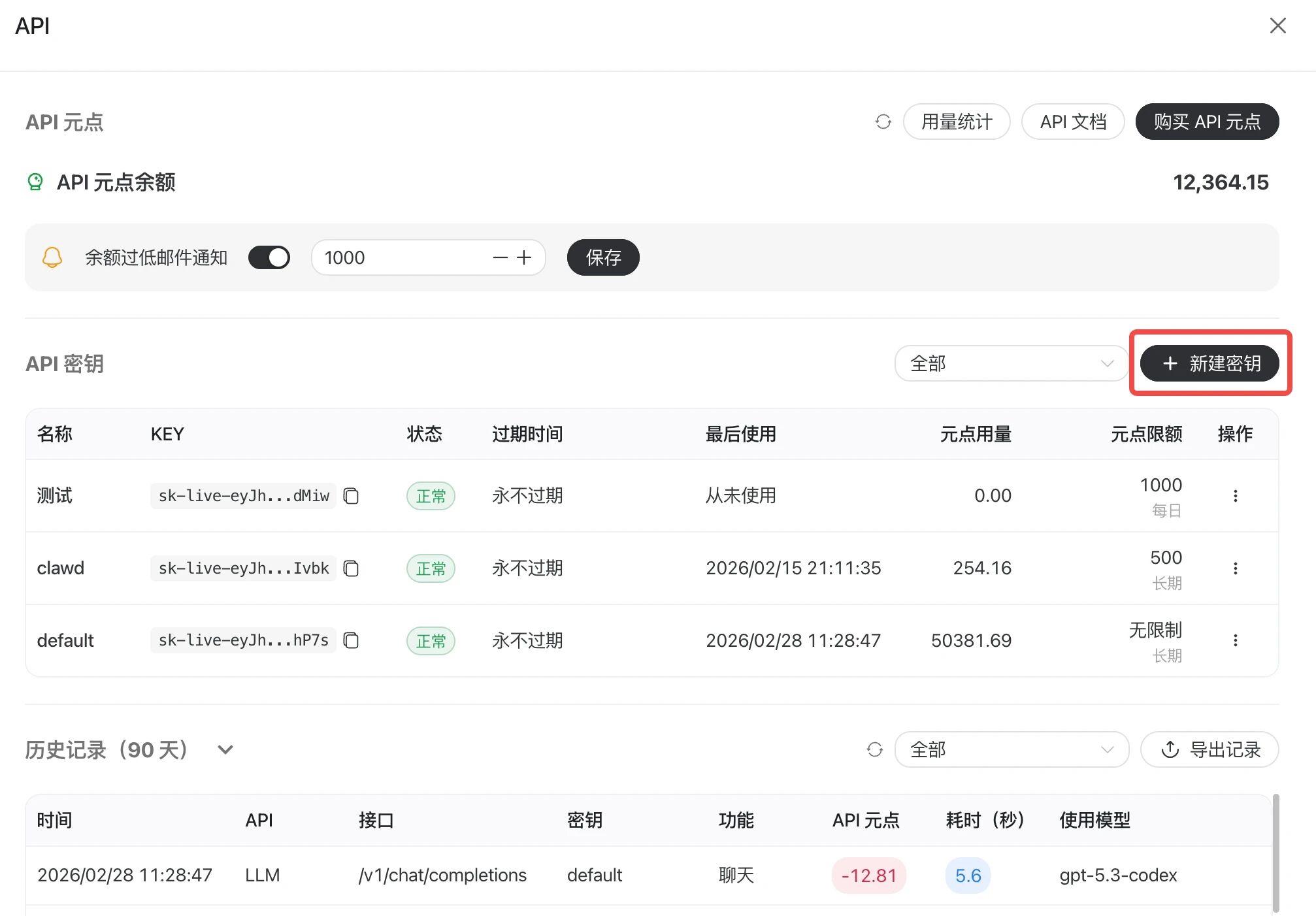

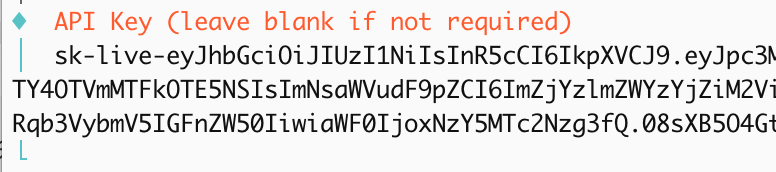

接下来,输入你的MetaChat API KEY

API KEY获取方式:登录MetaChat(https://metachat.fun)后,点击左下方头像区域,在弹出界面中,进入API 管理,点击“新建密钥”,生成你的API密钥即可,点击复制按钮可复制,那串"sk-live..."开头的就是你的API KEY。

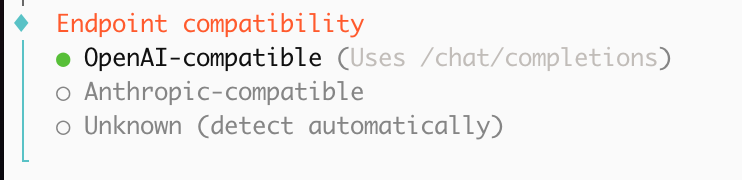

接下来,选择接入点的兼容协议(选OpenAI兼容)

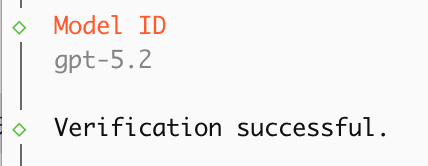

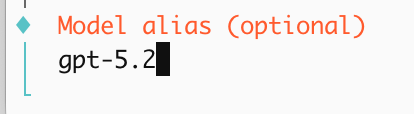

接下来,输入Model ID(MetaChat支持几乎所有主流的LLM,可以根据需要配置,这里,我们以GPT 5.2为例,具体支持的模型列表,请参见API文档:https://metachat.apifox.cn):

输入Model ID:gpt-5.2(注意全部小写),等待它verify,看到提示verfication successful说明配置成功了。

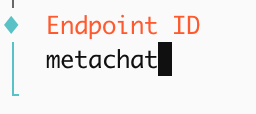

然后,给这个接入点ID起个别名,可以输入:metachat,回车

然后是模型别名,可以不填,也可以填一个你喜欢的别名:

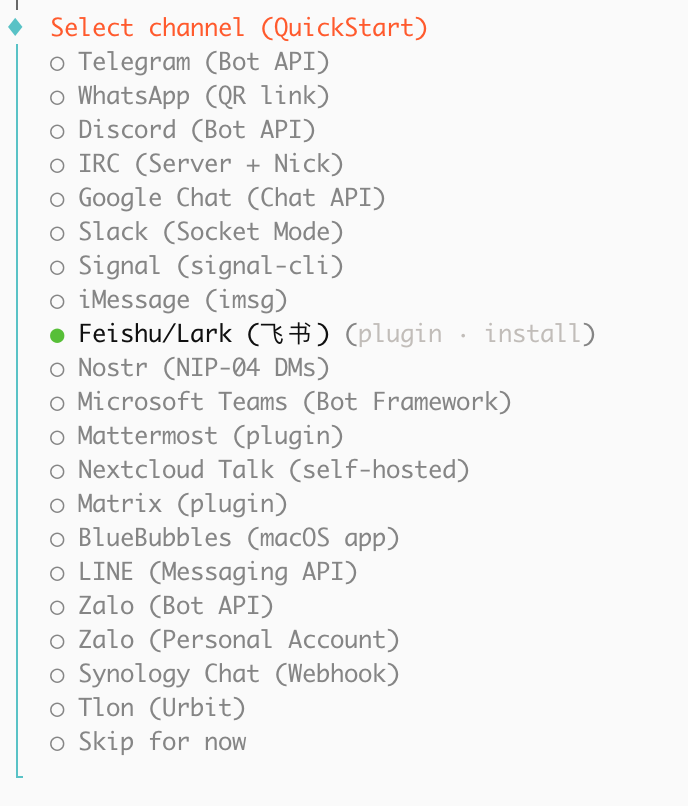

接下来就是选通信渠道了,首选telegram,国内用户推荐使用feishu:

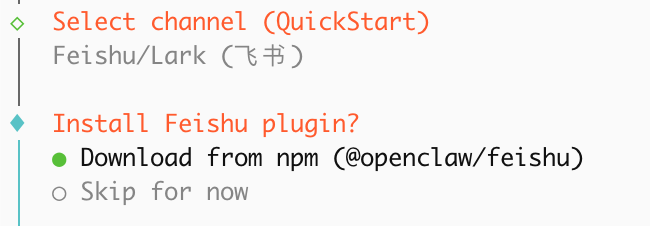

我们先选择飞书,然后回车,接下来会询问是否安装飞书插件。选download

然后开始下载飞书插件,等待安装完成。

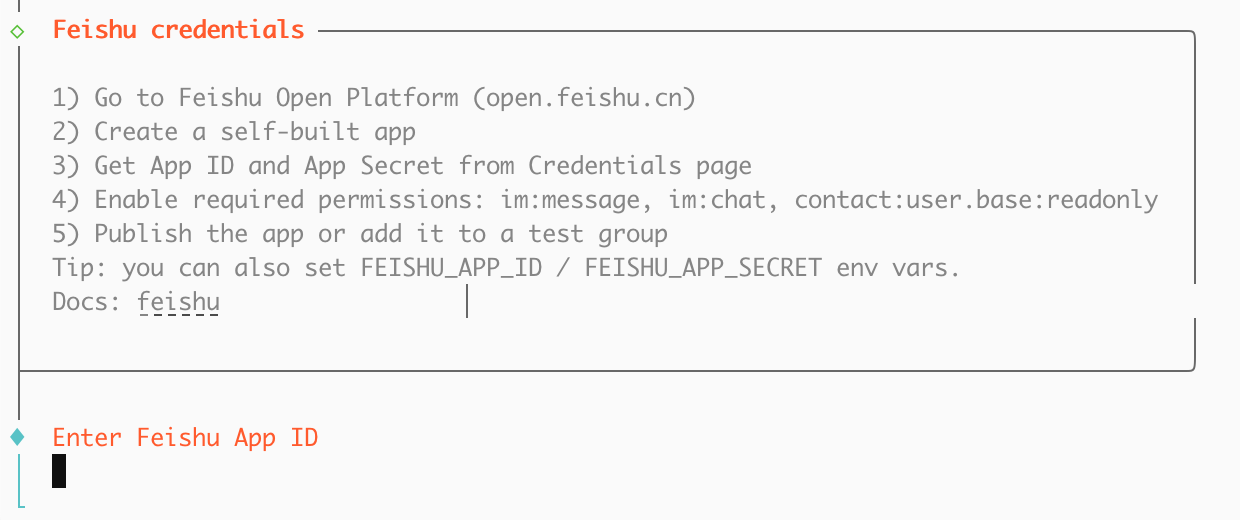

安装完成后,要配置飞书渠道信息,这个要到飞书开放平台上去完成配置:

以下是飞书上配置聊天机器人的详细过程

进入飞书开放平台:open.feishu.cn,进开发者后台

https://open.feishu.cn/app?lang=zh-CN

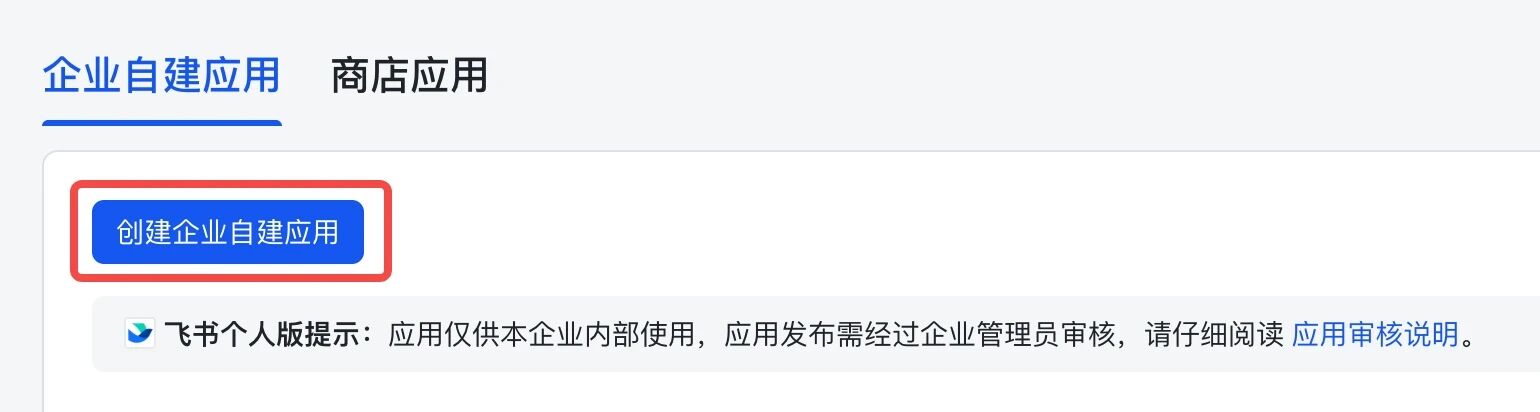

点击创建企业自建应用

输入应用名称(自己随便起一个喜欢的),应用描述,有喜欢的头像图标也可以上传一个,点创建。

应用创建成功之后,就可以获得应用的APPID和APP Secret等信息。点击“凭证与基础信息”查看。

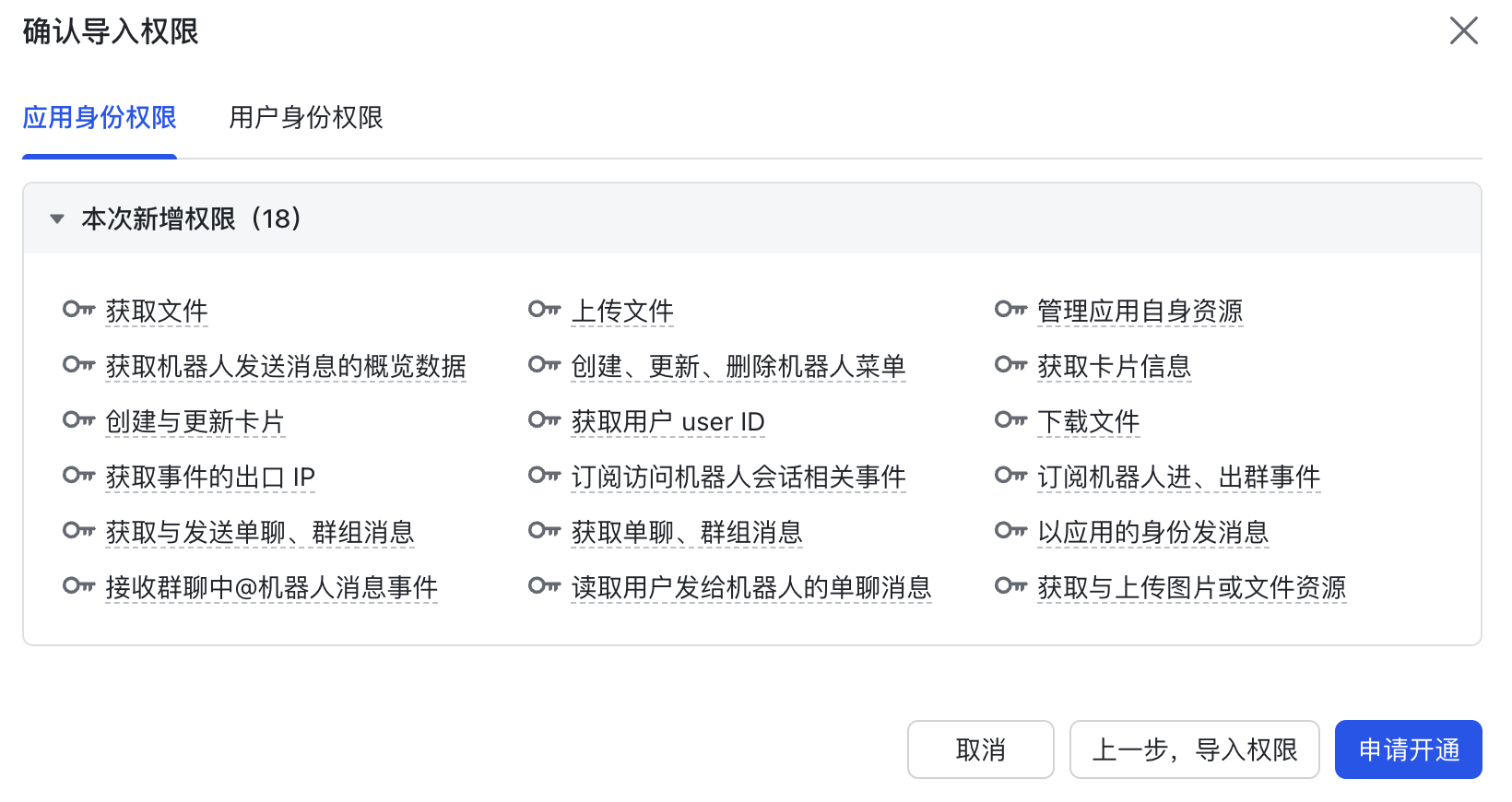

然后是给这个机器人配置权限(主要用于收发消息,访问文件等,可以根据需要增减)

OpenClaw官方给了一段权限代码,实际配置的时候,可以通过批量导入的方式,直接导入这些代码一下就配置好了。

{

"scopes": {

"tenant": [

"aily:file:read",

"aily:file:write",

"application:application.app_message_stats.overview:readonly",

"application:application:self_manage",

"application:bot.menu:write",

"cardkit:card:read",

"cardkit:card:write",

"contact:user.employee_id:readonly",

"corehr:file:download",

"event:ip_list",

"im:chat.access_event.bot_p2p_chat:read",

"im:chat.members:bot_access",

"im:message",

"im:message.group_at_msg:readonly",

"im:message.p2p_msg:readonly",

"im:message:readonly",

"im:message:send_as_bot",

"im:resource"

],

"user": ["aily:file:read", "aily:file:write", "im:chat.access_event.bot_p2p_chat:read"]

}

}

点击,下一步,确认新增权限。点击申请开通

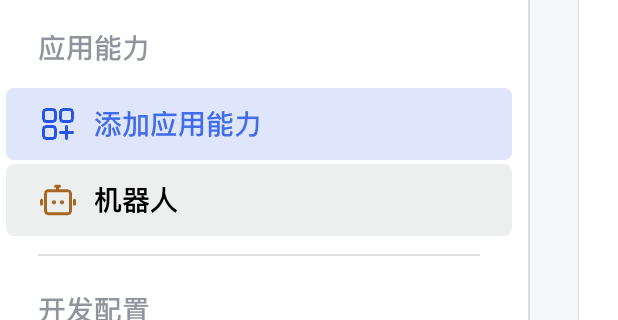

然后,是给这个应用开通“机器人”能力。因为刚刚导入权限的时候,有些权限是属于机器人的能力,所以导入权限完成后,飞书已经自动添加了“机器人”这个能力。

这时候,我们可以切回到OpenClaw的安装界面,完成一些信息输入了。把前面飞书开放平台获得App ID,App Secret输入,回车。然后OpenClaw会做一个连接测试,这里显示已经connected。如果用国内的飞书选择feishu.cn,用海外的Lark,选Lark

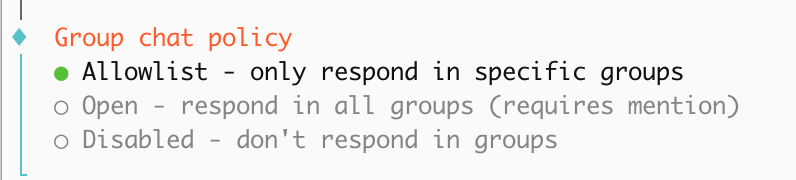

然后 群聊响应策略(Group chat policy) 的设置,这里按默认走,接下来会需要输入groupid,因为我们还没有创建群组,直接回车跳过就行。

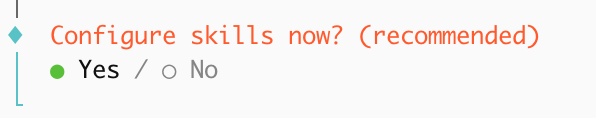

接下来是Skill的配置,点击确认往下走

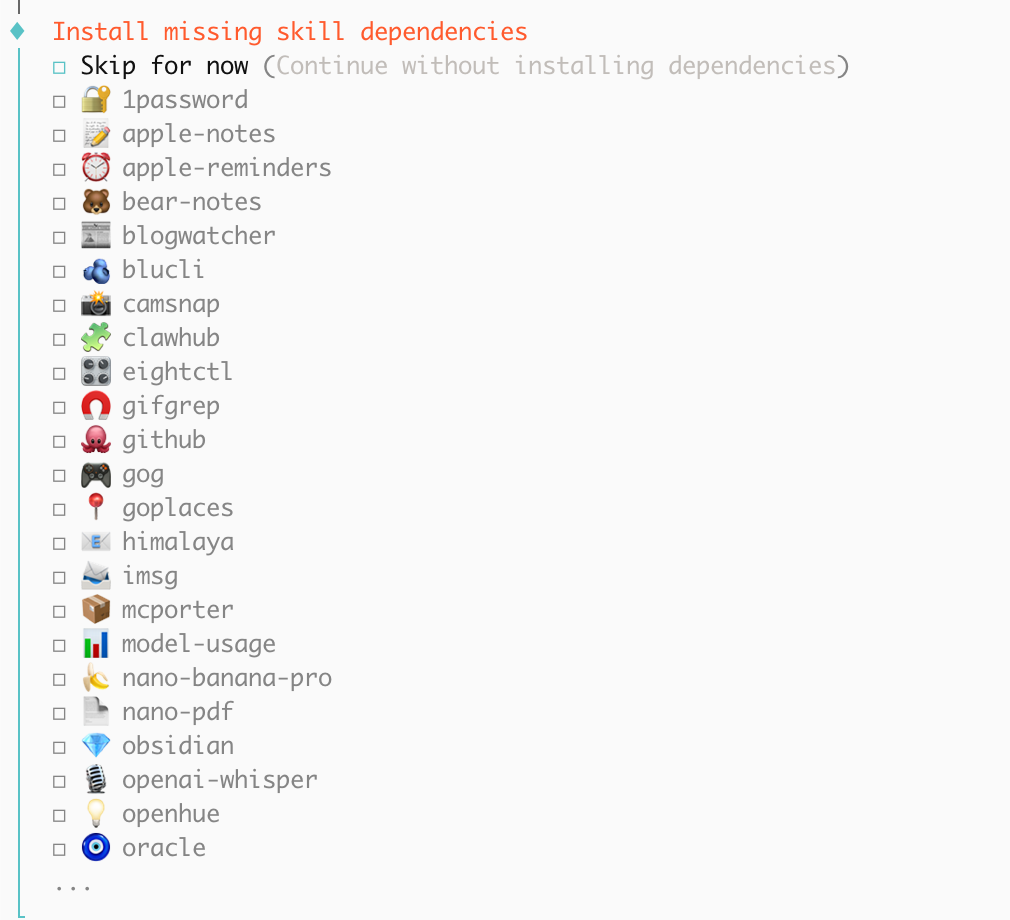

有些Skill的安装,需要依赖。这里我们可以先忽略,等后面用的时候再配置,先尽快完成龙虾的配置

按一下空格键,选中“Skip for now” 回车

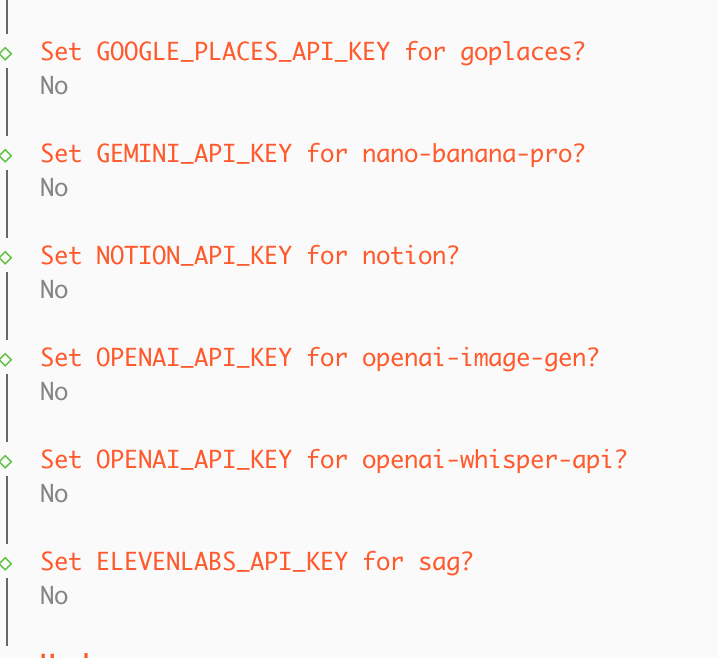

接下来几个是API的配置,如果有可以配置上,没有就先跳过

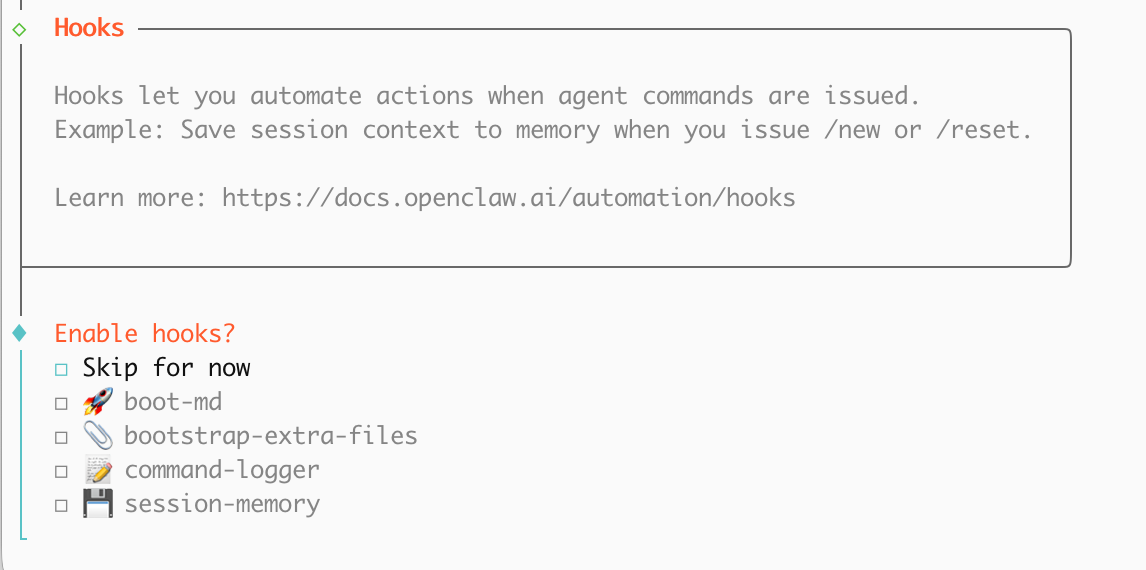

接下来是Hooks配置,这个我们第一次安装,可以先选择跳过,等以后有需要随时可以开启

空格键,选择Skip for now,跳过

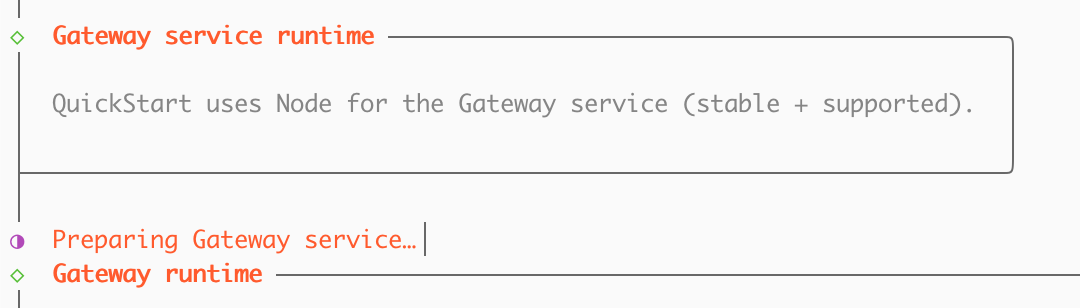

接下来就是安装核心服务Gateway了:

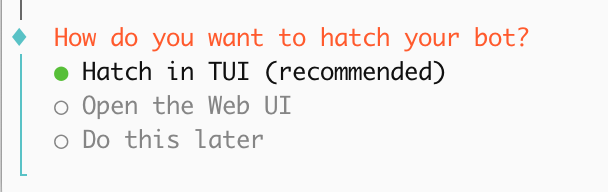

几分钟,Gateway就安装好了,接下来询问你启动哪个客户端

TUI是Teminal UI,还是在命令行里面,官方最推荐这个

喜欢通过浏览器访问的可以选择第二个 Open the Web UI

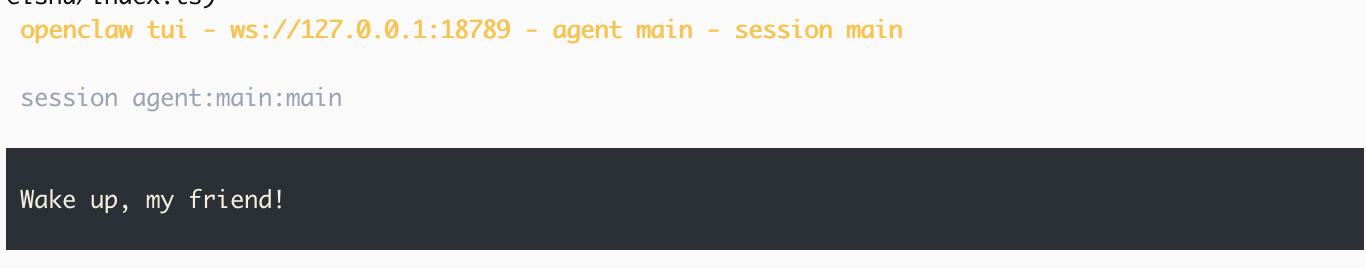

这里,我们先选TUI,让OpenClaw先跑起来。直接回车。看到龙虾OpenClaw已经启动了。看到了Wake up, my friend。

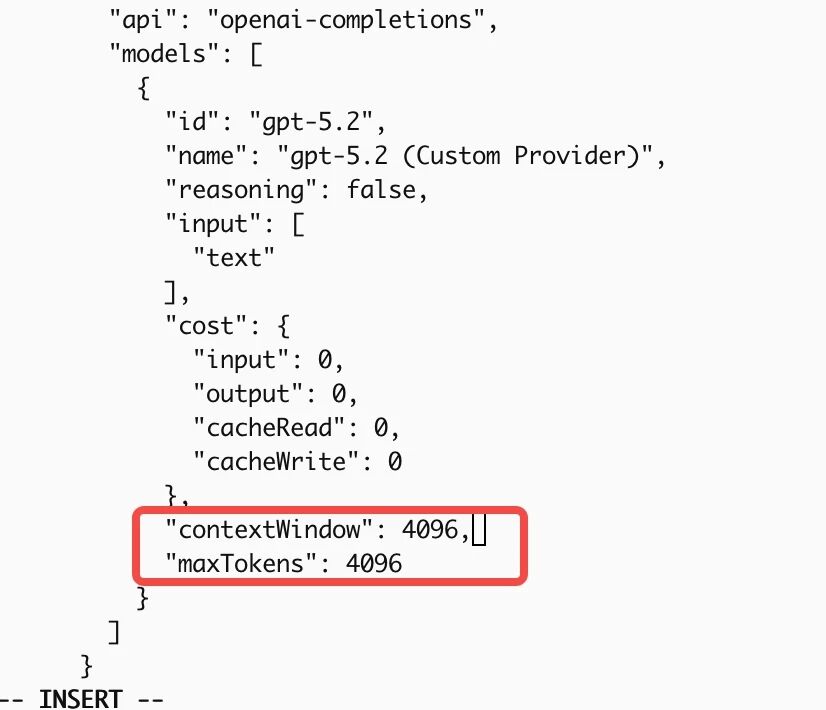

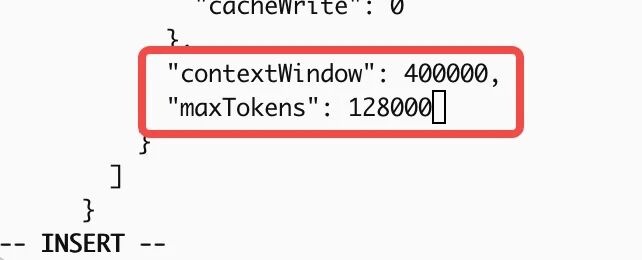

由于龙虾最早的版本对自定义模型provider的配置考虑的是对本地部署小模型的支持类似Ollama的方案,所以,上下文长度和最大输出token的大小设置的都非常小,达不到龙虾最新版本的要求,因为启动起来会报错。

我们需要手动修改一下这个值,才能使用MetaChat的模型

一键安装30+MetaChat模型,包括:

命令行执行:

export METACHAT_API_KEY="你的APIKey" && curl -fsSL https://raw.githubusercontent.com/metachat2026/support/main/openclaw/setup-metachat-openclaw.js | node

// ========== 模型清单(2026-03-06 更新)==========

// OpenAI 系列

openai: [

{ id: 'gpt-5.3-codex', name: 'GPT Codex 5.3' },

{ id: 'gpt-5.2', name: 'GPT-5.2' },

{ id: 'gpt-5.2-pro', name: 'GPT-5.2 Pro' },

{ id: 'gpt-5', name: 'GPT-5' },

{ id: 'gpt-5-mini', name: 'GPT-5 Mini' },

{ id: 'gpt-5-nano', name: 'GPT-5 Nano' },

{ id: 'gpt-4.1', name: 'GPT-4.1' },

{ id: 'gpt-4.1-mini', name: 'GPT-4.1 Mini' },

{ id: 'gpt-4.1-nano', name: 'GPT-4.1 Nano' },

{ id: 'gpt-4o', name: 'GPT-4o' },

{ id: 'gpt-4o-mini', name: 'GPT-4o Mini' }

],

// Claude 系列

claude: [

{ id: 'claude-opus-4-6', name: 'Claude Opus 4.6' },

{ id: 'claude-opus-4-5-20251101', name: 'Claude Opus 4.5 (2025-11-01)' },

{ id: 'claude-sonnet-4-6', name: 'Claude Sonnet 4.6' },

{ id: 'claude-sonnet-4-5-20250929', name: 'Claude Sonnet 4.5 (2025-09-29)' },

{ id: 'claude-haiku-4-5-20251001', name: 'Claude Haiku 4.5 (2025-10-01)' },

],

// Google Gemini 系列

gemini: [

{ id: 'gemini-3.1-pro-preview', name: 'Gemini 3.1 Pro' },

{ id: 'gemini-3-pro-preview', name: 'Gemini 3 Pro' },

{ id: 'gemini-3-flash-preview', name: 'Gemini 3 Flash' },

{ id: 'gemini-2.5-pro', name: 'Gemini 2.5 Pro' },

{ id: 'gemini-2.5-flash', name: 'Gemini 2.5 Flash' },

],

// Grok 系列

grok: [

{ id: 'grok-4-1-fast-non-reasoning', name: 'Grok 4.1 Fast (Non-reasoning)' },

{ id: 'grok-4-1-fast-reasoning', name: 'Grok 4.1 Fast (Reasoning)' },

{ id: 'grok-4-fast', name: 'Grok 4 Fast' },

{ id: 'grok-code-fast-1', name: 'Grok Code Fast 1' },

],

// 其他模型

others: [

{ id: 'minimax-m2.1', name: 'MiniMax M2.1' },

{ id: 'kimi-k2.5', name: 'Kimi K2.5' },

{ id: 'glm-4.7', name: 'GLM 4.7' },

],

如果你更喜欢手动修改,也可以使用手动修改方法:

找到 ~/.openclaw/openclaw.json ,编辑models里面的上下文长度和输出值

改成:上下文窗口40万,最大输出token128000

保存,退出。

执行命令:openclaw gateway restart 重启一下龙虾服务

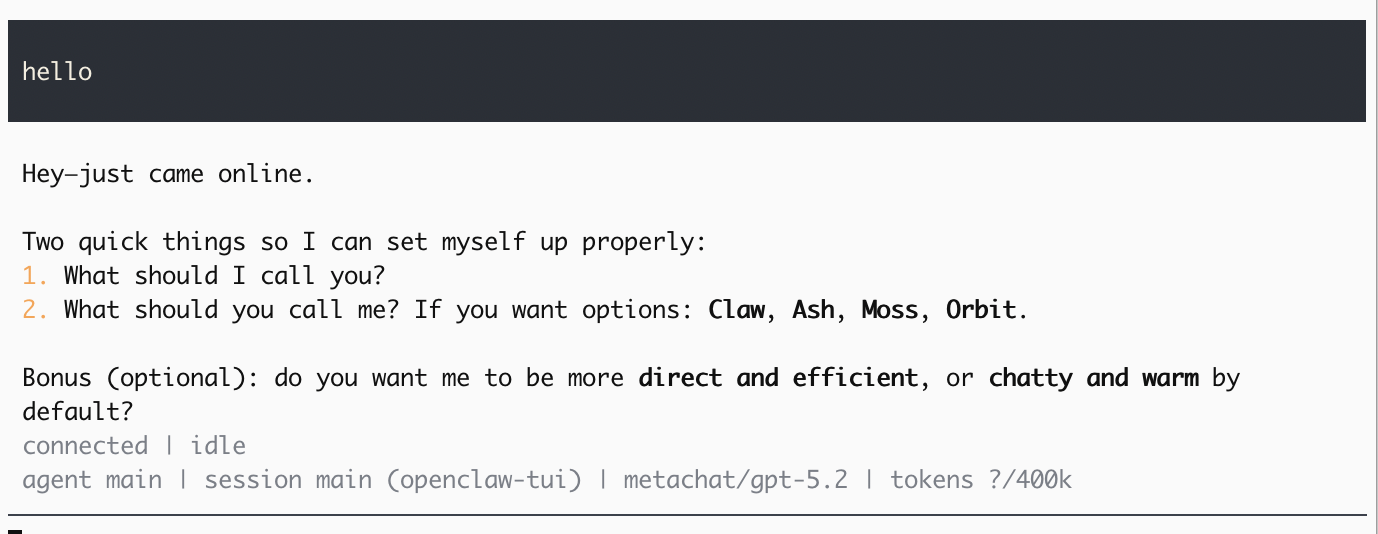

这时,龙虾就完全配置好了。我们启用一下命令行客户端:

执行:openclaw tui

然后说句hello给它,它回复了。第一句话就是给它起个名字吧~。好了剩下的,就好办了。因为你已经跟你的龙虾联系上了,后面有什么事不用自己再搞配置了,直接丢给它让它想办法。比如,添加更多的MetaChat模型,可以让它自己弄

我们再把飞书最后一点配置完,看看能不能通过飞书跟它聊上

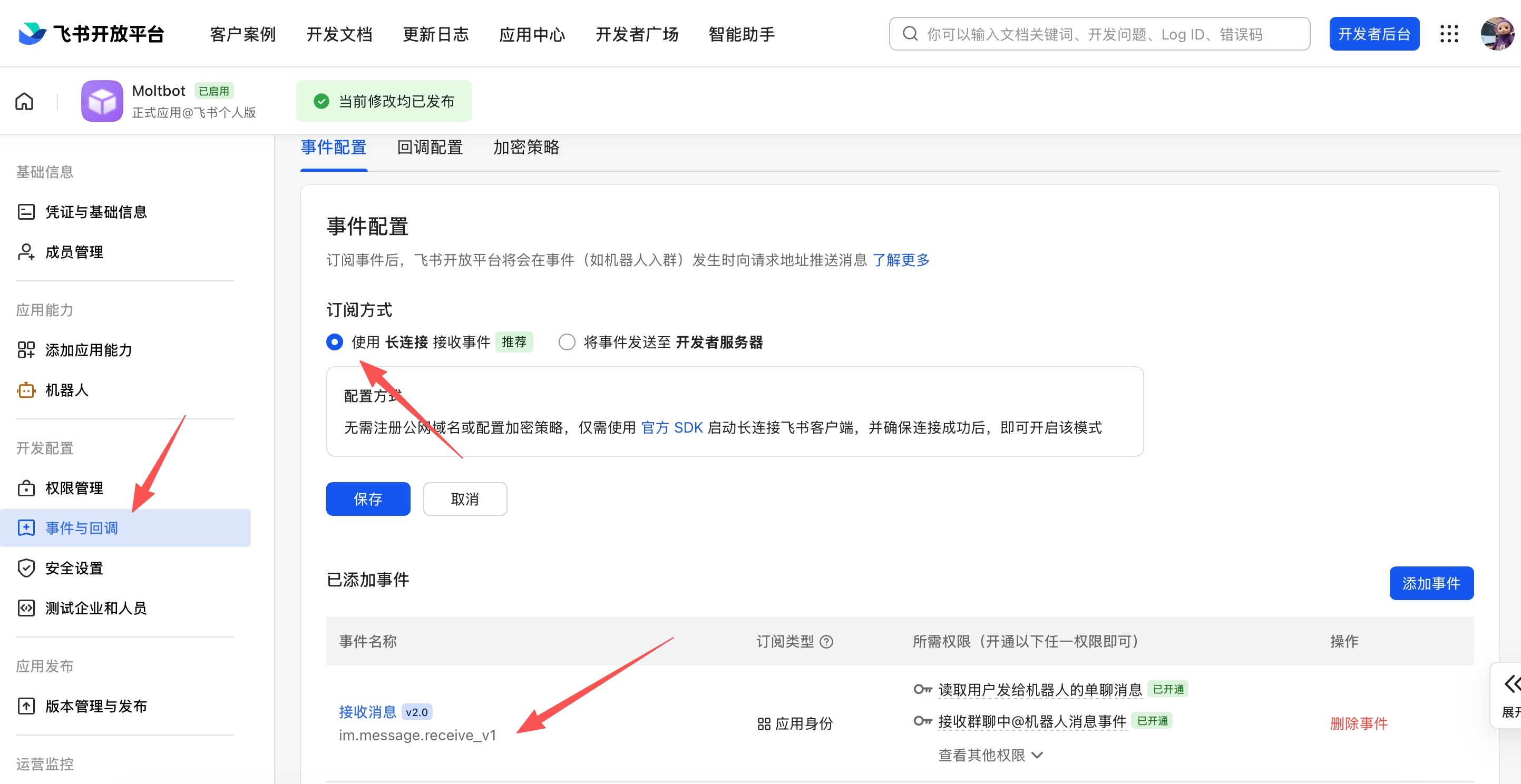

飞书里面还要做一个最后的配置就是订阅和事件的配置:

在事件与回调这里,配一下订阅方式为:长连接。添加接收消息的事件

这时候,我们就可以在飞书上发布应用了。点击上方的“创建版本”,输入版本号,更新说明,点下方保存,在弹出对话框中点击“确认发布”,这个机器人就上线了。

在飞书消息上方的搜索框输入“龙虾哥”,就能看到你创建的这个机器人了

点击“龙虾哥🦞”进入对话,你就可以跟你的openclaw对话了

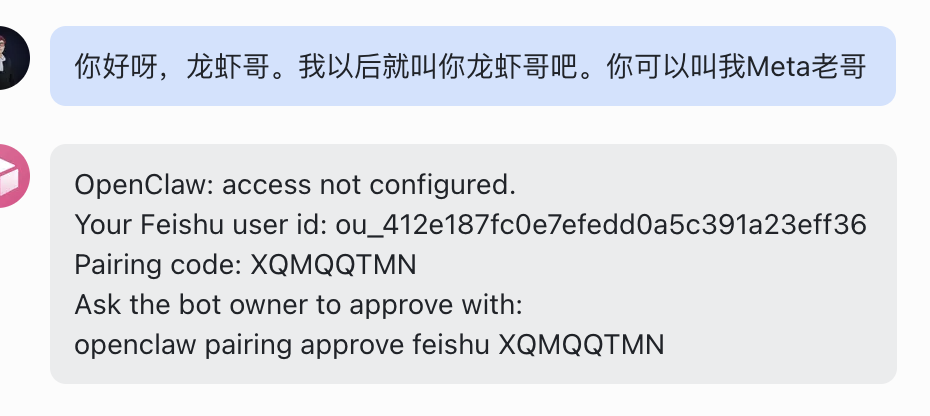

第一次发消息,需要做一下配对批准

把最后一句命令复制出来。openclaw pairing approve feishu xxxx(这个码每次都不一样)

然后在本机命令行运行,就approve了

理论上,所有的配置都搞完了,可以通过飞书跟龙虾对话了

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)