CherryStudio + OpenClaw 本地部署 AI Agent 保姆级教程(2026 最新)

本文介绍 CherryStudio 与 OpenClaw 组合搭建本地 AI Agent 的方法。CherryStudio 作为模型网关对接各类大模型,OpenClaw 负责自动执行复杂任务。文章提供一键部署与独立部署两种方案,适合新手与长期稳定运行场景,同时说明成本、隐私优势及使用注意事项。

CherryStudio 与 OpenClaw 是一对高度互补的 AI 工具,二者结合,能让你在本地快速搭建一个功能完整、隐私可控的个人 AI 助手(AI Agent)。

一、核心概念:它们分别做什么?

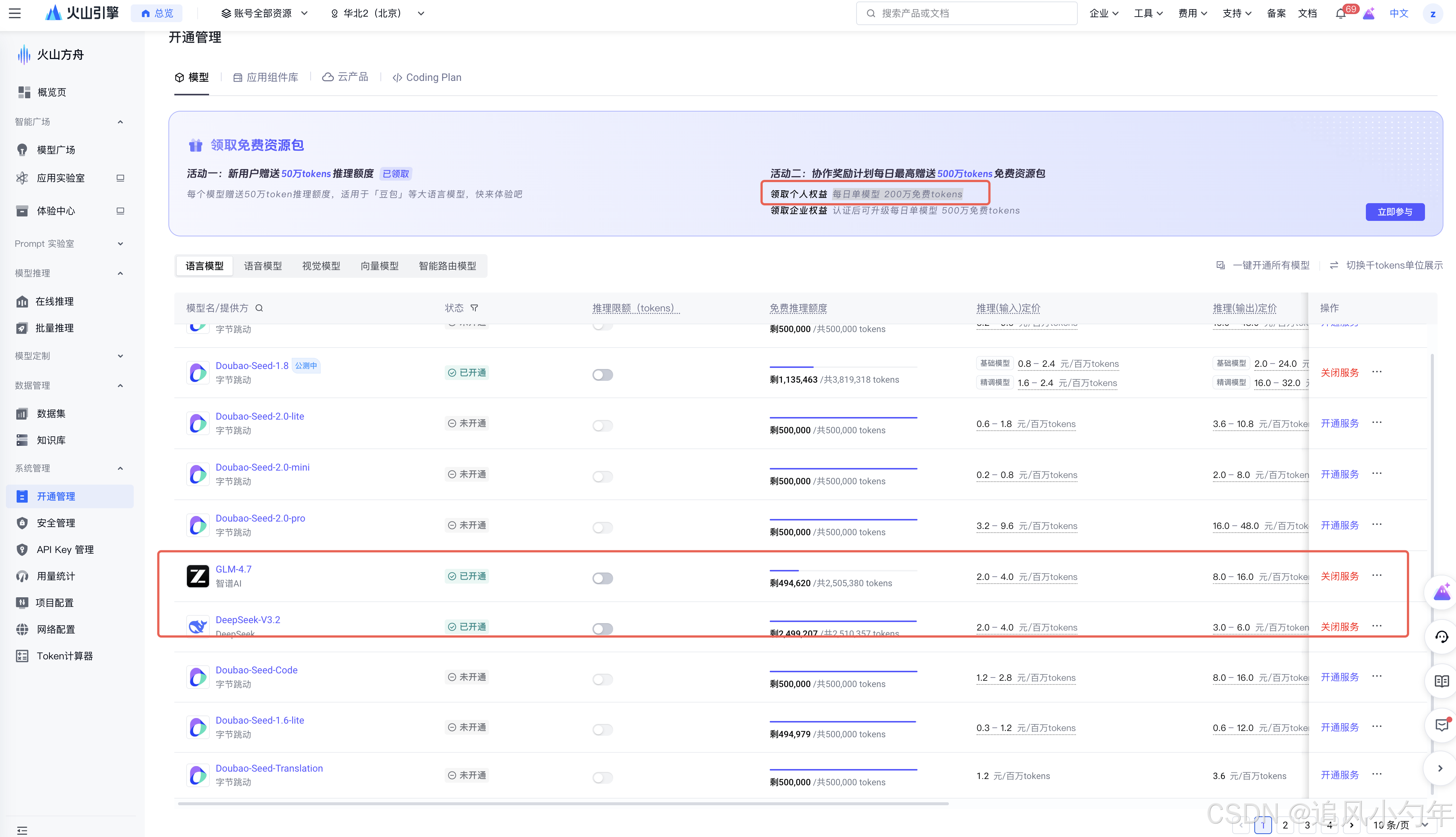

- CherryStudio:本地 AI 对话与模型管理平台,自身不执行复杂任务,而是作为统一模型网关,一键对接 GLM-4.7、DeepSeek、千问、豆包等主流大模型。火山的个人账号每日单模型可享 200 万免费 tokens(模型列表如下图),零成本就能跑起来。

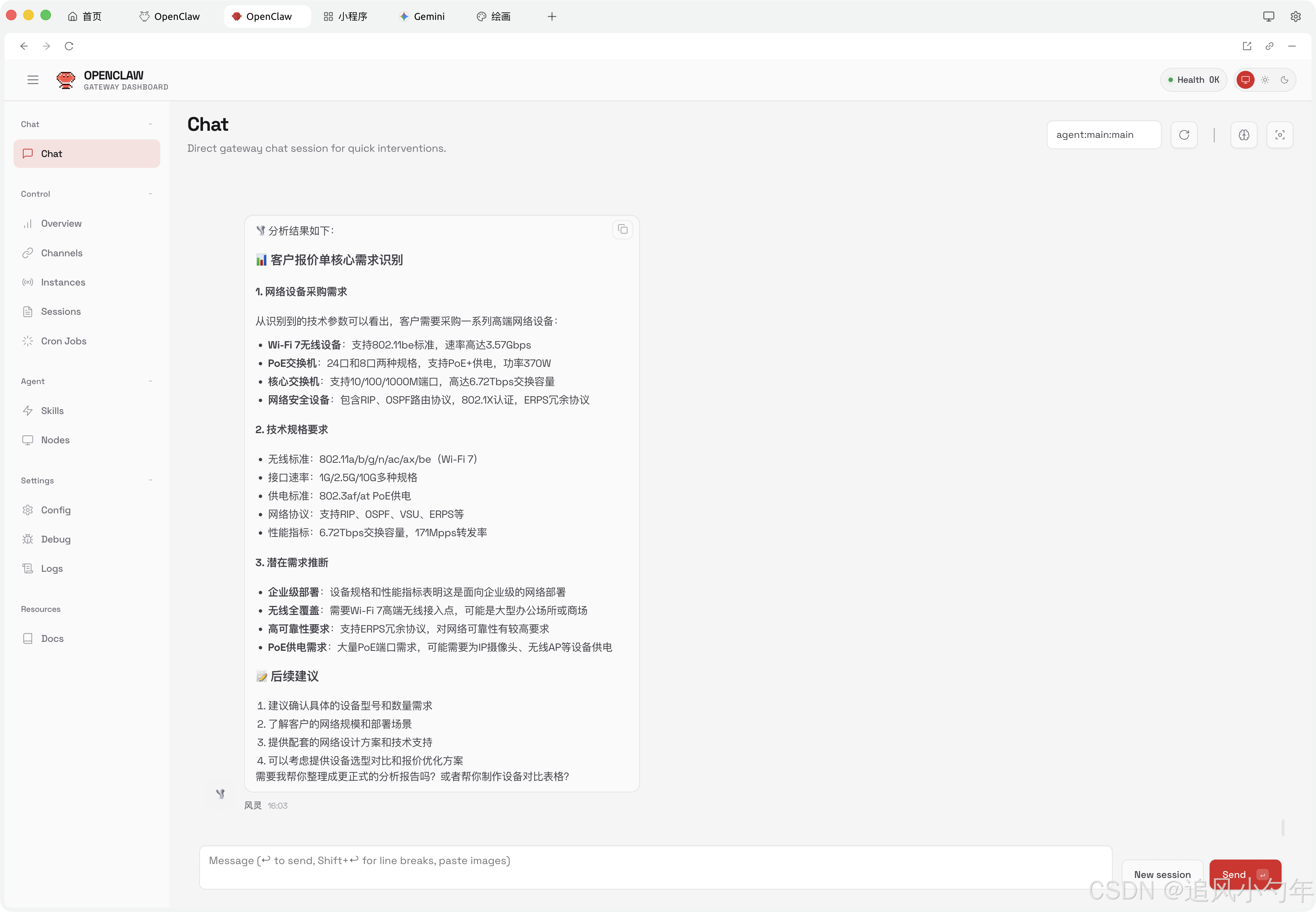

- OpenClaw:开源可自托管的 AI Agent 执行平台,相当于你的数字员工,可通过飞书、Telegram 等聊天工具接收指令,自动完成文件整理、日程管理、网页搜索、邮件发送等复杂任务。仅做对话使用时,可跳过 IM 接入步骤。

一句话总结:CherryStudio 是 AI 的「大脑选择器」,OpenClaw 是 AI 的「手脚执行者」。两者结合,你将拥有一个不依赖云端、数据本地留存、能自动干活的私人 AI 助手。

二、两种部署方式(2026 年 2 月最新)

方式一:CherryStudio 一键部署 OpenClaw(新手首选)

CherryStudio 已将 OpenClaw 封装为图形化一键安装,全程无需命令行、无需 Node.js/Docker,对零基础用户极度友好。

-

安装 CherryStudio前往官网:https://www.cherry-ai.com 下载最新版,建议 v1.7.16 及以上。

-

配置模型服务打开 CherryStudio → 左下角设置 → 模型服务 → 添加模型源。免费方案推荐:火山方舟平台,粘贴从火山方舟控制台获取的 API Key。

-

添加主力模型在模型服务页面点击「管理」,添加常用模型,如

GLM-4.7、deepseek-v3.2。 -

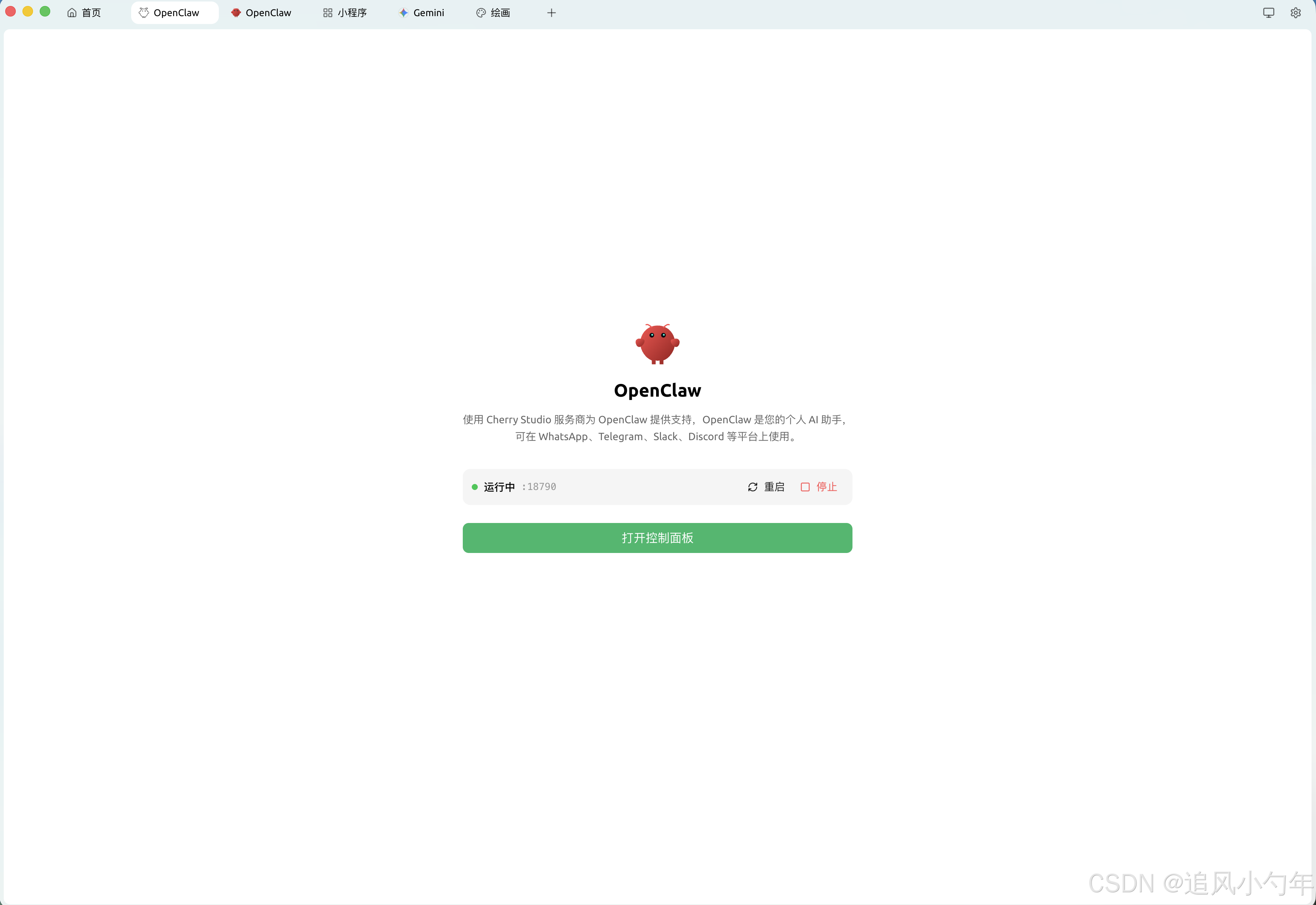

一键安装 OpenClaw返回主界面 → 侧边栏点击 OpenClaw → 点击「安装 OpenClaw」,自动配置环境。

-

启动使用选择已配置好的模型 → 点击「启动」,即可在 CherryStudio 内直接与 OpenClaw 交互,下达自动化任务。

优点:纯图形化、零命令行、零环境依赖,5 分钟上手。

方式二:独立部署 OpenClaw + CherryStudio 作为模型后端

适合需要 7×24 小时稳定运行 的场景(部署在 Mac mini、家用服务器、云服务器等)。

-

在独立设备部署 OpenClaw在 Linux/Windows/macOS 设备上,按官方教程完成 OpenClaw 安装。

-

CherryStudio 开启本地 API 服务在日常使用的电脑上打开 CherryStudio,配置好模型后,开启本地服务器模式(默认端口如 8080),得到本地接口:

http://127.0.0.1:8080/v1 -

OpenClaw 对接 CherryStudio修改 OpenClaw 配置文件

openclaw.json,将模型baseUrl指向 CherryStudio 所在设备的 IP + 端口,并填写 CherryStudio API Key。 -

启动运行启动 OpenClaw,它会通过内网 / 外网调用 CherryStudio 提供的模型能力完成推理。

优点:OpenClaw 独立运行、不占用主力机资源,隐私性与稳定性更强。

三、核心优势与重要注意事项

核心优势

- 近乎零成本:搭配千问、DeepSeek 等免费额度模型,可长期低成本运行 AI Agent。

- 隐私安全:所有数据在本地 / 私有服务器处理,不上传第三方云端,敏感信息不泄露。

- 真正能干活:支持多步骤复杂任务,如「整理上月邮件并归档」「每日凌晨推送 AI 新闻」。

重要提醒

-

Token 消耗较高OpenClaw 解决复杂任务时会进行多轮思考与工具调用,Token 消耗远高于普通对话,请注意账户余额与额度。

-

高权限风险OpenClaw 拥有本地文件读写、应用调用等系统权限,请勿随意授权系统盘与敏感目录,建议在专用测试文件夹内验证能力。

另外,我个人只是研究下openclaw的能力和验证下效果,并未真实对接小飞机或者飞书,文中也未写相关内容,如果对这部分感兴趣的朋友可以自己研究哈。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)